微软声称小型本地化语言模型更强大!用特别高质量数据训练它们

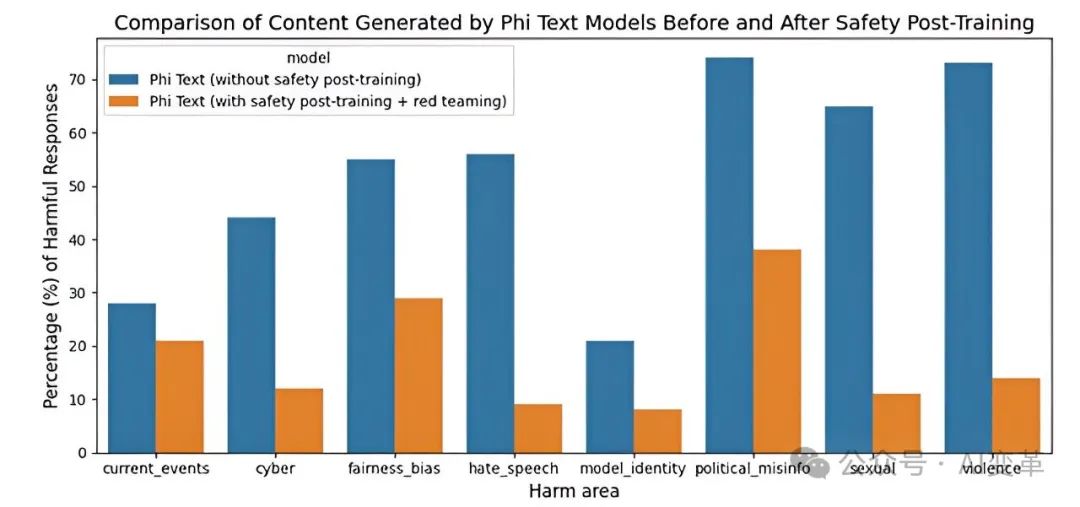

微软最新推出的人工智能语言模型Phi-3 mini,已在arXiv预印本服务器亮相,这是继Phi-1和Phi-2之后的进阶版本。请注意,此图表中的有害响应百分比是夸大的数字,因为红队试图以对抗性方式诱导 phi-3-mini,以通过多轮对话产生有害响应。Phi-3 mini模型以其相对较小的体积和优化的性能,预计将为用户带来更多灵活和高效的使用场景。微软强调,尽管Phi-3 mini的规模较小,其

微软声称小型本地化语言模型更强大!用特别高质量数据训练它们

原创 AI变革 AI变革 2024-04-28 15:21

微软发布Phi-3 mini:一种新型小型AI语言模型

微软最近在arXiv预印本服务器上发布了一项关于名为Phi-3 mini的新型小型、本地运行的人工智能语言模型(SLM)。这款3.8B参数的模型被团队誉为在成本效益和性能方面都优于同类其他模型,甚至一些体积更大的模型。这款模型的开发旨在允许其在没有网络连接的环境下本地运行,从而拓宽其应用范围和可达性。

参数众多,功能强大

这种型号的参数众多,是其强大功能的保证。以GPT-4为例,其参数超过一万亿,需要巨大的运算支持,这也是为什么它不能本地运行的原因之一。Phi-3 mini模型以其相对较小的体积和优化的性能,预计将为用户带来更多灵活和高效的使用场景。

安全调整前后 phi-3-mini 之间 Microsoft AI Red Team 的有害响应百分比比较。请注意,此图表中的有害响应百分比是夸大的数字,因为红队试图以对抗性方式诱导 phi-3-mini,以通过多轮对话产生有害响应。

性能可媲美更大型模型

微软最新推出的人工智能语言模型Phi-3 mini,已在arXiv预印本服务器亮相,这是继Phi-1和Phi-2之后的进阶版本。虽然这款模型体积较小,但它通过使用达3.3万亿代币的高质量数据进行训练,实现了令人瞩目的AI性能。数据源包括精选的网络信息和权威教科书内容,确保了Phi-3 mini的实用性和高效性。

用户体验的新升级

微软强调,尽管Phi-3 mini的规模较小,其性能却能媲美GPT-3.5及其他一些大型语言模型(LLM),在小型设备上也能展现出惊人的处理能力。令人兴奋的是,这款模型已经适配于仅有8GB RAM的计算机上运行,使其更加普及。

为了提升用户体验,微软在新模型中加入了多项新功能,旨在提供更强大、更安全、更愉悦的交互体验。Phi-3 mini现已通过Azure云服务免费向公众开放,同时支持在MAC和PC上使用,确保了其广泛的可接入性和应用前景。

更多推荐

已为社区贡献75条内容

已为社区贡献75条内容

所有评论(0)