发现个AI算力羊毛!新用户注册就送10小时4090,跑模型实测够香

学弟更夸张,之前用笔记本跑7B参数的对话模型,生成一段200字回答要等10秒,用4090跑直接压缩到1.5秒,连说“早知道有这好事,之前熬夜调参都能少掉点头发”。更省心的是环境配置——之前租其他平台的卡,光装PyTorch、CUDA驱动就折腾1小时,这次打开实例一看,常用的深度学习框架全预装好了,连StableDiffusion、LLaMA2的基础镜像都有,选好镜像开机就能跑代码,我学弟用它跑图像

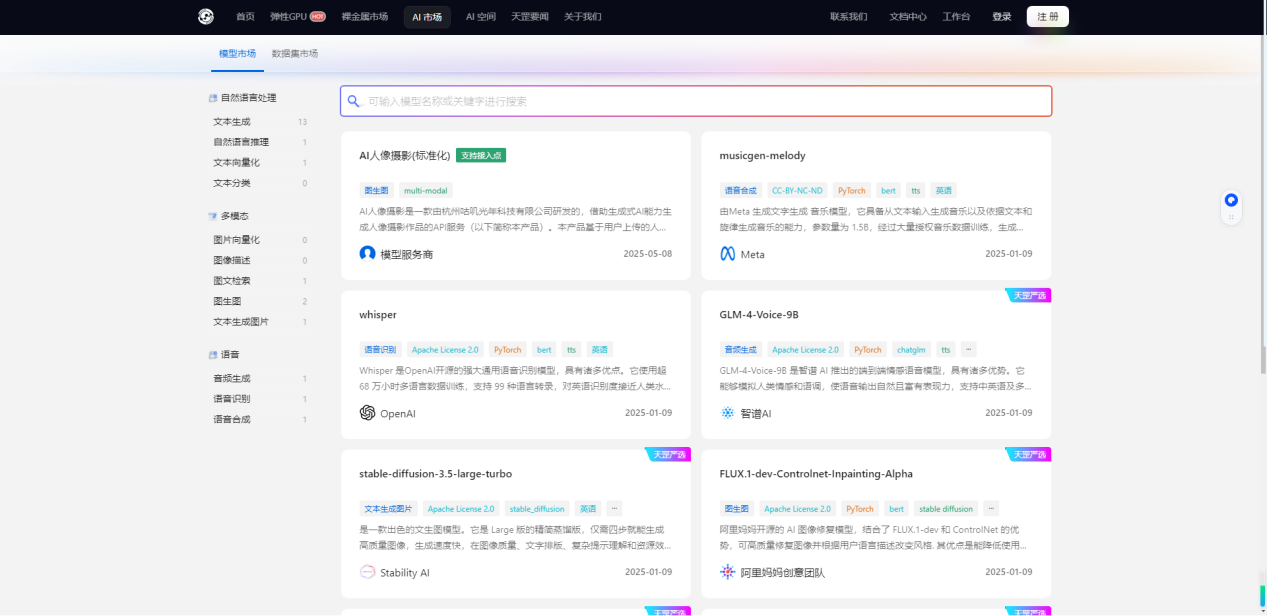

最近帮学弟调模型时总被吐槽“算力不够”——笔记本跑13B模型要卡半天,租云算力又怕踩坑,直到偶然刷到个小众算力平台的福利,才发现原来现在新用户能白嫖高端GPU,亲测10小时4090使用权到手,跑项目效率直接翻倍,必须跟大家分享下。

这次这个平台倒是实在:用手机号注册完事儿就可以领10小时4090额度,不用领券、不用邀好友,就能启动。

更省心的是环境配置——之前租其他平台的卡,光装PyTorch、CUDA驱动就折腾1小时,这次打开实例一看,常用的深度学习框架全预装好了,连StableDiffusion、LLaMA2的基础镜像都有,选好镜像开机就能跑代码,我学弟用它跑图像分类模型,从注册到开始训练总共没超过20分钟。

4090实测:小模型效率翻番,大模型也能扛

拿我自己的项目测试了下:之前用2060跑ResNet-50训练,1个epoch要12分钟,换成这个平台的4090,同样数据量3分钟就搞定,10小时免费额度足够把整个模型微调完。学弟更夸张,之前用笔记本跑7B参数的对话模型,生成一段200字回答要等10秒,用4090跑直接压缩到1.5秒,连说“早知道有这好事,之前熬夜调参都能少掉点头发”。

甚至试了试稍微吃算力的任务:用StableDiffusion生成4K分辨率的产品图,以前在中端卡上要等2分钟,4090只要30秒,而且生成的细节更清晰,连产品包装上的小字都能还原。关键是全程没出现过算力波动,连续跑5小时模型训练,进度条稳稳推进,比之前租到的“共享算力”靠谱多了。

免费额度用完,后续成本也能接受

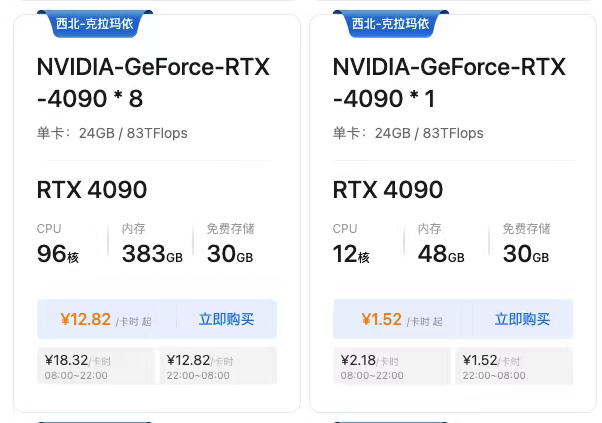

10小时免费肯定不够长期用,但查了下这个平台的定价,发现性价比还挺高:4090白天时费1块出头,晚上22点到早上8点直接半价,算下来夜间用1小时才5毛钱。我帮导师算过账,要是长期跑小模型,每月按100小时夜间算力算,成本也就50多块,比实验室申请算力排队快多了。

而且支持灵活挂载卡数,之前帮企业做简单的AI推理服务,用2张4090组队,响应速度比单卡快1.8倍,成本却只多了80%,比直接租更高端的卡划算。偶尔平台还会搞活动,上次看到新用户充值有赠额,算下来实际成本还能再降点,对学生党和中小团队很友好。

现在身边不少同学都被我安利了这个平台,有用来做毕设模型训练的,有帮工作室做短视频AI剪辑的,连导师都夸“找算力的效率比以前高多了”。要是你最近也缺算力,不妨去搜搜看,10小时免费4090先试试水,说不定能解决不少麻烦。对了,你们用免费算力都想跑什么项目?评论区聊聊,或许能互相给点思路~

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)