运动目标检测技术在OpenCV中的实战应用

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库,由Intel主导开发,并且由 Willow Garage、Itseez 等公司赞助。OpenCV提供了超过2500个优化的算法,涵盖了图像处理、计算机视觉、视频分析、计算机图形和机器学习等领域。它包含C++、Python、Java和MATLAB等语言的接口,并支持Windo

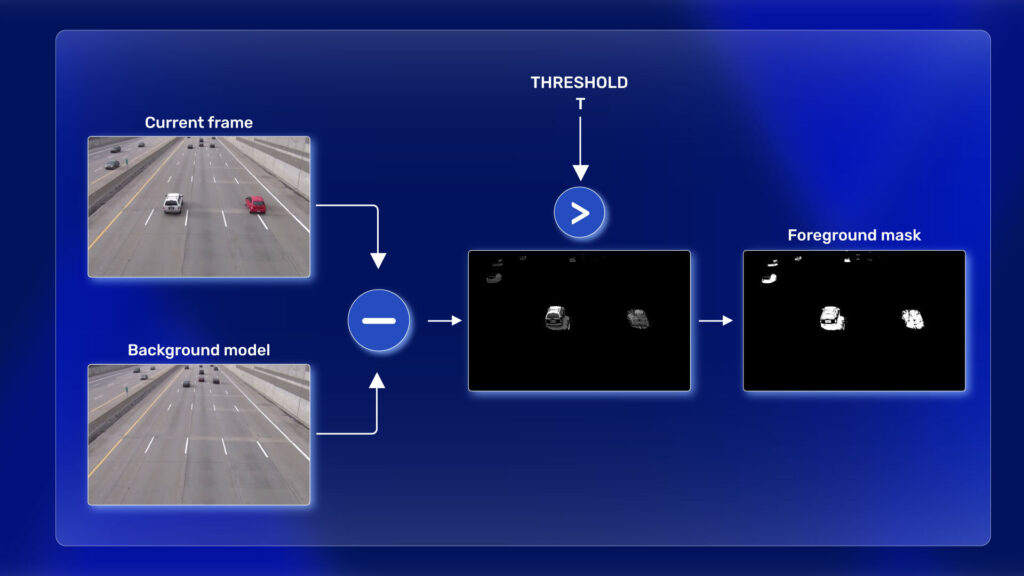

简介:本压缩包包含了三种计算机视觉中用于运动目标检测的技术:光流法、帧间差分法和高斯背景模型差分法,并在OpenCV库下实现。光流法通过计算像素位移来估计运动,适用于平滑运动;帧间差分法通过比较连续帧差异来检测运动区域,受背景稳定性影响;高斯背景模型差分法通过学习背景并检测运动物体,适用于复杂背景下的运动目标检测。文档文件提供了方法的对比分析,AVI文件用作测试和演示。开发者可结合API选择合适的方法以优化检测性能。

1. 光流法运动目标检测

1.1 光流法基本概念

光流法是一种基于图像序列分析的技术,它通过计算相邻帧之间像素点的运动向量来检测和分析视频中的运动目标。其核心在于假定场景中亮度保持不变,从而推断出像素点随时间变化的速度场,即光流场。

1.2 光流法的技术优势

该方法的优势在于对运动的连续性有很好的描述能力,特别适合于追踪视频中缓慢移动的目标。它不仅能够提供运动信息,还能在一定程度上处理遮挡问题,这使其在实际应用中具有重要的价值。

1.3 光流法的应用场景

由于其在运动连续性检测上的优势,光流法在自动驾驶车辆的交通监控、机器人导航以及医疗图像分析等领域有着广泛的应用前景。在这些场景中,能够连续跟踪和分析运动目标是极其重要的。

光流法作为一种高效的运动目标检测技术,将在未来的智能视频分析领域扮演更为重要的角色。接下来的章节将探讨其他运动目标检测技术,并对它们进行比较分析,以帮助读者选择最适合的检测技术。

2. 帧间差分法运动目标检测

2.1 帧间差分法的基本原理

2.1.1 帧间差分法的理论基础

帧间差分法是一种基于时间连续两帧或几帧图像差值检测运动目标的技术。在连续帧之间,背景环境变化相对较小,而运动目标由于其位置的移动会在图像中引起较大的像素值变化。通过计算连续两帧图像之间的差异,可以突出显示运动区域,进而实现运动目标的检测。

帧间差分法在实际应用中简单、计算量小,适合实时监控系统的初步运动检测。然而,它对噪声敏感,尤其是在光照变化明显的场景中,容易产生误检。

2.1.2 帧间差分法的关键步骤解析

实现帧间差分法的关键步骤包括图像预处理、差分计算、二值化处理以及形态学处理等。

- 图像预处理 :通常会对图像进行灰度化处理,降低计算复杂度。同时,可能会使用滤波器对图像进行降噪处理。

- 差分计算 :计算连续两帧图像对应像素点的绝对差值。对于彩色图像,需要分别对RGB分量进行差分,然后将结果合成灰度图像。

- 二值化处理 :设定一个阈值,将差分结果转换为二值图像。通过这一步可以得到一个粗略的运动目标二值掩码。

- 形态学处理 :运用形态学开运算或闭运算,消除二值图像中的噪声和孔洞,使检测到的运动目标区域更清晰。

2.2 帧间差分法的实现与优化

2.2.1 OpenCV中的实现方法

在OpenCV库中,帧间差分法的实现十分直接。以下是使用OpenCV函数实现帧间差分法的代码示例:

import cv2

import numpy as np

# 读取视频或者摄像头流

cap = cv2.VideoCapture('path/to/video')

# 读取第一帧图像

ret, frame1 = cap.read()

frame1 = cv2.cvtColor(frame1, cv2.COLOR_BGR2GRAY)

while(cap.isOpened()):

# 读取下一帧图像

ret, frame2 = cap.read()

if not ret:

break

frame2 = cv2.cvtColor(frame2, cv2.COLOR_BGR2GRAY)

# 计算两帧图像的差异

diff = cv2.absdiff(frame1, frame2)

# 对差值进行阈值二值化处理

gray = cv2.threshold(diff, 25, 255, cv2.THRESH_BINARY)[1]

# 应用形态学操作去除噪声

gray = cv2.dilate(gray, None, iterations=2)

# 更新第一帧图像

frame1 = frame2

# 显示结果

cv2.imshow('frame', gray)

key = cv2.waitKey(1)

if key == ord('q'):

break

cv2.destroyAllWindows()

cap.release()

2.2.2 帧间差分法性能优化技巧

为了提升帧间差分法的性能,以下是一些优化建议:

- 阈值选择 :阈值的选择对结果影响较大。可以通过动态阈值算法,根据图像的特性自适应选择阈值。

- 背景模型融合 :结合背景差分法,使用背景模型预处理图像,可以更有效地抑制背景变化带来的影响。

- 帧率调整 :适当降低视频帧率,可以减少计算量,同时在大部分监控场景中,依然能够保持较好的实时性。

2.3 帧间差分法的应用案例分析

2.3.1 实时监控系统中的应用

帧间差分法在实时监控系统中应用广泛。例如,在零售店的监控系统中,通过检测顾客运动区域,可以分析顾客在店内的流动路线,从而优化商品摆放和货架管理。在交通监控中,它可以帮助判断路口车辆的流量和行驶方向。

2.3.2 运动目标跟踪的案例展示

在运动目标跟踪中,帧间差分法作为运动检测的基础,常与其他算法结合使用。例如,将帧间差分法与卡尔曼滤波器结合,可以有效跟踪运动目标的位置变化,即使在目标暂时被遮挡或者暂时消失的情况下,依然可以预测目标的运动轨迹。

通过案例分析,我们可以看到帧间差分法在运动目标检测中的灵活性与实用性。它不仅为监控系统提供了基础运动信息,还为更高级的运动跟踪算法提供了可靠的数据源。

3. 高斯背景模型差分法运动目标检测

在现代视频监控和计算机视觉中,运动目标检测是一个关键的步骤,它能够识别出视频帧中移动的物体,为后续的处理提供基础。高斯背景模型差分法(Gaussian Mixture Model, GMM)是一种广泛应用于运动目标检测的算法,它基于统计模型来区分背景和前景,从而实现目标检测。本章将探讨高斯背景模型差分法的理论框架、实践操作以及效果评估。

3.1 高斯背景模型差分法的理论框架

3.1.1 高斯模型的数学原理

高斯背景模型差分法的核心思想是将每个像素点的值建模为多个高斯分布的叠加。在数学上,一个n维的高斯分布可以表示为:

[ p(x|\mu, \Sigma) = \frac{1}{\sqrt{(2\pi)^k |\Sigma|}} \exp\left(-\frac{1}{2}(x-\mu)^T\Sigma^{-1}(x-\mu)\right) ]

其中,(x)是变量,(\mu)是均值向量,(\Sigma)是协方差矩阵,(k)是维度。

高斯背景模型通常采用几个高斯分布来表示背景,每个高斯分布对应背景的一个颜色和运动状态。每个像素点的值会根据背景模型中的高斯分布权重来判断它属于背景还是前景。

3.1.2 背景建模的基本流程

高斯背景模型的建立需要通过初始几帧视频中像素值的统计特性来完成。基本流程如下:

- 初始化阶段 :选取初始帧,初始化背景模型,为每个像素点建立一个或多个高斯分布。

- 更新阶段 :随着视频帧的推进,不断更新高斯分布的参数(均值、方差和权重),以适应环境光线变化等动态因素。

- 分类阶段 :对于新的视频帧中的每个像素点,将其与背景模型中的高斯分布进行匹配,根据一定的阈值判定为背景或前景(运动目标)。

3.2 高斯背景模型差分法的实践操作

3.2.1 OpenCV中的实现步骤

在OpenCV库中,可以使用 cv::GaussianMixture 类来实现高斯背景模型差分法。以下是使用OpenCV进行运动目标检测的基本步骤:

- 视频读取 :使用

cv::VideoCapture读取视频流。 - 创建背景模型 :初始化

cv::GaussianMixture对象,并设置参数。 - 前景分割 :使用

GaussianMixture::train方法来训练背景模型,并通过GaussianMixture::apply方法来分割前景。 - 后处理 :对分割出的前景进行形态学操作,以去除噪声和填补空洞。

3.2.2 模型训练与更新策略

在训练和更新高斯背景模型时,合理的参数选择至关重要。可以通过调整以下参数来优化模型:

- 高斯分布的数量 :增加数量可以更精细地表示背景,但会增加计算负担。

- 背景学习率 :影响背景更新的速度,过高会导致背景模型无法稳定。

- 权重更新阈值 :只有当像素点的值与高斯分布的差异大于此阈值时,才会更新权重。

// 示例代码:在OpenCV中初始化和更新高斯背景模型

cv::Ptr<cv::BackgroundSubtractor> pMOG2;

pMOG2 = cv::createBackgroundSubtractorMOG2(); // 使用MOG2算法,是高斯模型的一种实现

for(int frameIndex = 0; frameIndex < n_frames; ++frameIndex) {

cap >> frame; // 读取帧

if(frame.empty()) break;

pMOG2->apply(frame, fgmask); // 应用模型,获取前景掩码

// 对fgmask进行后处理,比如形态学操作

}

3.3 高斯背景模型差分法的效果评估

3.3.1 检测准确性的评估方法

评估高斯背景模型差分法的检测准确性通常涉及到以下指标:

- 漏检率 :正确目标未被检测出的比例。

- 误检率 :错误地将背景像素点检测为前景的比例。

- 轮廓准确率 :检测出的目标轮廓与实际目标轮廓的匹配程度。

这些指标可以通过手动标注真实数据,与自动检测结果进行比较得到。

3.3.2 实际场景下的表现分析

在不同的实际场景中,高斯背景模型差分法的表现会有所不同。例如,在户外场景中,由于光照变化、风吹动植物等因素的影响,模型需要有更好的鲁棒性。而在室内场景中,光线变化相对较小,模型可以更稳定地工作。

针对各种场景,可以通过调整模型参数来优化检测性能,如调整学习率、权重更新阈值等。

graph LR

A[读取视频帧] --> B[模型训练和更新]

B --> C[前景分割]

C --> D[后处理]

D --> E[评估检测准确性]

E --> F[优化参数]

F -->|循环| B

以上章节内容展示了高斯背景模型差分法在运动目标检测中的理论框架、实现操作和效果评估。我们详细介绍了模型的数学原理,实现了基于OpenCV的高斯背景模型,并对其在实际场景中的表现进行了分析。通过上述方法,研究者和开发者可以更好地理解和应用高斯背景模型差分法,从而提升运动目标检测的准确性。

4. OpenCV中的运动目标检测应用

4.1 运动目标检测的OpenCV集成

4.1.1 OpenCV库概述

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库,由Intel主导开发,并且由 Willow Garage、Itseez 等公司赞助。OpenCV提供了超过2500个优化的算法,涵盖了图像处理、计算机视觉、视频分析、计算机图形和机器学习等领域。它包含C++、Python、Java和MATLAB等语言的接口,并支持Windows、Linux、Mac OS、iOS和Android等操作系统。OpenCV库在研究和产业界得到了广泛的应用,尤其在运动目标检测和跟踪方面,因其高效的实现、强大的功能和良好的跨平台兼容性,成为了该领域的事实标准工具库。

4.1.2 运动目标检测功能模块

OpenCV中的运动目标检测功能模块主要集中在视频分析部分,其中包含了用于背景减除、帧间差分、光流法等多种运动检测算法的函数和类。OpenCV的cv::BackgroundSubtractor类提供了背景减除的功能,而cv::VideoCapture类则用于视频帧的捕获。帧间差分法在OpenCV中可以通过cv::absdiff()和cv::threshold()函数实现,而光流法检测可以通过cv::calcOpticalFlowFarneback()等函数来完成。

// 示例:使用OpenCV进行帧间差分法运动目标检测

cv::VideoCapture capture("input_video.mp4"); // 打开视频文件

cv::Mat frame1, frame2, difference, thresh;

capture >> frame1; // 读取第一帧

while (true) {

capture >> frame2; // 读取下一帧

cv::absdiff(frame1, frame2, difference); // 计算两帧差异

cv::threshold(difference, thresh, 30, 255, cv::THRESH_BINARY); // 应用阈值化

// 更新帧数据用于下一帧的处理

frame1 = frame2.clone();

// ... 可以添加目标检测算法进行进一步处理

}

在上述代码中,我们首先创建了视频捕获对象,并读取了视频的第一帧。在一个循环中,我们读取新的帧并计算它与前一帧的差异,之后应用一个阈值操作来突出运动区域。这个例子展示了如何使用OpenCV处理视频流数据以及如何通过简单的帧间差分算法检测运动目标。

4.2 OpenCV在不同场景下的应用实践

4.2.1 室内与室外环境的检测差异

在室内环境中,光线条件相对稳定,背景变化较少,因此背景减除法和帧间差分法通常能很好地工作。然而,在室外环境中,天气变化、光照强度的剧烈波动以及背景的复杂变化都对运动目标检测提出了更高的要求。室外场景中的运动目标检测通常需要结合多种方法,例如使用高斯背景模型差分法来适应背景变化,并通过机器学习方法进行目标识别以提高检测的准确性。

4.2.2 不同光照条件下的应用挑战

光照条件的不同对运动目标检测的影响很大。在低光条件下,帧间的灰度差异可能不足以区分运动目标与背景,导致检测效果不佳。在高光条件下,可能造成“曝光过度”,同样影响检测结果。为了应对这些挑战,可以采用具有自适应阈值的算法,或者使用增强对比度和边缘检测的技术来辅助运动目标检测。此外,还可以结合光流法,利用图像序列中的像素点运动信息来进行目标的检测。

4.3 OpenCV运动目标检测案例分析

4.3.1 交通流量统计的应用实例

交通流量统计是一个典型的运动目标检测应用场景。使用OpenCV进行交通监控,可以实现对车辆和行人的数量、速度和运动方向的统计。OpenCV的背景减除和帧间差分法可以帮助我们从视频中分离出运动物体,并利用cv::HoughLinesP等函数检测道路中的车辆轮廓,最后通过跟踪算法如cv::KalmanFilter进行运动跟踪和计数。

4.3.2 安防监控中的目标检测与识别

安防监控系统中,运动目标检测与识别是关键的一环。在使用OpenCV进行该类应用时,可以首先采用背景减除法或者帧间差分法获取运动物体的轮廓,然后利用人脸识别或人体姿态识别等技术对目标进行进一步的识别。OpenCV提供了丰富的机器学习和深度学习接口,可以接入如Haar级联分类器、LBPH(局部二值模式直方图)等传统算法,或使用深度学习框架如TensorFlow或PyTorch训练的模型来进行目标的检测和分类。

以上章节内容展示了OpenCV在运动目标检测领域的强大功能和灵活性。通过具体的应用实践和案例分析,我们能够深入了解如何利用OpenCV进行高效的运动目标检测,并针对不同场景进行优化以应对现实中的挑战。

5. 光流法在OpenCV中的实现细节

5.1 光流法的OpenCV实现原理

5.1.1 光流法的数学模型介绍

光流法是一种基于图像序列分析的技术,用于估计每个像素点在连续帧之间的时间变化。这一方法的核心是亮度恒常假设,即认为在短时间内,图像点的亮度不会发生变化,而像素点的移动则是由于物体或摄像机的运动。数学上,光流法与光的流动类似,通过计算相邻帧图像的像素强度差异来估计场景中物体的运动。

光流法的数学表达通常使用以下公式表示:

[

I(x, y, t) = I(x + \Delta x, y + \Delta y, t + \Delta t)

]

其中,(I(x, y, t)) 表示在时间 (t) 时位置 ((x, y)) 处的像素强度,(\Delta x) 和 (\Delta y) 分别是在相邻帧之间 (x) 和 (y) 方向的位移,(\Delta t) 是时间间隔。通过求解偏微分方程,可以得到光流向量 ((u, v)),其中 (u) 和 (v) 分别是像素在 (x) 和 (y) 方向上的速度分量。

OpenCV库中实现了多种光流算法,如Lucas-Kanade法、Farneback算法等,它们都是基于上述数学模型的变体和优化。

5.1.2 OpenCV中光流法的算法流程

在OpenCV中,光流法的具体实现过程通常包括以下几个步骤:

- 初始化 :准备视频序列或连续帧的图像数据。

- 参数设置 :根据实际情况设置算法的参数,如窗口大小、迭代次数等。

- 特征点检测 :在第一帧图像中检测特征点(例如角点)。

- 特征点跟踪 :在后续帧中跟踪这些特征点。

- 计算光流 :根据跟踪结果计算光流向量。

- 结果分析 :利用计算得到的光流向量进行进一步分析,比如目标检测、跟踪等。

- 后处理 :对光流结果进行滤波和优化处理。

例如,在OpenCV中使用Lucas-Kanade方法的代码示例如下:

import numpy as np

import cv2

# 读取视频或图像序列

cap = cv2.VideoCapture('video.mp4')

# 创建Lucas-Kanade光流对象

lk_params = dict(winSize=(15, 15), maxLevel=2, criteria=(cv2.TERM_CRITERIA_EPS | cv2.TERM_CRITERIA_COUNT, 10, 0.03))

# 选择第一帧并找到角点

ret, old_frame = cap.read()

old_gray = cv2.cvtColor(old_frame, cv2.COLOR_BGR2GRAY)

p0 = cv2.goodFeaturesToTrack(old_gray, mask=None, **feature_params)

# 创建一个掩码图像用于绘制

mask = np.zeros_like(old_frame)

while True:

ret, frame = cap.read()

if not ret:

break

frame_gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 计算光流以获取新的点集

p1, st, err = cv2.calcOpticalFlowPyrLK(old_gray, frame_gray, p0, None, **lk_params)

# 选择好的点

good_new = p1[st == 1]

good_old = p0[st == 1]

# 绘制点

for i, (new, old) in enumerate(zip(good_new, good_old)):

a, b = new.ravel()

c, d = old.ravel()

mask = cv2.line(mask, (a, b), (c, d), color[i].tolist(), 2)

frame = cv2.circle(frame, (a, b), 5, color[i].tolist(), -1)

img = cv2.add(frame, mask)

cv2.imshow('frame', img)

k = cv2.waitKey(30) & 0xff

if k == 27:

break

# 更新前一帧图像和点集

old_gray = frame_gray.copy()

p0 = good_new.reshape(-1, 1, 2)

cap.release()

cv2.destroyAllWindows()

在上述代码中, calcOpticalFlowPyrLK 函数负责计算光流,它返回新的点集 p1 和跟踪状态 st 。通过选择 st 为 1 的点,我们可以过滤出成功跟踪的特征点,并在图像上绘制它们的轨迹。此外,还可以根据需求添加其他算法流程的步骤和优化。

5.2 光流法的关键技术与挑战

5.2.1 参数选择与算法优化

光流法的关键在于参数的合理选择和算法的适当优化。在OpenCV中,Lucas-Kanade方法的参数包括窗口大小、迭代次数和终止条件。窗口大小决定了用于估计光流的像素邻域大小,较小的窗口可以提高速度,但牺牲精度;较大的窗口可以提高精度,但增加计算量。迭代次数和终止条件则共同控制了算法的收敛性。

优化光流法的实现方式之一是使用多尺度金字塔。这种方法首先在较低分辨率的图像上估计光流,然后逐步细化到原始图像分辨率。多尺度方法可以帮助处理大范围运动和减少误匹配。

此外,对于复杂场景,如光照变化、遮挡和动态背景,需要更复杂的处理策略。例如,可以结合其他运动检测方法,或者使用机器学习方法进行预处理或后处理。

5.2.2 光流法在复杂场景中的适应性分析

光流法在复杂场景下的适应性是一个挑战。在光照变化剧烈或有遮挡的场景下,传统的光流法可能难以得到准确的运动估计。这要求算法能够处理异常值和噪声,同时保持对运动变化的敏感性。

为了提高光流法在复杂场景下的适应性,可以考虑以下策略:

- 预处理 :在计算光流之前对图像序列进行预处理,如直方图均衡化、滤波等,可以减少光照变化带来的影响。

- 特征点选择 :选择对光照变化和遮挡不敏感的特征点,如使用Harris角点检测而不是基于亮度的特征点检测。

- 后处理 :使用形态学操作等图像处理技术对光流结果进行平滑和噪声抑制。

- 多算法融合 :结合多种运动估计方法,如结合光流法和帧间差分法,利用各自优势互补不足。

5.3 光流法的应用与案例研究

5.3.1 实时人流分析中的应用

光流法在人流统计和分析中有广泛应用。通过在视频监控中应用光流法,可以准确地追踪和分析人流密度和流动方向,为交通规划、安全管理提供数据支持。

例如,在火车站、机场等人流密集的地方,可以利用光流法实时监测人群流动情况,自动检测异常行为,如拥堵和逆行等。通过安装监控摄像头,并将视频数据输入到光流法算法中,可以实时地获取人流信息并进行分析。

5.3.2 运动物体跟踪的实践案例

在运动物体跟踪方面,光流法能够提供连续的运动估计,使得跟踪过程更加平滑和稳定。在安防监控、机器人导航等领域,光流法的这些特性使得它成为一个理想的工具。

假设我们有一个监控视频,需要实时地跟踪视频中的运动物体。我们可以采用光流法估计每一帧图像中物体的运动向量,然后将这些信息用于预测物体在下一帧的可能位置。

# 假设初始化变量和流程与上述代码相同

while True:

# ...(读取视频帧和计算光流的过程)

# 显示跟踪结果

for i, (new, old) in enumerate(zip(good_new, good_old)):

# 绘制线条和圆点代码与前面类似

# 更新跟踪结果

objects = track_objects(good_new)

# 可视化跟踪结果

draw跟踪结果(frame, objects)

cv2.imshow('frame', img)

# ...(按键判断退出循环等)

在实际应用中, track_objects 函数需要根据光流法提供的信息,结合场景特征和可能的先验知识,实现对特定物体的持续跟踪。此外, draw跟踪结果 函数将跟踪的物体以特定的标记或框绘制到帧上,便于观察和分析。

光流法的这些应用案例表明,它是一种在多方面有广泛用途的技术。从人流统计到物体跟踪,光流法提供了一种直观而有效的解决方案。通过合理配置算法参数和结合其他技术,光流法可以更好地适应复杂多变的实际场景。

6. 运动目标检测技术的选择与比较

在动态视频分析领域,运动目标检测技术的选择对于系统性能至关重要。不同的检测方法有各自的优势和局限性,理解它们的特点能够帮助技术人员和项目决策者做出更明智的选择。

6.1 运动目标检测技术综述

6.1.1 各种技术的优缺点对比

在本小节中,将对三种主要的运动目标检测技术——光流法、帧间差分法和高斯背景模型差分法——进行优缺点的对比分析。

光流法基于像素强度的一阶导数,因此它对光线变化不敏感,能够在复杂的光照条件下很好地工作。然而,它的计算代价较高,对于快速运动的物体检测可能不够准确。

帧间差分法实现简单,适合处理低帧率视频,对于快速运动的目标检测效果较好。但是,此方法对光照变化和噪声非常敏感,可能在实际应用中需要额外的预处理步骤以提高鲁棒性。

高斯背景模型差分法能够适应光照变化和相机抖动,适用于监控场景。但是,当场景中出现大面积的背景变化(比如树叶晃动)时,它可能会将这些变化误判为运动目标。

6.1.2 适用场景的分析与建议

对于实时性要求高且光照变化不大的环境,例如室内监控,推荐使用高斯背景模型差分法。在光照变化大或需要处理快速运动物体的场合,例如户外交通监控,光流法可能是更合适的选择。

当摄像头帧率较低或者对实时性要求不高时,帧间差分法可以作为一个简单有效的备选方案。在选择技术时,应考虑实际应用场景的具体需求和约束。

6.2 运动目标检测技术的选择策略

6.2.1 项目需求与技术匹配

选择运动目标检测技术时,首要考虑的因素是项目需求。不同的应用场合对检测速度、准确性、鲁棒性和资源消耗有不同的要求。例如,安防监控系统可能更关注准确性,而实时交通监控系统可能更注重检测速度。

6.2.2 成本效益分析与决策

成本效益分析是决策过程中的另一个重要因素。实施高精度的光流法检测可能需要大量的计算资源,这会提高整体系统的成本。相比之下,帧间差分法和高斯背景模型差分法在资源消耗上更为经济。在有限预算的情况下,选择技术时应权衡成本和性能。

6.3 运动目标检测技术的未来展望

6.3.1 智能化与自适应化的发展趋势

未来,运动目标检测技术会趋向于更加智能化和自适应化。深度学习技术的应用使得检测系统能够自动学习和适应各种复杂的场景变化。未来的技术可能包含更为复杂的神经网络模型,能够自主优化检测效果。

6.3.2 结合深度学习的前景探讨

深度学习的引入将使运动目标检测技术在准确性和鲁棒性方面都得到显著提升。通过大量的训练数据,深度学习模型能够学习到更复杂的特征表示,实现更为精确的目标分割和分类。然而,这也会带来更高的计算成本和对大规模标注数据的需求。

在本章节中,我们深入探讨了运动目标检测技术的选择与比较,并对未来的趋势进行了展望。通过理性分析与实践考量,选择最适合特定应用需求的技术方案至关重要。随着技术的持续进步,我们可以期待未来会有更加高效、智能的运动目标检测方法的出现。

简介:本压缩包包含了三种计算机视觉中用于运动目标检测的技术:光流法、帧间差分法和高斯背景模型差分法,并在OpenCV库下实现。光流法通过计算像素位移来估计运动,适用于平滑运动;帧间差分法通过比较连续帧差异来检测运动区域,受背景稳定性影响;高斯背景模型差分法通过学习背景并检测运动物体,适用于复杂背景下的运动目标检测。文档文件提供了方法的对比分析,AVI文件用作测试和演示。开发者可结合API选择合适的方法以优化检测性能。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)