《迁移学习》chap02 基于样本的迁移学习

文章目录内容框架系列文章Chap 02 基于样本的迁移学习2.1 引用2.2 NTL2.3 ITL内容框架系列文章《迁移学习》chap01 绪论Chap 02 基于样本的迁移学习2.1 引用基于样本的迁移学习的两个关键问题:如何筛选出源域中与目标域数据具有相似分布的有标签样本。如何利用这些“相似”的数据训练处一个更准确的目标域上的学习模型。如果源域和目标域的边缘分布不同,但条件概率分布相同,则将问

·

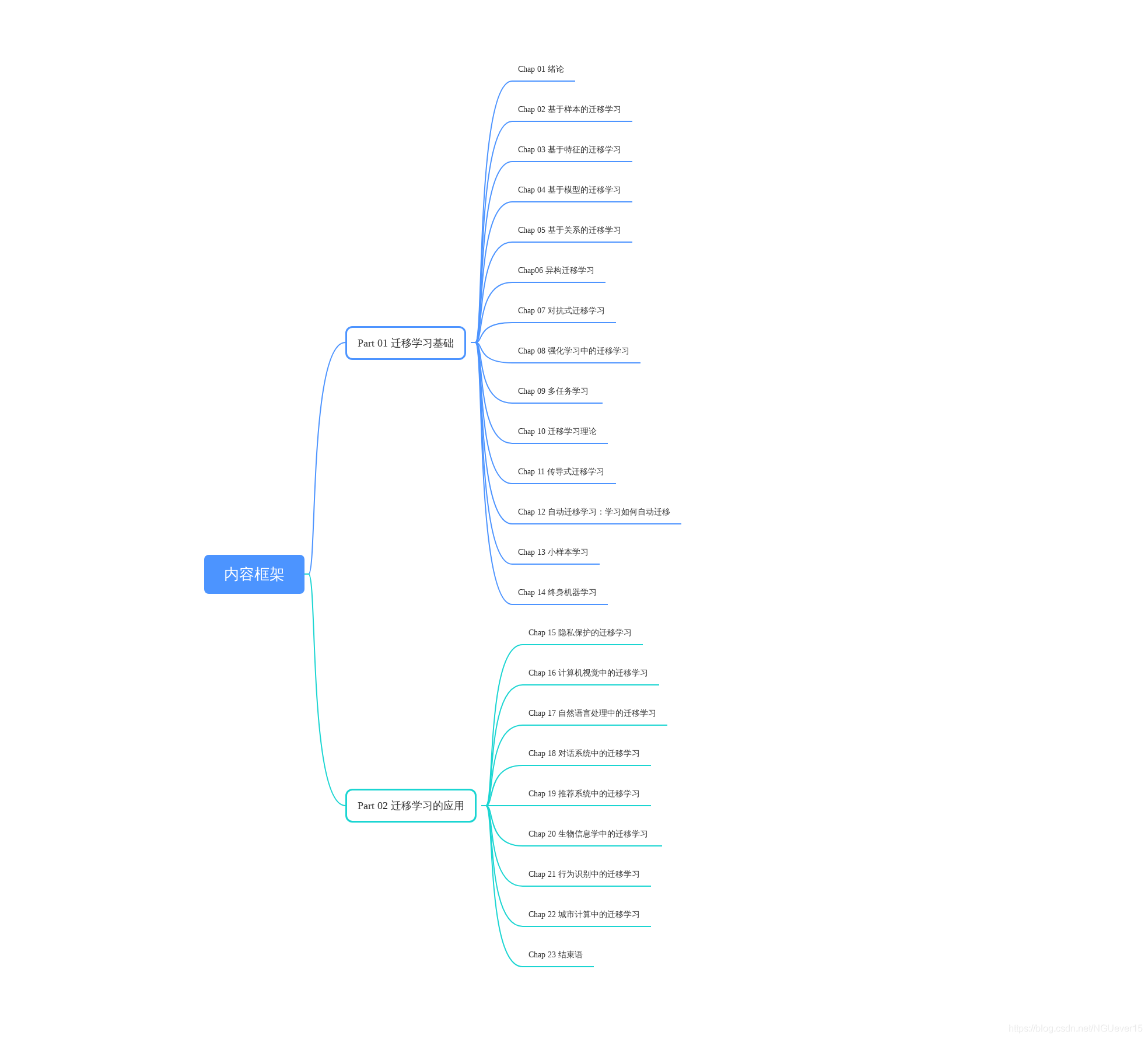

内容框架

系列文章

Chap 02 基于样本的迁移学习

2.1 引用

基于样本的迁移学习的两个关键问题:

- 如何筛选出源域中与目标域数据具有相似分布的有标签样本。

- 如何利用这些“相似”的数据训练处一个更准确的目标域上的学习模型。

如果源域和目标域的边缘分布不同,但条件概率分布相同,则将问题称为** 非归纳式迁移学习(NTL)**

如果源域和目标域的边缘分布不同,且条件概率分布不同,则将问题称为** 归纳式迁移学习(ITL)**

在NTL中,目标域数据可以无标注,但在ITL中,目标域数据需要部分被标注。

2.2 NTL

2.3 ITL

为了同时利用源域和目标域的有标签数据,直观方法: 将损失函数分为两个部分:一个用于源域有标签数据,另一个用于目标域有标签数据。 需引入协调参数平衡两种损失的影响。

除了重复利用源域有标记数据,另一个方法就是建立一个生成模型来为目标域生成新的样本。

生成图片的损失函数又两部分组成:内容损失和风格损失。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)