运动目标检测算法视频测试与分析

运动目标检测是计算机视觉领域的一个核心研究方向,旨在从视频序列中自动识别和追踪移动对象。检测的准确性直接影响了后续跟踪、行为分析、异常检测等任务的执行效率和结果的可靠性。在本章中,我们将从运动目标检测的定义谈起,然后分析它在不同领域的应用价值,从而帮助读者建立一个全面的理解基础。本章还将简要介绍检测技术的发展历程,包括从早期的经典算法到现代的深度学习方法,以及这些技术如何适应不断变化的实际需求。运

简介:运动目标检测在视频监控、自动驾驶等场景中具有重要作用,它通过识别和跟踪视频帧间变化来提取动态目标。本文将探讨包括背景差分法、光流法、帧差法、高斯混合模型、卡尔曼滤波和深度学习方法在内的多种运动目标检测算法。文章还将介绍这些算法在视频监控中的具体应用,如入侵检测和交通监控,并通过测试视频来评估不同算法的性能。

1. 运动目标检测概述

运动目标检测是计算机视觉领域的一个核心研究方向,旨在从视频序列中自动识别和追踪移动对象。检测的准确性直接影响了后续跟踪、行为分析、异常检测等任务的执行效率和结果的可靠性。

在本章中,我们将从运动目标检测的定义谈起,然后分析它在不同领域的应用价值,从而帮助读者建立一个全面的理解基础。本章还将简要介绍检测技术的发展历程,包括从早期的经典算法到现代的深度学习方法,以及这些技术如何适应不断变化的实际需求。

运动目标检测不仅仅是技术问题,它还涉及到算法设计、性能优化和实际应用场景的复杂交互。本章最后将给出一些运动目标检测的现实挑战和未来趋势,为后续章节中深入讨论各类算法和应用打下坚实的基础。

2. 传统运动目标检测算法介绍

2.1 背景差分法

背景差分法是一种基于静态背景的运动目标检测技术,其核心思想是将当前帧图像与背景模型进行差分,以此来识别出运动物体。它的优势在于简单易实现,适用于背景变化不大的场景。

2.1.1 背景差分法原理

背景差分法的关键在于背景模型的建立和更新。这个模型通常包含了图像中静止部分的统计信息,可以是单帧的图像,也可以是多帧图像的统计结果。背景模型的构建过程如下:

- 初始化背景模型:在视频序列的前几帧中选择一个或多个静止背景的帧作为初始背景模型。

- 背景模型更新:随着时间的推移,背景可能会发生变化(如光照变化、树叶飘动等),为了适应这些变化,需要不断地更新背景模型。常见的更新策略有滑动平均法、高斯更新法等。

一旦背景模型建立,接下来的步骤包括:

- 前景检测:将当前帧与背景模型进行逐像素的差分,并通过阈值操作确定运动物体。

- 噪声滤除与形态学处理:由于差分结果中可能存在空洞或边缘噪声,需要进行膨胀、腐蚀等形态学操作来获得更为完整的运动物体区域。

2.1.2 背景差分法的实现步骤

背景差分法的实现可以分为以下几个步骤:

- 初始化背景:读取前n帧图像并构建背景模型。

- 背景模型更新:使用滑动平均等方法持续更新背景。

- 捕获运动目标:将当前帧与背景模型做差分,并应用阈值处理以分离前景和背景。

- 形态学处理:对检测到的前景进行膨胀、腐蚀等形态学操作,以平滑边缘和填充空洞。

- 边界细化:可选步骤,使用轮廓检测方法进一步优化检测结果。

import cv2

def background_subtraction(image, background):

# 将当前帧与背景模型进行差分

diff = cv2.absdiff(image, background)

# 应用阈值处理

_, thresh = cv2.threshold(diff, 30, 255, cv2.THRESH_BINARY)

return thresh

# 读取视频帧

video = cv2.VideoCapture('video.mp4')

background = None

# 初始化背景模型

while True:

ret, frame = video.read()

if not ret:

break

if background is None:

background = frame

continue

# 更新背景模型

background = cv2.addWeighted(background, 0.95, frame, 0.05, 0)

# 释放资源

video.release()

# 使用背景模型检测运动目标

current_frame = cv2.imread('current_frame.jpg')

background_model = cv2.imread('background.jpg', 0)

foreground = background_subtraction(current_frame, background_model)

在此代码示例中,我们使用OpenCV库来实现背景差分法。首先,初始化视频捕获对象并逐帧读取视频。通过一个循环,不断更新背景模型,并在视频结束时保存背景模型。最后,使用背景模型对当前帧进行运动目标检测。

2.2 光流法

光流法是一种基于图像序列的运动目标检测方法,通过分析相邻帧之间的像素运动模式来检测目标。它适用于场景中目标或相机都有移动的情况。

2.2.1 光流法的基本概念

光流是描述图像序列中像素点运动的矢量场。每个像素点的运动矢量代表了其在相邻两帧图像间的位置变化。这些运动矢量反映了目标和相机的相对运动。光流法的基本假设是:时间连续性和像素亮度恒定性。

- 时间连续性假设:在很短的时间内,目标或相机的运动是连续的。

- 像素亮度恒定性假设:同一个物体表面的像素亮度在时间上是恒定的。

通过这些假设,可以使用诸如Lucas-Kanade算法、Horn-Schunck算法等来计算光流。

2.2.2 光流法在目标检测中的应用

光流法在目标检测中的应用依赖于计算出的光流向量场,通常步骤包括:

- 使用光流算法计算连续帧之间的光流。

- 根据光流向量的方向和大小来判定运动物体。

- 通过跟踪光流向量场来检测目标的运动轨迹。

- 应用阈值处理和形态学操作以进一步提取目标。

import cv2

cap = cv2.VideoCapture('video.mp4')

# 初始化光流对象

lk_params = dict(winSize=(15, 15), maxLevel=2, criteria=(cv2.TERM_CRITERIA_EPS | cv2.TERM_CRITERIA_COUNT, 10, 0.03))

# 选取初始点

ret, old_frame = cap.read()

old_gray = cv2.cvtColor(old_frame, cv2.COLOR_BGR2GRAY)

p0 = cv2.goodFeaturesToTrack(old_gray, mask=None, **feature_params)

while True:

ret, frame = cap.read()

frame_gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 计算光流

p1, st, err = cv2.calcOpticalFlowPyrLK(old_gray, frame_gray, p0, None, **lk_params)

# 选择好的点

good_new = p1[st == 1]

good_old = p0[st == 1]

# 绘制光流向量场

for i, (new, old) in enumerate(zip(good_new, good_old)):

a, b = new.ravel()

c, d = old.ravel()

frame = cv2.line(frame, (a, b), (c, d), color, 2)

# 更新旧帧和点

old_gray = frame_gray.copy()

p0 = good_new.reshape(-1, 1, 2)

cv2.imshow('frame', frame)

k = cv2.waitKey(30) & 0xff

if k == 27:

break

cv2.destroyAllWindows()

cap.release()

在上述代码中,我们使用了OpenCV中的 calcOpticalFlowPyrLK 函数来计算光流。我们首先读取视频的首帧作为旧帧,并将其转换为灰度图像用于后续处理。然后,我们使用 goodFeaturesToTrack 函数选取初始点,并在循环中计算这些点的光流向量。通过绘制这些向量,我们可以在视频帧上直观地看到目标的运动情况。

2.3 帧差法

帧差法是一种简单有效的运动目标检测方法,它利用连续帧图像间的差异来检测和提取运动目标。该方法适用于目标运动速度较快,背景变化不大的情况。

2.3.1 帧差法原理

帧差法的原理是通过计算连续帧之间的图像差分,来确定运动物体的位置。具体操作如下:

- 选取连续的两帧或三帧图像。

- 计算这些帧之间的像素差异。

- 通过设置阈值来确定哪些像素点属于运动目标。

- 对检测到的运动目标进行形态学处理,以获得更加准确的目标轮廓。

帧差法的关键在于阈值的选取,这直接影响到检测结果的准确性和鲁棒性。

2.3.2 帧差法的算法流程

帧差法检测运动目标的具体步骤如下:

- 读取视频流或视频文件,并逐帧提取。

- 选择连续的两帧图像,并进行灰度化处理。

- 计算两帧间的差值,形成差分图像。

- 应用阈值处理,将差分图像转换为二值图像。

- 使用形态学处理(如膨胀、腐蚀)来改善检测结果的边缘和填补孔洞。

- 输出检测结果,标定运动目标的位置和轮廓。

import cv2

import numpy as np

cap = cv2.VideoCapture('video.mp4')

# 设置阈值参数

diff_threshold = 50

morph_kernel = np.ones((3,3), np.uint8)

while True:

ret, frame1 = cap.read()

ret, frame2 = cap.read()

if not ret:

break

# 计算两帧的差分

diff = cv2.absdiff(frame1, frame2)

gray = cv2.cvtColor(diff, cv2.COLOR_BGR2GRAY)

_, thresh = cv2.threshold(gray, diff_threshold, 255, cv2.THRESH_BINARY)

# 形态学处理

thresh = cv2.morphologyEx(thresh, cv2.MORPH_OPEN, morph_kernel)

thresh = cv2.dilate(thresh, None, iterations=2)

# 显示结果

cv2.imshow('Frame', thresh)

k = cv2.waitKey(30) & 0xff

if k == 27:

break

cv2.destroyAllWindows()

cap.release()

以上代码中,我们使用了OpenCV库来实现帧差法。视频流通过逐帧读取后,连续两帧的图像被选取。接着,我们计算这两帧图像的像素差异,并通过阈值操作将差异图像转换为二值图像。经过形态学处理后,我们得到了较为清晰的运动目标区域,并将其显示出来。

2.4 光流法与帧差法的对比

光流法和帧差法都是利用时间序列上的帧间信息进行目标检测的方法,但它们的侧重点和适用场景有所不同。

2.4.1 适用场景

光流法侧重于提取运动目标的动态信息,比如运动速度和方向,并能够处理目标运动和相机移动的情况。而帧差法侧重于通过帧间差异快速检测出运动物体的位置变化,尤其适合目标运动较快的场景。

2.4.2 优势与不足

光流法的优势在于可以获取到丰富的动态信息,但算法实现较为复杂,对于光照变化敏感,且在目标速度过快时效果不佳。帧差法的优势是算法简单、速度快,但其对噪声比较敏感,且在背景复杂或者目标运动过慢时容易产生误检。

flowchart LR

A[输入视频] -->|帧间差分| B[帧差法]

A -->|光流计算| C[光流法]

B -->|快速检测| D[运动目标位置]

C -->|运动矢量场| E[运动目标方向和速度]

D -.->|适用| F[目标运动快、背景简单]

E -.->|适用| G[目标或相机移动、复杂背景]

上述流程图描述了帧差法和光流法的工作流程及其适用场景。可以看到,两种方法在目标检测中各有侧重,可根据实际需要选择合适的算法。

3. 高级运动目标检测算法介绍

3.1 高斯混合模型(GMM)

3.1.1 GMM模型理论基础

高斯混合模型(GMM)是一种统计模型,用于表示具有K个分量的多变量概率分布。每个分量都是一个多变量高斯分布,具有自己的均值向量、协方差矩阵和混合系数。这些分量的加权和构成了GMM。在目标检测中,GMM被用于建立场景的背景模型,进而区分前景的运动目标和静止背景。

3.1.2 GMM在目标检测中的应用实例

在运动目标检测的应用中,GMM可以适应背景的变化,适用于场景中光照变化、动态背景等复杂环境。其基本思想是:使用K个高斯分布来描述每个像素点在不同时间的状态。随着视频序列的进行,对每个像素点进行在线更新其对应的高斯分布参数,通过比较当前像素值与各高斯分布的相似度,判断为背景或前景。下面是一个使用GMM进行背景建模的示例代码。

import numpy as np

import cv2

# 初始化GMM参数

n_gaussians = 3 # GMM中高斯分布的数量

max_gaussianWeight = 0.8 # 高斯分布的最大权重

min_gaussianWeight = 0.1 # 高斯分布的最小权重

# 读取视频序列中的第一帧

cap = cv2.VideoCapture('video.mp4')

ret, frame1 = cap.read()

ret, frame2 = cap.read()

# 创建背景减除器对象

fgbg = cv2.createBackgroundSubtractorMOG2(n_gaussians, max_gaussianWeight, min_gaussianWeight)

while(cap.isOpened()):

ret, frame2 = cap.read()

if not ret:

break

fgmask = fgbg.apply(frame2) # 应用背景减除器来获取前景掩码

# 显示前景掩码

cv2.imshow('Frame', fgmask)

# 显示当前帧

cv2.imshow('Frame2', frame2)

k = cv2.waitKey(30) & 0xff

if k == 27:

break

cap.release()

cv2.destroyAllWindows()

上述代码使用了OpenCV库中的 BackgroundSubtractorMOG2 类来实现GMM背景减除。此算法会持续更新每个像素的GMM参数,并生成前景掩码图像。

3.2 卡尔曼滤波

3.2.1 卡尔曼滤波算法原理

卡尔曼滤波(Kalman Filter)是一种高效的递归滤波器,可以估计线性动态系统的状态。它通过系统的测量值和预测值对系统状态进行优化估计,并最小化估计误差。卡尔曼滤波在目标跟踪中非常有用,因为它能持续更新目标的运动信息,即使在部分遮挡或短暂丢失目标的情况下。

3.2.2 卡尔曼滤波在目标检测中的应用

在运动目标检测场景中,卡尔曼滤波可以用于估计目标的位置和速度,使跟踪过程更为平滑。它依赖于对目标运动模型的设定和测量更新的实现。目标的运动状态通常包括位置和速度,而测量更新则基于检测到的目标位置。下面是一个简单的一维卡尔曼滤波器应用示例。

import numpy as np

def kalman_filter(measurement, motion=0.0):

# 定义初始状态 [位置, 速度]

xhat = np.matrix([[measurement], [motion]])

# 状态转移矩阵

A = np.matrix([[1, 1], [0, 1]])

# 测量函数

H = np.matrix([[1, 0]])

# 估计误差协方差矩阵

P = np.matrix([[1, 0], [0, 1]])

# 过程噪声协方差矩阵

Q = np.matrix([[1, 0], [0, 1]])

# 测量噪声协方差矩阵

R = np.matrix([[1]])

# 定义卡尔曼增益

K = P * H.T * (H * P * H.T + R).I

# 更新估计值

xhat = A * xhat + K * (measurement - H * A * xhat)

# 更新协方差矩阵

P = (I - K * H) * A * P

return xhat

# 模拟的目标位置

measurements = [n + np.random.normal(0, 0.5) for n in range(30)]

# 卡尔曼滤波器估计位置

estimated_positions = []

for m in measurements:

xhat = kalman_filter(m)

estimated_positions.append(xhat[0])

import matplotlib.pyplot as plt

plt.plot(measurements, label='测量位置')

plt.plot(estimated_positions, label='卡尔曼估计位置')

plt.legend()

plt.show()

该示例中, kalman_filter 函数根据给定的测量值和运动值估计目标的位置。通过迭代应用测量值,可以得到更加平滑和准确的位置估计。最终,使用 matplotlib 库可视化了测量位置和卡尔曼滤波器估计的位置。

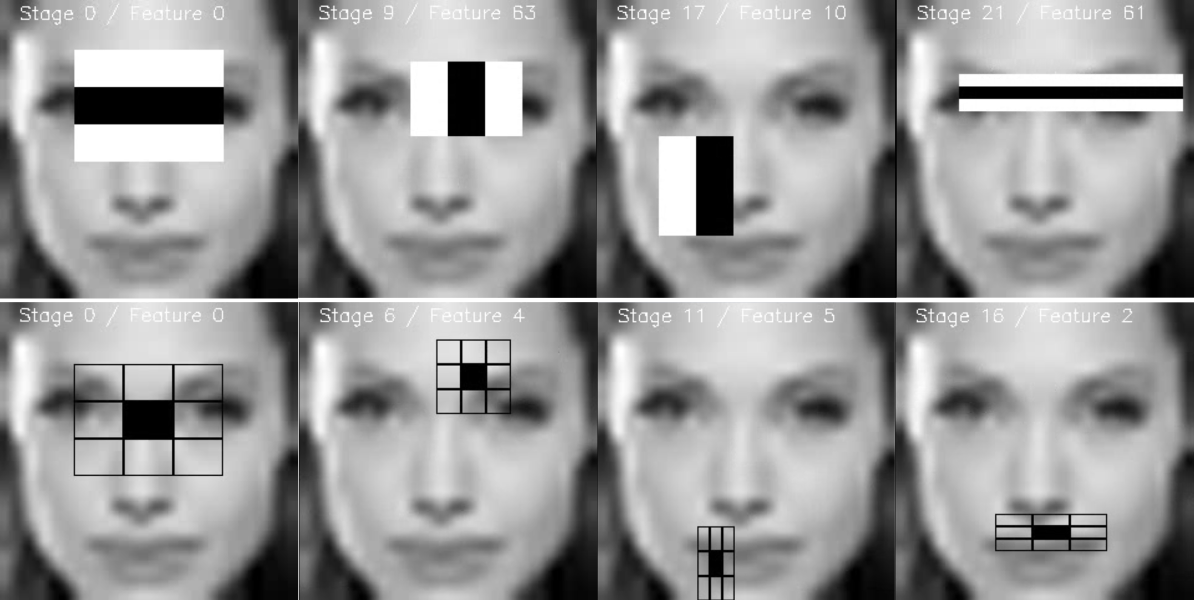

4. 深度学习在目标检测中的应用

深度学习技术已经深刻改变了计算机视觉领域,尤其是运动目标检测。通过大量数据的训练,深度学习模型能够提取复杂场景中的目标特征,从而在目标检测任务上展现出优于传统算法的性能。

4.1 深度学习基础

4.1.1 卷积神经网络(CNN)简述

卷积神经网络(CNN)是深度学习中用于处理具有类似网格结构的数据(例如时间序列数据、图像和视频)的一种特殊类型的神经网络。CNN的典型结构包括卷积层、激活函数、池化层和全连接层。卷积层通过卷积核(滤波器)提取输入数据的特征,激活函数如ReLU引入非线性,池化层减少数据维度,而全连接层则执行分类或回归操作。

CNN在图像处理中的优势在于其能够自动学习到数据的层次性特征表示,不需要手工设计特征提取器,这对于目标检测来说是极大的进步。

4.1.2 深度学习在目标检测中的作用

深度学习应用于目标检测中的主要作用是提高检测的准确性与效率。通过从大量标注数据中学习,深度学习模型能够捕捉目标的形状、大小、颜色等多种特征。特别是,深度学习模型能够识别出不同角度、光照条件下的同一目标,并且在有遮挡的情况下依然保持较高的检测率。

深度学习模型还可以处理复杂的背景和噪声干扰,这对于实际应用场景中的运动目标检测尤其重要。随着深度学习技术的发展,诸如Faster R-CNN、YOLO和SSD等优秀的目标检测模型不断涌现,并被广泛应用于视频监控、自动驾驶、人机交互等多个领域。

4.2 深度学习模型详解

4.2.1 Faster R-CNN和YOLO算法比较

Faster R-CNN和YOLO是两种非常有代表性的目标检测深度学习模型,它们都采用了卷积神经网络提取图像特征,但处理方式和应用场景有所不同。

Faster R-CNN采用区域建议网络(Region Proposal Network, RPN)来生成候选区域,并在这些区域上进行目标检测。RPN通过在共享卷积层上使用锚点(anchor)机制,同时预测目标的边界框和分类概率。Faster R-CNN结构复杂,训练和推断速度较慢,但检测精度高。

YOLO则将目标检测任务作为回归问题来处理,它将图像划分为一个个格子(grid),每个格子负责预测中心点落在该格子内的目标。YOLO的速度非常快,适合实时应用场景,虽然初期版本的精度相对较低,但随着YOLOv3、YOLOv4和YOLOv5的发展,精度和速度都得到了显著提升。

4.2.2 SSD和Focal Loss在目标检测中的应用

单次检测器(Single Shot MultiBox Detector, SSD)是一种结合了快速和高精度的目标检测算法。SSD在不同尺度的特征图上直接预测边界框和类别概率,这使得它能够在单次前向传播中完成目标检测,相比于需要多个阶段的Faster R-CNN,SSD在速度上有显著优势。

Focal Loss是为了解决目标检测中类别不平衡问题而提出的损失函数。在目标检测中,背景(无目标)的样本数量远大于前景(有目标)的样本数量,这会导致模型过拟合背景。Focal Loss通过降低易分类样本的权重并放大难分类样本的权重,使得模型更加关注难以检测的目标,从而提高整体的检测性能。

接下来,我们具体深入分析Faster R-CNN和YOLO这两个模型的核心技术,并通过代码实例进行深度学习目标检测的实际操作。这将有助于读者对这些高级模型有更深入的理解和实际应用能力。

5. 视频监控中的运动目标检测应用

5.1 视频监控系统概述

5.1.1 视频监控系统的组成

视频监控系统是一个集成了多种技术和设备的综合性系统,用于实时监控和记录特定区域内的活动。一个典型的视频监控系统主要包括以下几个部分:

- 摄像头 :负责捕获视频流,是视频监控系统中最基础的硬件设备。

- 视频编码器 :将模拟信号转换为数字信号,以便进行存储和传输。

- 存储设备 :用于保存视频数据,可以是本地硬盘或网络存储设备。

- 监控中心 :集中管理视频流,通常配备有多个显示器和控制系统。

- 网络 :连接监控设备和监控中心的通信基础设施,可以是有线或无线。

- 分析软件 :处理和分析视频数据,可以集成运动目标检测和人脸识别等技术。

5.1.2 目标检测在视频监控中的重要性

在视频监控系统中,目标检测是关键的技术之一,它使得系统能够自动识别监控场景中的运动物体,如人、车辆或其他物体。目标检测的重要性体现在以下几个方面:

- 安全性增强 :自动检测异常行为或可疑目标,及时提醒安保人员或启动报警程序。

- 事件记录 :自动标记和记录重要事件,便于事后检索和分析。

- 资源优化 :通过智能分析减少人为监控需求,提高监控资源的使用效率。

- 智能分析 :为后续的高级分析和决策支持系统提供基础数据。

5.2 实际案例分析

5.2.1 运动目标检测技术在不同场景的应用

运动目标检测技术在不同的视频监控场景中应用广泛,下面列举几个典型的应用实例:

- 城市安全监控 :在城市的交通路口、广场等重要地点部署目标检测系统,可以有效监控人流密度,防止拥挤和踩踏事件的发生。

- 交通流量统计 :通过安装在道路或高速公路出口的摄像头,检测和统计车辆流量,优化交通管理。

- 零售店铺监控 :在零售店铺中使用目标检测技术,跟踪顾客的流动路径,分析购物行为,用于提高销售效率和优化店铺布局。

- 智能家居安全 :在家庭监控系统中集成目标检测技术,当家中出现可疑人物时及时发送报警。

5.2.2 案例中的问题与解决策略

尽管运动目标检测技术具有巨大的潜力,但在实际应用中也面临着一些问题。以下是一些常见的挑战及相应的解决策略:

- 环境变化的影响 :室外环境的光照变化、遮挡问题等会影响目标检测的准确性。采用适应性强的算法模型,比如使用深度学习技术进行训练,可以提高算法对环境变化的适应能力。

- 实时性能要求 :视频监控系统需要实时处理大量数据。通过硬件加速、算法优化等手段提升计算效率,确保系统的实时性能。

- 误报和漏报问题 :目标检测系统可能会将背景误判为前景,或者漏掉真实的目标。通过改进检测算法、引入上下文信息等策略减少误报和漏报。

- 隐私和伦理问题 :监控系统收集的数据涉及个人隐私。在设计和部署监控系统时,需遵守相关的法律法规,确保数据的安全和隐私保护。

综上所述,运动目标检测技术在视频监控中的应用潜力巨大,但实际应用中还需解决一系列技术、性能和伦理问题。随着技术的不断发展和成熟,我们期待更加智能和高效的监控系统诞生。

6. 运动目标检测算法测试视频介绍

6.1 测试视频的选择与准备

6.1.1 测试视频的要求与标准

在进行运动目标检测算法的测试时,选择合适的测试视频是至关重要的。测试视频需要满足以下要求与标准:

- 多样性 :测试视频应该包含不同的场景,如室内外环境、不同光照条件、不同天气情况以及各种目标(行人、车辆等)。

- 高质量 :视频质量应保证足够的分辨率和帧率,以便算法能够清晰地捕捉到目标的运动细节。

- 真实场景 :优先使用真实场景下的视频,以确保测试结果的实用性和准确性。

视频还应被标注以用于评估算法的准确性。这些标签应该包括目标的位置、类别、以及它们随时间的变化。

6.1.2 视频数据集的构建

构建一个数据集是评估目标检测算法性能的重要步骤。一个良好的数据集应包含以下几个部分:

- 训练集 :用于训练目标检测模型,应包含足够多的带有标签的视频片段。

- 验证集 :用于模型调优和验证算法性能,可以帮助我们选择最佳的模型参数。

- 测试集 :用于最终的性能评估,一般保持独立,以模拟实际应用中的情况。

构建数据集时,需要进行视频预处理,如裁剪、缩放和标准化等。数据集的结构和格式应与算法的输入要求相匹配。

6.2 测试视频的实际应用

6.2.1 算法效果评估标准

评估运动目标检测算法性能的标准通常包括以下几个方面:

- 准确度 :准确度指标包括检测精度和召回率,反映了算法检测目标的准确性和覆盖的全面性。

- 实时性 :实时性指标衡量算法处理视频帧的速度,对于视频监控等实时应用尤为重要。

- 鲁棒性 :鲁棒性评估算法在不同条件和环境下的稳定性,如光照变化、遮挡等情况。

- 资源消耗 :资源消耗考虑算法运行所需的计算资源和存储资源,这关系到算法是否能在实际部署中应用。

6.2.2 测试结果展示与分析

测试结果应该以可视化的方式展示,例如:

- 精确度-召回率曲线 :展示不同阈值下的精确度和召回率变化。

- 混淆矩阵 :用于评估分类的准确性,显示预测类别和实际类别的对比。

- 视频帧检测示例 :展示算法在视频帧上的检测效果,标记检测到的目标位置。

通过对比不同算法在相同测试视频集上的表现,我们可以分析各算法的优缺点,并得出哪种算法更适合特定应用场景。

对于上述内容,我们可以进一步细化,例如,在”6.2.2 测试结果展示与分析”中添加一个表格,展示不同算法在各项指标上的具体数值。也可以创建一个流程图,显示整个测试评估的标准流程。由于文本限制,我们无法在此展示过多的代码块或图片,但可以根据实际需要增加具体的图表和代码段落来丰富内容。

简介:运动目标检测在视频监控、自动驾驶等场景中具有重要作用,它通过识别和跟踪视频帧间变化来提取动态目标。本文将探讨包括背景差分法、光流法、帧差法、高斯混合模型、卡尔曼滤波和深度学习方法在内的多种运动目标检测算法。文章还将介绍这些算法在视频监控中的具体应用,如入侵检测和交通监控,并通过测试视频来评估不同算法的性能。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)