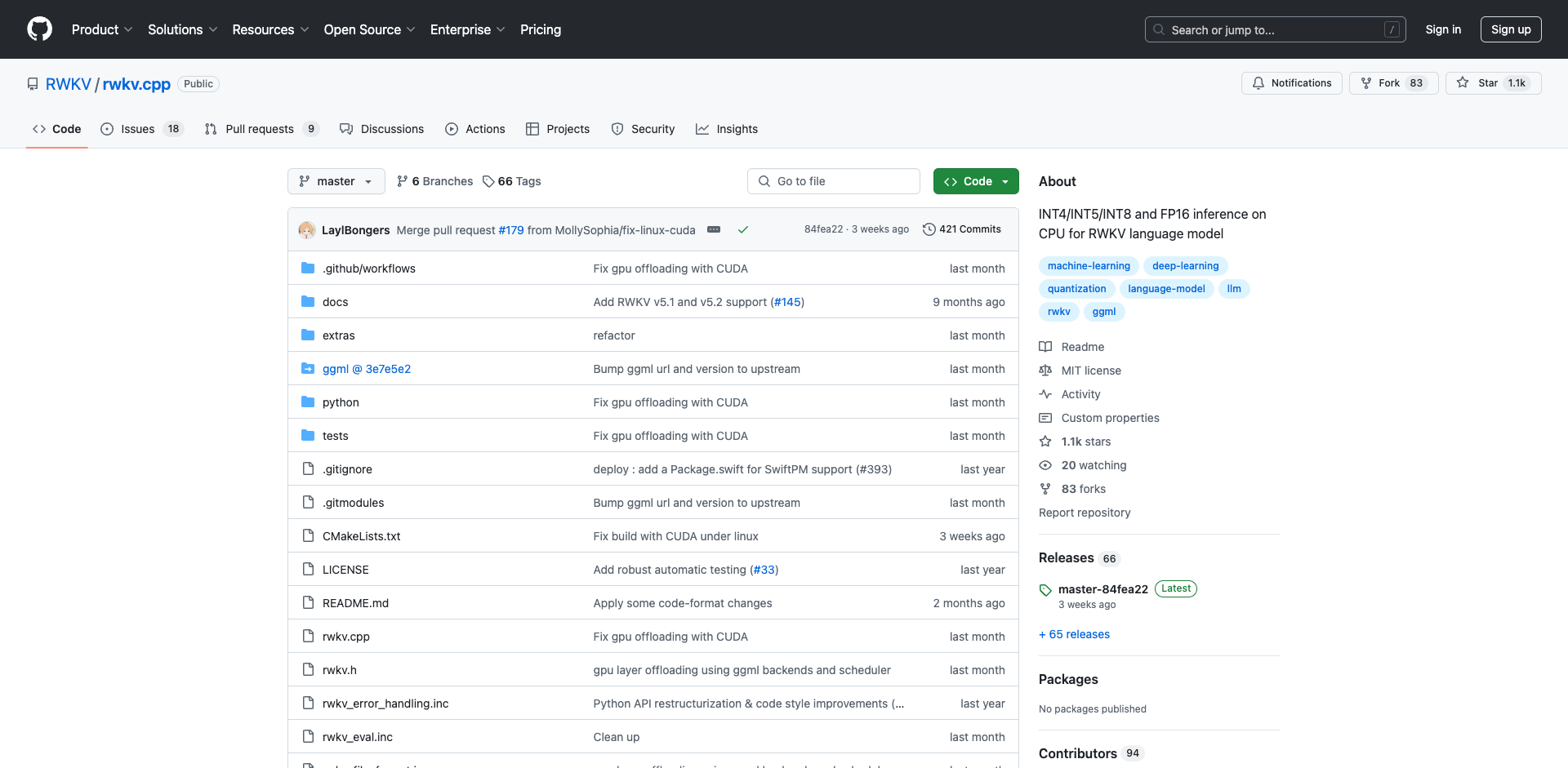

RWKV.cpp: 高效的CPU推理实现RWKV语言模型

RWKV.cpp项目为RWKV模型提供了高效的CPU推理实现,让这一创新的语言模型架构能够在普通硬件上发挥强大威力。随着项目的不断发展和社区的积极贡献,我们期待看到更多基于RWKV的创新应用涌现。RWKV.cpp项目为这一创新架构提供了高效的CPU推理实现,让更多人能够在普通硬件上体验RWKV模型的强大能力。随着RWKV模型的不断进化和RWKV.cpp项目的持续优化,我们有理由相信这一创新的语言模

RWKV.cpp:让RWKV模型在CPU上高效运行

RWKV(Receptance Weighted Key Value)是一种新兴的大型语言模型架构,旨在结合RNN和Transformer的优点。RWKV.cpp项目为这一创新架构提供了高效的CPU推理实现,让更多人能够在普通硬件上体验RWKV模型的强大能力。

项目背景与目标

RWKV.cpp是BlinkDL/RWKV-LM项目到ggerganov/ggml框架的移植。其主要目标是实现RWKV模型在CPU上的高效推理,同时也支持cuBLAS加速。项目提供了一个C语言库rwkv.h和一个方便使用的Python封装。

RWKV模型的最大特点是将Transformer的O(n^2)注意力机制简化为只需要前一步状态的线性复杂度计算。这使得RWKV在处理长文本时非常高效,特别适合在CPU上运行。目前RWKV家族中最大的模型拥有140亿参数,已经可以与同等规模的Transformer模型相媲美。

主要特性

RWKV.cpp项目具有以下主要特性:

- 支持FP32、FP16以及INT4、INT5、INT8量化推理

- 专注于CPU推理优化,同时支持cuBLAS GPU加速

- 支持RWKV v5和v6等最新版本的模型架构

- 提供C语言API和Python封装,方便集成和使用

- 支持LoRA微调检查点的加载

性能与质量

RWKV.cpp在保证模型质量的同时,大幅提升了推理效率。以下是不同量化格式在4核/8线程x86 CPU上的性能对比:

| 格式 | 困惑度(169M) | 延迟(ms, 1.5B) | 文件大小(GB, 1.5B) |

|---|---|---|---|

| Q4_0 | 17.507 | 76 | 1.53 |

| Q5_1 | 15.851 | 81 | 1.68 |

| FP16 | 15.623 | 117 | 2.82 |

| FP32 | 15.623 | 198 | 5.64 |

可以看到,INT4/INT5量化在保持较好质量的同时,显著降低了模型大小和推理延迟。

对于更大规模的模型,RWKV.cpp还支持cuBLAS和hipBLAS加速。例如,在AMD Ryzen 9 5900X CPU和AMD Radeon RX 7900 XTX GPU上,7B参数的模型可以达到每个token 75-90ms的推理速度。

使用方法

使用RWKV.cpp非常简单,主要包括以下步骤:

- 克隆项目仓库

- 获取预编译库或自行编译

- 下载RWKV模型并转换为GGML格式

- 运行推理脚本或集成到自己的代码中

项目提供了详细的安装和使用说明,包括Windows、Linux和MacOS平台的编译指南,以及模型转换和量化的具体步骤。

社区与生态

RWKV.cpp项目正在快速发展,已经有多个语言的绑定实现:

- Golang: seasonjs/rwkv

- Node.js: Atome-FE/llama-node

社区欢迎更多开发者参与贡献,包括改进代码质量、添加新功能、提供使用教程等。项目遵循代码风格指南,确保代码的一致性和可维护性。

未来展望

RWKV模型架构和RWKV.cpp项目都处于快速发展阶段。未来可能的发展方向包括:

- 支持更大规模的模型训练和推理

- 进一步优化量化算法,提高推理效率

- 扩展到更多硬件平台和加速库

- 改进指令微调和多语言支持

随着RWKV模型的不断进化和RWKV.cpp项目的持续优化,我们有理由相信这一创新的语言模型架构将在AI领域发挥越来越重要的作用,为更多应用场景带来高效、低成本的解决方案。

RWKV.cpp项目为RWKV模型提供了高效的CPU推理实现,让这一创新的语言模型架构能够在普通硬件上发挥强大威力。无论是个人开发者还是企业用户,都可以通过RWKV.cpp轻松体验RWKV模型的魅力。随着项目的不断发展和社区的积极贡献,我们期待看到更多基于RWKV的创新应用涌现。

文章链接:www.dongaigc.com/a/rwkv-cpp-efficient-cpu-inference

https://www.dongaigc.com/a/rwkv-cpp-efficient-cpu-inference

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)