构建基于OpenCV的实时人脸识别签到系统

OpenCV是一个开源的计算机视觉和机器学习软件库,它包含了大量的图像处理和识别的算法。自从1999年诞生以来,OpenCV成为了全球开发者和研究人员在视觉技术领域的首选工具之一。它广泛应用于学术研究、工业应用、以及各种娱乐应用中。在人脸识别领域,OpenCV不仅提供了基本的图像处理功能,还内置了多种人脸检测方法,比如Haar特征级联分类器、深度学习模型等。

简介:本项目结合计算机视觉和机器学习技术,通过使用OpenCV库,设计并实现了一个实时人脸识别签到系统。该系统首先通过人脸检测定位图像中的面部,然后提取面部特征进行匹配,最后使用机器学习模型如SVM或KNN来识别个体。系统采用C++进行编程,涵盖了从数据收集到模型训练、实时检测、特征匹配到签到记录的完整流程,并讨论了优化和应用场景。

1. OpenCV简介及其在人脸识别中的应用

OpenCV是一个开源的计算机视觉和机器学习软件库,它包含了大量的图像处理和识别的算法。自从1999年诞生以来,OpenCV成为了全球开发者和研究人员在视觉技术领域的首选工具之一。它广泛应用于学术研究、工业应用、以及各种娱乐应用中。

在人脸识别领域,OpenCV不仅提供了基本的图像处理功能,还内置了多种人脸检测方法,比如Haar特征级联分类器、深度学习模型等。除此之外,它还支持各种先进的特征提取方法和机器学习算法,如Eigenfaces、Fisherfaces、LBPH(局部二值模式直方图)、SVM(支持向量机)和KNN(K最近邻算法)等,使研究人员和开发人员能够轻松地构建和实现复杂的人脸识别系统。

OpenCV的易用性和强大的功能使其在人脸识别领域中占据了重要的地位。本章将对OpenCV进行一个简单的介绍,并概述其在人脸识别应用中的主要作用和优势。接下来的章节将详细探讨人脸识别的基础知识以及使用OpenCV进行人脸检测和特征提取的具体方法。

2. 人脸识别基础与OpenCV的人脸检测方法

2.1 人脸识别的原理

人脸识别技术是一种基于人的面部特征信息进行身份鉴别的生物识别技术。它包括图像处理、模式识别和机器学习等多个方面。在实际应用中,人脸识别通常分为人脸检测和人脸匹配两个主要步骤。

2.1.1 图像处理基础

图像处理是人脸识别技术中最为基础的环节,它涉及到图像的采集、预处理、增强和特征提取。首先,图像采集指的是使用摄像头等设备捕捉到的原始图像信息。由于原始图像通常包含有噪声和不均匀的光照等因素,因此需要进行预处理,如灰度化、滤波去噪等操作。预处理后的图像将用于后续的特征提取。

在预处理之后,往往需要进行图像增强,增强可以提高图像的质量,例如,通过对比度增强、直方图均衡化等技术改善图像的可识别度。这些步骤都是为了更好地从图像中提取出有效信息,为后续的特征提取和人脸检测奠定基础。

2.1.2 人脸检测的概念

人脸检测的目标是在给定的图像中定位到人脸的位置,并将其从背景中分离出来。一个有效的检测算法可以准确地判断出图像中是否存在人脸,并识别出人脸的具体位置。人脸检测技术的关键在于算法的选择,它可以是基于规则的方法,也可以是基于机器学习的方法。近年来,基于深度学习的人脸检测方法以其高准确率获得了广泛的认可和应用。

2.2 OpenCV中的人脸检测技术

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库,它提供了大量图像处理和计算机视觉方面的算法实现。在人脸检测领域,OpenCV提供了几种成熟的方法。

2.2.1 Haar特征级联分类器

Haar特征级联分类器是一种广泛应用于人脸检测的经典方法。其原理是通过提取图像中的Haar特征,这是一种简单的矩形特征,可以描述图像中边缘、线条、中心等区域的特征。然后利用级联分类器对这些特征进行分类,以此来识别出人脸的位置。

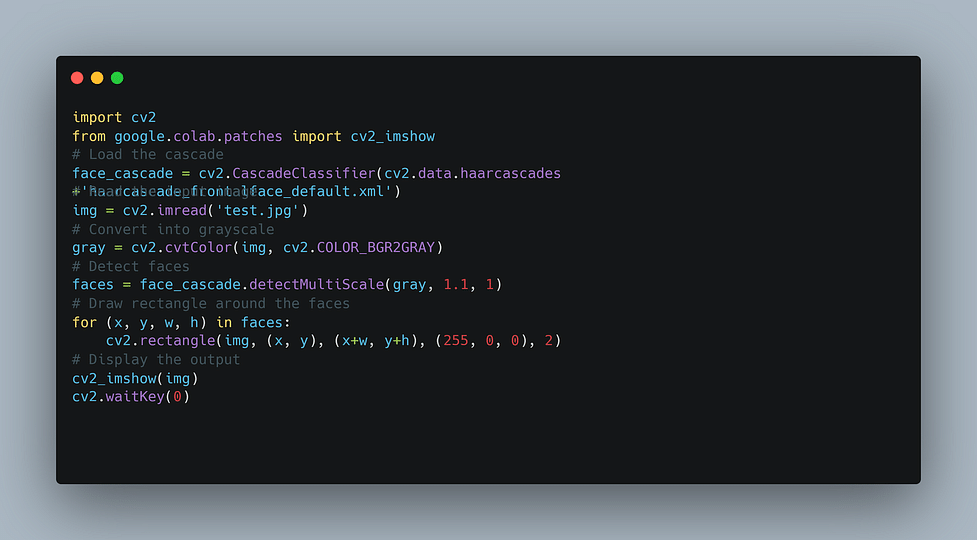

使用Haar特征级联分类器进行人脸检测的过程包括:训练一个级联的分类器来区分人脸和非人脸区域;然后在实际图像上应用此分类器,通过滑动窗口的方式遍历整个图像,并对每个窗口区域内的图像应用分类器进行判断;最终识别出含有一个人脸的区域。

import cv2

# 加载预训练的Haar特征级联分类器

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')

# 读取图片

img = cv2.imread('sample.jpg')

# 将图片转换为灰度图

gray_img = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 进行人脸检测

faces = face_cascade.detectMultiScale(gray_img, scaleFactor=1.1, minNeighbors=5)

# 在人脸周围画矩形框

for (x, y, w, h) in faces:

cv2.rectangle(img, (x, y), (x+w, y+h), (255, 0, 0), 2)

# 显示图片

cv2.imshow('Faces found', img)

cv2.waitKey(0)

cv2.destroyAllWindows()

在这段代码中,我们首先导入了OpenCV库,并加载了一个预训练的Haar级联分类器用于检测图像中的人脸。然后读取一张图像,并将其转换为灰度图像。接下来,我们使用 detectMultiScale 函数对灰度图像进行人脸检测,该函数会返回检测到的人脸的矩形区域。最后,我们在每个检测到的人脸周围画出一个蓝色的矩形框,并显示图像。

2.2.2 使用OpenCV进行人脸检测实例

在实际应用中,Haar特征级联分类器被广泛地用于人脸检测。以下是一个使用OpenCV进行人脸检测的完整实例,这个例子演示了如何利用OpenCV来实现一个简单的人脸识别系统。

import cv2

import numpy as np

# 加载Haar特征分类器文件

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')

# 打开摄像头

cap = cv2.VideoCapture(0)

while True:

# 读取一帧图像

ret, frame = cap.read()

if not ret:

break

# 将图像转换为灰度图

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 进行人脸检测

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

# 在人脸周围画矩形框

for (x, y, w, h) in faces:

cv2.rectangle(frame, (x, y), (x+w, y+h), (255, 0, 0), 2)

# 显示图像

cv2.imshow('Face Detection', frame)

# 按'q'键退出循环

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放摄像头资源

cap.release()

cv2.destroyAllWindows()

在这个例子中,我们首先导入了 cv2 和 numpy 库,并使用 cv2.CascadeClassifier 来加载预训练的Haar级联分类器。接下来,我们通过 cv2.VideoCapture(0) 打开默认摄像头。在一个循环中,我们不断读取摄像头的帧,将其转换为灰度图像后,使用 detectMultiScale 方法进行人脸检测。检测到的人脸会以矩形框的形式在原图上标注出来,并实时显示在窗口中。当用户按下’q’键时,程序将结束循环并释放摄像头资源。

3. 特征提取方法在人脸识别中的应用

人脸识别技术的发展历程中,特征提取方法扮演了至关重要的角色。特征提取的目的是为了从人脸图像中提取出最具判别力的信息,以此来区分不同的人脸。这一过程极大地提升了人脸识别系统的准确性和效率。本章将深入探讨特征提取方法,特别是在OpenCV中常用的技术。

3.1 传统特征提取方法

3.1.1 Eigenfaces方法

Eigenfaces是人脸识别领域的一项开创性技术,最初由Turk和Pentland于1991年提出。该方法的基本思想是将人脸图像进行向量化,然后通过主成分分析(PCA)提取最重要的特征向量,形成一个特征脸空间。在这个空间中,每个新的人脸图像都可以表示为这些特征向量的线性组合。

Eigenfaces方法的一个关键优势在于它能够通过较少的特征维数来表示人脸图像,这大大减少了计算量,同时也为后续的分类和识别任务提供了便利。然而,它也有一些局限性,比如对于表情、姿态变化以及光线条件的敏感性。

3.1.2 Fisherfaces方法

Fisherfaces方法基于线性判别分析(LDA),是Eigenfaces方法的改进版。其核心思想是寻找一个线性变换,使得变换后的数据在类别内具有最小的散布度,而类别间具有最大的散布度。这样得到的特征具有更高的判别能力。

与Eigenfaces相比,Fisherfaces更加关注区分不同类别的信息,因此在人脸识别任务中表现出更好的性能。不过,Fisherfaces在处理大规模数据集时计算代价较高,且对于数据的正则化要求更严格。

3.2 局部二值模式直方图(LBPH)

3.2.1 LBPH的原理

局部二值模式直方图(LBPH)是一种有效的纹理描述符,用于人脸图像特征提取。该方法首先将人脸图像划分为小块,并对每个小块中的像素进行二值化处理,然后统计每个小块中二值模式的出现频率,形成直方图。

LBPH的关键特点在于它对局部变化非常敏感,能够较好地保持人脸图像的局部纹理信息。因此,即使在表情变化较大或轻微遮挡的情况下,LBPH仍能提取出有用的特征。此外,由于LBPH具有良好的抗噪声能力,因此在复杂背景下的表现也较为出色。

3.2.2 LBPH在OpenCV中的实现

在OpenCV中,LBPH的实现主要通过 FaceRecognizer 类及其子类 LBPHFace 来完成。下面的代码段演示了如何使用OpenCV进行LBPH特征提取:

import cv2

# 创建LBPH人脸识别器实例

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')

recognizer = cv2.face.LBPHFaceRecognizer_create()

# 读取人脸数据集

imagePaths = ["path/to/person1/image1.jpg", "path/to/person1/image2.jpg", ...]

gray_images = []

labels = []

for imagePath in imagePaths:

image = cv2.imread(imagePath, cv2.IMREAD_GRAYSCALE)

gray_images.append(image)

labels.append(label_for_image)

# 训练人脸识别器

recognizer.train(gray_images, np.array(labels))

# 进行人脸识别

def predict_image(imagePath):

image = cv2.imread(imagePath, cv2.IMREAD_GRAYSCALE)

result, confidence = recognizer.predict(image)

return result, confidence

# 使用示例

result, confidence = predict_image("path/to/test/image.jpg")

print(f"Predicted label: {result}, Confidence: {confidence}")

在上述代码中,首先创建了一个 LBPHFaceRecognizer 实例。随后,从文件系统中读取了训练图像,并将其转换为灰度图像,因为LBPH是基于灰度图像进行操作的。之后,使用 train 方法对人脸识别器进行训练,其中包含了人脸图像和对应的标签。最后,通过 predict 方法可以进行人脸识别并返回预测结果及其置信度。

这段代码展示了使用LBPH进行特征提取和人脸识别的完整流程,从加载图像、训练模型到最终的预测步骤。通过这样的流程,开发者可以构建出实际可用的人脸识别系统。

4. 机器学习模型在人脸识别中的应用

在人脸识别技术中,机器学习模型扮演着至关重要的角色,它们通过学习大量的数据样本,能够逐渐提升识别的准确率和效率。本章节将深入探讨两种常见的机器学习算法:支持向量机(SVM)和K最近邻算法(KNN),以及它们在人脸识别中的具体应用。

4.1 支持向量机(SVM)在人脸识别中的应用

4.1.1 SVM的基本原理

支持向量机(SVM)是一种二分类模型,其基本模型定义在特征空间上间隔最大化的线性分类器。其核心思想是寻找一个超平面,该超平面能够在多维空间中将不同类别的数据点分开,并使得分类间隔(即离超平面最近的数据点到超平面的距离)最大化。这个超平面被称为最大间隔分类器。

在实际操作中,SVM利用核技巧来处理非线性可分的问题。通过将数据映射到更高维的空间,可以在新的空间中找到一个线性的超平面来完成分类任务。常用的核函数包括线性核、多项式核、径向基函数(RBF)核等。

4.1.2 SVM在OpenCV中的人脸识别应用

在OpenCV中,SVM可以用于训练一个分类器,用来识别已知人脸。下面是一个使用SVM进行人脸识别的简单示例代码:

import cv2 as cv

import numpy as np

# 训练数据集和标签

samples = np.load('face_samples.npy')

responses = np.load('face_responses.npy')

# 创建SVM分类器,使用线性核函数

svm = cv.ml.SVM_create()

svm.setType(cv.ml.SVM_C_SVC)

svm.setKernel(cv.ml.SVM_LINEAR)

svm.setTermCriteria((cv.TERM_CRITERIA_MAX_ITER, 100, 1e-6))

# 训练SVM分类器

svm.train(np.float32(samples), cv.ml.ROW_SAMPLE, np.float32(responses))

# 对新的数据进行预测

new_sample = np.load('new_face_sample.npy')

prediction = svm.predict(np.float32([new_sample]))[1]

print(f"Predicted class: {prediction}")

在这段代码中,我们首先加载了训练用的人脸样本数据和对应的标签。接着创建了一个SVM分类器,这里使用的是线性核函数。训练数据随后被用来训练这个分类器。最后,我们使用训练好的模型对一个新的样本进行预测,并打印出预测结果。

4.2 K最近邻算法(KNN)在人脸识别中的应用

4.2.1 KNN的基本原理

K最近邻算法(KNN)是一种基本分类与回归方法。在分类问题中,给定一个训练数据集,对新的输入实例,在训练集中找到与该实例最邻近的K个实例,这K个实例的多数属于某个类别,则该输入实例也属于这个类别。

KNN算法的优点是简单易懂,且不需要对数据进行预处理,如归一化等。不过KNN算法的计算量相对较大,尤其是当样本数量巨大时,需要对每个样本与查询点的距离进行计算。

4.2.2 KNN在OpenCV中的人脸识别应用

同样,在OpenCV中,KNN也可以用于训练分类器,用于识别已知的人脸。下面展示了如何使用KNN进行人脸识别的示例:

import cv2 as cv

import numpy as np

# 训练数据集和标签

samples = np.load('face_samples.npy')

responses = np.load('face_responses.npy')

# 创建KNN分类器

knn = cv.ml.KNearest_create()

# 训练KNN分类器

knn.train(np.float32(samples), cv.ml.ROW_SAMPLE, np.float32(responses))

# 对新的数据进行预测

new_sample = np.load('new_face_sample.npy')

ret, results, neighbors, dist = knn.findNearest(np.float32([new_sample]), k=3)

print(f"Predicted class: {results[0][0]}")

在这段代码中,我们首先加载了训练用的人脸样本数据和对应的标签。随后创建了一个KNN分类器,并用训练数据对其进行训练。最后,我们用训练好的模型对一个新的样本进行预测,并打印出预测结果。

在实际应用中,为了提高人脸识别的准确性和效率,通常会将SVM和KNN等算法与特征提取方法结合起来使用。例如,可以先使用LBPH(局部二值模式直方图)方法提取人脸特征,然后将这些特征用于SVM或KNN模型进行训练和识别。通过这种方法,可以有效地提高人脸识别系统的性能。

以上内容展示了SVM和KNN在人脸识别中的应用,接下来的章节将介绍人脸识别签到系统的开发与实践,这将是将理论知识应用于实际问题的一个重要步骤。

5. 人脸识别签到系统的开发与实践

人脸识别技术在日常生活中已经变得越来越普遍,特别是在签到系统中得到了广泛的应用。本章节将带领读者深入了解如何使用C++和OpenCV库开发一个人脸识别签到系统。

5.1 C++与OpenCV结合开发环境搭建

为了开发人脸识别签到系统,首先需要设置好开发环境。我们将使用C++语言,因为它的运行速度足够快,适合进行图像处理和模式识别。

5.1.1 C++编程环境配置

在开始之前,我们需要安装一个支持C++的集成开发环境(IDE)。常见的选择有Visual Studio、Eclipse CDT等。本教程中,我们选用Visual Studio,因为它对于Windows用户非常友好,并且支持C++11及以上版本,这对于使用OpenCV库尤为重要。

5.1.2 OpenCV库安装与配置

安装好C++的开发环境后,接下来就是安装OpenCV库。OpenCV是一个开源的计算机视觉和机器学习软件库,它提供了很多预编译的库,使得安装过程变得非常简单。

- 从OpenCV官方网站下载与你的开发环境匹配的版本。

- 解压缩下载的文件,并记住解压后的路径。

- 打开Visual Studio,进入”工具”->”选项”,在”项目和解决方案”->”VC++目录”中添加OpenCV的include目录和lib目录到”包含目录”和”库目录”。

- 在”链接器”->”输入”中,添加OpenCV的lib文件路径到”附加依赖项”。

完成以上步骤后,就可以在C++项目中使用OpenCV库进行开发了。

5.2 签到系统的需求分析与设计

在开发之前,需求分析与系统设计是不可或缺的步骤,它将指导整个项目的开发。

5.2.1 系统功能需求

我们的签到系统需要具备以下功能:

- 实时人脸检测 :能够从视频流中实时检测出人脸。

- 人脸比对 :将检测到的人脸与数据库中存储的人脸进行比对。

- 签到记录 :比对成功后,记录签到时间并通知用户。

- 用户界面 :提供简洁的用户界面,显示签到状态和记录。

5.2.2 系统架构设计

本系统将采用模块化的架构设计,主要分为以下几个模块:

- 数据采集模块 :负责获取摄像头的视频流。

- 处理模块 :包括人脸检测、特征提取和比对算法。

- 数据库模块 :存储人脸数据和签到记录。

- 用户界面模块 :提供交互界面,显示系统信息。

5.3 签到系统的完整实现流程

下面我们将详细介绍签到系统的实现过程,包括数据采集、处理和最终的签到逻辑。

5.3.1 数据采集与预处理

#include <opencv2/opencv.hpp>

int main() {

cv::VideoCapture capture(0); // 打开默认摄像头

if (!capture.isOpened()) {

std::cerr << "摄像头打开失败" << std::endl;

return -1;

}

cv::Mat frame;

while (true) {

capture >> frame; // 从摄像头获取一帧

if (frame.empty()) {

std::cerr << "视频帧读取失败" << std::endl;

break;

}

cv::imshow("采集的视频流", frame); // 显示视频流

// 这里可以添加预处理代码

char c = cv::waitKey(20); // 按任意键继续,20ms响应一次

if (c == 27) { // 按ESC键退出

break;

}

}

return 0;

}

上述代码段展示了如何使用C++和OpenCV库来从摄像头获取视频流,并实时显示。视频流的获取是签到系统的第一步。

5.3.2 人脸检测与特征提取

在视频流的基础上,我们需要进行人脸检测,并提取人脸特征。使用OpenCV的Haar特征级联分类器进行人脸检测是一个流行的选择。

// 在前面的代码基础上继续

cv::CascadeClassifier face_cascade;

if (!face_cascade.load("haarcascade_frontalface_default.xml")) {

std::cerr << "人脸检测模型加载失败" << std::endl;

return -1;

}

std::vector<cv::Rect> faces;

cv::Mat frame_gray;

cv::cvtColor(frame, frame_gray, cv::COLOR_BGR2GRAY);

face_cascade.detectMultiScale(frame_gray, faces);

for (const auto& face : faces) {

cv::rectangle(frame, face, cv::Scalar(255, 0, 0), 2); // 画出人脸矩形框

// 这里可以添加特征提取代码

}

cv::imshow("检测到的人脸", frame);

在上述代码中,我们使用了OpenCV的 CascadeClassifier 类加载了Haar特征级联分类器,并对视频流中的每一帧进行人脸检测。

5.3.3 人脸识别与签到逻辑

在获取了人脸区域后,我们需要进行人脸识别。这通常需要使用机器学习算法来完成,比如使用Eigenfaces或Fisherfaces方法,或是K最近邻算法等。

// 在前面代码的基础上继续

// 假设我们已经有了一个训练好的人脸识别模型face_model

// 使用该模型对检测到的人脸进行识别

for (const auto& face : faces) {

// 提取特征(此处需要根据实际情况来实现)

// ...

// 使用模型进行识别

// ...

// 如果识别成功,记录签到信息

// ...

}

在这个阶段,根据识别结果,我们可以进一步实现签到逻辑。例如,如果用户身份被正确识别,我们可以记录签到时间,并将此信息存储在数据库中供后续查询和验证。

以上就是人脸识别签到系统开发的详细流程。系统开发完成后,我们还需要对系统进行测试和优化,以保证其稳定性和准确性。在接下来的章节中,我们将讨论人脸识别系统所面临的挑战以及优化策略。

简介:本项目结合计算机视觉和机器学习技术,通过使用OpenCV库,设计并实现了一个实时人脸识别签到系统。该系统首先通过人脸检测定位图像中的面部,然后提取面部特征进行匹配,最后使用机器学习模型如SVM或KNN来识别个体。系统采用C++进行编程,涵盖了从数据收集到模型训练、实时检测、特征匹配到签到记录的完整流程,并讨论了优化和应用场景。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)