【论文阅读05】-基于知识图谱与大语言模型的航空装配故障诊断联合方法

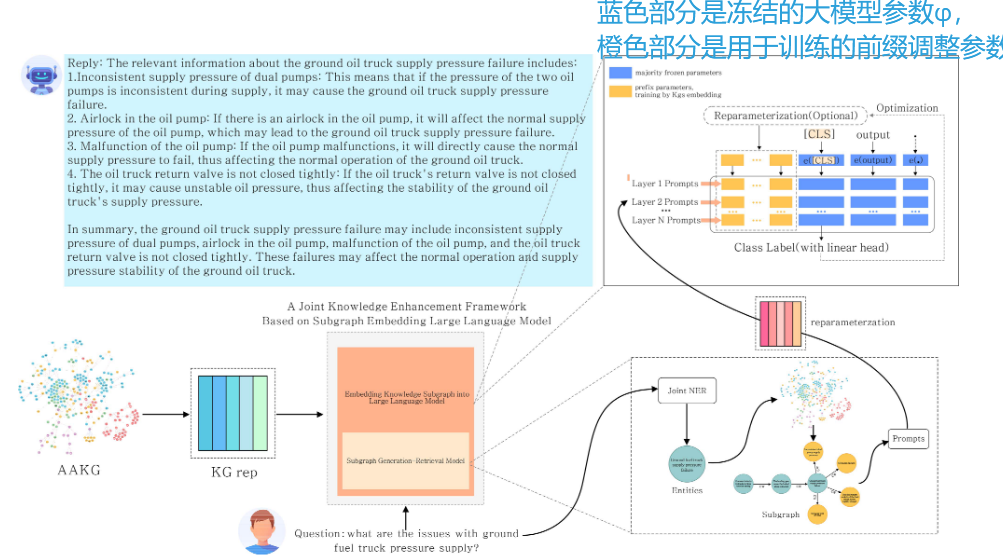

本文提出了一种融合知识图谱(KG)与大语言模型(LLM)的联合知识增强框架,用于航空装配领域的智能故障诊断。该框架采用两阶段设计:首先通过前缀调优技术将KG子图嵌入LLM,使模型掌握专业知识;然后在推理时通过子图生成-检索机制动态获取相关知识。实验结果表明,该方法在自建航空装配故障数据集(AA550)上达到98.5%的准确率,响应时间小于1.1秒,诊断效率较人工提升15倍。研究为解决复杂工业场景下

📌 研究背景与问题

- 研究背景:航空装配系统复杂度高,传统故障诊断依赖人工查询手册,效率低下;

- 问题陈述:多维信息(组件、工艺、工具等)形成复杂系统,需要智能故障定位解决方案技术;

- 挑战:LLMs缺乏事实知识捕获能力,KGs缺乏创造性和用户体验。

能否将KG的准确性与LLM的智能性相结合,取长补短,构建一个既可靠又易用的航空装配故障诊断专家系统?

📌 研究目标

提出一种KG与LLM的联合知识增强模型,实现航空装配领域高效、高精度的智能故障定位与解决方案生成。

🧠 所用方法

一、整体框架设计

-

核心思想: 外挂检索 + 内嵌微调” 的混合系统。

可分为三阶段:

-

阶段一(输入与检索):

- 用户输入自然语言问题;

-

命名实体识别:系统通过 NER去 AAKG(知识图谱)里检索 出相关的实体和子图;

-

子图提取:系统根据实体去知识图谱AAKG里检索直接相关的节点,形成一个小型的网络即子图。

-

对应RAG 中的 Retrieve 环节。

-

阶段二(增强与嵌入):

-

将领域知识(KG子图)通过前缀调优技术嵌入LLM,让模型“学好专业知识”。

-

对应RAG 中的 Augment 环节。

-

-

阶段三(推理与生成):

-

信号进入大模型。

-

关键点:信号先经过**“经过特训的黄色前缀参数”(这里蕴含了模型对航空装配领域的理解),再流经“通用的蓝色模型参数”**。

-

最终生成具备专业知识的诊断报告。

-

联合知识增强框架

创新点一:基于子图嵌入的前缀微调大模型(离线阶段)

-

目的:让大模型学会一种通用的能力——即如何阅读和理解输入的知识图谱子图。

-

数据准备:收集大量的“故障问题 + 对应子图 + 标准答案”的数据对。

-

冻结主体:LLM 的大部分参数(蓝色块)是冻结的,不参与训练。

-

训练前缀:采用前缀微调,只训练插入在每一层前面的前缀参数(Prefix Parameters,黄色块) 。

优势: 使LLM内部化领域知识,成为一个领域专家,同时训练效率高。

创新点二:子图生成-检索模型(在线阶段)

-

输入:用户的自然语言问题。

-

基于 NER 的关键实体识别:提出一种联合统计学习与深度学习的命名实体识别模型,用于从问题中准确提取关键故障实体(如部件、参数、异常现象等)。

-

子图检索:通过图数据库(Neo4j)检索与实体直接和间接关联的节点及关系,从知识图谱(KG)中提取出 2-step 关系子图。

-

知识注入:将检索到的子图转化为结构化三元组序列,再转化为Prompt/Embedding,与指令和问题一起输入模型。

-

输出:模型通过训练好的“黄色参数”来深度理解这些子图结构,生成最终答案。

易混点:本文属于广义的RAG

RAG 的定义(核心特征)

广义RAG = Retrieval-Augmented Generation,指:

-

Retrieve:从外部知识源获取相关信息。

-

Augment:把获取的信息注入到模型的输入或参数中。

-

Generate:模型基于注入的信息生成回答。

狭义 RAG:

-

把文本切块 -> 变成向量 (Embedding) -> 存入向量库 (FAISS/Milvus) -> 算余弦相似度检索。

-

这是目前最流行的做法,所以容易让人产生“RAG = 向量库”的错觉。

🧪 实验设计

一、实验设置

-

数据集: 自建航空装配故障定位语料库AA550,包含200个真实工业故障案例,并通过添加噪声(错别字、语序颠倒)构建了总计1655条问题,模拟真实环境。

-

对比模型:

-

未调优的ChatGLM-6B

-

ERNIE-3.5

-

仅使用子图嵌入的GLM模型

-

本文提出的联合增强模型

-

-

评估指标: 准确率、精确度、召回率、F1值。

二、主要实验结果

-

准确性对比:

-

本文模型: 98.5% (在200个案例中正确诊断197个)

-

子图嵌入GLM: 93%

-

ChatGLM: 41.5%

-

ERNIE: 45%

-

-

结论: 本文提出的联合模型在故障诊断准确率上显著优于其他基线模型,证明了方法的有效性。

三、系统性能与应用验证

-

效率: 平均响应时间<1.1秒,字符生成速度达10.92字符/秒。

-

工业价值: 诊断耗时仅为人工审查的6.5%,效率提升巨大。

-

案例展示: 通过一个具体故障案例(如“XX部件安装不到位”),展示系统如何通过检索子图、融合知识,最终生成准确解决方案的全过程,体现其可解释性。

✅ 研究结论

-

本研究成功开发了一个KG与LLM深度融合的航空装配故障诊断联合框架。

-

通过知识增强(前缀调优) 和检索增强(子图检索) 双重机制,有效解决了LLM在专业领域知识不足和不可信的问题。

-

实验证明,该框架不仅实现了接近98.5%的超高诊断准确率,还具备了高效率、高可解释性的优点,满足工业应用需求。

📈 研究意义

本文的研究意义在于提出了一种融合知识图谱与大语言模型的联合知识增强框架,为解决航空装配等复杂工业场景中的智能故障诊断问题提供了创新性解决方案。该方法通过将知识图谱的结构化专业知识以子图形式嵌入大语言模型的前缀调优过程,显著提升了模型在专业领域的知识推理准确性和可靠性,同时保留了大语言模型的自然语言交互优势。

🔮 未来研究方向

-

技术层面: 探索更高效的子图采样策略、尝试更多先进的LLM作为基座模型。

-

应用层面: 将本框架扩展至航空维修、其他复杂装备制造等更多工业领域。

-

功能层面: 研究支持多模态输入(如图片、视频)的故障诊断,使系统能力更加全面。

📕专业名词

一、核心人工智能技术术语

LLM (Large Language Model) - 大语言模型

-

外行定义:一种经过海量文本数据训练的人工智能系统,能够理解和生成人类语言,类似一个非常博学的"文字预测器",可以根据输入的问题或提示生成连贯的回答。

KG (Knowledge Graph) - 知识图谱

-

外行定义:一种以图形方式组织知识的方法,将现实世界中的事物(实体)和它们之间的关系用节点和连线表示,就像一张巨大的"知识地图"。

AAKG (Aviation Assembly Knowledge Graph) - 航空装配知识图谱

-

外行定义:专门为航空装备制造领域构建的知识图谱,包含了飞机组装过程中涉及的所有部件、工艺、故障现象和解决方案等专业知识。

二、自然语言处理技术术语

NER (Named Entity Recognition) - 命名实体识别

-

外行定义:从文本中自动识别和提取特定类型实体的技术,比如从问题中找出人名、地名、机构名或本文中的故障部件名称等。

HMM (Hidden Markov Model) - 隐马尔可夫模型

-

外行定义:一种统计模型,用于处理序列数据,通过观察可见的信号来推测背后不可见的状态序列,常用于语音识别和文本标注。

CRF (Conditional Random Field) - 条件随机场

-

外行定义:一种更先进的序列标注模型,能够考虑整个句子的上下文信息来做出更准确的标注决策。

BiLSTM (Bidirectional Long Short-Term Memory) - 双向长短期记忆网络

-

外行定义:一种特殊的神经网络,能够同时从前后两个方向理解文本的上下文含义,更好地捕捉长距离的依赖关系。

三、模型训练与优化术语

Prefix-tuning - 前缀调优

-

外行定义:一种高效训练大模型的方法,只训练添加到输入前的一小段"提示词"参数,而不改动模型原有的权重,就像给模型一个专门的"使用说明书"。

Fine-tuning - 微调

-

外行定义:在预训练好的基础模型上,用特定领域的数据进行进一步训练,使模型适应特定任务的过程。

Adapter-tuning - 适配器调优

-

外行定义:一种参数高效的微调方法,在模型中插入小的可训练模块(适配器),而保持主干网络参数不变。

P-tuning v2

-

外行定义:前缀调优的改进版本,在模型的多个层都添加可训练的提示参数,效果更好。

四、评估指标术语

F1值 (F1-score)

-

外行定义:综合考量模型准确率和召回率的评价指标,数值越高说明模型整体性能越好,是准确率和召回率的"调和平均数"。

Precision - 精确度

-

外行定义:模型预测为正例的样本中,真正为正例的比例,衡量的是"宁缺毋滥"的程度。

Recall - 召回率

-

外行定义:所有真实的正例样本中,被模型正确预测出来的比例,衡量的是"网罗全面"的程度。

五、其他专业术语

Transformer架构

-

外行定义:当前大多数先进语言模型采用的底层技术架构,使用自注意力机制来处理序列数据。

Retrieval-augmentation - 检索增强

-

外行定义:让模型在回答问题前先从一个知识库中查找相关信息,然后基于这些信息生成回答,类似于"开卷考试"。

Stochastic Gradient Descent - 随机梯度下降

-

外行定义:一种优化算法,通过不断微调模型参数来最小化错误率,是模型"学习"的核心过程。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)