Transformer+YOLO:新一代目标检测的王炸组合!

目标检测领域近年涌现多项突破性进展,包括YOLOv10通过架构优化实现端到端无NMS检测,RT-DETR首次将Transformer模型应用于实时检测,以及DINO通过去噪训练和混合查询显著提升DETR性能。这些创新工作从模型架构、训练策略和实时性等维度推动着检测技术的发展,在COCO等基准上不断刷新精度-速度平衡的纪录。

在目标检测这个已经“卷”到飞起的赛道上,你是不是也常常被铺天盖地的模型名字和花样百出的改进点轰到头昏眼花:两阶段、一阶段、Anchor-free、Transformer、端到端检测……真正想系统梳理,却总感觉缺一条“主线”?

为了帮你把握这一领域的核心脉络,我们精选了近几年发表在 CVPR、ICCV、ECCV、NeurIPS 等顶会顶刊上的 15 篇高引用目标检测论文既包含从 Faster R-CNN、RetinaNet 等奠定现代检测框架的基石性工作,也涵盖 DETR 及一系列后续改进、轻量化与实时检测、以及面向实际场景(小目标、密集目标、多尺度等)的关键突破,需要的同学可以扫码领取。

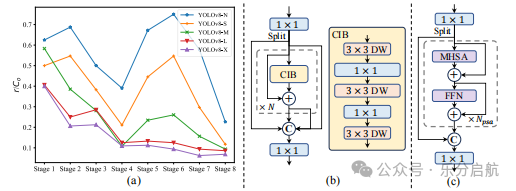

YOLOv10: Real-Time End-to-End Object Detection

本文提出了一种新型实时端到端目标检测模型YOLOv10,通过优化模型架构和去NMS训练策略,实现了更高的性能效率平衡。

主要创新点

-

-

系统性地从架构和训练两侧优化 YOLO 系列,包括 backbone、neck、head 与训练策略,从而实现端到端、无 NMS 的检测框架。

-

在 COCO 上各个尺度模型都取得更优的精度–速度折中,例如 YOLOv10-S 在与 RT-DETR-R18 精度相当时,速度约快 1.8 倍,参数也显著更少。

-

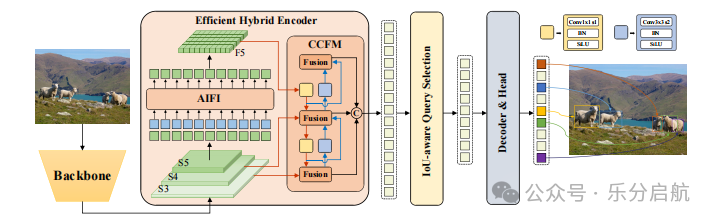

RT-DETR: DETRs Beat YOLOs on Real-time Object Detection

本文提出了RT-DETR,一种首个实现实时端到端对象检测的Transformer-based模型,有效解决了YOLO系列因NMS导致的速度和精度损失问题。

主要创新点

-

AIFI:基于注意力的尺度内特征交互;

-

再配合最小不确定性查询选择(IoU-aware / Uncertainty-aware queries),实现可调节的速度–精度平衡。

-

提出 Real-Time DEtection TRansformer (RT-DETR),是首个真正做到实时 & 端到端(无 NMS) 的 DETR 型检测器。

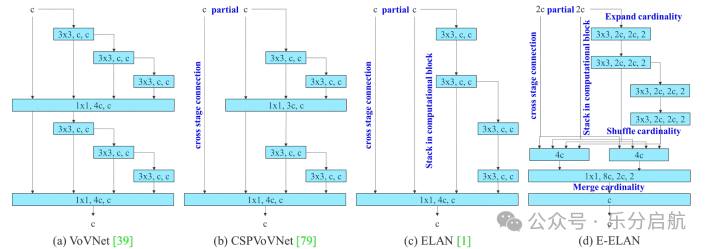

YOLOv7: Trainable bag-of-freebies sets new SOTA for real-time detectors

论文提出了一种新的实时物体检测方法YOLOv7,通过可训练的免费特性集,在5至120帧每秒的范围内实现了速度和准确度的领先,并在30帧每秒以上的实时物体检测中取得了最高的56.8%平均精度(AP)。

主要创新点

-

提出“trainable bag-of-freebies”理念,把大量训练 tricks 设计成可学习模块,并结合新的网络结构与 compound scaling 策略。

-

在 5–160 FPS 范围内,YOLOv7 在 V100 上实现最高 56.8% COCO AP,是当时最快的高精度实时检测器之一。

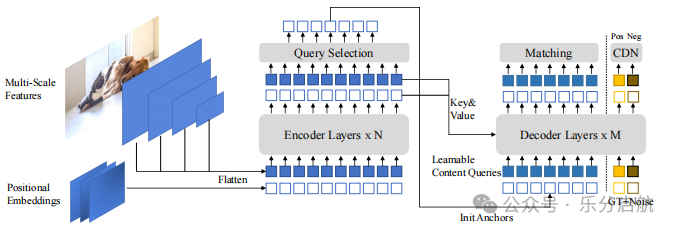

DINO: DETR with Improved DeNoising Anchor Boxes for End-to-End Object Detection

本论文介绍了一种名为DINO的最新端到端目标检测器,通过使用对比式的去噪训练、混合查询选择方法进行锚框初始化和预测,并且实现了优于以往DETR类模型的性能和效率,最终在COCO上达到49.4 AP(12个epochs)和51.3 AP(24个epochs)的精度,相比于之前最好的DETR类模型DN-DETR,分别提升了6.0 AP和2.7 AP。DINO在模型大小和数据量上具有很好的扩展能力,在Objects365数据集上进行预训练,并且在COCO val2017和test-dev上达到63.2 AP和63.3 AP的最佳结果,相比于其他模型在榜单上显著减小了模型大小和预训练数据量但取得了更好的结果。

主要创新点

-

Mixed Query Selection:混合查询初始化,提高 anchor 初始化质量;

-

Contrastive DeNoising Training:对抗式去噪训练,提高收敛速度和鲁棒性;

-

Look Forward Twice:两次 box 预测机制,提升定位精度。

-

在 DN-DETR 的基础上,提出三大关键改进

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)