轻松上手:LM Studio本地大语言模型部署指南

它的聊天界面设计得很直观,参数都有悬停提示,对新手很友好。不需要连接云端服务器,所有数据处理都在本地完成,这对于注重隐私保护的项目特别有用。新版本还增加了本地文档交互功能,可以直接让模型分析你自己的文件内容。最近尝试了LM Studio这款本地大语言模型部署工具,发现它确实为想要在离线环境下使用AI能力的开发者提供了很大便利。实际使用中发现这个平台的一键部署特别方便,生成的项目可以直接在线运行,省

快速体验

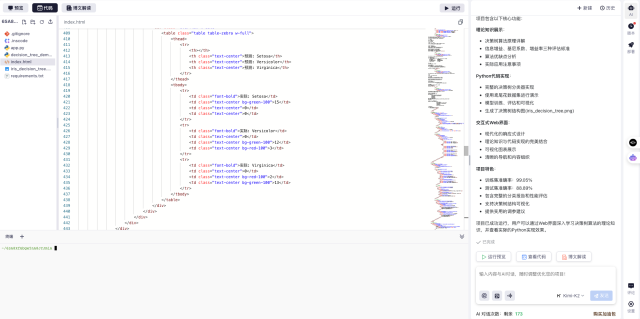

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框输入如下内容

帮我开发一个本地LLM演示系统,用于展示大语言模型在离线环境下的文本生成能力。系统交互细节:1.提供模型选择界面 2.支持输入文本提示词 3.显示模型生成的文本结果。注意事项:需兼容常见GGUF格式模型文件。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

最近尝试了LM Studio这款本地大语言模型部署工具,发现它确实为想要在离线环境下使用AI能力的开发者提供了很大便利。这里把我的使用心得整理成笔记分享给大家。

-

核心功能亮点 LM Studio最吸引我的就是它的离线运行能力。不需要连接云端服务器,所有数据处理都在本地完成,这对于注重隐私保护的项目特别有用。新版本还增加了本地文档交互功能,可以直接让模型分析你自己的文件内容。

-

安装配置要点 在Windows系统上安装过程很顺畅,但要注意硬件要求。我的笔记本是16GB内存加NVIDIA显卡,运行起来比较流畅。如果只有集成显卡的话,建议选择小一点的模型。安装完成后,通过内置的Discover页面可以很方便地下载各种开源模型。

-

实际应用场景 我主要用它来做两方面的事情:一是作为写作助手生成创意文本,二是通过API接口让其他程序调用。它的聊天界面设计得很直观,参数都有悬停提示,对新手很友好。API兼容OpenAI的格式这点特别实用,很多现有工具都能直接对接。

-

使用小技巧 刚开始使用时,建议从7B参数的小模型开始尝试。大模型虽然效果更好,但对硬件要求也高。另外,如果遇到模型加载问题,检查一下CUDA版本是否匹配显卡驱动。

-

进阶功能探索 对于想要深入使用的开发者,LM Studio支持模型微调功能。我在本地数据集上对模型进行了微调,效果提升很明显。文档交互功能也很强大,可以直接让模型总结PDF文件内容。

-

性能优化建议 如果发现生成速度慢,可以尝试调整上下文长度和批次大小参数。在任务管理器中监控显存使用情况,适当降低参数可以显著提升响应速度。

想快速体验类似功能的话,可以试试InsCode(快马)平台,它提供了更轻量级的在线体验方式,不用安装就能直接生成和运行AI项目。

实际使用中发现这个平台的一键部署特别方便,生成的项目可以直接在线运行,省去了配置环境的麻烦。对于想快速验证想法的开发者来说是个不错的选择。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)