推理成本降98%,准确率升13%!微软提出TwT:Thinking without Tokens

如今的大模型(如GPT-4o)越来越聪明,但“聪明”的背后是巨大的计算成本。比如,解答一道数学题时,模型会一步步写出推理过程,虽然答案更准,但生成的文字量暴涨,导致算力消耗和响应时间激增。:TwT请多位“老师模型”(如GPT-4、Mistral等)各自写答案,再用。:挑出老师们观点差异最大的答案,避免“标准答案”单一化(用余弦相似度对比)。:探索更多任务类型,研究隐式推理机制,让LLM真正“无师自

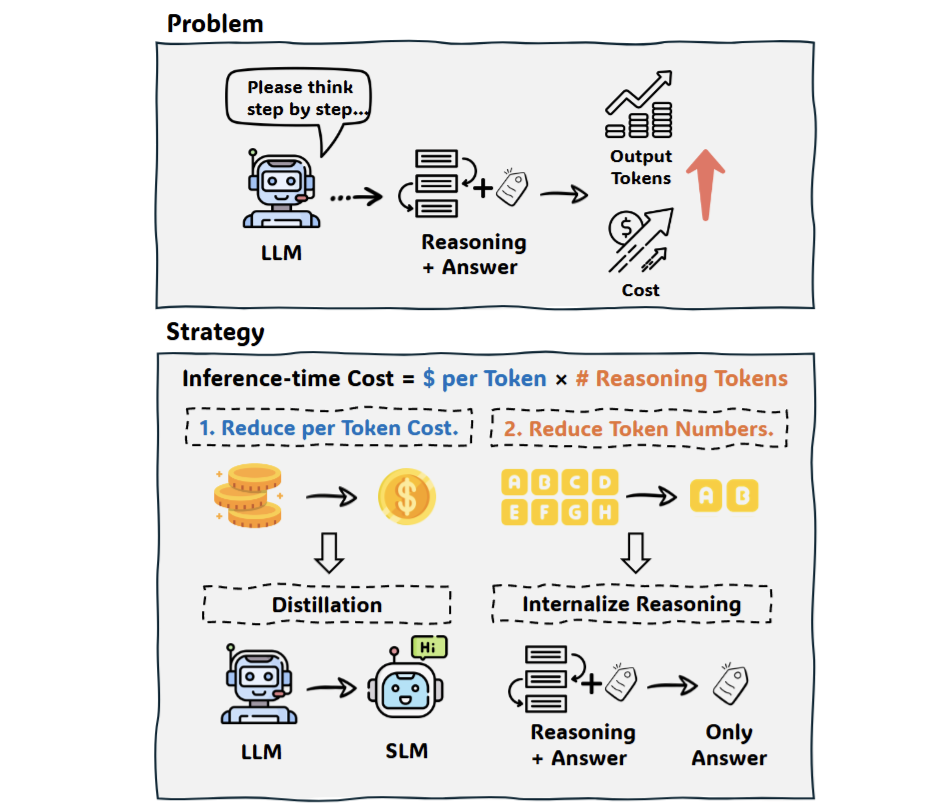

如今的大模型(如GPT-4o)越来越聪明,但“聪明”的背后是巨大的计算成本。比如,解答一道数学题时,模型会一步步写出推理过程,虽然答案更准,但生成的文字量暴涨,导致算力消耗和响应时间激增。这就像学生考试时写满草稿纸——虽然得分高,但太费时间!

论文:TwT: Thinking without Tokens by Habitual Reasoning Distillation with Multi-Teachers’ Guidance

链接:https://arxiv.org/pdf/2503.24198

TwT的核心理念:让LLM“少想多干”

微软团队提出的TwT(Thinking without Tokens),目标很直接:让LLM像学霸一样,不用写草稿也能直接答对题。实现这一目标靠两大绝招:

微软团队提出的TwT(Thinking without Tokens),目标很直接:让LLM像学霸一样,不用写草稿也能直接答对题。实现这一目标靠两大绝招:

绝招一:多教师筛选优质答案(DCRS策略)

-

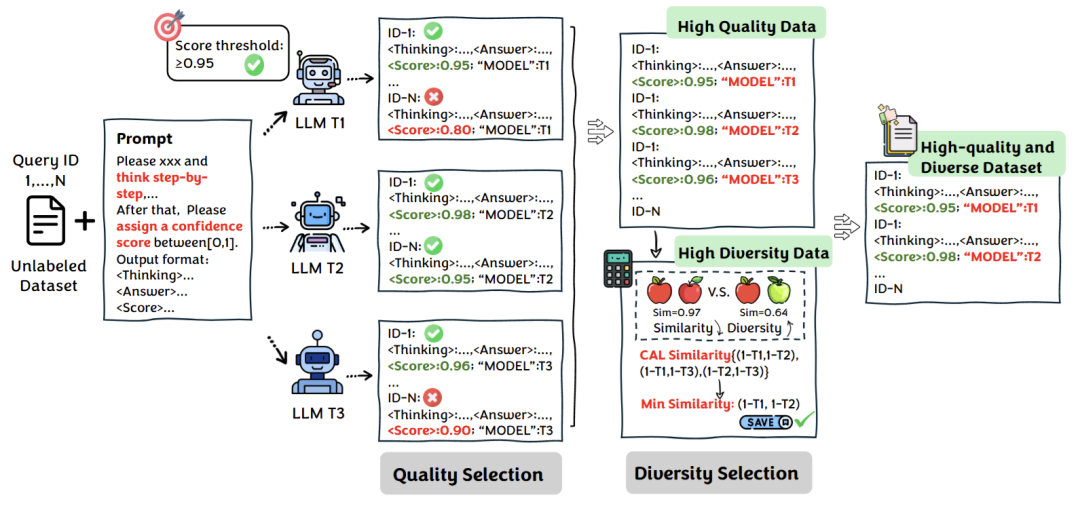

问题:传统蒸馏依赖单一老师的答案,容易片面;人工标注数据又贵又少。

-

解法:TwT请多位“老师模型”(如GPT-4、Mistral等)各自写答案,再用双标准筛选:

-

-

质量关:综合代码正确性、逻辑清晰度等指标打分,只留高分答案(公式: )。

-

多样性关:挑出老师们观点差异最大的答案,避免“标准答案”单一化(用余弦相似度对比)。

-

-

效果:既保质量,又增多样性,完美适配无监督场景!

绝招二:三步内化推理能力(HaRD方法)

-

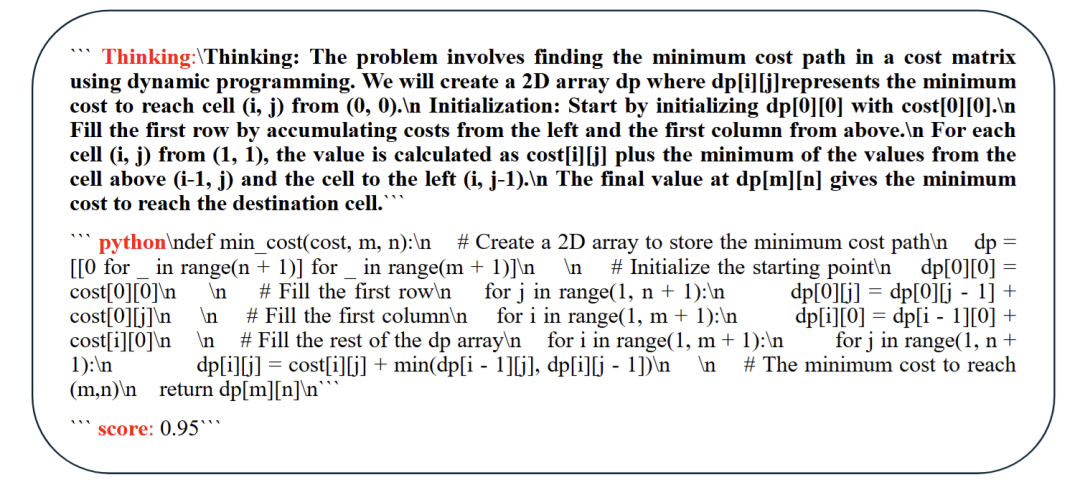

阶段1:学生模型先学老师的完整解题步骤(带详细草稿)。

-

阶段2:老师根据学生表现压缩推理步骤,比如原本10步的思考缩成5步。

-

阶段3:直接去掉推理步骤,只学题目和答案,训练学生“秒答”能力。

-

类比:就像学霸辅导学渣——先教详细解法,再简化步骤,最后训练条件反射!

实验结果:少花钱,多办事

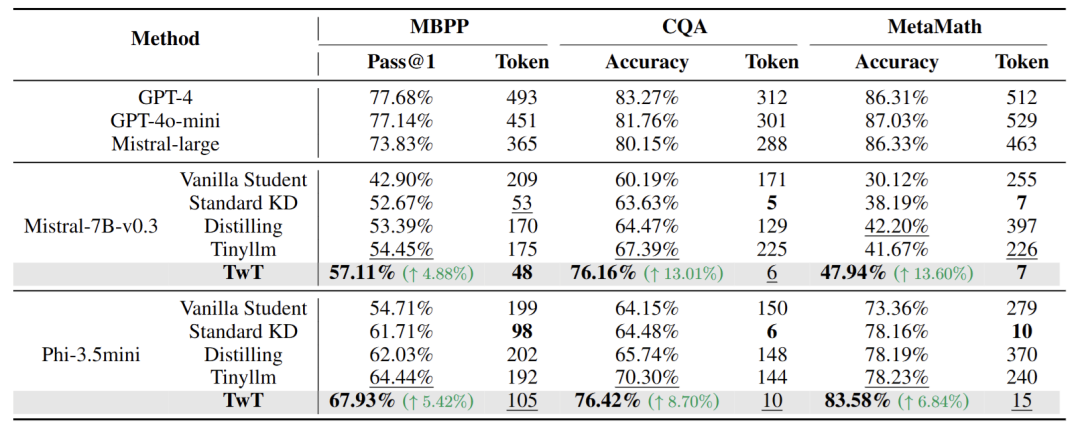

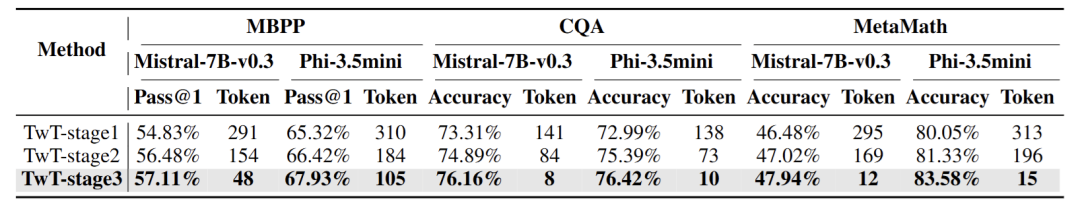

论文在代码生成(MBPP)、常识问答(CQA)、数学推理(MetaMath)三个任务中测试,结果惊人:

-

性能提升:相比传统蒸馏方法,TwT准确率最高提升13.6%。

-

成本暴降:生成答案的token数减少98%(比如数学题从397个token降到7个!)。

-

渐进式提升:三阶段训练中,模型准确率逐步上升,token数逐步下降。

有啥意义:低成本部署大模型的曙光

-

企业端:推理成本降低98%,意味着同样算力可服务更多用户。

-

用户端:响应速度更快,比如数学题从“等10秒”变成“秒出答案”。

-

环保意义:减少算力消耗=减少碳排放,AI也能更绿色!

不足与未来

-

局限:目前仅适用于特定任务(如代码、数学),混合任务表现待改进;筛选过程可能有噪声干扰。

-

未来方向:探索更多任务类型,研究隐式推理机制,让LLM真正“无师自通”。

确实test-time reasoning太长了,还是需要瘦身下,需要更多后续研究多多探讨下。

备注:昵称-学校/公司-方向/会议(eg.ACL),进入技术/投稿群

id:DLNLPer,记得备注呦

更多推荐

已为社区贡献53条内容

已为社区贡献53条内容

所有评论(0)