本地部署DeepSeek R1 保姆级攻略

本地部署就是自己本地电脑上部署DeepSeek-R1模型,使用本地的算力,可以不联网使用。

【软件名称】:Ollama + DeepSeek R1

【安装环境】:Windows/Mac

【下载链接】:使用文中链接

简介

![]()

DeepSeek以强大AI能力受瞩目,但官方平台常因访问压力出现服务中断。用户可通过本地部署DeepSeek R1构建自主智能体系,在终端设备实现数据闭环处理,本地部署就是自己本地电脑上部署DeepSeek-R1模型,使用本地的算力,可以不联网使用。

主要瓶颈:内存+显存的大小。

特点:此方案不用联网。

适合:有数据隐私方面担忧的或者保密单位根本就不能上网的。

安装步骤

![]()

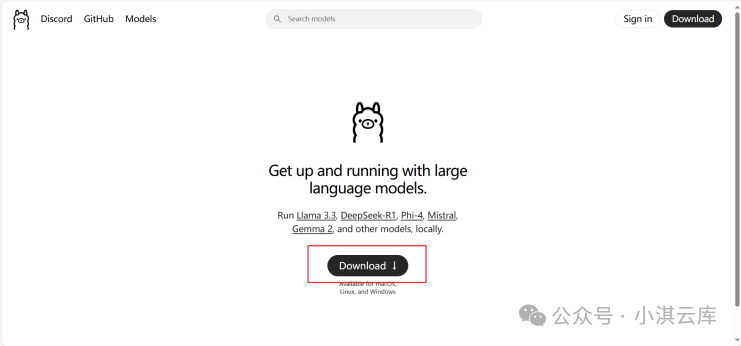

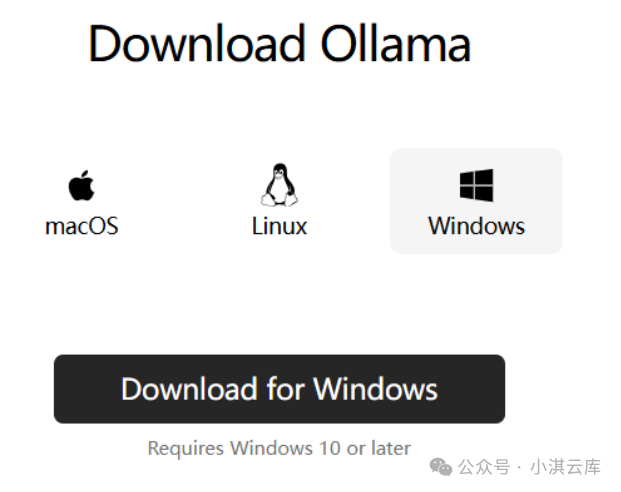

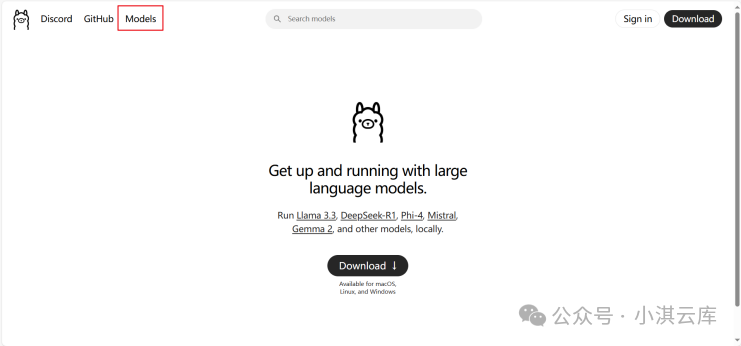

步骤1、下载Ollama :https://ollama.com/download

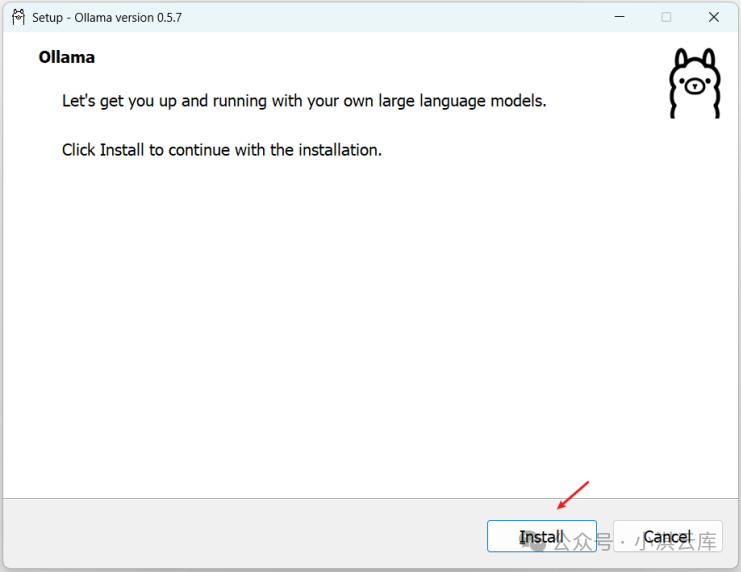

步骤2、安装ollama

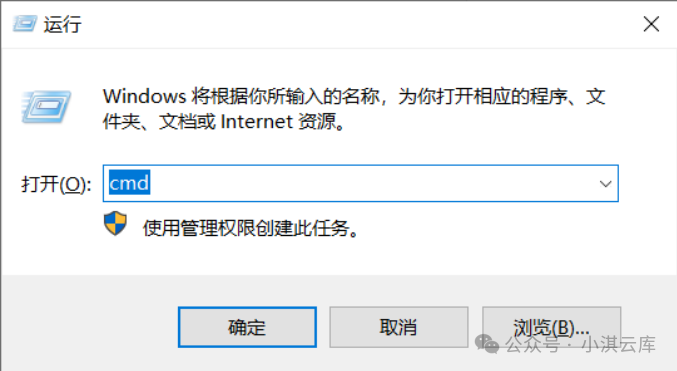

安装完后,验证是否安装成功:

“win+r”输入cmd

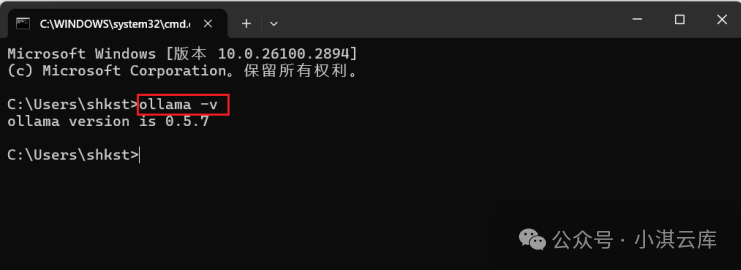

命令行输入ollama -v

能显示ollama版本说明安装成功。

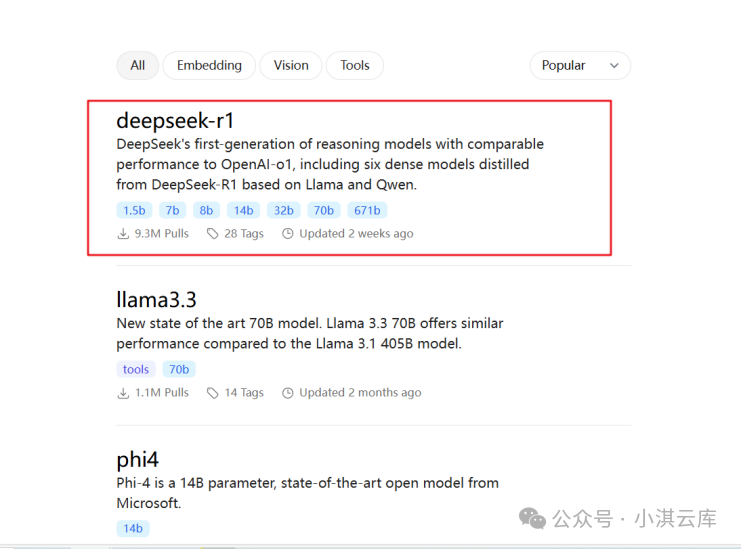

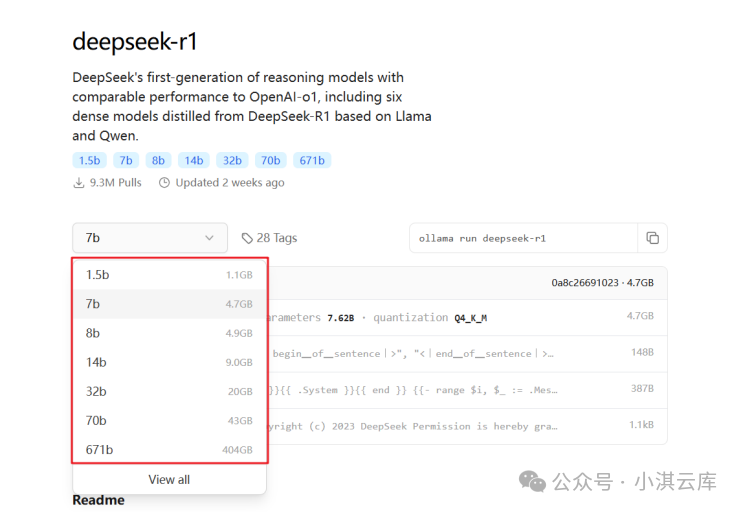

步骤3:选择r1模型, 支持的大模型还是非常多的,如下图

步骤4:选择版本

b代表10亿参数量,7b就是70亿参数量。这里的671B是

HuggingFace经过4-bit 标准量化的,所以大小是404GB。

ollama 支持 CPU 与 GPU 混合推理。将内存与显存之和大致视为系统的 “总内存空间”。

如果你想运行404GB的671B,建议你的内存+显存能达到500GB以上。

这里我们以7B为例,大多数的电脑都能够运行起来。

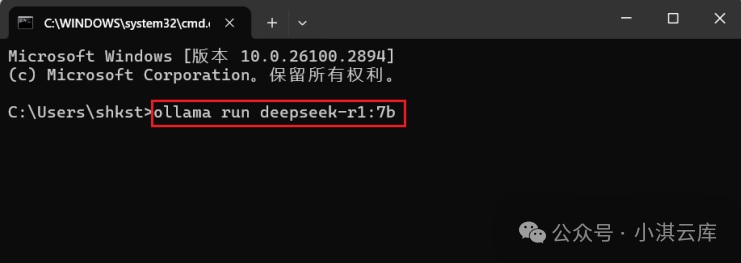

步骤5:本地运行DeepSeek模型

在命令行中,输入如下命令: ollama run deepseek-r1:7b

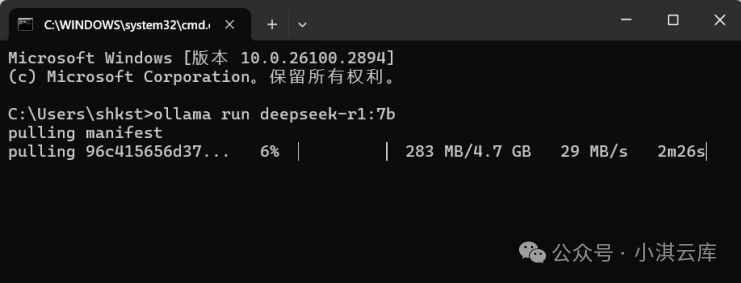

首次运行会下载对应模型文件:

下载支持断点续传,如果下载中速度变慢,可以鼠标点击命令行窗口,然后ctrl+c取消,取消后按方向键“上”,可以找到上一条命令,即”ollama run deepseek-r1:7b“,按下回车会重新链接,按照之前进度接着下载。

如果不想下载,也可以直接使用我们提供的下载好的模型文件,按照后续小节 “修改models文件夹路径” 的步骤配置好环境变量和对应models文件夹的路径即可。

模型下载地址:https://pan.quark.cn/s/62e338ec0ce6

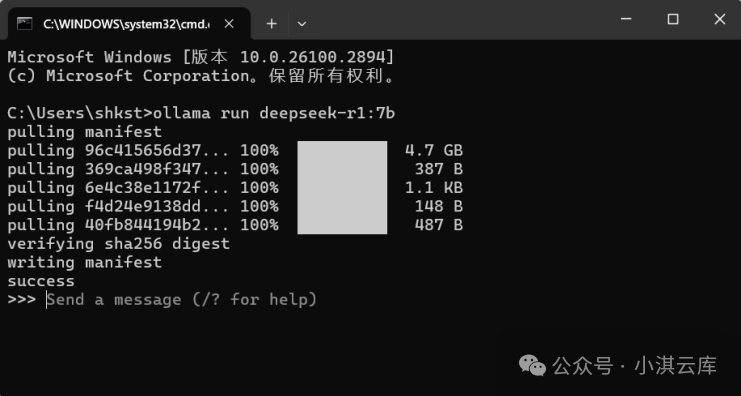

下载完成后,自动进入模型,直接在命令行输入问题,即可得到回复。

如果不用界面,到这里大家部署完成。本地部署好模型之后,在命令行操作还是不太方便,我们继续使用一些客户端工具Cherry Studio来使用。

Cherry Studio的下载地址:https://cherry-ai.com/

傻瓜式安装,这里省略。

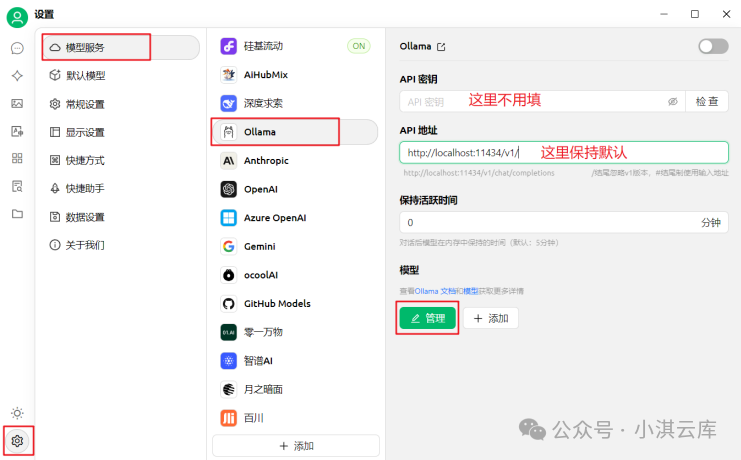

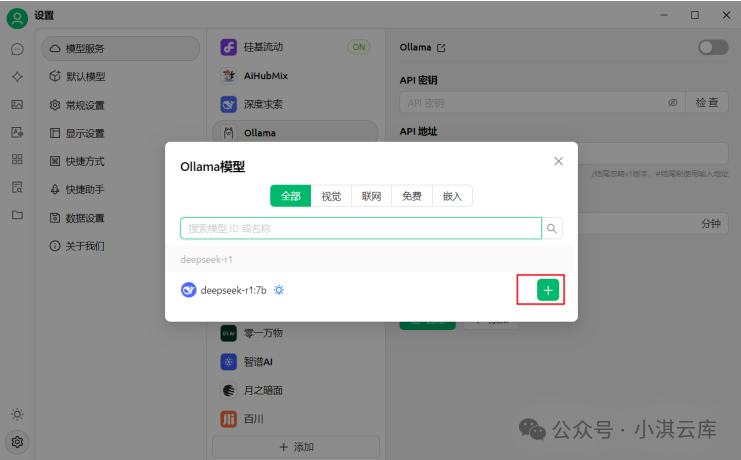

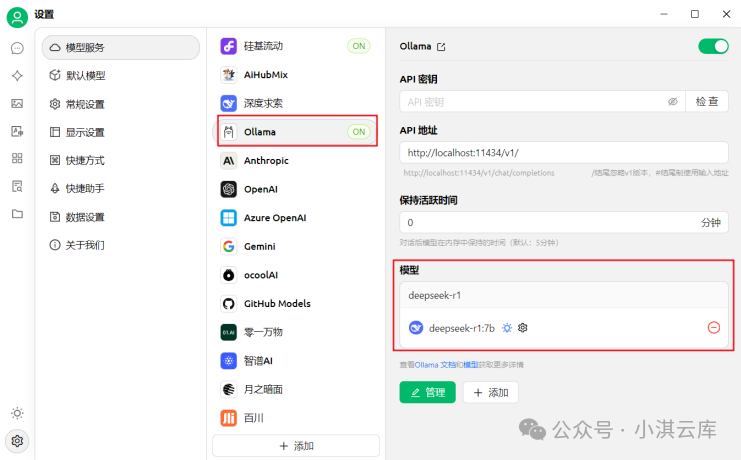

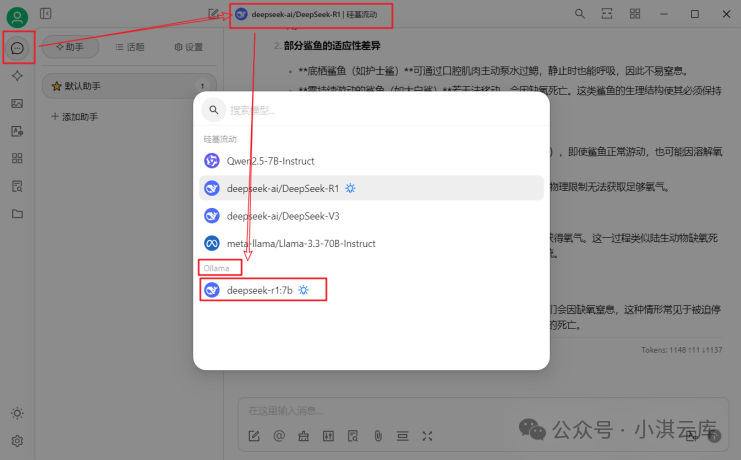

以Cherry Studio为例访问7b的蒸馏模型:

注意:使用时要确保ollama客户端已启动,看右下角托盘菜单栏图标

![]()

其它方式:服务器部署

在企业中,想要私有化部署满血版DeepSeek-R1,即671B版本,需要有更好的硬件配置。

服务器可以是物理机,也可以是云服务器。

使用Ollama提供的经过量化压缩的671B模型的大小是404GB,建议内存 + 显存 ≥ 500 GB,部署流程与个人电脑部署7B的流程没有太大区别,都是以下几个步骤:

1. 根据服务器的操作系统,下载对应版本的Ollama客户端;

2. 运行Ollama,执行 Ollama命令 运行 671B版本模型;首次执行自动下载模型;

3. 使用客户端工具/自己开发页面/代码调用,对接Ollama的R1模型;

飞书文档攻略库地址:Docs![]() https://ncncv6w4h3fq.feishu.cn/wiki/TdLlwY66YirLXbkDP7ocpSxTncc

https://ncncv6w4h3fq.feishu.cn/wiki/TdLlwY66YirLXbkDP7ocpSxTncc

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)