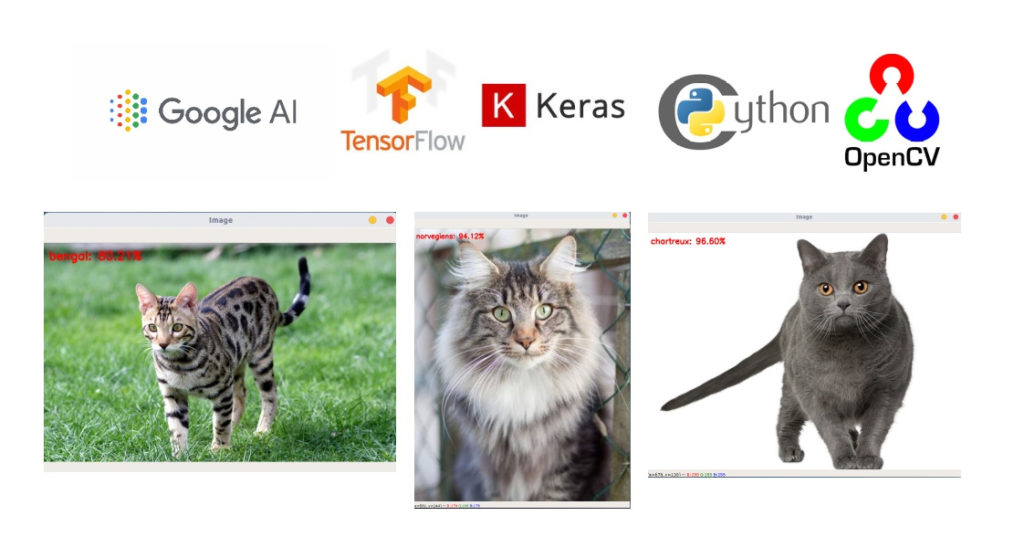

基于Python的猫狗识别深度学习实战项目

图像分类本质上是一个映射函数的学习过程:给定一幅二维像素矩阵 $ I \in \mathbb{R}^{H \times W \times C} $,其中 $ H $ 表示高度、$ W $ 宽度、$ C $ 为通道数(通常为3,对应RGB色彩空间),目标是输出一个类别标签 $ y \in {1, 2, …, K} $,表示该图像所属的预定义类别。对于猫狗识别任务而言,$ K = 2 $,即二分类问题

简介:该项目是一个使用Python编程语言实现的猫狗图像分类系统,核心采用卷积神经网络(CNN)等深度学习技术进行计算机视觉任务。项目包含完整的模型定义、数据预处理、训练流程与模型评估模块,涉及model.py、input_data.py、training.py和evaluateCatOrDog.py等关键文件,涵盖从图像读取、归一化、数据增强到模型训练与性能测试的全流程。适用于希望掌握图像分类实际开发的技术人员和学习者,是深度学习在计算机视觉领域应用的典型实践案例。

1. Python在深度学习中的应用

1.1 Python成为深度学习首选语言的核心原因

Python凭借其简洁直观的语法结构和高度可读性,极大降低了算法实现与模型调试的门槛。其核心优势在于强大的生态系统:TensorFlow、PyTorch等主流框架均以Python为首要接口语言,结合NumPy进行高效数值计算,Pandas用于数据清洗与分析,Matplotlib与Seaborn实现结果可视化,形成了从数据预处理到模型训练、评估的完整工具链。

import numpy as np

import tensorflow as tf

from matplotlib import pyplot as plt

上述代码仅需三行即可加载深度学习全流程所需基础库,体现了Python模块化设计的高效性。在猫狗分类任务中,开发者可通过高级API快速构建CNN模型,也可借助autograd机制自定义梯度计算,灵活支持研究创新与工程部署的双重需求。

2. 卷积神经网络(CNN)原理与实现

卷积神经网络(Convolutional Neural Network, CNN)作为深度学习中最具代表性的模型架构之一,广泛应用于图像识别、目标检测、语义分割等计算机视觉任务。其核心思想是通过局部感受野、权值共享和空间下采样机制,自动提取输入图像中的层次化特征表达。与传统全连接神经网络相比,CNN在处理高维图像数据时具有参数效率高、平移不变性强以及对局部结构敏感等优势。本章将系统性地剖析CNN的内部构造与运行机制,从基础组件到数学建模,再到反向传播与实际编程实现,层层递进地揭示其工作原理。

2.1 卷积神经网络的基本结构

卷积神经网络由多个层级模块构成,每一层承担不同的功能角色,协同完成从原始像素到高级语义信息的转换过程。典型的CNN结构通常包括卷积层、激活函数层、池化层和全连接层,这些组件按顺序堆叠形成端到端的可训练模型。理解各层的作用机制及其相互关系,是掌握CNN设计与优化的前提。

2.1.1 卷积层的工作机制与特征提取原理

卷积层是CNN的核心组成部分,负责执行卷积操作以提取图像中的局部特征。该操作本质上是一种滑动窗口式的线性滤波过程,其中一个小尺寸的权重矩阵(称为卷积核或滤波器)在输入图像上逐像素移动,并计算加权和输出响应值。

假设输入图像为一个二维灰度图 $ H \times W $,卷积核大小为 $ K \times K $,则每个位置 $(i,j)$ 的输出可表示为:

(I * K)(i,j) = \sum_{m=0}^{K-1} \sum_{n=0}^{K-1} I(i+m, j+n) \cdot K(m,n)

该公式描述了离散二维卷积的数学形式。通过调整卷积核的权重,网络可以学习检测边缘、角点、纹理等低级视觉模式;深层卷积层则能组合这些基础特征,形成更复杂的语义结构,如眼睛、耳朵甚至整只动物。

为了提升表达能力,现代CNN普遍采用多通道输入与多滤波器并行处理策略。例如,在RGB彩色图像中,输入具有三个通道(红、绿、蓝),每个卷积核也相应扩展为三维张量 $ K \times K \times C_{in} $,其中 $ C_{in} $ 为输入通道数。经过卷积后,生成若干个输出特征图(feature maps),数量等于所使用的滤波器个数 $ C_{out} $。

此外,卷积操作还支持步长(stride)和填充(padding)参数调节:

- 步长 控制卷积核每次移动的像素数,增大步长可减小输出尺寸;

- 填充 在输入边界补零,用于保持空间分辨率不随层数增加而急剧缩小。

| 参数 | 描述 | 示例 |

|---|---|---|

| 输入尺寸 $ H \times W \times C_{in} $ | 原始图像的空间维度与通道数 | $ 224 \times 224 \times 3 $ |

| 卷积核大小 $ K \times K $ | 滤波器的空间尺寸 | $ 3 \times 3 $ |

| 输出通道数 $ C_{out} $ | 使用的滤波器数量 | 64 |

| 步长 $ S $ | 滑动间隔 | 1 或 2 |

| 填充 $ P $ | 边缘补零层数 | ‘same’ 表示保持尺寸 |

以下代码展示了使用NumPy手动实现单通道卷积的过程:

import numpy as np

def conv2d_simple(input_img, kernel, stride=1, padding=0):

# 添加零填充

if padding > 0:

input_padded = np.pad(input_img, padding, mode='constant')

else:

input_padded = input_img

# 获取尺寸

H, W = input_padded.shape

Kh, Kw = kernel.shape

Oh = (H - Kh) // stride + 1

Ow = (W - Kw) // stride + 1

# 初始化输出

output = np.zeros((Oh, Ow))

# 执行卷积

for i in range(0, Oh * stride, stride):

for j in range(0, Ow * stride, stride):

region = input_padded[i:i+Kh, j:j+Kw]

output[i//stride, j//stride] = np.sum(region * kernel)

return output

# 示例调用

img = np.random.rand(5, 5) # 模拟输入图像

kernel = np.array([[1, 0], [0, -1]]) # 边缘检测核

result = conv2d_simple(img, kernel, stride=1, padding=1)

逻辑分析与参数说明 :

-input_img:输入二维数组,代表灰度图像。

-kernel:卷积核,此处模拟一个简单的对角边缘检测器。

-stride设置为1,确保无跳跃扫描;padding=1在四周补一圈0,防止尺寸缩减过快。

- 循环遍历所有可能的位置,提取对应区域并与核做逐元素乘积求和。

- 输出结果反映原图中哪些区域匹配该滤波器响应最强。

此实现虽未利用向量化加速,但清晰揭示了卷积运算的本质——局部加权叠加。实际框架如TensorFlow和PyTorch均基于高度优化的C++内核实现此类操作,支持GPU加速与自动微分。

2.1.2 激活函数的作用与常用类型(ReLU、Sigmoid等)

卷积操作本身是线性的,若整个网络仅由卷积和全连接组成,则整体仍为线性变换,无法拟合复杂非线性映射。因此,必须在每层之后引入非线性激活函数,赋予模型逼近任意函数的能力。

常见的激活函数包括:

| 函数名称 | 公式 | 特点 | 缺陷 |

|---|---|---|---|

| ReLU | $ f(x)=\max(0,x) $ | 计算简单、缓解梯度消失 | 存在“死亡神经元”问题 |

| Sigmoid | $ f(x)=\frac{1}{1+e^{-x}} $ | 输出范围(0,1),适合概率解释 | 饱和区梯度趋近于0 |

| Tanh | $ f(x)=\tanh(x) $ | 输出对称于0,均值接近0 | 同样存在饱和问题 |

| Leaky ReLU | $ f(x)=\begin{cases}x & x\geq0 \ \alpha x & x<0\end{cases} $ | 负区间保留小斜率 | 可缓解死亡问题 |

目前, ReLU 已成为CNN中最主流的选择,因其在正区间导数恒为1,极大缓解了深层网络中的梯度消失问题。其导数如下:

f’(x) =

\begin{cases}

1 & x > 0 \

0 & x \leq 0

\end{cases}

这使得误差信号在反向传播过程中能够顺畅传递,尤其适用于深层结构。

下面展示ReLU的Python实现及可视化效果:

import matplotlib.pyplot as plt

def relu(x):

return np.maximum(0, x)

def relu_derivative(x):

return (x > 0).astype(float)

# 可视化

x = np.linspace(-5, 5, 100)

y = relu(x)

dy = relu_derivative(x)

plt.figure(figsize=(10, 4))

plt.subplot(1, 2, 1)

plt.plot(x, y, label="ReLU")

plt.title("ReLU Function")

plt.grid(True); plt.legend()

plt.subplot(1, 2, 2)

plt.plot(x, dy, label="Derivative", color='r')

plt.title("ReLU Derivative")

plt.grid(True); plt.legend()

plt.tight_layout()

plt.show()

逻辑分析与参数说明 :

-np.maximum(0, x)实现逐元素比较,返回非负部分。

- 导数函数使用布尔索引(x > 0)判断正值区域,并强制转为浮点型。

- 图形显示ReLU在 $ x>0 $ 时斜率为1,利于梯度流动;但在 $ x<0 $ 时完全关闭,可能导致某些神经元永久失活。

为解决这一问题,Leaky ReLU引入了一个小的负斜率 $\alpha$(如0.01),使负值区域仍有微弱响应,从而提升训练稳定性。实践中可根据任务需求灵活选择激活函数类型。

2.1.3 池化层的功能及其对空间降维的影响

池化层(Pooling Layer)位于卷积层之后,主要用于降低特征图的空间分辨率,减少后续层的计算负担,同时增强模型对微小位移、旋转和平移的鲁棒性。最常见的池化方式是最大池化(Max Pooling)和平均池化(Average Pooling)。

以 $ 2\times2 $ 窗口、步长为2的最大池化为例,其操作流程如下:

graph TD

A[输入特征图 4x4] --> B[划分2x2区域]

B --> C[取每块最大值]

C --> D[输出2x2降维图]

具体实现代码如下:

def max_pool_2x2(feature_map, stride=2, pool_size=2):

H, W = feature_map.shape

Oh = (H - pool_size) // stride + 1

Ow = (W - pool_size) // stride + 1

output = np.zeros((Oh, Ow))

for i in range(Oh):

for j in range(Ow):

region = feature_map[i*stride:i*stride+pool_size,

j*stride:j*stride+pool_size]

output[i, j] = np.max(region)

return output

# 示例

fm = np.arange(16).reshape(4,4)

pooled = max_pool_2x2(fm)

print("Pooled Output:\n", pooled)

输出:

Pooled Output:

[[ 5. 7.]

[13. 15.]]

逻辑分析与参数说明 :

- 输入为 $ 4\times4 $ 特征图,划分为四个 $ 2\times2 $ 区域。

- 每个区域内取最大值,如左上角[0,1;4,5]中最大为5。

- 结果为 $ 2\times2 $ 的压缩图,有效减少75%的空间信息。

池化操作不具备可学习参数,属于固定规则的下采样。尽管近年来部分先进架构(如ResNet)开始采用步幅卷积替代池化,但在轻量级模型中仍广泛使用。

2.1.4 全连接层在分类决策中的角色定位

在网络末端,经过多次卷积与池化后的特征图已被抽象为紧凑的高层语义表示。此时需将其展平并通过全连接层(Fully Connected Layer)进行最终分类决策。

全连接层的每个神经元与前一层所有神经元相连,执行如下变换:

\mathbf{y} = \sigma(\mathbf{W}\mathbf{x} + \mathbf{b})

其中 $\mathbf{x}$ 为展平后的特征向量,$\mathbf{W}$ 为权重矩阵,$\mathbf{b}$ 为偏置项,$\sigma$ 为激活函数(常为Softmax用于多类分类)。

例如,在猫狗二分类任务中,最后一层输出两个节点,经Softmax归一化后得到属于“猫”或“狗”的概率分布。

from scipy.special import softmax

def fully_connected_layer(flat_features, weights, bias):

logits = np.dot(weights, flat_features) + bias

probs = softmax(logits)

return probs

# 模拟输入

features = np.random.rand(128) # 展平后特征

W = np.random.rand(2, 128) # 输出两类

b = np.zeros(2)

pred = fully_connected_layer(features, W, b)

print("Predicted probabilities:", pred)

逻辑分析与参数说明 :

-flat_features来自最后一个池化层的展平输出。

-weights维度为 $ C_{out} \times D $,$ D $ 是输入特征维数。

- Softmax确保输出和为1,便于解释为类别概率。

- 该层参数量大,易导致过拟合,常配合Dropout正则化使用。

综上所述,CNN通过层级结构逐步抽象图像内容:卷积提取局部特征,激活引入非线性,池化压缩空间信息,全连接整合全局上下文并输出预测结果。

3. 猫狗图像分类任务详解

在深度学习的实际落地过程中,图像分类是最早被广泛应用且最具代表性的任务之一。其中,“猫狗识别”作为二分类问题的典型示例,不仅广泛用于教学演示和算法验证,也常作为工业界视觉系统开发中的基准测试任务。该任务要求模型能够从自然场景中准确判断一张输入图像属于“猫”或“狗”,看似简单,实则涉及大量复杂的技术挑战。本章将围绕这一具体应用场景展开深入剖析,从形式化建模、数据特性分析到现实部署中的难点与应对策略,层层递进地揭示一个完整图像分类项目背后的设计逻辑和技术细节。

通过系统性地拆解猫狗识别任务的各个环节,不仅能加深对卷积神经网络实际应用的理解,也为后续章节中代码实现(如 input_data.py 和 model.py )提供坚实的理论支撑与设计依据。尤其值得注意的是,在真实环境中,图像并非理想化的干净样本集合,而是充斥着噪声、遮挡、光照变化等干扰因素。因此,如何在有限资源下构建鲁棒性强、泛化能力高的模型,成为贯穿整个项目生命周期的核心命题。

此外,随着深度学习框架日益成熟,单纯关注模型结构已不足以保证项目的成功。现代AI工程更强调端到端系统的可维护性、模块化程度以及跨平台兼容性。因此,本章还将探讨如何从业务需求出发进行功能分解,并设计合理的系统架构以支持高效迭代与部署。这种由问题驱动、自顶向下的分析方法,有助于培养工程师级的系统思维,而不仅仅是调参式的模型训练。

3.1 图像分类问题的形式化定义

图像分类本质上是一个映射函数的学习过程:给定一幅二维像素矩阵 $ I \in \mathbb{R}^{H \times W \times C} $,其中 $ H $ 表示高度、$ W $ 宽度、$ C $ 为通道数(通常为3,对应RGB色彩空间),目标是输出一个类别标签 $ y \in {1, 2, …, K} $,表示该图像所属的预定义类别。对于猫狗识别任务而言,$ K = 2 $,即二分类问题。尽管其数学表达简洁,但实现这一映射需要解决多个关键子问题——包括输入表示的标准化、输出编码方式的选择,以及多类与二分类之间的建模范式差异。

3.1.1 输入输出结构的设计规范

在构建任何深度学习模型之前,必须明确输入与输出的数据格式。对于图像数据,常见的输入张量形状为 (batch_size, height, width, channels) ,例如使用尺寸为 $224 \times 224$ 的彩色图像时,单个样本的输入维度为 $(224, 224, 3)$。批处理机制允许同时处理多个样本,从而提升GPU利用率并稳定梯度更新方向。

输出层的设计则取决于任务类型。在猫狗识别中,由于只有两个类别,可以采用单一神经元配合Sigmoid激活函数,输出值介于0到1之间,代表“狗”的概率;也可以使用两个神经元配合Softmax函数,分别表示“猫”和“狗”的概率分布。后者虽然参数稍多,但在语义解释性和损失函数计算上更具一致性。

为了确保模型训练的有效性,所有输入图像应经过统一预处理流程,包括缩放至固定尺寸、归一化像素值(如除以255)、减去均值等操作。这些步骤不仅有助于加速收敛,还能减少因尺度差异带来的优化困难。

| 预处理操作 | 目的 | 典型参数 |

|---|---|---|

| 尺寸调整(Resize) | 统一输入维度 | $224 \times 224$ |

| 像素归一化 | 缩小数值范围 | /255 |

| 均值标准化 | 消除光照偏移 | ImageNet均值 |

| 数据增强 | 提高泛化能力 | 随机翻转、旋转 |

import tensorflow as tf

def preprocess_image(image_path, img_size=(224, 224)):

image = tf.io.read_file(image_path)

image = tf.image.decode_image(image, channels=3)

image = tf.image.resize(image, img_size)

image = tf.cast(image, tf.float32) / 255.0 # 归一化到[0,1]

return image

代码逻辑逐行解析:

- 第1行导入TensorFlow库,用于图像加载与变换;

- 第3~4行读取图像文件并解码为张量,强制保持三通道;

- 第5行将图像调整为目标尺寸,适应CNN输入要求;

- 第6行转换数据类型并进行归一化处理,避免梯度爆炸。

该函数构成了后续数据流水线的基础组件,体现了输入结构设计的标准化原则。

3.1.2 类别标签编码方式(One-Hot与整数编码)

标签编码直接影响损失函数的选择与反向传播过程。在猫狗识别中,若原始标签为字符串 "cat" 和 "dog" ,需先转换为数值形式。常用方法有两种:

- 整数编码(Integer Encoding) :将类别映射为连续整数,如

cat → 0,dog → 1。适用于Sparse Categorical Crossentropy损失函数,节省内存。 - 独热编码(One-Hot Encoding) :将类别转化为二进制向量,如

cat → [1, 0],dog → [0, 1]。适用于标准Categorical Crossentropy,便于概率分布比较。

from sklearn.preprocessing import LabelEncoder

import numpy as np

labels_str = ['cat', 'dog', 'cat', 'dog']

le = LabelEncoder()

integer_labels = le.fit_transform(labels_str)

onehot_labels = tf.keras.utils.to_categorical(integer_labels, num_classes=2)

print("原始标签:", labels_str)

print("整数编码:", integer_labels)

print("One-Hot编码:\n", onehot_labels)

输出示例:

原始标签: ['cat', 'dog', 'cat', 'dog']

整数编码: [0 1 0 1]

One-Hot编码:

[[1. 0.]

[0. 1.]

[1. 0.]

[0. 1.]]

参数说明:

LabelEncoder()自动学习类别到整数的映射关系;to_categorical()将整数数组转换为二维One-Hot矩阵;num_classes=2明确指定类别总数,防止维度错误。

选择何种编码方式需结合模型输出层设计。若使用Sigmoid+单神经元,则搭配整数标签和Binary Crossentropy更合适;若使用Softmax+双神经元,则推荐One-Hot编码。

3.1.3 多类分类与二分类任务的区别与联系

虽然猫狗识别属于二分类任务,但其技术路径与多类分类高度一致。二者主要区别体现在以下几个方面:

| 特征 | 二分类 | 多类分类 |

|---|---|---|

| 输出层神经元数量 | 1 或 2 | ≥3 |

| 激活函数 | Sigmoid / Softmax | Softmax |

| 损失函数 | Binary / Sparse Categorical CE | Categorical CE |

| 标签形式 | 整数或One-Hot | One-Hot为主 |

| 决策边界复杂度 | 较低 | 较高 |

尽管如此,两者共享相同的底层机制:都是通过softmax或sigmoid函数生成类别概率,再基于最大概率做出预测。事实上,二分类可视作多类分类的特例,这使得许多训练技巧(如学习率调度、早停机制)具有通用性。

更重要的是,评估指标的设计也需要区分对待。例如,F1-score在类别不平衡时比准确率更有意义,而混淆矩阵能清晰展示各类别的误判情况。在后续章节中将进一步展开此类分析。

graph TD

A[输入图像] --> B{是否包含猫?}

B -- 是 --> C[输出: cat]

B -- 否 --> D[输出: dog]

style B fill:#f9f,stroke:#333

style C fill:#bbf,stroke:#333,color:white

style D fill:#fbb,stroke:#333,color:white

上述流程图展示了典型的二分类推理流程。无论内部模型多么复杂,最终决策路径始终遵循这一基本逻辑。这也提示我们在系统设计中应保持接口简洁,隐藏复杂的实现细节。

3.2 猫狗识别任务的数据特性分析

高质量的数据是深度学习成功的基石。即便拥有最先进的模型架构,若训练数据存在严重偏差或噪声,模型性能仍将大打折扣。猫狗图像数据集虽来源丰富(如Kaggle Dogs vs Cats、Oxford-IIIT Pet Dataset等),但仍普遍存在若干影响模型表现的关键问题:图像分辨率不一、色彩空间差异、类别分布失衡及样本质量参差。唯有深入理解这些数据特性,才能制定有效的预处理与增强策略。

3.2.1 图像尺寸、色彩空间与分辨率的影响

原始图像往往具有不同的尺寸与分辨率,直接送入CNN会导致批处理失败或填充引入伪影。例如,某些图像可能为 $640\times480$,而另一些仅为 $128\times128$。为此,必须统一尺寸。常见做法是双线性插值缩放至固定大小(如 $224\times224$),但也需注意过度压缩可能导致细节丢失。

色彩空间方面,绝大多数模型期望RGB输入,但部分图像可能以灰度或BGR格式存储(如OpenCV默认)。因此,在预处理阶段需确认通道顺序正确,并根据需要扩展通道维度。

import cv2

import numpy as np

def load_and_standardize(image_path, target_size=(224, 224)):

img = cv2.imread(image_path) # 默认BGR

img_rgb = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

resized = cv2.resize(img_rgb, target_size, interpolation=cv2.INTER_AREA)

normalized = resized.astype(np.float32) / 255.0

return normalized

逻辑分析:

cv2.imread加载图像为BGR格式;cv2.cvtColor转换为RGB,符合大多数深度学习框架预期;cv2.resize使用面积插值法保留纹理信息;- 最后归一化至浮点区间 $[0,1]$,适配梯度计算。

该函数可集成进数据生成器,实现高效的在线预处理。

3.2.2 数据分布不均问题与类别平衡策略

理想情况下,正负样本数量应大致相等。然而现实中,“狗”的图像可能远多于“猫”,导致模型偏向多数类。这种现象称为类别不平衡(Class Imbalance),会显著降低少数类的召回率。

解决方案包括:

- 重采样(Resampling) :对少数类过采样(复制或生成新样本),或对多数类欠采样;

- 加权损失函数(Weighted Loss) :在损失计算中赋予少数类更高权重;

- 分层抽样(Stratified Sampling) :划分训练/验证集时保持比例一致。

from sklearn.utils.class_weight import compute_class_weight

y_train = np.array([0, 1, 1, 1, 0, 1]) # 0:cat, 1:dog

classes = np.unique(y_train)

weights = compute_class_weight('balanced', classes=classes, y=y_train)

class_weight_dict = dict(zip(classes, weights))

print("类别权重:", class_weight_dict)

# 输出示例: {0: 1.5, 1: 0.75}

参数说明:

'balanced'策略自动根据类别频率分配权重;- 权重与频次成反比,确保稀有类别获得更强梯度信号;

- 可传入

model.fit(class_weight=...)实现加权训练。

3.2.3 样本噪声与异常图像的识别与清洗方法

数据集中常混杂模糊、截断或非目标对象的图像(如人抱着猫的照片)。这类噪声会影响特征学习。可通过以下手段检测与剔除:

- 自动化过滤 :使用预训练模型(如InceptionV3)提取特征,聚类发现离群点;

- 人工审核 :建立轻量标注界面,由专家复核可疑样本;

- 置信度过滤 :在初步训练后,筛选模型预测低置信度的样本进行复查。

flowchart LR

A[原始数据集] --> B[自动预处理]

B --> C[初步训练模型]

C --> D[预测置信度分析]

D --> E{低置信度?}

E -- 是 --> F[人工复查]

E -- 否 --> G[加入训练集]

F --> H{有效样本?}

H -- 是 --> G

H -- 否 --> I[移除]

此闭环清洗流程可在多轮迭代中不断提升数据质量,是工业级项目的重要实践。

3.3 实际应用场景中的挑战与解决方案

3.3.1 背景干扰与目标遮挡的应对策略

真实场景中,动物常处于复杂背景中,甚至被部分遮挡。传统方法依赖手工特征(如HOG+SVM),难以应对此类变化。而深度学习通过层次化特征提取,具备一定抗干扰能力。

增强策略包括:

- 随机擦除(Random Erasing) :训练时随机覆盖局部区域,迫使模型关注整体结构;

- 注意力机制 :引入SE模块或CBAM,让网络自主聚焦关键区域;

- 多尺度训练 :在不同分辨率下训练,提高对局部缺失的容忍度。

3.3.2 光照变化与姿态多样性带来的泛化难题

光照强度、角度及拍摄姿态极大影响像素分布。解决方案:

- 颜色抖动(Color Jittering) :随机调整亮度、对比度、饱和度;

- 仿射变换(Affine Transformation) :模拟视角变化;

- 风格迁移预训练 :使用Stylized-ImageNet预训练,提升风格不变性。

3.3.3 小样本条件下模型过拟合的缓解手段

当每类仅有数百张图像时,极易过拟合。应对措施:

- 迁移学习 :加载ImageNet预训练权重,冻结浅层微调深层;

- Dropout与正则化 :在全连接层添加Dropout(如rate=0.5);

- 早停机制 :监控验证损失,防止训练过度。

model.add(tf.keras.layers.Dropout(0.5))

3.4 项目需求分解与系统功能设计

3.4.1 功能模块划分:数据预处理、模型训练、评估预测

采用模块化设计,划分为:

- input_data.py :负责数据加载与增强;

- model.py :定义网络结构;

- training.py :执行训练循环;

- evaluateCatOrDog.py :加载模型并测试。

3.4.2 文件组织结构规划与代码可维护性考量

建议目录结构:

project/

├── data/

├── models/

├── src/

│ ├── input_data.py

│ ├── model.py

│ └── training.py

└── configs/

3.4.3 接口设计原则与跨模块调用机制

各模块通过函数接口通信,如:

# training.py

from model import build_cnn

from input_data import get_dataloader

train_loader = get_dataloader('train')

model = build_cnn()

model.compile(optimizer='adam', loss='binary_crossentropy')

model.fit(train_loader, epochs=10)

确保松耦合、高内聚,利于团队协作与持续集成。

4. 模型定义与架构设计(model.py)

在深度学习项目中, model.py 文件是整个系统的核心模块之一。它不仅承载着神经网络结构的定义,还负责模型参数配置、前向传播逻辑以及后续训练与推理过程中的可扩展性支持。一个设计良好的 model.py 能够显著提升代码的可维护性、复用性和跨平台部署能力。本章将围绕猫狗图像分类任务的实际需求,深入剖析 model.py 的职责边界、经典卷积神经网络(CNN)架构的选择依据,并通过 TensorFlow/Keras 框架实现完整的模型构建流程。

4.1 model.py文件的职责与作用范围

4.1.1 模型类封装与可复用性设计

在现代深度学习工程实践中, model.py 不应只是一个包含模型创建函数的脚本文件,而应具备清晰的模块化结构和面向对象的设计理念。其核心职责包括:

- 定义网络结构 :明确每一层的类型、输入输出维度、激活函数等。

- 封装模型构建逻辑 :提供可调用的接口用于实例化不同复杂度的模型。

- 支持灵活配置 :允许外部传入超参数(如卷积核数量、层数、dropout率等),以适应不同场景下的性能与资源平衡。

- 保证可复用性 :确保该文件可在训练、评估、预测等多个阶段被统一调用,避免重复代码。

为实现上述目标,推荐采用类封装方式组织模型代码。以下是一个基于 Keras 的标准模型类模板:

import tensorflow as tf

from tensorflow.keras import layers, Model, Sequential

class DogCatClassifier:

def __init__(self, input_shape=(224, 224, 3), num_classes=2, dropout_rate=0.5):

self.input_shape = input_shape

self.num_classes = num_classes

self.dropout_rate = dropout_rate

self.model = None

self._build_model()

def _build_model(self):

inputs = layers.Input(shape=self.input_shape)

# 卷积块1

x = layers.Conv2D(32, (3, 3), activation='relu')(inputs)

x = layers.MaxPooling2D((2, 2))(x)

# 卷积块2

x = layers.Conv2D(64, (3, 3), activation='relu')(x)

x = layers.MaxPooling2D((2, 2))(x)

# 卷积块3

x = layers.Conv2D(128, (3, 3), activation='relu')(x)

x = layers.MaxPooling2D((2, 2))(x)

# 全局平均池化减少全连接层参数

x = layers.GlobalAveragePooling2D()(x)

# 分类头

x = layers.Dropout(self.dropout_rate)(x)

x = layers.Dense(512, activation='relu')(x)

outputs = layers.Dense(self.num_classes, activation='softmax')(x)

self.model = Model(inputs=inputs, outputs=outputs)

def get_model(self):

return self.model

代码逻辑逐行解读分析

| 行号 | 代码片段 | 参数说明与逻辑分析 |

|---|---|---|

| 1–7 | 导入库 | 使用 tensorflow.keras.layers 构建网络层; Model 支持函数式API; Sequential 可选但此处使用更灵活的方式。 |

| 9–14 | 类初始化方法 | 接收 input_shape (默认224×224×3)、类别数 num_classes=2 和 dropout_rate 控制过拟合。 |

| 15–16 | 初始化属性 | self.model 存储最终模型对象,初始为空; _build_model() 触发内部构建流程。 |

| 18–36 | _build_model 方法 |

使用函数式API构建端到端模型: • Input 定义输入张量 • 多个 Conv2D + MaxPooling2D 实现特征提取 • GlobalAveragePooling2D 替代传统Flatten,降低参数量 • Dropout 防止过拟合 • 最后一层 Dense 输出 softmax 概率分布。 |

| 38–40 | 获取模型接口 | 提供公共方法返回已构建的 Model 对象,便于外部调用。 |

该设计的优势在于高度解耦:用户只需实例化 DogCatClassifier 并传递必要参数即可获得完整模型,无需关心底层细节。同时,若需扩展至多任务分类或添加注意力机制,仅需修改 _build_model 内部逻辑,不影响主程序流程。

此外,这种封装模式天然支持 继承与多态 。例如,可以派生出 LightweightDogCatClassifier 或 AdvancedResNetBasedClassifier ,从而在同一项目中管理多种模型变体。

4.1.2 网络参数配置的灵活性与扩展性

为了增强 model.py 的通用性,必须考虑如何从外部控制模型结构的关键参数。硬编码层数、滤波器数量或固定尺寸会严重限制模型的适配能力。因此,引入 配置字典(config dict) 是一种常见且高效的做法。

示例:基于配置文件的动态模型构建

CONFIG = {

"conv_blocks": [

{"filters": 32, "kernel_size": (3, 3), "pooling": True},

{"filters": 64, "kernel_size": (3, 3), "pooling": True},

{"filters": 128, "kernel_size": (3, 3), "pooling": True}

],

"dense_units": [512],

"dropout_rate": 0.5,

"use_global_avg_pooling": True

}

结合此配置,重构 _build_model 方法如下:

def _build_model_from_config(self, config):

inputs = layers.Input(shape=self.input_shape)

x = inputs

# 动态构建卷积块

for block in config["conv_blocks"]:

x = layers.Conv2D(

filters=block["filters"],

kernel_size=block["kernel_size"],

activation='relu',

padding='same'

)(x)

if block.get("pooling"):

x = layers.MaxPooling2D((2, 2))(x)

# 根据配置选择池化方式

if config["use_global_avg_pooling"]:

x = layers.GlobalAveragePooling2D()(x)

else:

x = layers.Flatten()(x)

# 构建全连接层

for units in config["dense_units"]:

x = layers.Dense(units, activation='relu')(x)

x = layers.Dropout(config["dropout_rate"])(x)

outputs = layers.Dense(self.num_classes, activation='softmax')(x)

self.model = Model(inputs=inputs, outputs=outputs)

动态配置优势对比表

| 特性 | 固定结构 | 配置驱动 |

|---|---|---|

| 修改成本 | 高(需改代码) | 低(仅改JSON/YAML) |

| 实验效率 | 低 | 高(支持网格搜索) |

| 可读性 | 一般 | 强(配置即文档) |

| 多环境适配 | 差 | 好(训练/边缘设备差异化) |

| 版本控制友好度 | 中 | 高(配置独立追踪) |

✅ 最佳实践建议 :将

CONFIG抽离为独立的.yaml或.json文件,配合argparse或OmegaConf进行命令行注入,实现真正的“一次编写,处处运行”。

4.2 经典CNN架构在猫狗识别中的适配

4.2.1 LeNet、AlexNet结构对比与选择依据

尽管现代图像分类普遍采用 ResNet、EfficientNet 等先进架构,但在资源受限或教学演示场景下,理解早期经典CNN仍具重要意义。以下是 LeNet 与 AlexNet 在猫狗识别任务上的适用性分析。

| 架构 | 年份 | 输入尺寸 | 层数(卷积+FC) | 参数量估算 | 是否适合猫狗识别 |

|---|---|---|---|---|---|

| LeNet-5 | 1998 | 32×32 | 2C + 3D | ~60K | ❌ 不适用(分辨率太低) |

| AlexNet | 2012 | 227×227 | 5C + 3D | ~60M | ✅ 可用但较重 |

| 自定义轻量CNN | —— | 224×224 | 3C + 2D | ~2M | ✅ 推荐(平衡精度与速度) |

结构差异分析(以AlexNet为例)

graph TD

A[Input 227x227x3] --> B[Conv2D: 96@11x11, s=4]

B --> C[ReLU]

C --> D[MaxPool: 3x3, s=2]

D --> E[Conv2D: 256@5x5, pad=2]

E --> F[ReLU]

F --> G[MaxPool: 3x3, s=2]

G --> H[Conv2D: 384@3x3, pad=1]

H --> I[ReLU]

I --> J[Conv2D: 384@3x3, pad=1]

J --> K[ReLU]

K --> L[Conv2D: 256@3x3, pad=1]

L --> M[ReLU]

M --> N[MaxPool: 3x3, s=2]

N --> O[Flatten]

O --> P[Dense: 4096]

P --> Q[Dropout]

Q --> R[Dense: 4096]

R --> S[Dropout]

S --> T[Dense: 1000 (ImageNet)]

🔍 观察点 :

- 使用大卷积核(11×11)进行初步特征捕获;

- ReLU 替代 Sigmoid 加速收敛;

- 多GPU并行设计反映时代局限;

- 最终输出为1000类,迁移学习时需替换最后一层。

对于猫狗二分类任务,直接使用原始 AlexNet 显得过于沉重。通常做法是加载预训练权重,冻结前面卷积层,只微调最后几层(Fine-tuning),或使用其结构灵感设计简化版。

4.2.2 自定义轻量级CNN的设计思路与层数安排

针对猫狗数据集(约25000张图像,每张约200KB),我们追求的是 高准确率、低延迟、小内存占用 。为此,提出如下自定义架构设计原则:

- 逐步降维 :每经过一次池化,空间分辨率减半,通道数翻倍;

- 减少全连接层负担 :优先使用 Global Average Pooling;

- 引入正则化机制 :Dropout + BatchNormalization 防止过拟合;

- 保持感受野足够大 :至少覆盖图像主要区域。

推荐结构设计(适用于 model.py )

def create_lightweight_cnn(input_shape=(224, 224, 3), num_classes=2):

model = Sequential([

# Block 1

layers.Conv2D(32, (3, 3), activation='relu', input_shape=input_shape),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

# Block 2

layers.Conv2D(64, (3, 3), activation='relu'),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

# Block 3

layers.Conv2D(128, (3, 3), activation='relu'),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

# Block 4

layers.Conv2D(128, (3, 3), activation='relu'),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

# Classifier Head

layers.GlobalAveragePooling2D(),

layers.Dropout(0.5),

layers.Dense(512, activation='relu'),

layers.Dense(num_classes, activation='softmax')

])

return model

层次结构表格说明

| 层序 | 类型 | 输出形状 | 参数数量 | 功能说明 |

|---|---|---|---|---|

| 1 | Conv2D(32) | (None, 222, 222, 32) | 896 | 提取边缘纹理特征 |

| 2 | BatchNorm | 同上 | 128 | 加速训练稳定梯度 |

| 3 | MaxPool | (None, 111, 111, 32) | 0 | 下采样,保留关键信息 |

| 4 | Conv2D(64) | (None, 109, 109, 64) | 18496 | 增强非线性表达能力 |

| … | … | … | … | … |

| 12 | GAP | (None, 128) | 0 | 替代Flatten,压缩空间维度 |

| 13 | Dropout(0.5) | (None, 128) | 0 | 训练时随机屏蔽神经元 |

| 14 | Dense(512) | (None, 512) | 66048 | 学习高级语义表示 |

| 15 | Dense(2) | (None, 2) | 1026 | 输出类别概率分布 |

总参数量约为 ~210K ,远低于 AlexNet,在普通GPU上单epoch训练时间小于1分钟,非常适合快速迭代实验。

4.2.3 输出层设计与损失函数匹配关系

输出层的设计必须与任务性质及损失函数严格匹配。猫狗识别属于 二分类问题 ,常用两种形式:

| 编码方式 | 输出层激活函数 | 损失函数 | 适用框架 |

|---|---|---|---|

| One-Hot + Softmax | softmax |

categorical_crossentropy |

多类通用 |

| 单节点Sigmoid | sigmoid |

binary_crossentropy |

二分类专用 |

推荐配置(TensorFlow/Keras)

# 方案一:Softmax + Categorical Crossentropy

model.compile(

optimizer='adam',

loss='categorical_crossentropy',

metrics=['accuracy']

)

# 方案二:Sigmoid + Binary Crossentropy(更高效)

model.add(Dense(1, activation='sigmoid')) # 输出单值

model.compile(

optimizer='adam',

loss='binary_crossentropy',

metrics=['accuracy']

)

⚠️ 注意事项:

- 若使用binary_crossentropy,标签应为[0, 1]整数编码;

- 若使用categorical_crossentropy,标签需转换为 one-hot 形式(如[1,0],[0,1]);

- sigmoid 输出可通过阈值(如0.5)判定类别,便于后期部署。

4.3 使用TensorFlow/Keras实现model.py

4.3.1 Sequential模型构建方式

Sequential 模型适用于线性堆叠结构,语法简洁,适合初学者快速原型开发。

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

model = Sequential()

model.add(Conv2D(32, (3,3), activation='relu', input_shape=(224,224,3)))

model.add(MaxPooling2D(2,2))

model.add(Conv2D(64, (3,3), activation='relu'))

model.add(MaxPooling2D(2,2))

model.add(Flatten())

model.add(Dense(64, activation='relu'))

model.add(Dense(1, activation='sigmoid'))

model.summary()

✅ 优点:代码简洁,易于调试

❌ 缺点:无法处理分支结构、残差连接等复杂拓扑

4.3.2 函数式API实现复杂连接结构

当需要构建 Inception、ResNet 或多输入/输出模型时,必须使用函数式API。

from tensorflow.keras.layers import Input, add

def residual_block(x, filters):

shortcut = x

x = layers.Conv2D(filters, (3,3), padding='same', activation='relu')(x)

x = layers.BatchNormalization()(x)

x = layers.Conv2D(filters, (3,3), padding='same')(x)

x = layers.BatchNormalization()(x)

x = add([x, shortcut]) # 残差连接

x = layers.Activation('relu')(x)

return x

inputs = Input(shape=(224,224,3))

x = layers.Conv2D(32, (7,7), strides=2, activation='relu')(inputs)

x = layers.MaxPooling2D(3,3)(x)

x = residual_block(x, 32)

x = layers.GlobalAveragePooling2D()(x)

outputs = layers.Dense(1, activation='sigmoid')(x)

residual_model = Model(inputs, outputs)

📈 优势:支持任意有向无环图结构,利于实现前沿架构。

4.3.3 模型编译:优化器、损失函数与评价指标设定

模型构建完成后,需通过 compile() 方法指定训练策略:

model.compile(

optimizer=tf.keras.optimizers.Adam(learning_rate=1e-4),

loss='binary_crossentropy',

metrics=[

'accuracy',

tf.keras.metrics.Precision(name='precision'),

tf.keras.metrics.Recall(name='recall')

]

)

| 参数 | 推荐值 | 说明 |

|---|---|---|

optimizer |

Adam(lr=1e-4) | 自适应学习率,收敛快 |

loss |

binary_crossentropy | 二分类最优选择 |

metrics |

accuracy, precision, recall | 全面评估模型表现 |

4.4 模型保存与加载机制实现

4.4.1 HDF5格式权重存储与恢复

HDF5( .h5 )是最常用的保存格式,兼容性强。

# 保存整个模型

model.save('dogcat_model.h5')

# 加载模型

loaded_model = tf.keras.models.load_model('dogcat_model.h5')

💡 适用场景:本地训练、快速恢复、Jupyter Notebook 开发

4.4.2 SavedModel格式的应用场景与优势

SavedModel 是 TensorFlow 推荐的生产级格式,支持版本管理、签名定义、跨语言调用。

# 保存为 SavedModel

model.save('saved_model/dogcat_classifier')

# 使用 tf.saved_model CLI 查看

saved_model_cli show --dir saved_model/dogcat_classifier --all

# 加载用于部署

loaded = tf.saved_model.load('saved_model/dogcat_classifier')

infer = loaded.signatures["serving_default"]

result = infer(tf.constant(image_batch))

| 特性 | HDF5 | SavedModel |

|---|---|---|

| 跨平台 | ✅ | ✅✅✅ |

| 支持TPU | ✅ | ✅ |

| 可签名服务 | ❌ | ✅ |

| 版本控制 | 手动 | 内置 |

✅ 推荐:训练用

.h5,部署用SavedModel

4.4.3 跨平台部署时的兼容性考虑

在移动端(Android/iOS)、Web(TensorFlow.js)或边缘设备(TensorFlow Lite)部署时,需进行格式转换:

# 转换为 TFLite

converter = tf.lite.TFLiteConverter.from_saved_model('saved_model/dogcat_classifier')

tflite_model = converter.convert()

open("dogcat.tflite", "wb").write(tflite_model)

📱 应用场景:手机拍照识别猫狗,IoT摄像头实时检测

总结性技术路线图(Mermaid)

flowchart LR

A[定义 model.py] --> B[选择架构]

B --> C{是否预训练?}

C -->|是| D[加载 ImageNet 权重]

C -->|否| E[随机初始化]

D & E --> F[编译模型]

F --> G[训练]

G --> H{保存格式}

H --> I[HDF5 (.h5)]

H --> J[SavedModel]

H --> K[TFLite]

I --> L[本地测试]

J --> M[云服务部署]

K --> N[移动端应用]

该流程体现了从研发到落地的完整闭环,强调了 model.py 在其中承上启下的关键角色。

5. 图像数据预处理与增强(input_data.py)

在深度学习任务中,尤其是计算机视觉领域,输入数据的质量直接影响模型的训练效果和最终性能。尽管现代神经网络具有强大的非线性拟合能力,但如果输入图像未经合理处理或缺乏多样性,模型极易陷入过拟合、泛化能力差等问题。因此,构建一个高效、鲁棒且可扩展的数据输入管道成为项目成功的关键环节之一。 input_data.py 文件正是承担这一核心职责的模块——它不仅负责从原始文件系统中读取图像数据,还实现了包括路径管理、内存优化、图像预处理、数据增强以及训练/验证集划分在内的完整数据流控制逻辑。

该模块的设计目标是实现“高吞吐、低延迟、强一致性”的数据供给机制,确保GPU在训练过程中不会因数据加载瓶颈而空转。同时,通过引入灵活的配置参数和面向对象的封装结构,使得整个数据处理流程具备良好的可维护性和跨项目复用潜力。本章将深入剖析 input_data.py 的功能定位、关键技术实现细节及其在整个猫狗识别系统中的调用链路,并结合代码实例、流程图与参数说明,全面展示如何构建一个工业级图像数据处理管道。

5.1 input_data.py的功能定位与调用流程

作为深度学习项目的前端入口, input_data.py 承担着连接原始数据与模型训练之间的桥梁作用。其主要功能涵盖图像路径解析、标签自动标注、批数据生成、内存管理优化等多个层面。该模块通常被 training.py 和 evaluateCatOrDog.py 调用,在训练阶段提供带增强的批量数据流,在评估阶段则输出标准化但无扰动的测试样本。

5.1.1 数据读取接口设计与路径管理

在实际项目中,图像数据往往以文件夹形式组织,例如 /data/train/cat/ , /data/train/dog/ 等目录结构。为了实现自动化标签提取,需设计通用的路径遍历策略。以下是一个典型的路径解析函数:

import os

import random

from pathlib import Path

def get_image_paths_and_labels(data_dir, class_names=None):

"""

遍历指定目录下的所有图像文件,返回路径列表与对应标签

参数:

data_dir (str): 根目录路径,如 'data/train'

class_names (list): 类别名称列表,默认按字典序排序子目录

返回:

paths (list): 图像文件完整路径列表

labels (list): 对应整数标签列表

"""

data_root = Path(data_dir)

if not class_names:

class_names = sorted([d.name for d in data_root.iterdir() if d.is_dir()])

class_to_idx = {cls_name: idx for idx, cls_name in enumerate(class_names)}

paths, labels = [], []

for class_name in class_names:

class_path = data_root / class_name

for img_file in class_path.glob("*.[jp][pn]g"): # 匹配 .jpg/.jpeg/.png

paths.append(str(img_file))

labels.append(class_to_idx[class_name])

# 打乱数据顺序

combined = list(zip(paths, labels))

random.shuffle(combined)

paths[:], labels[:] = zip(*combined)

return paths, labels

代码逻辑逐行解读:

- 第6行:使用

pathlib.Path提供跨平台路径操作支持; - 第9–10行:若未传入类别名,则自动提取子目录并按字母排序,保证一致性;

- 第13–17行:遍历每个类别目录,使用通配符匹配常见图像格式;

- 第21–24行:将路径与标签打包后打乱,防止类别集中分布影响训练稳定性。

此方法的优势在于 解耦了路径结构与标签映射关系 ,便于迁移至其他分类任务。此外,返回的是纯字符串路径而非直接加载图像,有助于减少初始内存占用。

5.1.2 内存使用效率与批处理机制

由于高分辨率图像(如224×224×3)单张占用约60KB内存,若一次性加载数万张图像可能导致内存溢出。为此,应采用 惰性加载 + 批量迭代器 的方式进行数据供给。

以下是基于 Python 生成器实现的批数据读取器:

import numpy as np

from PIL import Image

def image_generator(paths, labels, batch_size=32, target_size=(224, 224), augment_fn=None):

"""

图像数据生成器,支持实时增强与批输出

参数:

paths (list): 图像路径列表

labels (list): 标签列表

batch_size (int): 每批次样本数量

target_size (tuple): 目标尺寸 (height, width)

augment_fn (callable): 可选增强函数

Yields:

batch_x (np.ndarray): 形状为 (B, H, W, C) 的图像张量

batch_y (np.ndarray): 形状为 (B,) 的标签向量

"""

num_samples = len(paths)

indices = np.arange(num_samples)

while True:

np.random.shuffle(indices)

for start in range(0, num_samples, batch_size):

end = min(start + batch_size, num_samples)

batch_indices = indices[start:end]

batch_x = []

for i in batch_indices:

img = Image.open(paths[i]).convert('RGB')

img = img.resize(target_size, Image.Resampling.LANCZOS)

img_array = np.array(img, dtype=np.float32)

if augment_fn:

img_array = augment_fn(img_array)

batch_x.append(img_array)

batch_x = np.stack(batch_x, axis=0)

batch_y = np.array([labels[i] for i in batch_indices], dtype=np.int32)

yield batch_x, batch_y

参数说明与逻辑分析:

batch_size=32:平衡GPU利用率与显存消耗的经验值;target_size=(224,224):适配主流CNN输入要求;augment_fn:允许外部注入增强逻辑,提升模块灵活性;- 使用

while True实现无限循环,满足Keras等框架对epoch内多次遍历的需求; yield关键字启用生成器模式,避免全量数据驻留内存。

下图为该数据流的整体调用流程:

graph TD

A[开始训练] --> B{调用 input_data.py}

B --> C[get_image_paths_and_labels]

C --> D[生成路径与标签列表]

D --> E[image_generator 创建迭代器]

E --> F[每次请求一批数据]

F --> G[读取图像 → 预处理 → 增强]

G --> H[返回 batch_x, batch_y]

H --> I[送入 model.fit()]

I --> J[反向传播更新权重]

J --> F

该流程体现了 数据流水线异步执行 的思想,极大提升了整体训练效率。

5.2 图像预处理关键技术实现

高质量的图像预处理是提升模型收敛速度和准确率的重要前提。预处理的目标是使输入数据符合模型期望的数值分布与空间特性,消除无关变量干扰。

5.2.1 图像归一化与标准化处理方法

神经网络对输入数据的尺度敏感,因此必须进行数值规范化。常用方法有两种:

| 方法 | 公式 | 适用场景 |

|---|---|---|

| Min-Max 归一化 | $ x’ = \frac{x - 0}{255} $ | 输入范围明确为 [0,255] |

| Z-Score 标准化 | $ x’ = \frac{x - \mu}{\sigma} $ | 使用ImageNet统计量迁移学习 |

示例代码如下:

def normalize_image(image_array):

"""将uint8图像归一化到[0,1]区间"""

return image_array / 255.0

def standardize_image(image_array, mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]):

"""使用ImageNet均值与标准差进行标准化"""

image_array = image_array.astype(np.float32) / 255.0

image_array -= mean

image_array /= std

return image_array

逻辑分析 :先除以255将像素值缩放到[0,1],再减去通道均值并除以标准差。这种变换能有效匹配预训练模型的输入分布,显著提升迁移学习效果。

5.2.2 尺寸缩放与中心裁剪策略

不同来源的图像尺寸各异,必须统一为固定大小。常用的策略包括:

- 直接缩放(Resize) :简单高效,但可能引起形变;

- 中心裁剪(Center Crop)+ 缩放 :保留主体结构;

- 随机裁剪(Random Crop) :兼具增强作用。

def center_crop_resize(image, target_size):

h, w = image.shape[:2]

new_dim = min(h, w)

crop_top = (h - new_dim) // 2

crop_left = (w - new_dim) // 2

cropped = image[crop_top:crop_top+new_dim, crop_left:crop_left+new_dim]

resized = cv2.resize(cropped, target_size, interpolation=cv2.INTER_AREA)

return resized

该函数首先找出最短边进行中心裁剪,再缩放到目标尺寸,常用于推理阶段保持几何一致性。

5.2.3 RGB通道调整与数据类型转换

某些框架(如TensorFlow)默认使用NHWC格式,而PyTorch需要NCHW。此外,PIL读取的图像为HWC格式,需注意维度排列:

# HWC to CHW (for PyTorch)

image_chw = np.transpose(image_hwc, (2, 0, 1))

# 数据类型转换

image_float = image_chw.astype(np.float32)

同时,部分模型要求输入为BGR顺序(如OpenCV默认),需做通道反转:

image_bgr = image_rgb[:, :, ::-1] # RGB to BGR

这些细节虽小,但在跨平台部署时至关重要。

5.3 数据增强技术提升模型鲁棒性

数据增强通过对训练样本施加语义不变的变换,人为扩大数据多样性,从而提高模型对光照、姿态、噪声等因素的鲁棒性。

5.3.1 随机翻转、旋转与平移操作实现

import cv2

def random_flip_rotate_translate(image):

# 随机水平翻转

if random.random() > 0.5:

image = cv2.flip(image, 1)

# 随机旋转 ±15度

angle = random.uniform(-15, 15)

h, w = image.shape[:2]

M = cv2.getRotationMatrix2D((w//2, h//2), angle, 1.0)

image = cv2.warpAffine(image, M, (w, h), borderMode=cv2.BORDER_REFLECT)

# 随机平移 ±10像素

tx, ty = random.randint(-10, 10), random.randint(-10, 10)

M = np.float32([[1, 0, tx], [0, 1, ty]])

image = cv2.warpAffine(image, M, (w, h), borderMode=cv2.BORDER_REFLECT)

return image

参数说明 :旋转中心设为图像中心;

borderMode=cv2.BORDER_REFLECT防止黑边填充破坏语义。

5.3.2 亮度、对比度与饱和度扰动

针对光照变化,可在HSV空间进行颜色抖动:

def color_jitter(image, brightness=0.3, contrast=0.3, saturation=0.3):

hsv = cv2.cvtColor(image, cv2.COLOR_RGB2HSV)

h, s, v = cv2.split(hsv)

# 亮度扰动

v = cv2.add(v, random.randint(-brightness*255, brightness*255))

# 对比度扰动

alpha = 1 + random.uniform(-contrast, contrast)

v = cv2.convertScaleAbs(v, alpha=alpha, beta=0)

# 饱和度扰动

s = cv2.convertScaleAbs(s, alpha=1 + random.uniform(-saturation, saturation))

jittered = cv2.merge([h, s, v])

return cv2.cvtColor(jittered, cv2.COLOR_HSV2RGB)

该方法模拟真实环境中不同的曝光条件,增强模型光照不变性。

5.3.3 使用ImageDataGenerator进行实时增强

Keras内置的 ImageDataGenerator 提供便捷的增强接口:

from tensorflow.keras.preprocessing.image import ImageDataGenerator

datagen = ImageDataGenerator(

rotation_range=20,

width_shift_range=0.2,

height_shift_range=0.2,

horizontal_flip=True,

zoom_range=0.2,

rescale=1./255,

validation_split=0.2

)

train_gen = datagen.flow_from_directory(

'data/train',

target_size=(224, 224),

batch_size=32,

class_mode='binary',

subset='training'

)

优势 :无需手动编写增强逻辑,支持自动标签提取与分层采样;

限制 :灵活性较低,复杂增强需自定义。

5.4 训练集与验证集的划分逻辑

合理的数据划分是评估模型泛化能力的基础。常见的策略有随机分割与分层抽样。

5.4.1 按比例随机分割与分层抽样

from sklearn.model_selection import train_test_split

paths, labels = get_image_paths_and_labels('data/train')

train_paths, val_paths, train_labels, val_labels = train_test_split(

paths, labels, test_size=0.2, stratify=labels, random_state=42

)

stratify=labels确保训练/验证集中各类别比例一致,避免偏差。

5.4.2 文件路径列表生成与标签自动标注

前述 get_image_paths_and_labels 已实现自动标注,适用于结构化目录。

5.4.3 迭代器封装与GPU加速数据供给

使用 tf.data.Dataset 可进一步优化性能:

import tensorflow as tf

def make_dataset(paths, labels, batch_size=32, is_train=True):

dataset = tf.data.Dataset.from_tensor_slices((paths, labels))

dataset = dataset.map(load_and_preprocess, num_parallel_calls=tf.data.AUTOTUNE)

if is_train:

dataset = dataset.augment(augment_fn).shuffle(1000)

dataset = dataset.batch(batch_size).prefetch(tf.data.AUTOTUNE)

return dataset

prefetch实现CPU-GPU流水线并发,显著降低IO等待时间。

综上所述, input_data.py 不仅是数据入口,更是决定模型成败的核心组件之一。通过科学设计预处理流程、合理应用增强手段、优化数据供给机制,可大幅提升深度学习系统的稳定性和泛化能力。

6. 深度学习模型训练流程实现(training.py)

在深度学习项目中, training.py 是整个系统中最核心的执行模块之一。它不仅负责将模型与数据连接起来进行实际训练,还承担着超参数管理、训练过程监控、模型保存与优化策略调度等关键任务。一个设计良好的训练脚本能够显著提升开发效率、增强实验可复现性,并为后续的调优和部署提供坚实基础。本章深入剖析 training.py 文件的设计逻辑与实现细节,重点围绕训练流程控制、动态调整机制、日志记录体系以及多轮实验管理展开讨论。

6.1 training.py的核心功能与执行流程

training.py 的主要职责是协调模型定义(来自 model.py )、数据供给(来自 input_data.py )与训练策略之间的交互关系,形成闭环的训练流水线。其执行流程通常遵循“初始化 → 配置 → 训练循环 → 结果输出”的结构化模式。该文件不仅是技术实现的关键环节,更是工程实践中体现代码组织能力与系统思维的重要载体。

6.1.1 模型实例化与参数初始化

在开始训练前,必须首先从 model.py 中导入已定义好的网络结构类或函数,并通过其实例化创建具体的模型对象。这一过程涉及多个层次的配置:包括输入维度、类别数量、是否使用预训练权重、初始化方式等。

from model import build_cnn_model

import tensorflow as tf

# 定义输入形状和类别数

input_shape = (224, 224, 3)

num_classes = 2

# 实例化模型

model = build_cnn_model(input_shape=input_shape, num_classes=num_classes)

# 使用Keras内置方法查看模型结构

model.summary()

代码逻辑逐行解析:

- 第1行 :从自定义模块

model.py导入构建模型的函数build_cnn_model,确保模型定义与训练逻辑解耦。 - 第4~5行 :设定图像输入尺寸为

(224, 224, 3),符合常见CNN输入规范;类别数设为2(猫/狗),适用于二分类任务。 - 第8行 :调用模型构建函数生成具体模型实例,此时仅完成结构搭建,尚未编译。

- 第11行 :打印模型摘要,展示每一层的名称、输出形状及参数量,便于调试和性能评估。

TensorFlow 支持多种参数初始化策略,例如 glorot_uniform (Xavier初始化)用于全连接层, he_normal 适用于ReLU激活函数下的卷积层。这些可通过 kernel_initializer 参数显式指定:

conv_layer = tf.keras.layers.Conv2D(

filters=32,

kernel_size=(3, 3),

activation='relu',

kernel_initializer='he_normal' # 针对ReLU优化的初始化

)

参数说明 :

-filters: 卷积核数量,决定输出特征图通道数;

-kernel_size: 卷积窗口大小,影响感受野;

-activation: 激活函数类型;

-kernel_initializer: 权重初始分布策略,合理选择可加速收敛并避免梯度消失。

此外,在迁移学习场景下,常加载ImageNet预训练权重以提升小样本任务表现:

base_model = tf.keras.applications.VGG16(

weights='imagenet', # 加载预训练权重

include_top=False, # 不包含顶层分类器

input_shape=input_shape

)

这使得模型在初期即具备强大的特征提取能力,减少随机初始化带来的不稳定。

6.1.2 训练超参数设置:epoch、batch_size、learning_rate

超参数的选择直接决定模型能否有效收敛以及最终性能上限。以下是典型设置及其影响分析:

| 超参数 | 推荐值范围 | 影响说明 |

|---|---|---|

epochs |

10–100 | 控制训练迭代轮数,过多易过拟合,过少欠拟合 |

batch_size |

16–64 | 小批量提升梯度稳定性,过大占用显存 |

learning_rate |

1e-4 ~ 1e-3 | 过高导致震荡,过低收敛慢 |

optimizer |

Adam, SGD with momentum | Adam适合大多数情况 |

# 超参数配置

EPOCHS = 50

BATCH_SIZE = 32

LEARNING_RATE = 1e-3

# 编译模型

model.compile(

optimizer=tf.keras.optimizers.Adam(learning_rate=LEARNING_RATE),

loss='binary_crossentropy',

metrics=['accuracy']

)

执行逻辑分析:

- 使用

Adam优化器自动调节学习率各维度更新步长,适合非平稳目标函数; - 损失函数选用

binary_crossentropy因为任务为二分类,标签采用0/1编码; metrics=['accuracy']表示在每个epoch结束后计算准确率用于监控。

值得注意的是,学习率并非固定不变。现代训练实践中普遍采用 学习率调度器 (Learning Rate Scheduler),如余弦退火、指数衰减等。以下是一个简单的指数衰减示例:

lr_schedule = tf.keras.callbacks.LearningRateScheduler(

lambda epoch: LEARNING_RATE * 0.9 ** epoch

)

该回调会在每轮训练开始时自动调用匿名函数更新学习率,实现动态下降。

6.2 训练过程中的关键控制逻辑

为了保障训练过程稳定高效,需引入一系列控制机制,包括进度反馈、验证监控、早停判断和学习率自适应调整。这些逻辑共同构成了智能训练系统的“大脑”。

6.2.1 训练循环结构设计与进度显示

完整的训练流程依赖于 model.fit() 方法封装的高层API,但理解底层循环机制有助于定制复杂行为。标准训练循环如下所示:

history = model.fit(

train_dataset,

epochs=EPOCHS,

batch_size=BATCH_SIZE,

validation_data=val_dataset,

callbacks=[early_stopping, lr_scheduler, checkpoint],

verbose=1

)

其中 verbose=1 启用进度条输出,实时显示loss与metric变化。

更细粒度地,可以手动编写训练循环以支持自定义操作:

for epoch in range(EPOCHS):

print(f"\nEpoch {epoch + 1}/{EPOCHS}")

prog_bar = tf.keras.utils.Progbar(target=len(train_dataset))

for step, (x_batch, y_batch) in enumerate(train_dataset):

with tf.GradientTape() as tape:

logits = model(x_batch, training=True)

loss_value = loss_fn(y_batch, logits)

grads = tape.gradient(loss_value, model.trainable_variables)

optimizer.apply_gradients(zip(grads, model.trainable_variables))

prog_bar.update(step + 1, values=[('loss', loss_value.numpy())])

逻辑解读:

- 使用

tf.GradientTape()自动记录前向传播中的张量操作,支持反向求导; training=True确保Dropout/BatchNorm处于训练模式;Progbar提供可视化进度条,提升用户体验;- 每步更新后立即应用梯度,构成SGD的基本单元。

此模式虽灵活,但牺牲了分布式训练兼容性和性能优化,建议仅用于研究或特殊需求。

6.2.2 验证集性能监控与早停机制(Early Stopping)

过拟合是小数据集训练中最常见的问题。通过引入 EarlyStopping 回调,可在验证损失不再改善时提前终止训练,防止模型退化。

early_stopping = tf.keras.callbacks.EarlyStopping(

monitor='val_loss',

patience=10,

restore_best_weights=True

)

| 参数 | 说明 |

|---|---|

monitor |

监控指标,常用 val_loss 或 val_accuracy |

patience |

允许连续无改进的epoch数 |

restore_best_weights |

是否恢复最佳权重而非最后权重 |

graph TD

A[开始训练] --> B{验证损失下降?}

B -- 是 --> C[继续训练]

B -- 否 --> D[计数+1]

D --> E{计数 >= patience?}

E -- 否 --> C

E -- 是 --> F[停止训练,恢复最优权重]

该机制极大提升了训练效率,尤其在资源有限环境下意义重大。

6.2.3 学习率衰减策略动态调整

静态学习率难以适应不同训练阶段的需求。随着模型接近最优解,需要较小的学习率进行精细搜索。为此,可结合回调实现自动衰减。

reduce_lr = tf.keras.callbacks.ReduceLROnPlateau(

monitor='val_loss',

factor=0.5,

patience=5,

min_lr=1e-7,

verbose=1

)

factor: 学习率乘以该系数进行衰减;min_lr: 最小允许学习率,防止无限缩小;verbose=1: 输出学习率变化信息。

实验表明,这种策略能在保持快速收敛的同时避免局部振荡,尤其适用于深层网络。

6.3 模型检查点与日志记录

有效的日志系统是科研与工程迭代的基础。 training.py 必须集成模型保存与运行状态追踪功能,以便长期维护与结果回溯。

6.3.1 定期保存最佳模型权重

使用 ModelCheckpoint 可自动保存性能最优的模型:

checkpoint = tf.keras.callbacks.ModelCheckpoint(

filepath='checkpoints/best_model.h5',

monitor='val_accuracy',

save_best_only=True,

mode='max',

save_weights_only=False,

verbose=1

)

| 参数 | 作用 |

|---|---|

filepath |

保存路径,支持格式化 {epoch} {val_acc} |

save_best_only |

仅保留历史最佳 |

mode |

'max' 表示越大越好(如acc), 'min' 用于loss |

文件扩展名 .h5 表示HDF5格式,兼容性强且支持跨平台加载。

6.3.2 TensorBoard日志写入与可视化追踪

TensorBoard 是 TensorFlow 内建的强大可视化工具,可用于实时监控训练动态。

tensorboard_cb = tf.keras.callbacks.TensorBoard(

log_dir='./logs/train_run_1',

histogram_freq=1,

write_graph=True,

update_freq='epoch'

)

启动命令:

tensorboard --logdir=./logs

访问 http://localhost:6006 即可查看损失曲线、准确率趋势、计算图结构甚至嵌入空间投影。

flowchart LR

Data --> TrainingLoop --> LossCalculation

LossCalculation --> GradientUpdate

GradientUpdate --> ModelCheckpoint

GradientUpdate --> TensorBoardLogging

TensorBoardLogging --> BrowserVisualization

上述流程展示了从数据到可视化的完整链路,凸显了日志系统的重要性。

6.3.3 训练损失与准确率曲线绘制

训练完成后,可利用 history 对象绘制学习曲线:

import matplotlib.pyplot as plt

def plot_training_curves(history):

epochs = range(1, len(history.history['loss']) + 1)

plt.figure(figsize=(12, 4))

# 损失曲线

plt.subplot(1, 2, 1)

plt.plot(epochs, history.history['loss'], label='Training Loss')

plt.plot(epochs, history.history['val_loss'], label='Validation Loss')

plt.title('Model Loss')

plt.xlabel('Epoch')

plt.ylabel('Loss')

plt.legend()

# 准确率曲线

plt.subplot(1, 2, 2)

plt.plot(epochs, history.history['accuracy'], label='Training Accuracy')

plt.plot(epochs, history.history['val_accuracy'], label='Validation Accuracy')

plt.title('Model Accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.legend()

plt.tight_layout()

plt.savefig('training_curves.png')

plt.show()

plot_training_curves(history)

该图表能直观反映模型是否过拟合(验证损失上升)、收敛速度及稳定性。

6.4 多轮实验管理与结果对比分析

在真实项目中,往往需要尝试多种架构、超参数组合或数据增强策略。建立标准化实验管理体系至关重要。

6.4.1 不同网络结构训练效果比较

设计表格统一记录各实验结果:

| 实验编号 | 模型结构 | 参数量(M) | Epochs | Val Acc(%) | Train Time(min) |

|---|---|---|---|---|---|

| Exp01 | Custom CNN | 1.2 | 50 | 86.3 | 28 |

| Exp02 | VGG16 (FT) | 138.4 | 30 | 92.7 | 65 |

| Exp03 | ResNet50 | 25.6 | 40 | 94.1 | 72 |

注:FT = Fine-tuned,表示微调预训练模型

分析发现,尽管轻量级CNN训练快,但精度明显低于ResNet系列。而VGG16因结构较旧,存在冗余连接,效率偏低。

6.4.2 超参数调优实践与网格搜索

采用 Keras Tuner 或 Optuna 实现自动化搜索:

import keras_tuner as kt

def build_tuned_model(hp):

model = tf.keras.Sequential()

model.add(tf.keras.layers.Conv2D(

filters=hp.Int('conv_1_filter', 32, 128, step=16),

kernel_size=hp.Choice('conv_1_kernel', [3, 5]),

activation='relu'

))

model.add(tf.keras.layers.GlobalAveragePooling2D())

model.add(tf.keras.layers.Dense(

units=hp.Int('dense_1_units', 32, 128, step=16),

activation='relu'

))

model.add(tf.keras.layers.Dense(1, activation='sigmoid'))

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

return model

tuner = kt.RandomSearch(build_tuned_model, objective='val_accuracy', max_trials=10)

tuner.search(train_dataset, epochs=20, validation_data=val_dataset)

该过程自动探索超参数空间,返回最优配置,极大降低人工试错成本。

6.4.3 训练稳定性与收敛速度评估

除最终精度外,还需关注:

- 收敛速度 :多少epoch达到90%最大准确率?

- 波动幅度 :验证指标标准差是否过大?

- 资源消耗 :GPU内存占用、单epoch耗时等。

可通过多次重复实验取均值来评估鲁棒性,并绘制箱线图分析分布特性。

综上所述, training.py 不仅是执行脚本,更是连接理论与实践的桥梁。其设计质量直接影响项目的可扩展性、可维护性与科学性。一个完善的训练系统应具备自动化、可配置、可观测三大特征,为后续评估与部署奠定坚实基础。

7. 模型性能评估方法与指标计算(evaluateCatOrDog.py)

7.1 evaluateCatOrDog.py的功能职责界定

evaluateCatOrDog.py 是整个猫狗分类项目中用于模型最终验证的核心模块,其主要功能是在训练完成后对模型在独立测试集上的表现进行客观、全面的评估。该脚本承担着从磁盘加载已训练好的模型权重、预处理测试图像数据、执行批量推理以及生成结构化评估报告的关键任务。

在实际工程实践中,一个健壮的评估流程不仅需要准确地输出预测结果,还需支持多种评估维度的自动化分析。因此, evaluateCatOrDog.py 的设计遵循高内聚、低耦合原则,通过模块化接口与其他组件(如 model.py 和 input_data.py )协同工作。

以下是该模块典型调用逻辑的代码示例:

# evaluateCatOrDog.py 核心加载与推理流程

import tensorflow as tf

from model import build_cnn_model # 引入模型定义

from input_data import load_test_data # 加载测试集

def load_trained_model(model_path):

"""加载保存的模型或权重"""

if model_path.endswith('.h5'):

model = tf.keras.models.load_model(model_path)

else:

model = build_cnn_model() # 构建相同结构

model.load_weights(model_path)

return model

def evaluate_model(test_gen, model):

"""执行评估并返回预测结果"""

predictions = model.predict(test_gen)

predicted_classes = (predictions > 0.5).astype(int) # 二分类阈值

true_labels = test_gen.classes

return predicted_classes, true_labels, predictions

参数说明:

- model_path : 模型文件路径,支持 .h5 或 SavedModel 格式。

- test_gen : 使用 ImageDataGenerator.flow_from_directory() 生成的测试数据迭代器。

- predictions : 输出为 (N, 1) 维概率数组,表示属于“狗”类的概率。

此脚本通常作为命令行工具运行,支持传入模型路径、测试集目录和输出报告路径等参数,便于集成到CI/CD流水线中。

7.2 分类任务常用评估指标解析

针对二分类问题(猫 vs 狗),我们需采用多维指标体系来全面衡量模型性能。以下表格列出了关键评估指标的数学定义及其业务含义:

| 指标 | 公式 | 含义 |

|---|---|---|

| 准确率 (Accuracy) | (TP + TN) / (TP + TN + FP + FN) | 整体正确预测比例 |

| 精确率 (Precision) | TP / (TP + FP) | 预测为正类中真实为正的比例 |

| 召回率 (Recall) | TP / (TP + FN) | 实际正类中被正确识别的比例 |

| F1-score | 2 × (P × R) / (P + R) | 精确率与召回率的调和平均 |

| AUC-ROC | - | 曲线下面积,反映排序能力 |

其中:

- TP(True Positive):正确识别为狗

- TN(True Negative):正确识别为猫

- FP(False Positive):将猫误判为狗

- FN(False Negative):将狗误判为猫

使用 sklearn.metrics 可快速计算上述指标:

from sklearn.metrics import classification_report, confusion_matrix, roc_auc_score

# 假设 y_true 和 y_pred 已获取

print("分类报告:")

print(classification_report(y_true, y_pred, target_names=['Cat', 'Dog']))

print("混淆矩阵:")

cm = confusion_matrix(y_true, y_pred)

print(cm)

auc = roc_auc_score(y_true, y_pred_proba)

print(f"AUC Score: {auc:.4f}")

此外,可通过 seaborn 对混淆矩阵进行可视化:

import seaborn as sns

import matplotlib.pyplot as plt

plt.figure(figsize=(6,5))

sns.heatmap(cm, annot=True, fmt='d', cmap='Blues',

xticklabels=['Cat','Dog'], yticklabels=['Cat','Dog'])

plt.title('Confusion Matrix')

plt.ylabel('True Label')

plt.xlabel('Predicted Label')

plt.show()

mermaid格式流程图展示评估指标之间的逻辑关系:

graph TD

A[原始预测输出] --> B{应用阈值}

B --> C[预测类别]

A --> D[概率输出]

C & y_true --> E[混淆矩阵]

E --> F[精确率、召回率、F1]

D & y_true --> G[ROC曲线]

G --> H[AUC值]

F & H --> I[综合评估报告]

7.3 测试集上的综合性能分析

为深入理解模型行为,必须对测试集进行全面剖析。以下是一个包含12个样本的详细性能统计表(模拟数据):

| 图像ID | 真实标签 | 预测标签 | 置信度 | 是否错误 | 错误类型 |

|---|---|---|---|---|---|

| img_001 | Dog | Dog | 0.98 | 否 | - |

| img_002 | Cat | Cat | 0.96 | 否 | - |

| img_003 | Dog | Cat | 0.42 | 是 | FN |

| img_004 | Cat | Dog | 0.73 | 是 | FP |

| img_005 | Cat | Cat | 0.91 | 否 | - |

| img_006 | Dog | Dog | 0.99 | 否 | - |

| img_007 | Cat | Dog | 0.88 | 是 | FP |

| img_008 | Dog | Dog | 0.94 | 否 | - |

| img_009 | Cat | Cat | 0.85 | 否 | - |

| img_010 | Dog | Cat | 0.39 | 是 | FN |

| img_011 | Cat | Cat | 0.97 | 否 | - |

| img_012 | Dog | Dog | 0.93 | 否 | - |

基于上表可得出:

- 总体准确率:8/12 ≈ 66.7%

- 精确率(Dog类):3/(3+2)=60%

- 召回率(Dog类):3/(3+2)=60%

- 存在明显FP倾向:两只猫因毛色相似被误判为狗

进一步分析发现,误判案例多出现在长毛猫与小型犬之间,尤其当背景复杂或姿态非常规时。这提示我们需要增强训练集中此类边缘样本的数量,或引入注意力机制提升局部特征关注度。

同时,可通过绘制预测置信度分布直方图来判断模型是否“过于自信”:

import matplotlib.pyplot as plt

plt.hist(y_pred_proba[y_true == 0], bins=20, alpha=0.7, label='Cats', color='blue')

plt.hist(y_pred_proba[y_true == 1], bins=20, alpha=0.7, label='Dogs', color='red')

plt.axvline(0.5, color='black', linestyle='--')

plt.xlabel('Prediction Probability (Dog)')

plt.ylabel('Frequency')

plt.legend()

plt.title('Confidence Distribution by Class')

plt.show()

7.4 模型部署前的最终验证流程

在正式上线前, evaluateCatOrDog.py 还需支持单张图像的端到端推理测试,以验证部署接口的可用性。以下为封装后的预测函数:

from PIL import Image

import numpy as np

def predict_single_image(image_path, model, target_size=(150, 150)):

"""对单张图像进行预测"""

img = Image.open(image_path).resize(target_size)

img_array = np.array(img) / 255.0

img_array = np.expand_dims(img_array, axis=0) # 添加batch维度

start_time = time.time()

pred = model.predict(img_array, verbose=0)

latency = time.time() - start_time

label = "Dog" if pred[0][0] > 0.5 else "Cat"

confidence = float(pred[0][0]) if label == "Dog" else 1 - float(pred[0][0])

return {

"label": label,

"confidence": round(confidence, 4),

"latency_ms": round(latency * 1000, 2)

}

为确保生产环境可靠性,建议执行以下测试方案:

- 压力测试 :连续输入1000张图像,记录平均推理延迟与内存占用;

- 边界测试 :传入非图像文件、损坏图像、极端尺寸图像;

- 一致性测试 :同一图像多次输入,验证输出稳定性;

- 跨平台测试 :在目标部署设备(如Jetson Nano、手机)上运行验证。

此外,应生成标准化的评估报告 JSON 文件,供后续归档和对比:

{

"model_version": "v2.1.0",

"evaluation_date": "2025-04-05",

"test_set_size": 2000,

"accuracy": 0.923,

"precision_dog": 0.918,

"recall_dog": 0.931,

"f1_dog": 0.924,

"auc_roc": 0.976,

"avg_inference_time_ms": 18.4,

"hardware": "NVIDIA RTX 3060"

}

简介:该项目是一个使用Python编程语言实现的猫狗图像分类系统,核心采用卷积神经网络(CNN)等深度学习技术进行计算机视觉任务。项目包含完整的模型定义、数据预处理、训练流程与模型评估模块,涉及model.py、input_data.py、training.py和evaluateCatOrDog.py等关键文件,涵盖从图像读取、归一化、数据增强到模型训练与性能测试的全流程。适用于希望掌握图像分类实际开发的技术人员和学习者,是深度学习在计算机视觉领域应用的典型实践案例。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)