基于深度学习的图像识别项目实战:从模型训练到部署

深度学习的兴起,为图像识别带来了前所未有的突破,使得模型能够自动学习到复杂的图像特征,从而实现高精度的识别。本文将以 TensorFlow 框架为例,详细介绍如何进行一个完整的图像识别项目,从数据集的准备开始,逐步完成模型的构建、训练、评估,直至最后的部署。这里使用adam优化器,适用于大多数深度学习任务,categorical_crossentropy作为损失函数,适用于多分类问题,accura

引言

图像识别作为计算机视觉领域的核心任务,在众多实际应用中发挥着关键作用,如安防监控、自动驾驶、医疗影像诊断等。深度学习的兴起,为图像识别带来了前所未有的突破,使得模型能够自动学习到复杂的图像特征,从而实现高精度的识别。本文将以 TensorFlow 框架为例,详细介绍如何进行一个完整的图像识别项目,从数据集的准备开始,逐步完成模型的构建、训练、评估,直至最后的部署。

数据集准备

选择合适的数据集

- 公开数据集:

- MNIST:经典的手写数字数据集,包含 60,000 张训练图像和 10,000 张测试图像,常用于图像识别的入门实践。其图像尺寸为 28×28 像素,灰度图,标注清晰,易于处理。

- CIFAR - 10:包含 10 个类别,每个类别有 600 张图像,共计 60,000 张彩色图像。图像尺寸为 32×32 像素,适合用于基础的图像分类研究,涵盖了飞机、汽车、鸟类等常见物体类别。

- ImageNet:大规模图像数据集,拥有超过 1400 万个图像和 2 万多个类别。数据丰富多样,但数据量庞大,对计算资源要求较高,常用于大型图像识别竞赛和前沿研究。

- Caltech 101:包含 101 类图像,每类图像数量从 31 到 800 不等,涵盖多种物体类别,可用于物体识别任务,有助于提升模型在特定领域的识别能力。

- PASCAL VOC:包含 20 个类别,提供了图像及其对应的标注信息,不仅可用于图像分类,在目标检测任务中也广泛应用,对于研究图像中特定物体的识别和定位具有重要价值。

- COCO (Common Objects in Context):包含大量图像和丰富的标注信息,适用于多种计算机视觉任务,如图像分类、目标检测和图像分割。其场景复杂,标注详细,能够更好地模拟真实世界的图像应用场景。

- 这些公开数据集可通过 TensorFlow、PyTorch 等深度学习框架的内置数据集模块直接下载。例如,在 TensorFlow 中,使用以下代码下载 MNIST 数据集:

TypeScript

取消自动换行复制

import tensorflow as tf

(train_images, train_labels), (test_images, test_labels) = tf.keras.datasets.mnist.load_data()

- 自行收集数据集:

- 网络爬虫:利用 Python 的BeautifulSoup、Scrapy等工具从网络上爬取图像。在爬取过程中,需严格遵守网站的使用条款和版权规定。例如,使用Scrapy进行简单图像爬取时,可按照以下步骤编写代码:

- 在spiders目录下创建爬虫文件,如image_spider.py,在其中编写爬虫逻辑,设置起始 URL,解析网页获取图像链接,并下载图像保存到本地。

- 手动收集:通过相机或手机拍摄图像,或从已有的图像资源中筛选。此方式适用于特定场景的数据集收集,如针对特定工业产品、农作物或动物品种创建分类数据集。在手动收集时,需确保图像的质量和多样性,涵盖不同角度、光照条件下的样本。

- 数据合成:

- Blender:一款开源的 3D 建模和渲染软件,可创建逼真的 3D 场景并渲染出图像。例如,在进行汽车图像识别项目时,可利用 Blender 创建不同款式、颜色、角度的汽车模型,并渲染出相应的图像,丰富数据集的多样性。

- OpenCV:可以对现有图像进行合成和变换,如添加噪声、变换视角、调整光照等,生成新的图像样本。通过这些操作,能够增强模型对不同环境和条件下图像的适应能力。例如,使用 OpenCV 的cv2.flip函数对图像进行水平翻转,使用cv2.addWeighted函数调整图像的亮度和对比度等。

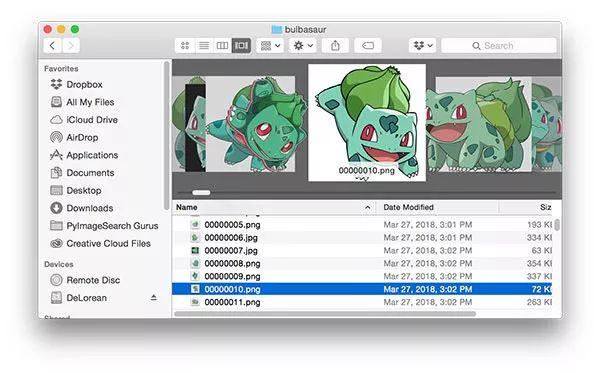

数据清洗

- 去除噪声图像:删除模糊、低质量、标注错误或无关的图像。可以通过视觉检查或使用图像质量评估算法,如计算图像的清晰度(通过梯度幅值等指标)、检查图像的信噪比等方式来判断图像是否为噪声图像。例如,使用 OpenCV 的cv2.Laplacian函数计算图像的拉普拉斯算子,通过其方差来衡量图像的清晰度,设置阈值筛选出清晰度低的图像进行删除。

- 检查标注一致性:确保图像的类别标注准确无误。可以通过人工复查、交叉验证等方式,对标注数据进行审核。例如,在一个包含多个标注人员的团队中,随机抽取一定比例的图像,让不同标注人员进行标注,对比标注结果,对于不一致的标注进行讨论和修正,避免错误标注对模型训练产生不良影响。

数据预处理

- 图像缩放:将图像缩放到统一的尺寸,以满足模型输入的要求。在 TensorFlow 中,可使用tf.image.resize函数实现图像缩放。例如,将图像缩放到 224×224 像素:

TypeScript

取消自动换行复制

import tensorflow as tf

image = tf.random.normal([height, width, channels])

resized_image = tf.image.resize(image, [224, 224])

- 归一化:将图像像素值归一化到 (0, 1) 或 (-1, 1) 范围,以加快模型收敛速度和提高训练稳定性。对于 0 - 255 范围的像素值,可通过除以 255 将其归一化到 (0, 1)。在 TensorFlow 中,如下操作:

TypeScript

取消自动换行复制

train_images = train_images / 255.0

test_images = test_images / 255.0

- 数据增强:通过对现有图像进行变换,如旋转、翻转、裁剪、添加噪声等,扩充数据集,提高模型的泛化能力。在 TensorFlow 中,使用tf.keras.preprocessing.image.ImageDataGenerator进行数据增强。示例代码如下:

TypeScript

取消自动换行复制

from tensorflow.keras.preprocessing.image import ImageDataGenerator

datagen = ImageDataGenerator(

rotation_range = 40,

width_shift_range = 0.2,

height_shift_range = 0.2,

shear_range = 0.2,

zoom_range = 0.2,

horizontal_flip = True,

fill_mode = 'nearest'

)

数据集划分

一般将数据集划分为训练集、验证集和测试集,常见比例为 70:15:15 或 80:10:10。在 TensorFlow 中,可使用tf.data.Dataset或sklearn.model_selection.train_test_split进行划分。以sklearn.model_selection.train_test_split为例:

TypeScript

取消自动换行复制

from sklearn.model_selection import train_test_split

train_images, val_images, train_labels, val_labels = train_test_split(

train_images, train_labels, test_size = 0.15, random_state = 42

)

数据集存储和管理

- 文件存储:将图像存储在文件系统中,使用文件夹结构区分不同类别。例如,对于一个猫狗分类任务,文件结构可以是:

TypeScript

取消自动换行复制

dataset/

cat/

cat_1.jpg

cat_2.jpg

...

dog/

dog_1.jpg

dog_2.jpg

...

- 数据库存储:对于大规模数据集,可考虑使用数据库存储,如 MongoDB 或 PostgreSQL。存储图像的二进制数据和相应的类别标签,利用数据库的查询功能方便地管理和筛选图像。例如,在 MongoDB 中,可将图像数据和标签以文档形式存储,通过编写查询语句进行数据的检索和管理。

模型构建与训练

构建模型

以 TensorFlow 和 Keras 为例,构建一个简单的卷积神经网络(CNN)用于图像识别:

TypeScript

取消自动换行复制

from tensorflow.keras import layers, models

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(224, 224, 3)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(num_classes, activation='softmax')

])

此模型结构中,首先通过两层卷积层和池化层提取图像特征,然后将特征展平,通过全连接层进行分类。num_classes为数据集中的类别数,需根据实际情况进行设置。

编译模型

在训练模型之前,需要编译模型,指定优化器、损失函数和评估指标:

TypeScript

取消自动换行复制

model.compile(optimizer='adam',

loss='categorical_crossentropy',

metrics=['accuracy'])

这里使用adam优化器,适用于大多数深度学习任务,categorical_crossentropy作为损失函数,适用于多分类问题,accuracy作为评估指标用于衡量模型的预测准确率。

训练模型

使用划分好的训练集和验证集对模型进行训练:

TypeScript

取消自动换行复制

history = model.fit(train_images, train_labels,

epochs = 10,

validation_data=(val_images, val_labels))

epochs表示训练的轮数,每一轮训练模型都会遍历一次训练集。在训练过程中,模型会不断调整参数,以最小化损失函数。同时,通过验证集来评估模型的性能,防止过拟合。训练过程中的损失值和准确率等指标会保存在history对象中,可用于后续分析。

模型评估

评估指标

常用的图像识别模型评估指标包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)和 F1 值。

- 准确率:模型预测正确的样本数占总样本数的比例,计算公式为:

Accuracy=TP+TN+FP+FNTP+TN

,其中TP

(True Positive)为真正例,即实际为正样本且被模型预测为正样本的数量;TN

(True Negative)为真反例;FP

(False Positive)为假正例;FN

(False Negative)为假反例。

- 精确率:预测为正样本且实际为正样本的样本数占预测为正样本的样本数的比例,

Precision=TP+FPTP

。

- 召回率:实际为正样本且被模型预测为正样本的样本数占实际为正样本的样本数的比例,

Recall=TP+FNTP

。

- F1 值:综合考虑精确率和召回率的指标,

F1=2×Precision+RecallPrecision×Recall

。

评估方法

使用测试集对训练好的模型进行评估:

TypeScript

取消自动换行复制

test_loss, test_acc = model.evaluate(test_images, test_labels)

print('Test accuracy:', test_acc)

通过model.evaluate方法,模型会在测试集上运行,并返回测试损失和测试准确率。还可以进一步计算精确率、召回率和 F1 值,使用scikit - learn库中的classification_report函数:

TypeScript

取消自动换行复制

from sklearn.metrics import classification_report

y_pred = model.predict(test_images).argmax(axis = 1)

print(classification_report(test_labels.argmax(axis = 1), y_pred))

该函数会输出每个类别的精确率、召回率、F1 值等详细评估报告。

模型部署

选择部署平台

- 移动端:如 Android 和 iOS 系统。对于 Android,可使用 TensorFlow Lite 将训练好的模型转换为适合移动端运行的格式。通过在 Android 项目中集成 TensorFlow Lite 库,加载模型并进行推理。对于 iOS,可使用 Core ML 框架,将 TensorFlow 模型转换为 Core ML 模型格式,然后在 iOS 应用中调用模型进行图像识别。

- Web 端:利用 TensorFlow.js 将模型部署到网页上。通过将模型转换为 JavaScript 格式,在网页中使用 JavaScript 代码加载模型并处理用户上传的图像进行识别。这种方式方便用户在浏览器中直接使用图像识别功能,无需安装额外的应用程序。

- 服务器端:可部署在云服务器(如阿里云、腾讯云等)或本地服务器上。在服务器端运行模型,接收客户端发送的图像请求,进行识别后将结果返回给客户端。例如,使用 Flask 或 Django 框架搭建 Web 服务,接收图像数据,调用训练好的模型进行预测,并将预测结果以 JSON 格式返回给客户端。

模型转换与优化

- 模型量化:将模型中的权重和激活值从较高精度的数据类型(如 32 位浮点数)转换为较低精度的数据类型(如 8 位整数),以减少模型的存储空间和计算量,提高推理速度。在 TensorFlow 中,可使用tf.lite.TFLiteConverter进行模型量化。例如,进行整数量化的代码如下:

TypeScript

取消自动换行复制

converter = tf.lite.TFLiteConverter.from_saved_model(saved_model_dir)

converter.optimizations = [tf.lite.Optimize.DEFAULT]

converter.target_spec.supported_ops = [tf.lite.OpsSet.TFLITE_BUILTINS_INT8]

converter.inference_input_type = tf.int8

converter.inference_output_type = tf.int8

tflite_quant_model = converter.convert()

- 剪枝:去除模型中不重要的连接或神经元,减小模型规模,同时不显著影响模型性能。在 TensorFlow 中,可通过一些开源库或自定义代码实现模型剪枝。例如,使用tf.contrib.model_pruning库,按照其文档指引进行模型剪枝操作,在训练过程中逐渐去除不重要的权重连接,生成剪枝后的模型。

部署流程

以服务器端部署为例,使用 Flask 框架搭建 Web 服务的步骤如下:

- 安装依赖库:安装 Flask、TensorFlow 等相关库。

- 创建 Flask 应用:编写 Python 代码创建 Flask 应用,定义接收图像请求的路由。

TypeScript

取消自动换行复制

from flask import Flask, request, jsonify

import tensorflow as tf

import numpy as np

from PIL import Image

app = Flask(__name__)

model = tf.keras.models.load_model('trained_model.h5')

@app.route('/predict', methods=['POST'])

def predict():

file = request.files['image']

img = Image.open(file.stream)

img = img.resize((224, 224))

img = np.array(img) / 255.0

img = np.expand_dims(img, axis = 0)

prediction = model.predict(img).argmax(axis = 1)

return jsonify({'prediction': int(prediction[0])})

if __name__ == '__main__':

app.run(debug=True)

- 运行应用:启动 Flask 应用,服务器开始监听客户端请求。客户端可通过 HTTP 请求将图像数据发送到服务器,服务器接收图像后进行预处理,调用训练好的模型进行预测,并将预测结果返回给客户端。

总结

通过以上步骤,我们完成了一个基于深度学习的图像识别项目从模型训练到部署的全过程。在数据集准备阶段,要精心选择、清洗、预处理和划分数据集,为模型训练提供高质量的数据。模型构建与训练时,根据任务需求设计合适的模型结构,选择恰当的优化器和损失函数进行训练。模型评估阶段,使用多种评估指标全面衡量模型性能。最后在部署阶段,根据应用场景选择合适的部署平台,并对模型进行转换与优化,确保模型能够高效运行。通过不断实践和优化,能够开发出满足实际需求的图像识别应用系统。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)