深度学习神经网络学习路线:从入门到精通

本文为初学者提供了一份系统的深度学习神经网络学习路线,涵盖从基础知识到实战应用的全面指导。首先,强调了数学和编程基础的重要性,包括线性代数、概率论、微积分以及Python编程和常用库的使用。接着,介绍了神经网络的基本概念和入门实践,如手写数字识别项目。进阶部分深入探讨了卷积神经网络(CNN)、循环神经网络(RNN)及其优化算法。实战阶段则通过图像识别、自然语言处理和生成对抗网络(GAN)等复杂项目

深度学习作为人工智能领域的重要分支,近年来在图像识别、自然语言处理、语音识别等众多领域取得了巨大的突破。而神经网络则是深度学习的核心技术之一。对于初学者来说,如何系统地学习深度学习神经网络是一个关键问题。本文将为你提供一份详细的学习路线,帮助你从入门到精通,逐步掌握深度学习神经网络的精髓。

一、基础知识储备

(一)数学基础

-

线性代数

-

矩阵运算(加法、乘法、转置等)

-

特征值与特征向量

-

向量空间与线性变换

-

推荐学习资源:《线性代数及其应用》(David C. Lay)

-

-

概率论与数理统计

-

概率分布(二项分布、正态分布等)

-

随机变量与期望

-

最大似然估计

-

推荐学习资源:《概率论与数理统计》(陈希孺)

-

-

微积分

-

导数与梯度

-

多元微积分

-

泰勒展开

-

推荐学习资源:《托马斯微积分》(Thomas' Calculus)

-

(二)编程基础

-

Python语言

-

基本语法(变量、数据类型、控制流等)

-

函数与模块

-

面向对象编程

-

推荐学习资源:Python官方文档、《Python编程从入门到实践》(Eric Matthes)

-

-

常用库

-

NumPy(数值计算)

-

Pandas(数据分析)

-

Matplotlib(数据可视化)

-

推荐学习资源:NumPy官方文档、Pandas官方文档、Matplotlib官方文档

-

二、入门阶段:理解神经网络的基本概念

(一)神经网络基础

-

神经元模型

-

生物神经元与人工神经元

-

激活函数(Sigmoid、ReLU、Tanh等)

-

推荐学习资源:吴恩达《机器学习》课程

-

-

多层神经网络

-

前馈神经网络

-

反向传播算法

-

梯度下降优化

-

推荐学习资源:斯坦福大学CS231n课程、《深度学习》(Ian Goodfellow等著)

-

(二)实践项目

-

手写数字识别

-

使用TensorFlow或PyTorch构建一个简单的神经网络模型,实现对手写数字的识别。

-

推荐数据集:MNIST数据集

-

示例代码:

Python复制

import tensorflow as tf from tensorflow.keras import layers, models # 加载数据集 (train_images, train_labels), (test_images, test_labels) = tf.keras.datasets.mnist.load_data() # 数据预处理 train_images = train_images.reshape((60000, 28, 28, 1)).astype("float32") / 255 test_images = test_images.reshape((10000, 28, 28, 1)).astype("float32") / 255 # 构建模型 model = models.Sequential() model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1))) model.add(layers.MaxPooling2D((2, 2))) model.add(layers.Flatten()) model.add(layers.Dense(64, activation='relu')) model.add(layers.Dense(10, activation='softmax')) # 编译模型 model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy']) # 训练模型 model.fit(train_images, train_labels, epochs=5, batch_size=64) # 评估模型 test_loss, test_acc = model.evaluate(test_images, test_labels) print(f"Test accuracy: {test_acc}")

-

三、进阶阶段:深入理解神经网络架构与优化

(一)卷积神经网络(CNN)

-

卷积层与池化层

-

卷积操作的原理

-

池化操作的作用

-

不同类型的卷积(标准卷积、深度可分离卷积等)

-

推荐学习资源:斯坦福大学CS231n课程

-

-

经典CNN架构

-

LeNet、AlexNet、VGGNet、ResNet等

-

推荐学习资源:《深度学习》(Ian Goodfellow等著)、ResNet论文

-

(二)循环神经网络(RNN)

-

RNN的基本原理

-

序列数据的处理

-

长短期记忆网络(LSTM)与门控循环单元(GRU)

-

推荐学习资源:Andrej Karpathy的博客

-

-

自然语言处理中的应用

-

语言模型、文本生成、机器翻译

-

推荐学习资源:斯坦福大学CS224n课程

-

(三)优化算法

-

梯度下降的变体

-

随机梯度下降(SGD)、动量优化、Adagrad、Adam等

-

推荐学习资源:《深度学习》(Ian Goodfellow等著)

-

-

正则化技术

-

L1/L2正则化、Dropout、Batch Normalization

-

推荐学习资源:吴恩达《深度学习专项课程》

-

四、实战阶段:构建复杂项目与解决实际问题

(一)图像识别与分类

-

数据增强与迁移学习

-

使用数据增强技术提升模型的泛化能力

-

迁移学习在小数据集上的应用

-

示例代码:

Python复制

from tensorflow.keras.preprocessing.image import ImageDataGenerator from tensorflow.keras.applications import VGG16 from tensorflow.keras import layers, models # 数据增强 train_datagen = ImageDataGenerator( rescale=1./255, rotation_range=20, width_shift_range=0.2, height_shift_range=0.2, shear_range=0.2, zoom_range=0.2, horizontal_flip=True, fill_mode='nearest') # 加载预训练模型 base_model = VGG16(weights='imagenet', include_top=False, input_shape=(224, 224, 3)) # 冻结预训练模型的权重 base_model.trainable = False # 构建模型 model = models.Sequential() model.add(base_model) model.add(layers.Flatten()) model.add(layers.Dense(256, activation='relu')) model.add(layers.Dropout(0.5)) model.add(layers.Dense(10, activation='softmax')) # 编译模型 model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy']) # 训练模型 train_generator = train_datagen.flow_from_directory( 'path/to/train/directory', target_size=(224, 224), batch_size=32, class_mode='sparse') model.fit(train_generator, epochs=10)

-

(二)自然语言处理

-

文本分类与情感分析

-

使用LSTM或BERT进行文本分类

-

示例代码:

Python复制

import tensorflow as tf from tensorflow.keras.preprocessing.text import Tokenizer from tensorflow.keras.preprocessing.sequence import pad_sequences # 准备数据 texts = ["I love this movie", "This is a bad movie"] labels = [1, 0] tokenizer = Tokenizer(num_words=10000) tokenizer.fit_on_texts(texts) sequences = tokenizer.texts_to_sequences(texts) data = pad_sequences(sequences, maxlen=100) # 构建模型 model = tf.keras.Sequential([ tf.keras.layers.Embedding(input_dim=10000, output_dim=64, input_length=100), tf.keras.layers.LSTM(64), tf.keras.layers.Dense(1, activation='sigmoid') ]) # 编译模型 model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy']) # 训练模型 model.fit(data, labels, epochs=10)

-

(三)生成对抗网络(GAN)

-

GAN的基本原理

-

生成器与判别器的对抗训练

-

推荐学习资源:Goodfellow的GAN论文

-

-

图像生成应用

-

使用GAN生成手写数字或人脸图像

-

示例代码:

Python复制

import tensorflow as tf from tensorflow.keras import layers # 生成器 def make_generator_model(): model = tf.keras.Sequential() model.add(layers.Dense(7*7*256, use_bias=False, input_shape=(100,))) model.add(layers.BatchNormalization()) model.add(layers.LeakyReLU()) model.add(layers.Reshape((7, 7, 256))) model.add(layers.Conv2DTranspose(128, (5, 5), strides=(1, 1), padding='same', use_bias=False)) model.add(layers.BatchNormalization()) model.add(layers.LeakyReLU()) model.add(layers.Conv2DTranspose(64, (5, 5), strides=(2, 2), padding='same', use_bias=False)) model.add(layers.BatchNormalization()) model.add(layers.LeakyReLU()) model.add(layers.Conv2DTranspose(1, (5, 5), strides=(2, 2), padding='same', use_bias=False, activation='tanh')) return model # 判别器 def make_discriminator_model(): model = tf.keras.Sequential() model.add(layers.Conv2D(64, (5, 5), strides=(2, 2), padding='same', input_shape=[28, 28, 1])) model.add(layers.LeakyReLU()) model.add(layers.Dropout(0.3)) model.add(layers.Conv2D(128, (5, 5), strides=(2, 2), padding='same')) model.add(layers.LeakyReLU()) model.add(layers.Dropout(0.3)) model.add(layers.Flatten()) model.add(layers.Dense(1)) return model generator = make_generator_model() discriminator = make_discriminator_model() # 定义GAN的训练过程 cross_entropy = tf.keras.losses.BinaryCrossentropy(from_logits=True) def discriminator_loss(real_output, fake_output): real_loss = cross_entropy(tf.ones_like(real_output), real_output) fake_loss = cross_entropy(tf.zeros_like(fake_output), fake_output) total_loss = real_loss + fake_loss return total_loss def generator_loss(fake_output): return cross_entropy(tf.ones_like(fake_output), fake_output) generator_optimizer = tf.keras.optimizers.Adam(1e-4) discriminator_optimizer = tf.keras.optimizers.Adam(1e-4) # 训练GAN EPOCHS = 50 noise_dim = 100 num_examples_to_generate = 16 seed = tf.random.normal([num_examples_to_generate, noise_dim]) @tf.function def train_step(images): noise = tf.random.normal([BATCH_SIZE, noise_dim]) with tf.GradientTape() as gen_tape, tf.GradientTape() as disc_tape: generated_images = generator(noise, training=True) real_output = discriminator(images, training=True) fake_output = discriminator(generated_images, training=True) gen_loss = generator_loss(fake_output) disc_loss = discriminator_loss(real_output, fake_output) gradients_of_generator = gen_tape.gradient(gen_loss, generator.trainable_variables) gradients_of_discriminator = disc_tape.gradient(disc_loss, discriminator.trainable_variables) generator_optimizer.apply_gradients(zip(gradients_of_generator, generator.trainable_variables)) discriminator_optimizer.apply_gradients(zip(gradients_of_discriminator, discriminator.trainable_variables)) for epoch in range(EPOCHS): for image_batch in train_dataset: train_step(image_batch)

-

五、高级阶段:研究前沿技术与创新应用

(一)Transformer架构

-

Transformer的基本原理

-

自注意力机制

-

编码器-解码器架构

-

-

BERT与GPT系列

(二)强化学习与深度学习的结合

-

强化学习基础

-

状态、动作、奖励

-

Q-learning、Policy Gradient

-

推荐学习资源:David Silver的强化学习课程

-

-

AlphaGo与AlphaFold

-

深度强化学习在游戏与生物医学中的应用

-

推荐学习资源:AlphaGo论文、AlphaFold论文

-

(三)深度学习在计算机视觉与自然语言处理中的前沿应用

-

计算机视觉

-

3D视觉、多模态学习、视觉问答(VQA)

-

推荐学习资源:CVPR、ICCV、ECCV会议论文

-

-

自然语言处理

-

对话系统、文本生成、跨语言学习

-

推荐学习资源:ACL、NAACL、EMNLP会议论文

-

六、总结

深度学习神经网络的学习之路虽然充满挑战,但只要按照系统的路线逐步学习,从基础知识到实际应用,再到前沿研究,你一定能够掌握这一强大的技术。希望本文为你提供了一份清晰的学习指南,祝你在深度学习的道路上越走越远!

希望这篇文章对你有帮助!如果你对某些部分有更详细的需求,比如增加代码示例或特定技术的讲解,随时告诉我!

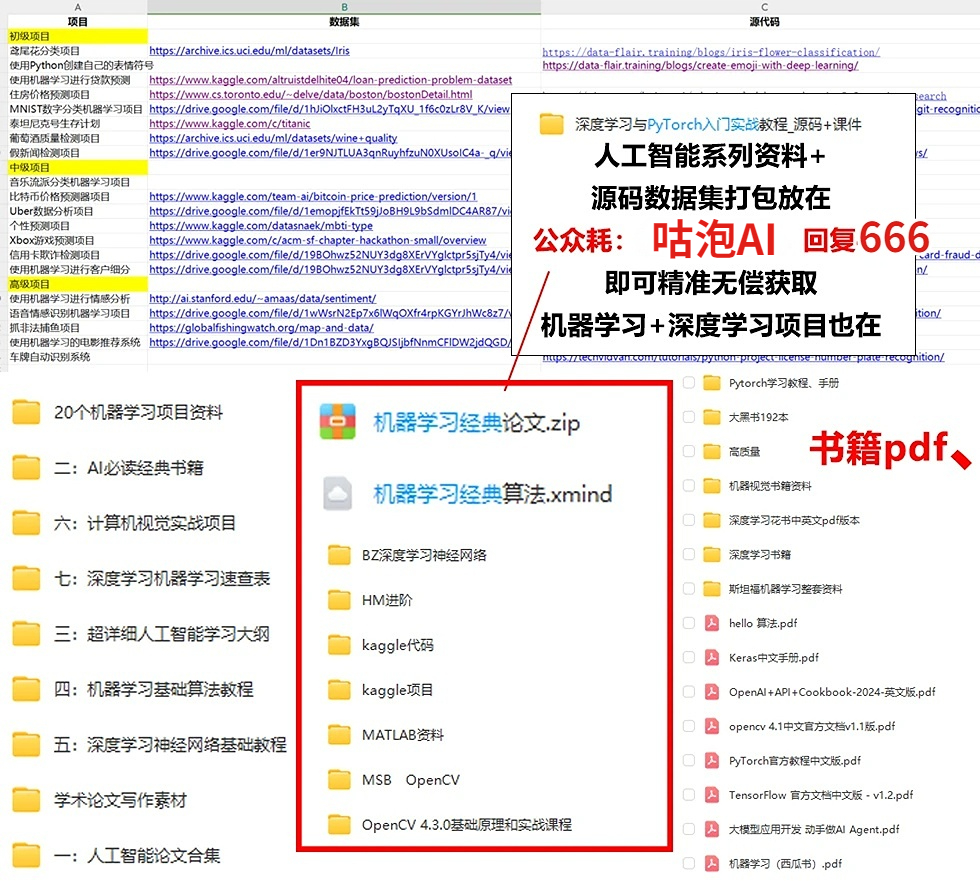

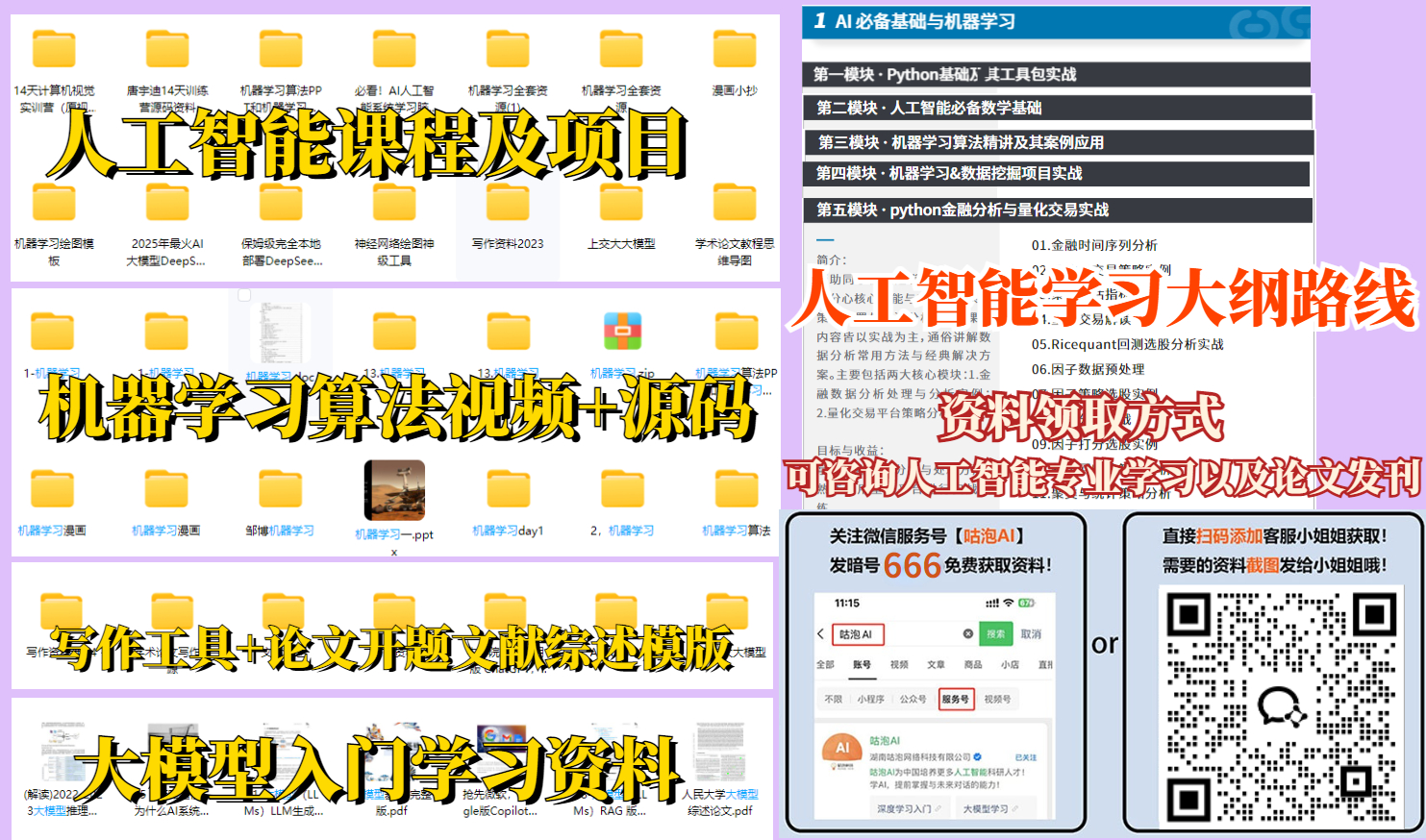

免费分享一些我整理的人工智能学习资料给大家,包括一些AI常用框架实战视频、图像识别、OpenCV、NLQ、机器学习、pytorch、计算机视觉、深度学习与神经网络等视频、课件源码、国内外知名精华资源、AI热门论文、行业报告等。

为了更好的系统学习AI,推荐大家收藏一份。

一、人工智能课程及项目

二、国内外知名精华资源

三、人工智能论文合集

四、人工智能行业报告

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)