深度学习与人工智能简史

Transformer 模型是由Vaswani 等人(2017) 在开创性论文“”中提出的。该模型放弃了传统的 RNN 顺序处理,转而采用自注意力机制,从而实现并行处理并更好地处理长距离依赖关系。自注意力机制(来源Sohl-Dickstein 等人 (2015) 在其论文中介绍了扩散模型,奠定了基础。他们概念化了一个生成过程,通过逆转逐渐增加的噪声可以将噪声重新转换为结构化数据。Transform

深度学习与人工智能简史

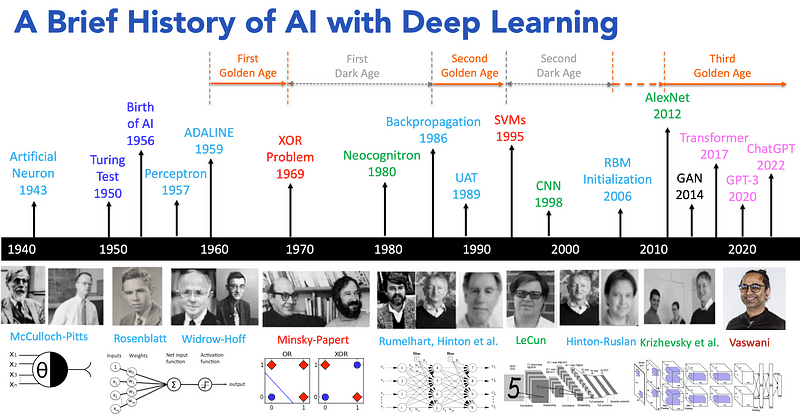

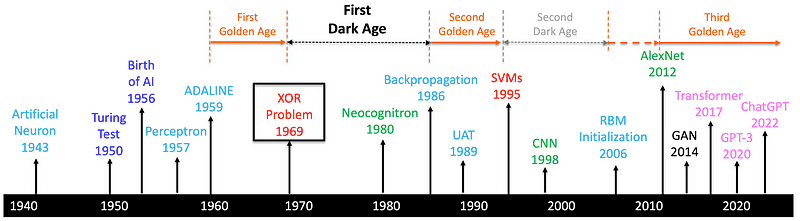

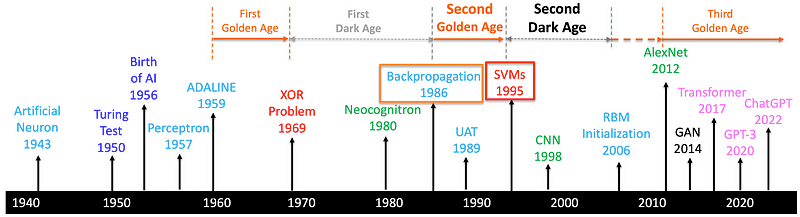

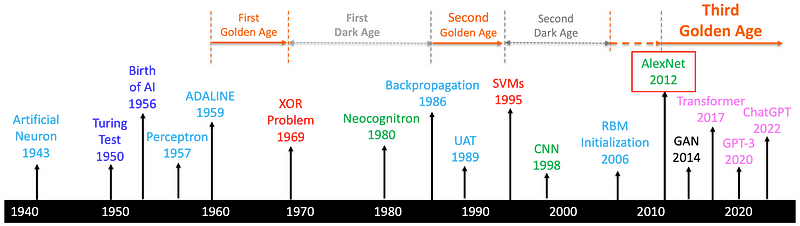

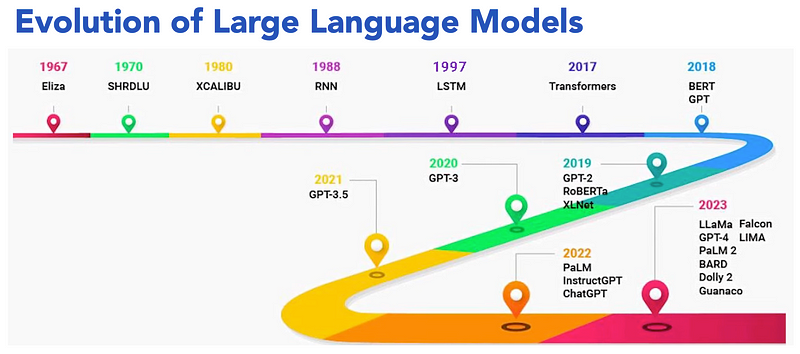

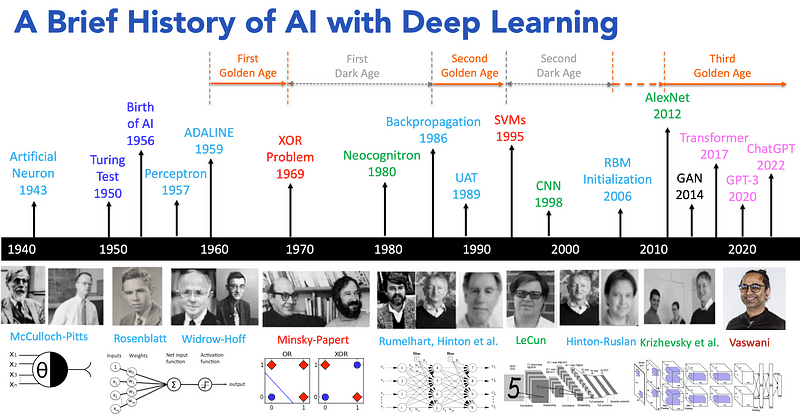

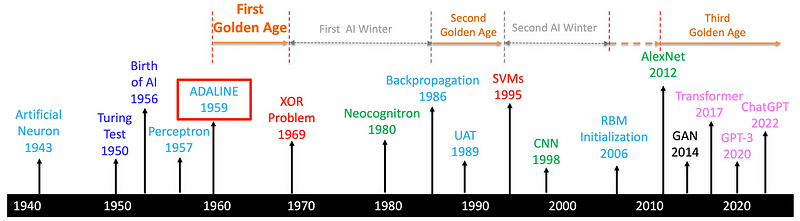

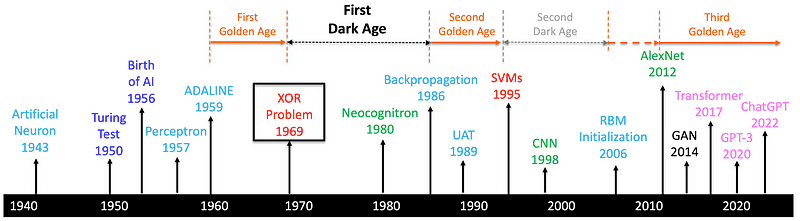

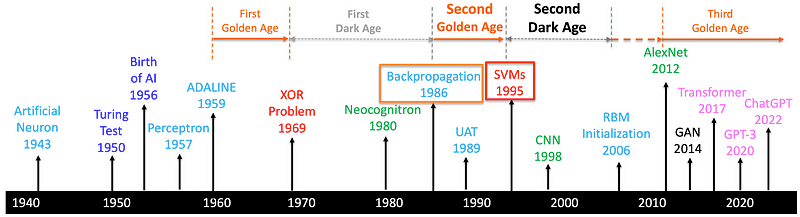

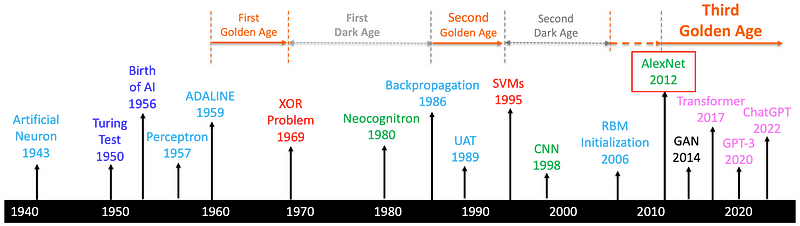

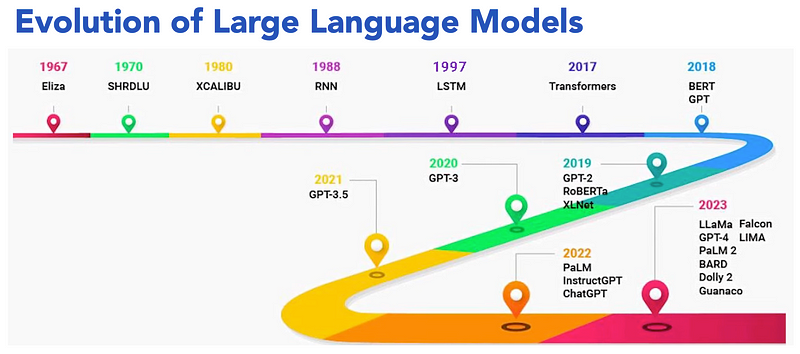

人工智能 (AI) 和深度学习在过去几十年中取得了显著进展,改变了计算机视觉、自然语言处理和机器人等领域。本文概述了人工智能历史上使用深度学习的重要里程碑,从早期的神经网络模型到现代的大型语言模型和多模态人工智能系统。

1.人工智能的诞生(1956年)

人工智能 (AI) 的概念已经存在了几个世纪,但我们今天所知道的现代人工智能领域是在 20 世纪中叶开始形成的。“人工智能”一词最早是由计算机科学家和认知科学家约翰·麦卡锡于 1956 年在达特茅斯人工智能夏季研究项目中创造的。

达特茅斯会议通常被认为是人工智能研究领域的发源地。会议汇集了一群计算机科学家、数学家和认知科学家,探讨创造能够模拟人类智能的机器的可能性。与会者包括马文·明斯基、纳撒尼尔·罗切斯特和克劳德·香农等著名人物。

马文·明斯基、克劳德·香农、雷·所罗门诺夫和其他科学家在达特茅斯人工智能夏季研究项目中(图片:玛格丽特·明斯基)来源

1.1 人工智能的演变:从基于规则的系统到深度学习

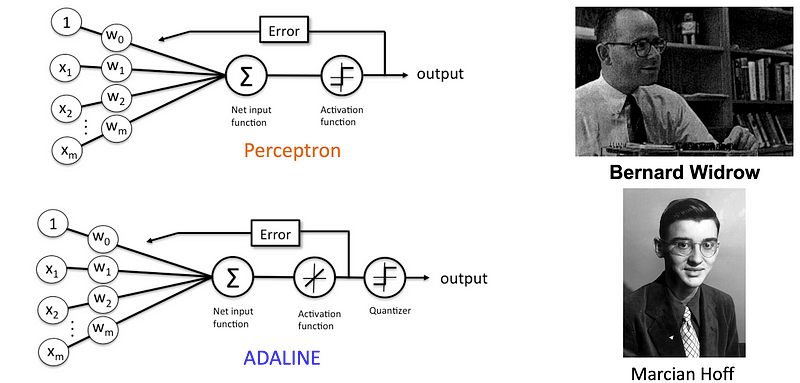

人工智能的发展始于 20 世纪 50 年代,当时出现了用于国际象棋和解决问题等任务的算法,第一个人工智能程序 Logical Theorist 于 1956 年诞生。20 世纪 60 年代和 70 年代引入了基于规则的专家系统,例如 MYCIN,它可以协助复杂的决策过程。20 世纪 80 年代出现了机器学习,它使人工智能系统能够从数据中学习并随着时间的推移不断改进,为现代深度学习技术奠定了基础。

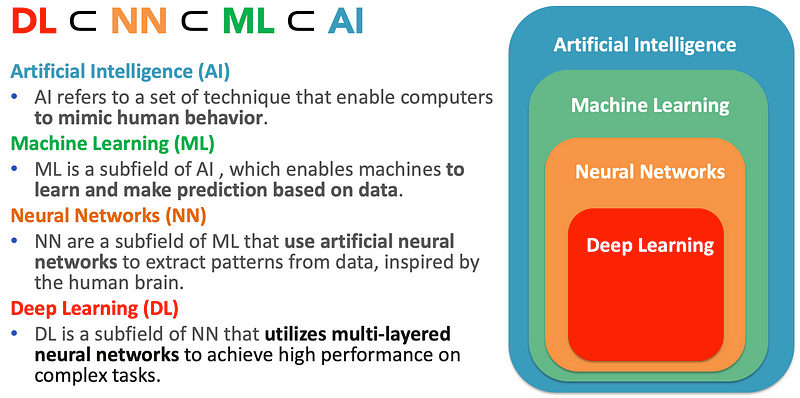

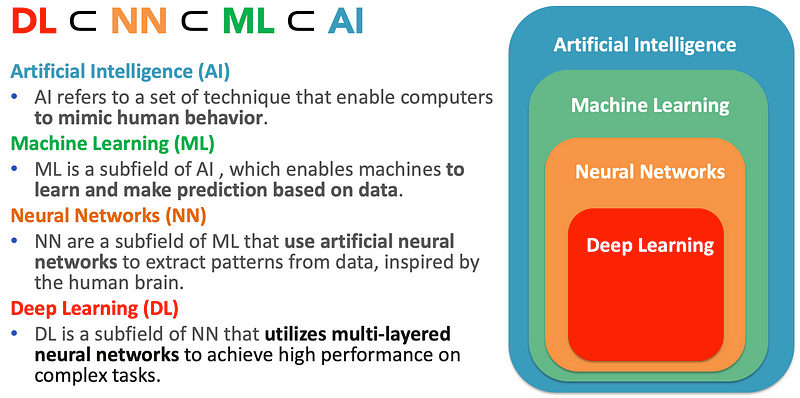

如今,大多数尖端人工智能技术都由深度学习技术驱动,这些技术已经改变了人工智能的格局。深度学习是机器学习的一个专门分支,它利用多层人工神经网络从原始输入数据中提取复杂特征。在本文中,我们将探索人工智能的历史,重点介绍深度学习在其发展中的作用。

2.早期人工神经网络(20 世纪 40 年代 - 20 世纪 60 年代)

2.1 Muclloch-Pitts神经元(1943年)

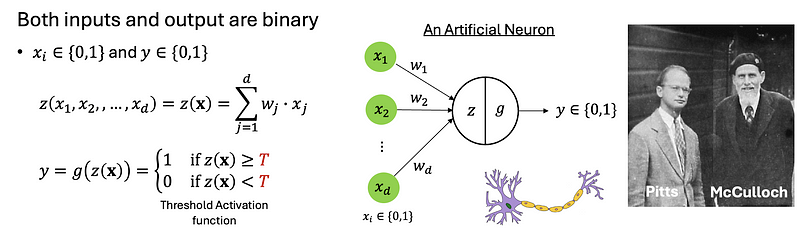

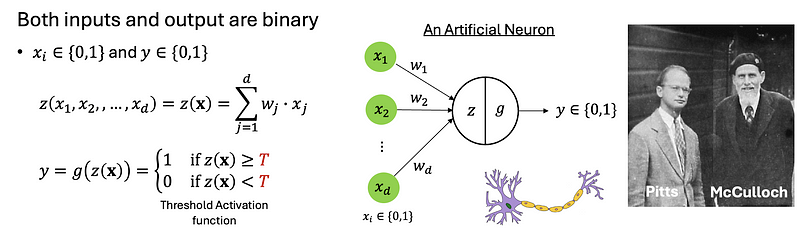

神经网络的概念可以追溯到 1943 年,当时 Warren McCulloch 和 Walter Pitts 提出了第一个人工神经元模型。McCulloch-Pitts (MP) 神经元模型是对生物神经元的突破性简化。该模型通过聚合二进制输入并使用阈值激活函数根据此聚合做出决策,从而产生二进制输出 {0, 1},为人工神经网络奠定了基础。

这个简化模型抓住了神经元行为的本质——接收多个输入,整合它们,并根据整合信号是否超过阈值产生二进制输出。尽管 MP 神经元模型很简单,但它能够实现基本的逻辑运算,展示了神经计算的潜力。

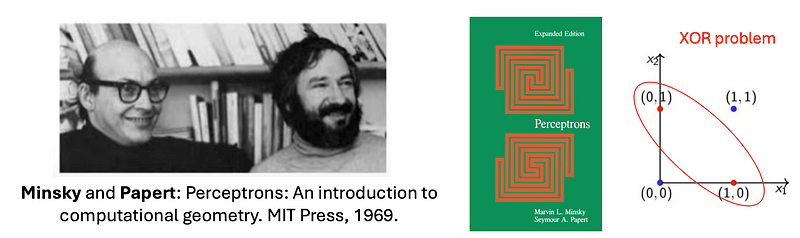

2.2 罗森布拉特的感知器模型(1957)

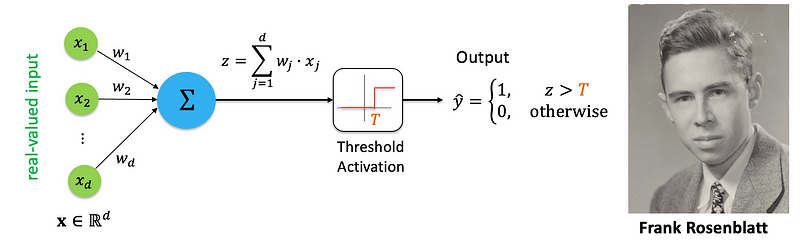

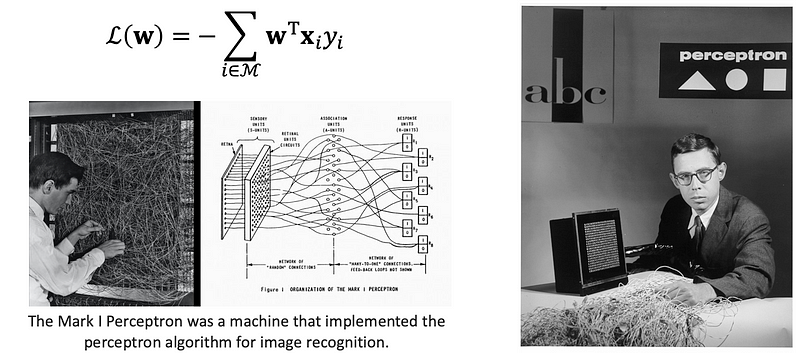

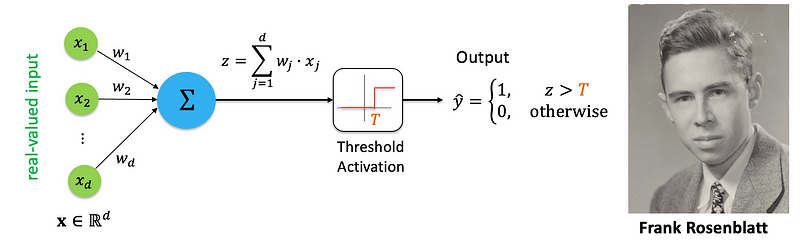

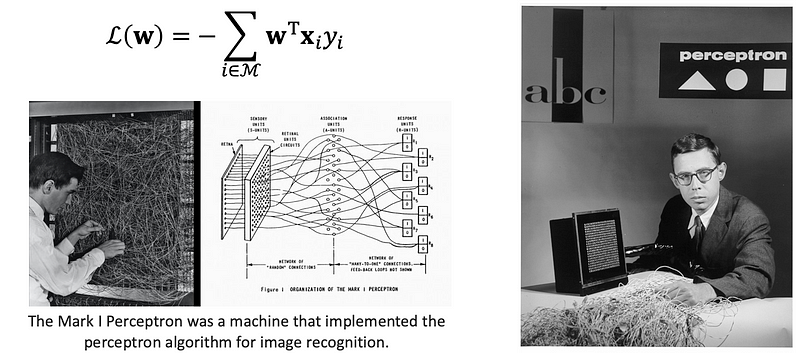

1957 年,弗兰克·罗森布拉特 (Frank Rosenblatt) 发明了感知器,这是一种能够学习和识别模式的单层神经网络。感知器模型是一种比 MP 神经元更通用的计算模型,旨在处理实值输入并调整权重以最大限度地减少分类错误。

罗森布拉特还为感知器开发了一种监督学习算法,使得网络可以直接从训练数据中学习。

罗森布拉特雄心勃勃地宣称感知器具有识别个体和翻译语言的潜力,这在当时引起了公众对人工智能的极大兴趣。感知器模型及其相关学习算法标志着神经网络发展的重要里程碑。然而,一个关键的限制很快就显现出来:感知器的学习规则在呈现非线性可分离训练数据时无法收敛。

2.3 艾达琳(1959)

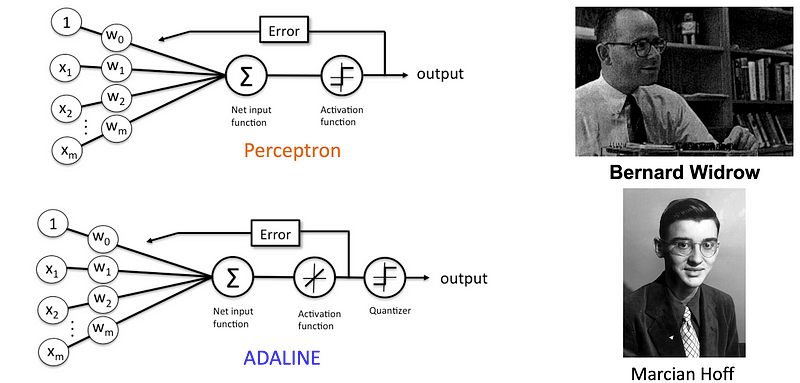

1959 年,Widrow 和 Hoff提出了ADALINE(自适应线性神经元,又称 Delta 学习规则),这是对感知器学习规则的改进。ADALINE 解决了二进制输出和噪声敏感性等限制,并且可以学习和收敛非线性可分离数据,这是神经网络开发的一个重大突破。

ADALINE 的主要功能包括:

- 线性激活函数:与感知器的阶跃函数不同,ADALINE 使用线性激活函数,使其适用于回归任务和连续输出。

- 最小均方 (LMS) 算法:ADALINE 采用 LMS 算法,最小化预测输出和实际输出之间的均方误差,提供更高效、更稳定的学习过程。

- 自适应权重:LMS 算法根据输出中的误差自适应地调整权重,使得 ADALINE 即使在存在噪声的情况下也能够有效地学习和收敛。

ADALINE 的推出标志着神经网络第一个黄金时代的开始,它克服了罗森布拉特感知器学习的局限性。这一突破实现了高效学习、连续输出和对噪声数据的适应,引发了该领域的创新浪潮和快速进步。

然而,与感知器一样,ADALINE 仍然局限于线性可分离问题,**无法解决更复杂和非线性的任务。**这一限制后来被 XOR 问题凸显出来,从而导致了更先进的神经网络架构的发展。

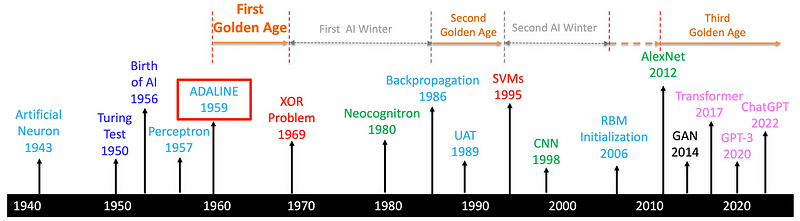

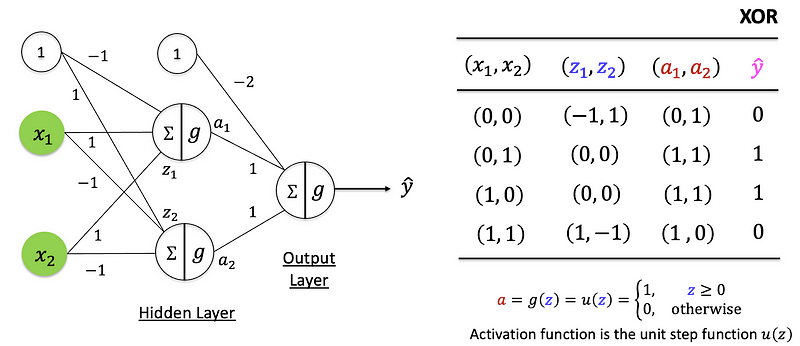

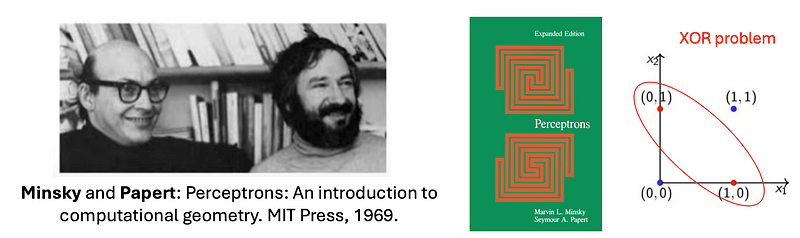

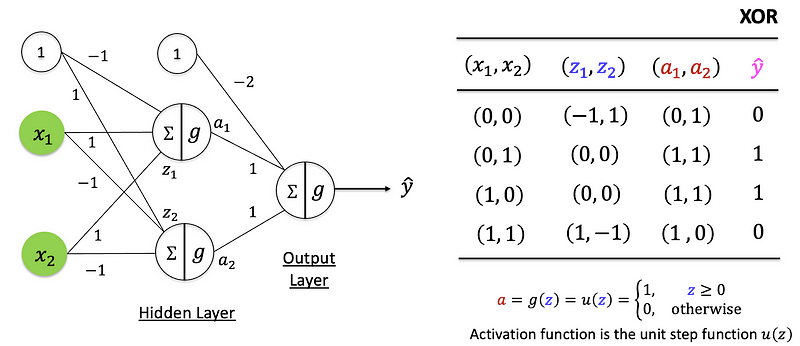

2.4 异或问题(1969)

1969 年,Marvin Minsky 和 Seymour Papert 在他们的著作《感知器》中强调了单层感知器的一个关键限制。他们证明,由于感知器的决策边界是线性的,它无法解决异或 (XOR) 问题(一个简单的二元分类任务)。XOR 问题不是线性可分的,这意味着没有一个线性边界可以正确地对所有输入模式进行分类。

这一发现强调了对更复杂的神经网络架构的需求,这些架构能够学习非线性决策边界。感知器局限性的暴露导致人们对神经网络失去信心,并转向符号人工智能方法,标志着从 20 世纪 70 年代初到 80 年代中期的“神经网络第一个黑暗时代”的开始。

神经网络的第一个黑暗时代。

然而,从解决 XOR 问题中获得的见解使研究人员认识到需要更复杂的模型来捕捉非线性关系。这一认识最终导致了多层感知器和其他高级神经网络模型的发展,为后来几十年神经网络和深度学习的复兴奠定了基础。

3.多层感知器(20 世纪 60 年代)

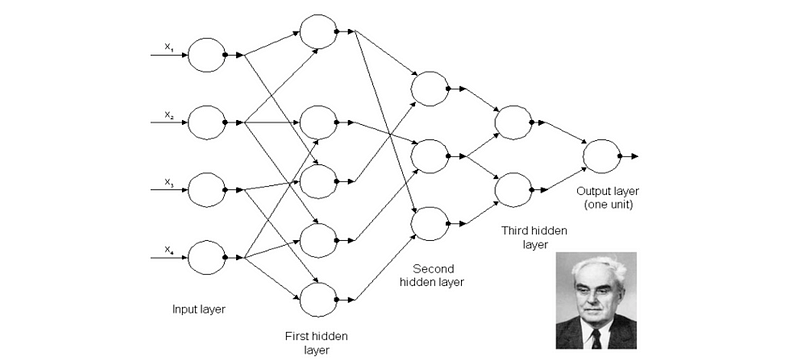

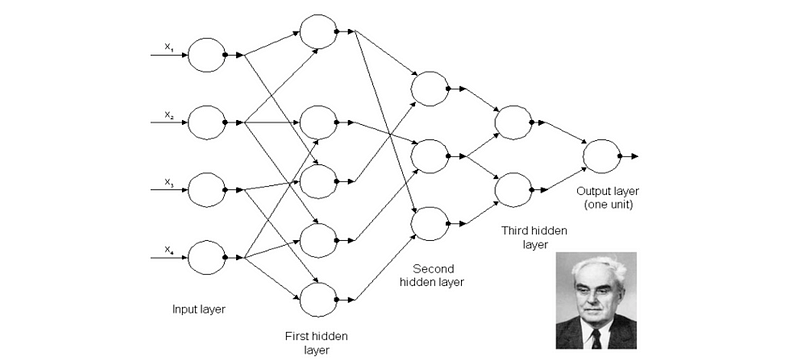

多层感知器 (MLP) 于 20 世纪 60 年代推出,是对单层感知器的改进。它由多层互连的神经元组成,可以解决单层模型的局限性。苏联科学家AG Ivakhnenko 和 V. Lapa在感知器的基础工作的基础上,为 MLP 的开发做出了重大贡献。

3.1 隐藏层

添加隐藏层使 MLP 能够捕获和表示数据中复杂的非线性关系。这些隐藏层显著增强了网络的学习能力,使其能够解决非线性可分的问题,例如 XOR 问题。

3.2 MLP 的历史背景和挑战

MLP 标志着神经网络研究的重大进步,展示了深度学习架构在解决复杂问题方面的潜力。然而,在 20 世纪 60 年代和 70 年代,MLP 的发展受到了以下几个挑战的阻碍:

- 缺乏训练算法:早期的 MLP 模型缺乏有效的训练算法,无法有效地调整网络的权重。缺乏反向传播使得训练多层深度网络变得困难。

- 计算限制:当时的计算能力不足以处理训练深度神经网络所需的复杂计算。这一限制减缓了 MLP 研发的进度。

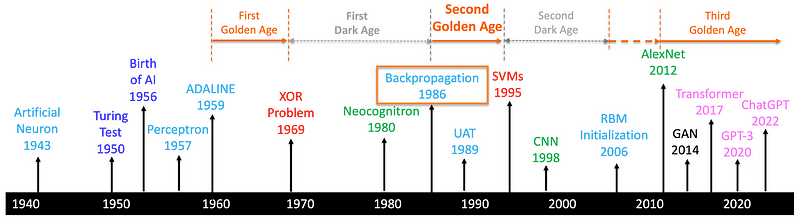

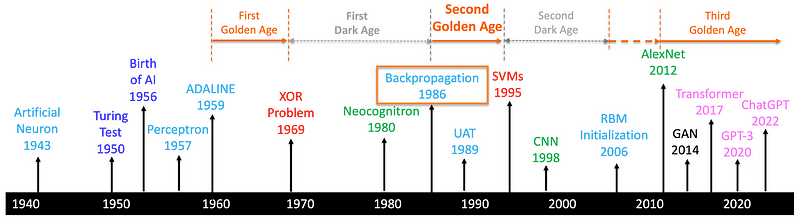

神经网络的第一个黑暗时代于 1986 年随着反向传播算法的重新发现和发表而结束,从而开启了神经网络的第二个黄金时代。

神经网络的第二个黄金时代。

4.反向传播(1970年代-1980年代)

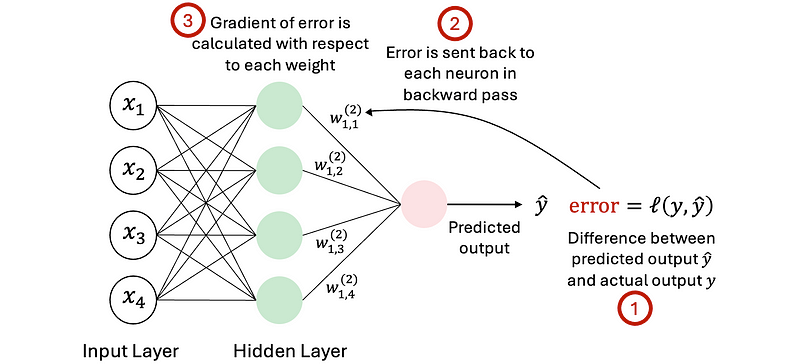

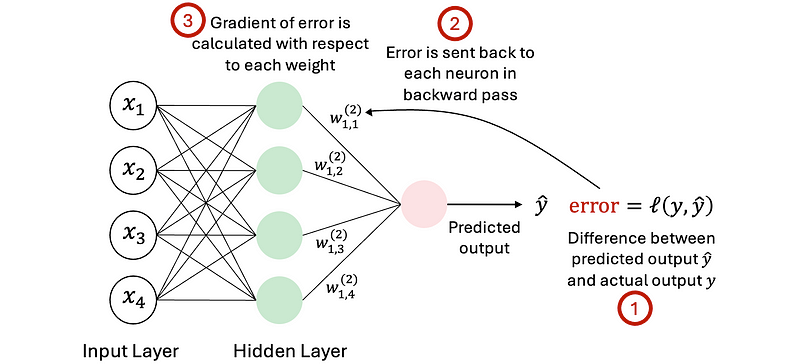

1969 年,XOR 问题凸显了感知器(单层神经网络)的局限性。研究人员意识到多层神经网络可以克服这些局限性,但他们缺乏一种实用的算法来训练这些复杂的网络。反向传播算法花了 17 年的时间才开发出来,使神经网络在理论上能够近似任何函数。有趣的是,后来人们发现,该算法实际上是在发表之前就被发明出来的。如今,反向传播是深度学习的一个基本组成部分,自 20 世纪 60 年代和 70 年代诞生以来,它经历了重大的进步和改进。

4.1 早期发展(20 世纪 70 年代)

- Seppo Linnainmaa (1970):引入了自动微分的概念,这是反向传播算法的关键组成部分。

- Paul Werbos (1974):提出使用微积分的链式法则来计算误差函数关于网络权重的梯度,从而实现多层神经网络的训练。

4.2 细化与普及(20 世纪 80 年代)

- David Rumelhart、Geoffrey Hinton 和 Ronald Williams (1986):提出反向传播作为一种训练深度神经网络的实用而有效的方法,并展示了其在各种问题中的应用。

4.3 反向传播的主要特点:

- 梯度下降:反向传播与梯度下降结合使用,以最小化误差函数。该算法计算网络中每个权重的误差梯度,从而允许迭代更新权重以减少误差。

- 链式法则:反向传播算法的核心是应用微积分的链式法则。该法则允许将误差的梯度分解为一系列偏导数,这些偏导数可以通过网络的反向传播有效地计算出来。

- 分层计算:反向传播以逐层方式运行,从输出层开始向后工作到输入层。这种分层计算可确保梯度在网络中正确传播,从而实现深度架构的训练。

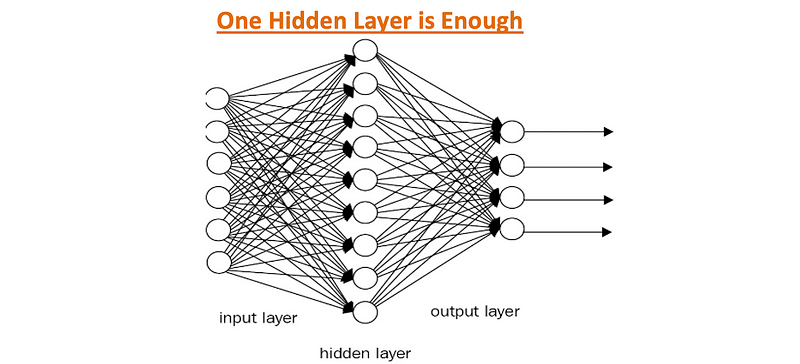

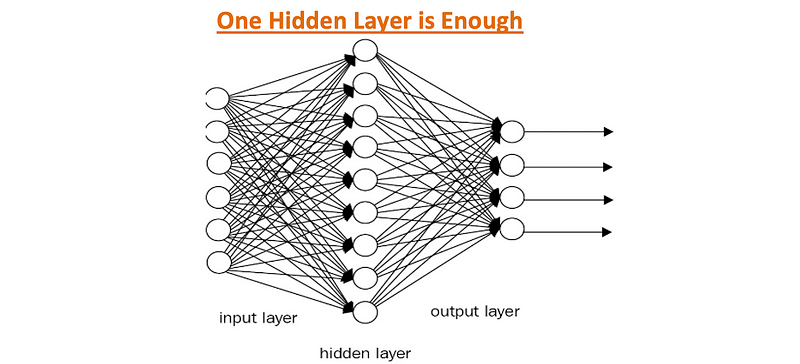

4.5 通用逼近定理(1989)

乔治·西本科 (George Cybenko) 于 1989 年提出的通用近似定理为多层神经网络的功能提供了数学基础。该定理指出,**在给定足够多的神经元并使用非线性激活函数的情况下,具有单个隐藏层的前馈神经网络可以将任何连续函数近似到任意精度。**该定理强调了神经网络的强大功能和灵活性,使其适用于广泛的应用。

具有单个隐藏层的多层神经网络可以将任何连续函数近似到任何所需的精度,从而能够解决各个领域的复杂问题。

4.6 第二个黄金时代(20 世纪 80 年代末 — 90 年代初)

反向传播和通用近似定理 (UAT) 的发展标志着神经网络的第二个黄金时代的开始。反向传播提供了一种训练多层神经网络的有效方法,使研究人员能够训练更深、更复杂的模型。UAT 为使用多层神经网络提供了理论依据,并增强了人们对其解决复杂问题能力的信心。这一时期跨越 20 世纪 80 年代末至 90 年代初,人们对该领域的兴趣重新燃起,并取得了重大进展。

4.7 第二次黑暗时代(20 世纪 90 年代初 — 21 世纪初)

然而,由于以下几个因素,神经网络领域在 20 世纪 90 年代初至 21 世纪初经历了“第二个黑暗时代”:

- 支持向量机(SVM)的兴起,为分类和回归任务提供了一种数学上优雅的方法。

- 计算限制,因为训练深度神经网络仍然耗时且需要大量硬件。

- 过度拟合和泛化问题,早期的神经网络在训练数据上表现良好,但在未知数据上表现不佳,这使得它们在实际应用中的可靠性较低。

这些挑战导致许多研究人员将注意力从神经网络转移,导致该领域陷入停滞。

4.8 深度学习的复兴(2000 年代末至今):

神经网络领域在 2000 年代末和 2010 年代初经历了复兴,推动力包括:

- 深度学习架构(CNN、RNN、Transformers、扩散模型)

- 硬件(GPU、TPU、LPU)

- 大型数据集(ImageNet、COCO、OpenWebText、WikiText 等)

- 训练算法(SGD、Adam、dropout)

这些进步推动了计算机视觉、自然语言处理、语音识别和强化学习领域的重大突破。通用近似定理与实践进步相结合,为深度学习技术的广泛采用和成功铺平了道路。

5.卷积神经网络(1980 年代 - 2010 年代)

卷积神经网络 (CNN) 极大地改变了深度学习的格局,尤其是在计算机视觉和图像处理领域。从 20 世纪 80 年代到 21 世纪 10 年代,CNN 的发展反映了架构、训练技术和应用方面的重大进步。

5.1 早期发展(1989-1998)

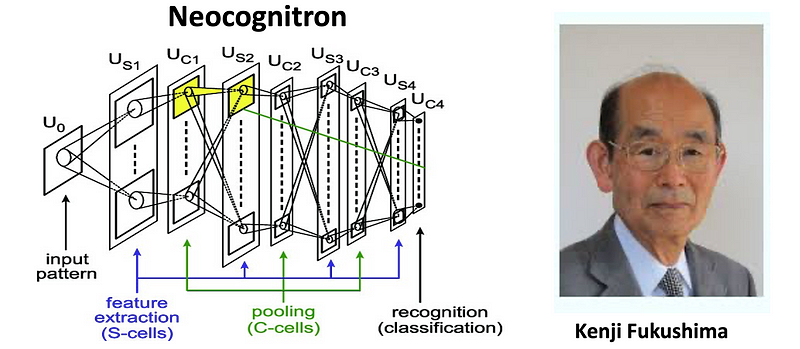

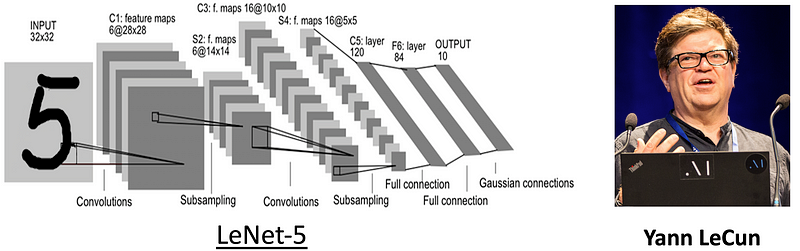

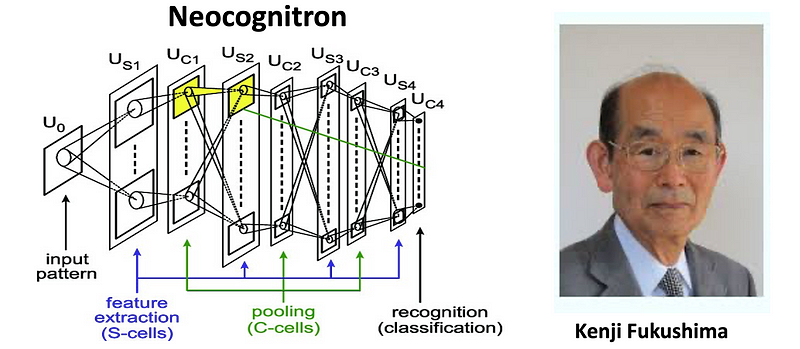

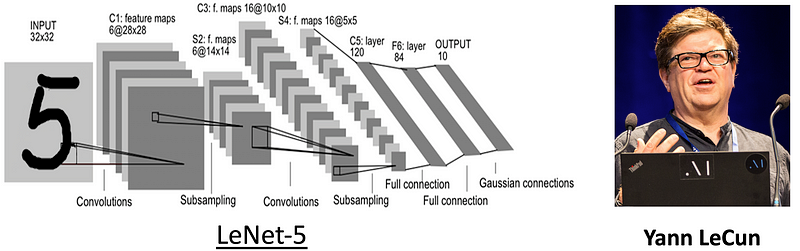

CNN 的概念最早由福岛健二在 20 世纪 80 年代提出,他提出了Neocognitron,这是一种模仿人类视觉皮层结构的分层神经网络。这项开创性的工作为 CNN 的发展奠定了基础。20 世纪 80 年代末和 90 年代初,Yann LeCun 和他的团队进一步开发了 CNN,推出了专为手写数字识别而设计的LeNet-5架构。

5.2 CNN 的关键组件

CNN 由三个关键组件构成:

- 卷积层:这些层通过应用一组可学习的过滤器自动从输入图像中学习特征的空间层次结构。

- 池化层:池化层减少了输入的空间维度,增强了对变化的鲁棒性并减少了计算负荷。

- 全连接层:在卷积层和池化层之后,全连接层用于分类任务,整合从先前层学习到的特征。

5.3 CNN 的主要特点

- 局部感受野:CNN 使用局部感受野来捕获输入数据中的局部模式,使其对于图像和视觉任务非常有效。

- 共享权重:在卷积层中使用共享权重减少了网络中的参数数量,使其更高效且更易于训练。

- **平移不变性:**池化层引入了平移不变性,使得网络能够识别模式,而不管其在输入图像中的位置。

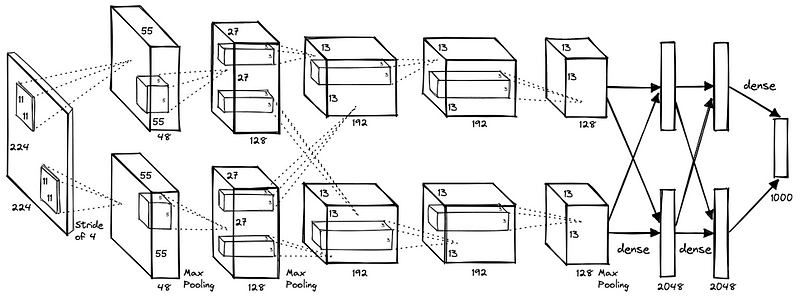

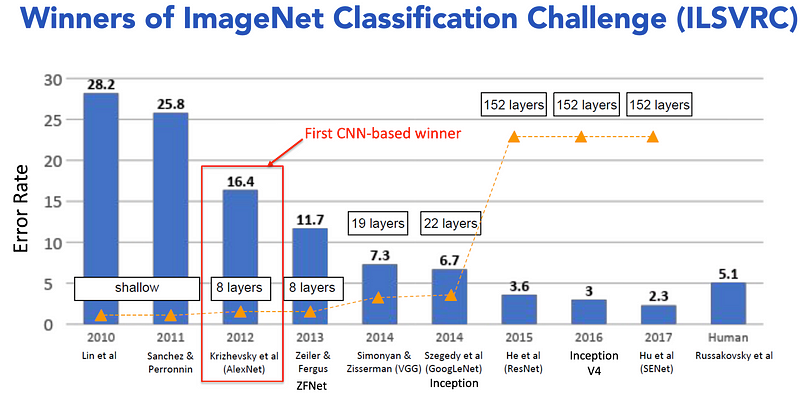

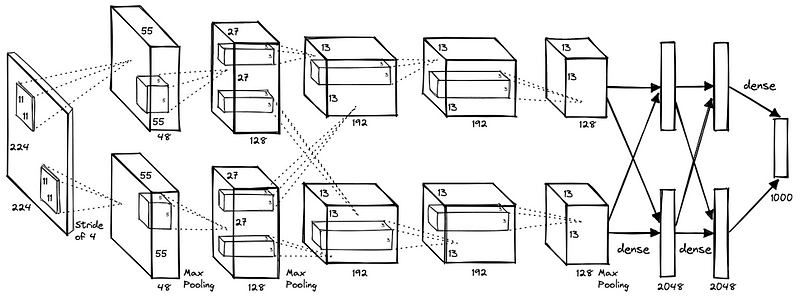

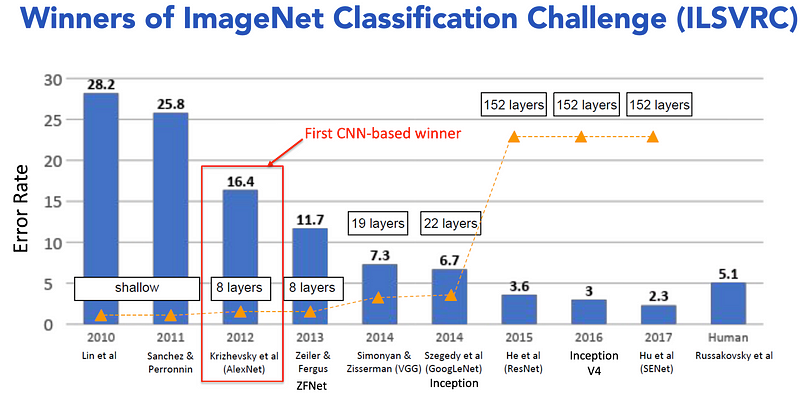

5.4 CNN 的崛起:AlexNet 的影响(2012 年)

2012年,CNN发展迎来了重要的里程碑:AlexNet在ImageNet大规模视觉识别挑战赛(ILSVRC)中脱颖而出,取得了显著的胜利,标志着图像分类领域取得了重大突破。

AlexNet 的架构(2012)

ILSVRC 是一项年度图像识别基准测试,它基于包含 1000 多万张带注释图像的数据集评估算法,这些图像分为 1000 个类别。AlexNet 的创新包括:

- ReLU 激活函数:ReLU 是为了克服传统激活函数的问题而引入的,它可以加快训练速度并提高性能。

- 丢弃正则化:该技术通过在训练期间随机删除单元来减少过度拟合。

- 数据增强:通过人为增加训练数据的多样性,对训练数据集的增强提高了泛化能力。

AlexNet 的成功标志着 CNN 发展的一个转折点,为图像分类和物体检测的进一步发展铺平了道路。

AlexNet 开启神经网络的第三个黄金时代

当前的黄金时代(2010 年代至今)以深度学习、大数据和强大计算平台的融合为标志。这个时代在图像识别、自然语言处理和机器人技术方面取得了显著突破。正在进行的研究继续推动人工智能能力的边界。

AlexNet 开启神经网络的第三个黄金时代。

5.5 后续架构

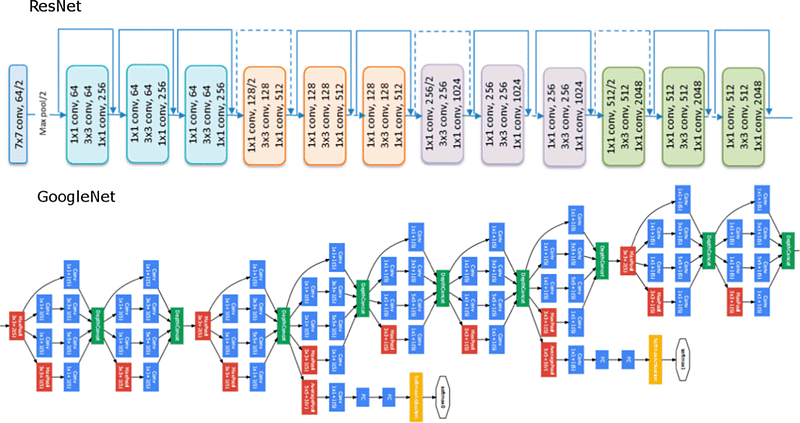

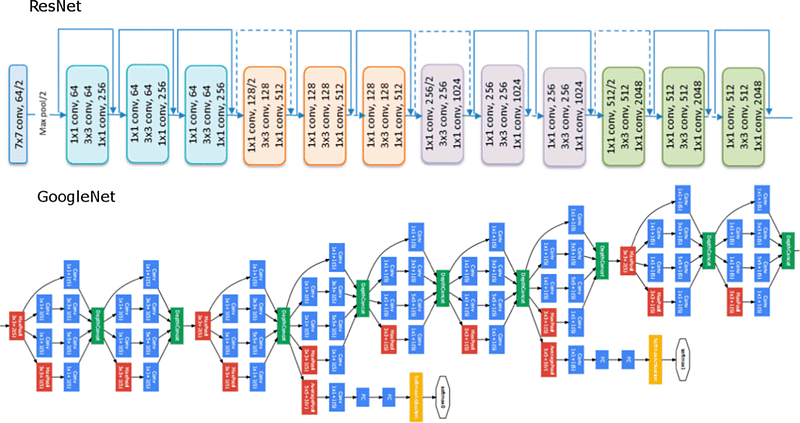

继 AlexNet 之后,出现了几种有影响力的架构:

- VGGNet(2014):VGGNet 由牛津大学视觉几何小组开发,强调更深的架构和更小的卷积滤波器(3x3),实现了非凡的准确性。

- GoogLeNet/Inception(2014):引入了 Inception 模块,使网络能够有效地捕获多尺度特征。

- ResNet(2015):残差网络引入了跳过连接,使得非常深的网络的训练成为可能,同时缓解了梯度消失问题。

ResNet 和 GoogeNet 架构

5.6 CNN 的应用

CNN 的进步彻底改变了各个领域:

- 计算机视觉:CNN 已成为现代计算机视觉的支柱,推动了图像分类、对象检测和语义分割方面的突破。

- 医学成像:CNN 用于疾病诊断、肿瘤检测和图像引导手术等任务,显著提高诊断准确性。

- 自动驾驶汽车:CNN 是自动驾驶汽车感知系统不可或缺的一部分,使它们能够解读和响应周围环境。

CNN 的计算机视觉应用。

CNN 从诞生到如今成为深度学习基石的历程表明了其对 AI 的深远影响。CNN 的成功也为深度学习的进一步发展铺平了道路,并启发了其他专用神经网络架构(如 RNN 和 Transformers)的发展。CNN 的理论基础和实践创新为深度学习技术在各个领域的广泛采用和成功做出了重大贡献。

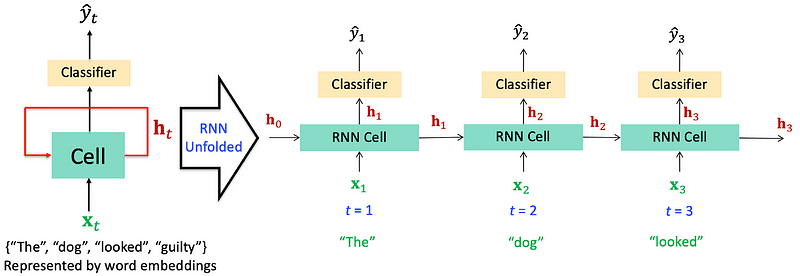

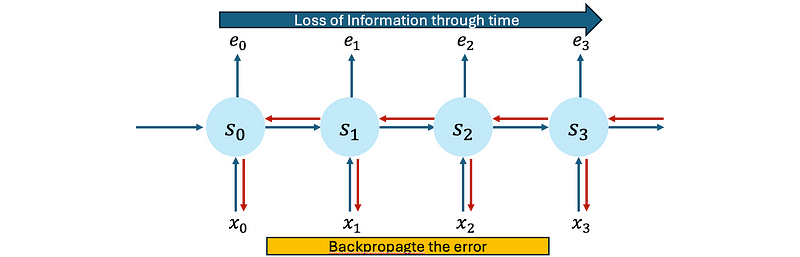

6.循环神经网络(1986-2017)

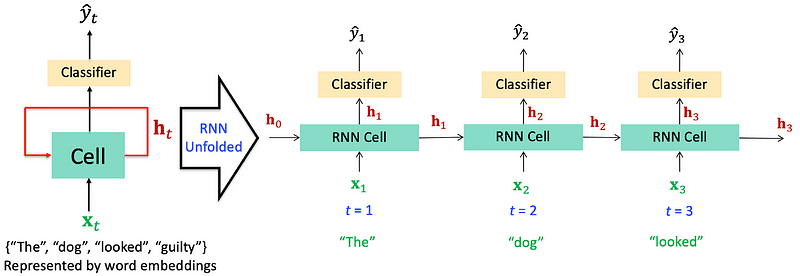

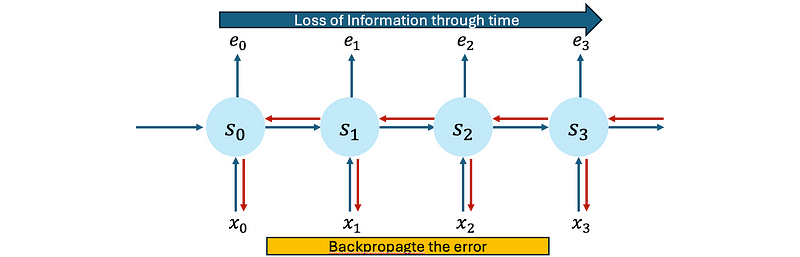

循环神经网络 (RNN) 是一种强大的架构,可用于处理顺序和时间数据。与前馈神经网络不同,RNN 旨在处理输入序列,因此对于语言建模、时间序列预测和语音识别等任务特别有效。

6.1 早期发展(20 世纪 80 年代 - 90 年代)

RNN 的概念可以追溯到 20 世纪 80 年代,John Hopfield、Michael I. Jordan 和 Jeffrey L. Elman 等先驱为这些网络的发展做出了贡献。John Hopfield 于 1982 年提出的 Hopfield 网络为理解神经网络中的循环连接奠定了基础。Jordan 网络和 Elman 网络分别于 20 世纪 80 年代和 90 年代提出,是捕捉序列数据中时间依赖关系的早期尝试。

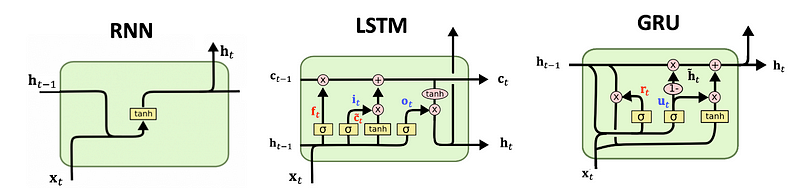

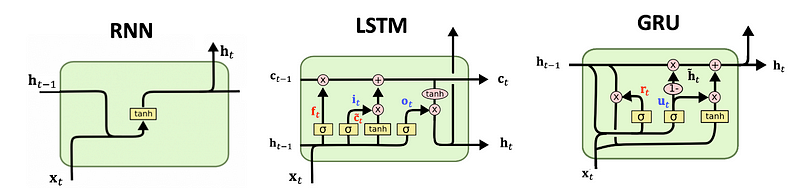

6.2 LSTM、GRU 和 Seq2Seq 模型(1997 — 2014)

- 长短期记忆 (LSTM) 网络 (1997):Sepp Hochreiter 和 Jürgen Schmidhuber 引入了长短期记忆 (LSTM) 网络,解决了传统 RNN 中的梯度消失问题。LSTM 使用门控机制来控制信息流,从而使其能够捕获序列数据中的长期依赖关系。

- 门控循环单元 (GRU) (2014):Kyunghyun Cho 等人提出了门控循环单元 (GRU),这是 LSTM 的简化版本,也使用门控机制来控制信息流。GRU 的参数比 LSTM 少,并且训练速度通常更快。

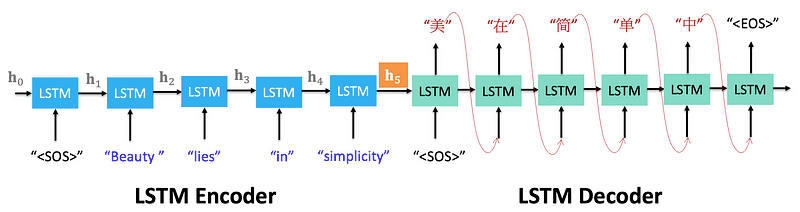

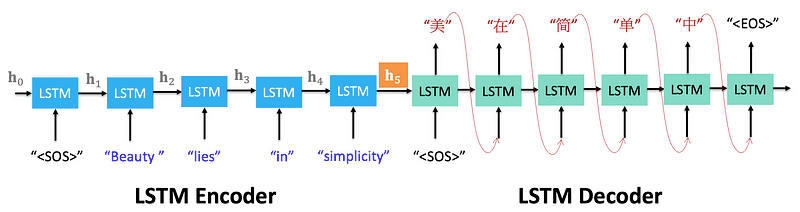

- 序列到序列模型 (Seq2Seq) (2014):Ilya Sutskever 和他的团队提出了 Seq2Seq 模型,该模型使用编码器-解码器架构将输入序列映射到输出序列。该模型已广泛用于机器翻译、语音识别和文本摘要等任务。

6.3 RNN 循环连接的主要特点:

RNN 使用循环连接来维持隐藏状态,以捕获来自先前时间步骤的信息。这使得网络能够对顺序数据中的时间依赖性进行建模。

- 随时间反向传播 (BPTT):RNN 使用反向传播的变体(称为随时间反向传播 (BPTT))进行训练,它会随时间展开循环网络,并将标准反向传播算法应用于展开的网络。

- 门控机制:先进的 RNN 架构,例如 LSTM 和 GRU,使用门控机制来控制信息流,有助于缓解梯度消失问题并使网络能够捕获长期依赖关系。

6.4 RNN 应用

RNN 对各个领域产生了重大影响,其中包括:

- 自然语言处理:RNN 彻底改变了自然语言处理领域,推动了语言建模、机器翻译、情感分析和文本生成等任务的重大进步。

- 语音识别:RNN 广泛应用于语音识别系统,它们对口语中的时间依赖性进行建模,以将语音信号转换为文本。

- 时间序列预测:RNN 适用于时间序列预测,它们对序列数据中的时间依赖性进行建模以预测未来值。

6.5 RNN 的挑战

尽管取得了成功,RNN 仍面临着一些挑战:

- 梯度消失和梯度爆炸:尽管 LSTM 和 GRU 提供了一些解决方案,但传统的 RNN 仍难以解决这些问题。

- 计算复杂性:训练 RNN 可能需要大量资源,尤其是在处理大型数据集时。

- 并行化:RNN 的顺序特性使得并行训练和推理过程变得复杂。

RNN 的成功为深度学习的进一步发展铺平了道路,并激发了其他专用神经网络架构(如 Transformers)的发展,这些架构在各种顺序数据任务中都取得了最佳性能。RNN 的理论基础和实践创新为深度学习技术在各个领域的广泛采用和成功做出了重大贡献。

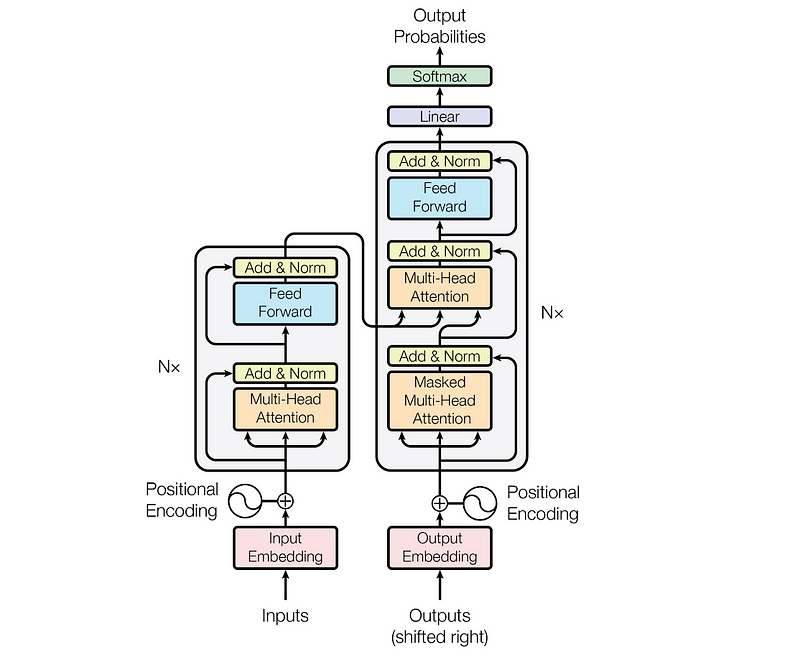

7.《变形金刚》(2017 年至今)

Transformer 凭借其处理序列数据的卓越能力彻底改变了深度学习的格局,并成为从自然语言处理 (NLP) 到计算机视觉等许多领域的关键。

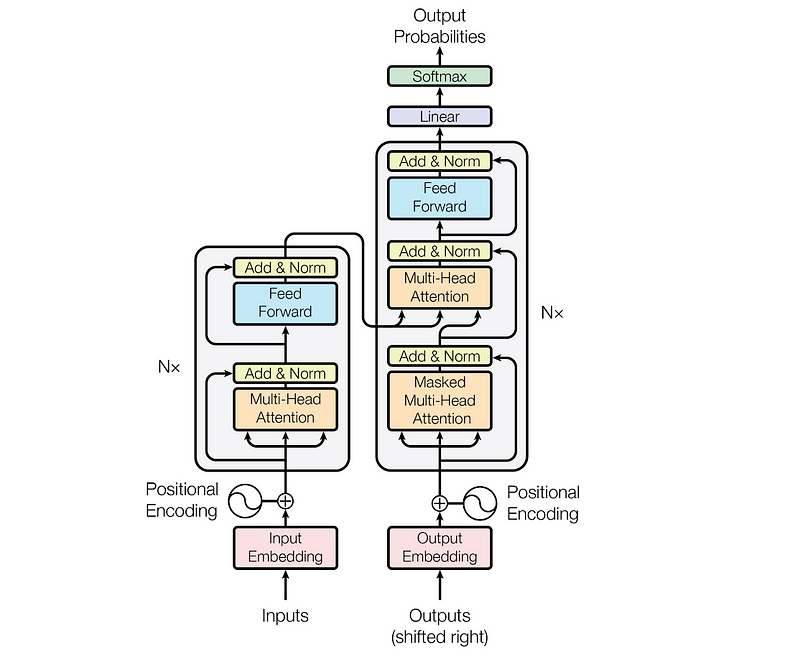

7.1 Transformer 简介(2017)

Transformer 模型是由Vaswani 等人(2017) 在开创性论文“ Attention is All You Need ”中提出的。该模型放弃了传统的 RNN 顺序处理,转而采用自注意力机制,从而实现并行处理并更好地处理长距离依赖关系。

自注意力机制(来源)

7.2 Transformer 的主要特点

- 自注意力机制:允许序列中的每个位置关注所有位置,从而比 RNN 或 LSTM 更灵活地捕获上下文。

- 并行化:通过同时处理所有输入数据来提高训练速度,这与 RNN 的顺序性形成鲜明对比。

- **编码器-解码器结构:**编码器和解码器堆栈都利用自注意力和前馈神经网络层,并使用位置编码来维持序列顺序。

具有编码器-解码器结构和多头注意力机制的原始 Transformer 架构。

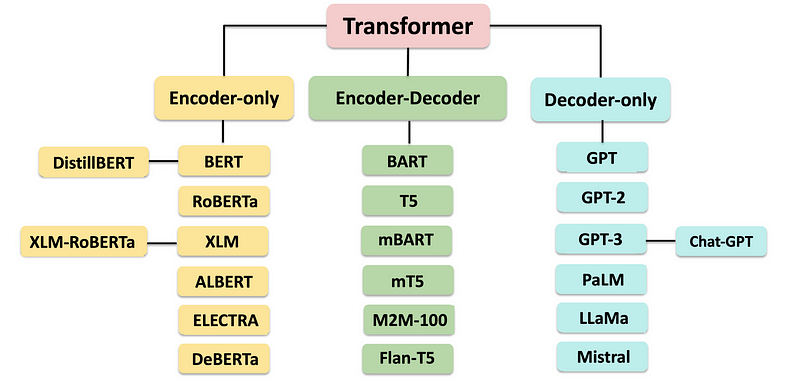

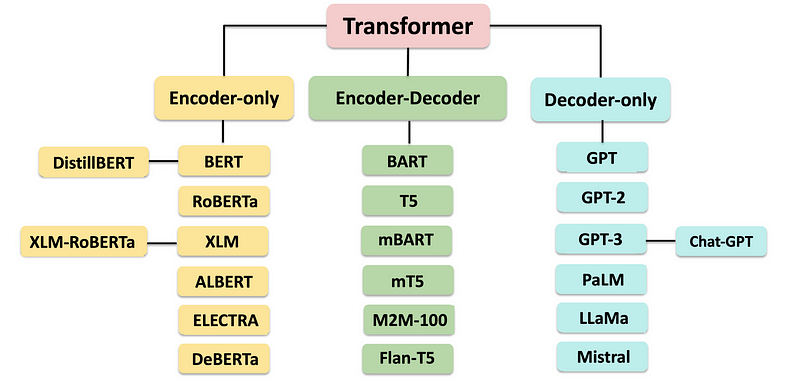

基于 Transformer 的语言模型

7.3 基于 Transformer 的语言模型(2017 年至今)

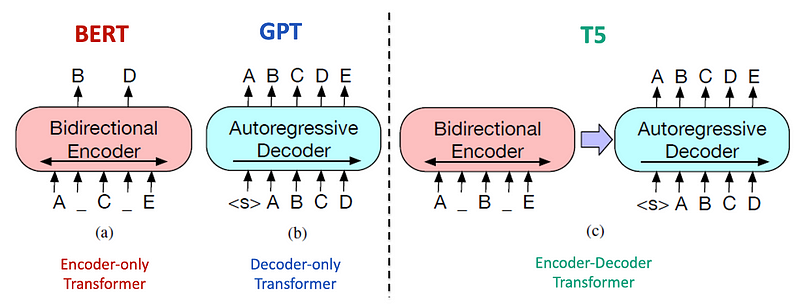

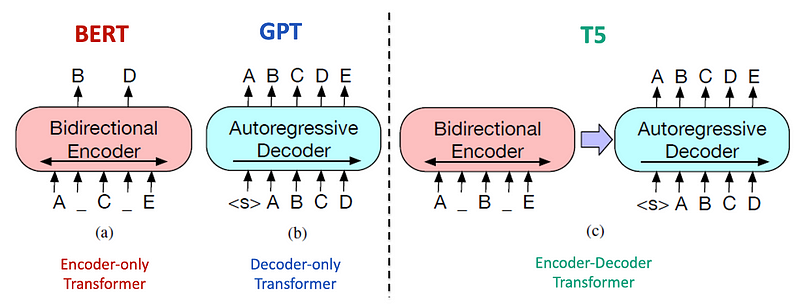

- BERT(2018): Transformers 的双向编码器表示,一种仅编码器的 Transformer,通过对掩蔽语言建模和下一句预测进行预训练,彻底改变了 NLP。

- T5(2019):文本到文本传输转换器,一种编码器-解码器转换器,将 NLP 任务重新定义为文本到文本的格式,简化了模型架构和训练。

OpenAI 的 GPT 系列:

- GPT(2018): OpenAI 推出的生成式预训练变压器,一种自回归解码器专用变压器,专注于预测文本序列中的下一个单词,展示了令人印象深刻的语言理解和生成能力。

- GPT-2(2019):它比其前身大得多,展示了零样本任务执行等新兴能力,引发了关于人工智能可能被滥用的讨论,因为它能够生成连贯的、但有时具有误导性的文本。

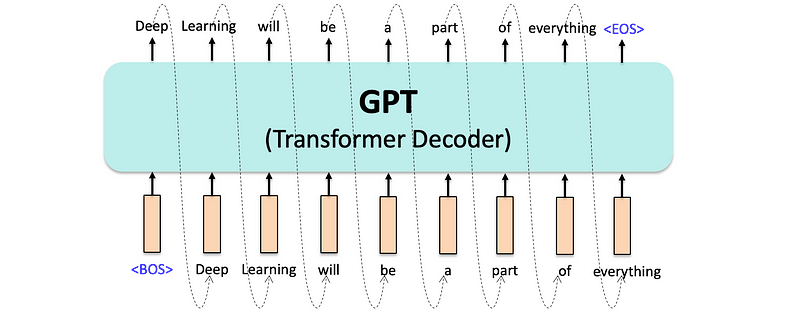

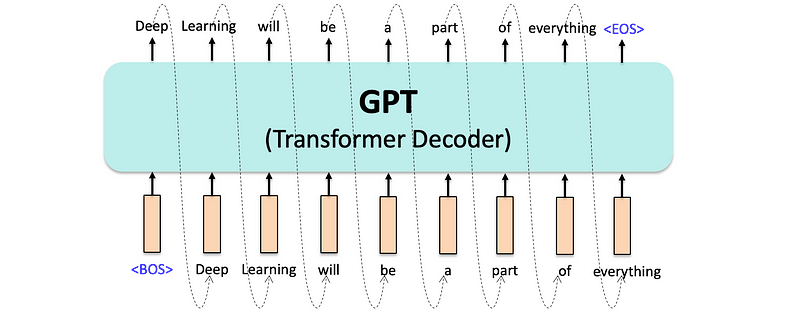

- GPT-3(2020 年):GPT-3 拥有 1750 亿个参数,进一步扩展了语言模型的可能性,在微调最少的任务(即少样本学习)中表现出色。作为仅用于解码器的转换器,GPT-3 的自回归架构使其能够根据序列中的前几个单词一次生成一个单词的文本。

GPT 的自回归语言模型架构旨在根据输入的前一个标记来预测序列中的下一个标记。

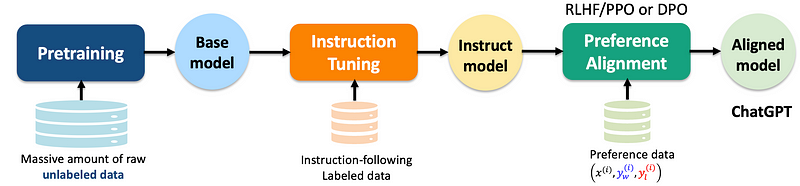

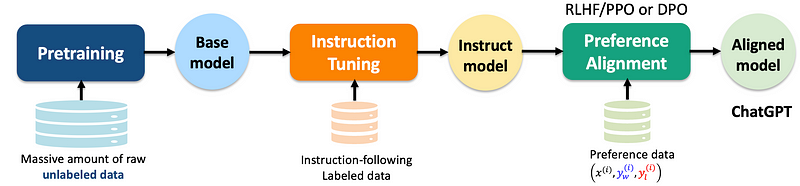

- ChatGPT(2022):GPT-3.5 系列中模型的微调版本,针对对话参与进行了优化,展示了指令调整的强大功能,使模型响应与用户意图保持一致。

高级大型语言模型 (LLM) 训练流程涉及预训练、指令调整和偏好调整的组合,使用人类反馈强化学习 (RLHF) 或直接偏好优化 (DPO)。

7.4 其他著名的大型语言模型(LLM)

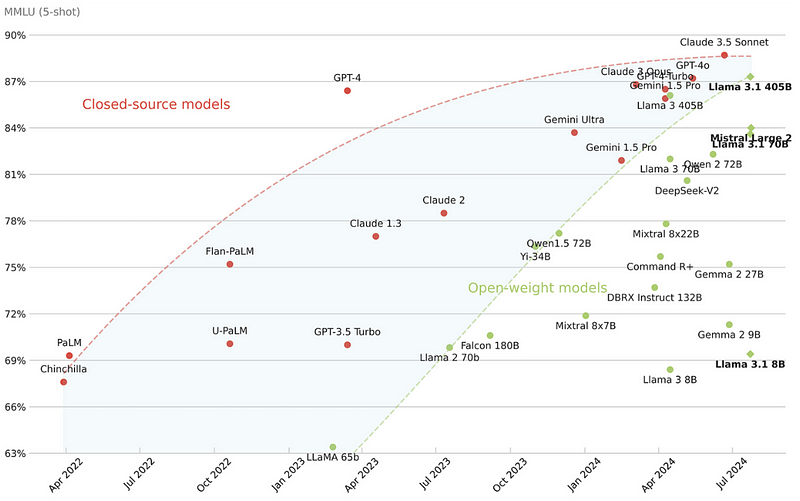

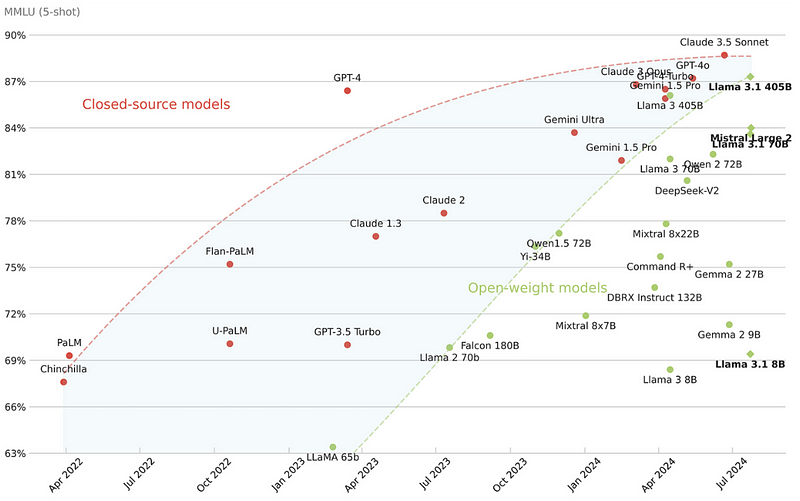

各种著名模型极大地丰富了大型语言模型 (LLM) 的格局,每种模型都提供了独特的功能和人工智能方面的进步。以下是一些知名 LLM 的最新概述:

- **Anthropic 的 Claude (2022):**优先考虑人工智能输出的安全性和道德考虑,旨在与人类价值观保持一致。

- **Meta 的 LLaMA(2023):**为不同的计算需求提供不同大小的模型,在自然语言处理基准测试中取得了令人印象深刻的成果。

- **Mistral.AI 的 Mistral (2023):**平衡高性能和资源效率,非常适合实时应用,专注于开源 AI 解决方案。

- **阿里巴巴的Qwen(2023年):**为英语和中文创建高质量的双语AI模型,促进跨语言应用并鼓励创新。

- **微软的 Phi(2023):**强调跨各种应用程序的多功能性和集成性,并具有用于情境理解和用户交互的高级培训技术。

- **Google 的 Gemma 系列 (2024):**轻量级、最先进的开放模型,适用于多种应用,包括文本生成、摘要和提取,重点关注性能和效率。

https://www.analyticsvidhya.com/blog/2023/07/build-your-own-large-language-models/

https://readmedium.com/fine-tune-llama-3-1-ultra-efficiently-with-unsloth-7196c7165bab

8.多模态模型(2023 年至今)

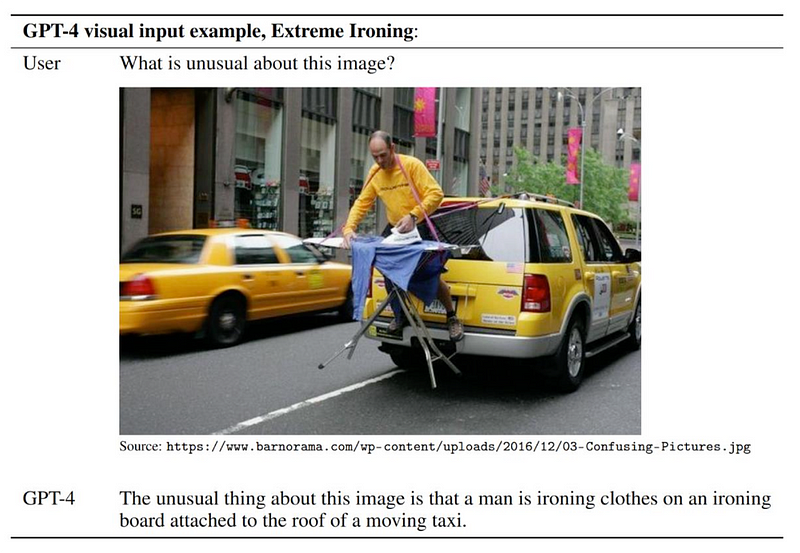

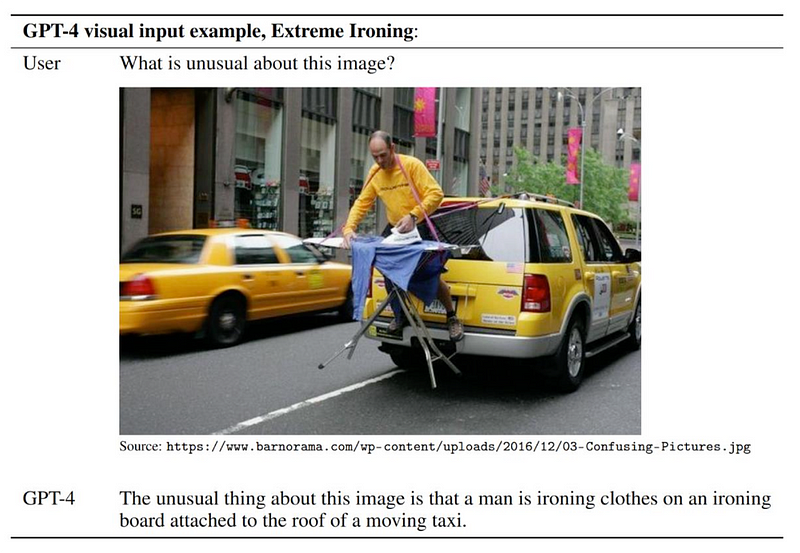

8.1 GPT-4V (2023) 和 GPT-4-o (2024)

- **GPT-4V(2023 年)**将多模态功能集成到已经非常强大的基于文本的模型中,标志着人工智能发展迈出了重要一步。它不仅可以处理和生成文本内容,还可以处理和生成图像内容,为更全面的人工智能交互奠定了基础。

- **GPT-4-o (2024)**是 GPT-4V 的演进版本,它通过复杂的上下文理解增强了多模态集成。它通过提供跨不同媒体的更好连贯性、根据文本提示生成高级图像以及基于视觉输入的精细推理,在其前身的基础上进行了改进。此外,GPT-4-o 还包括用于道德协调的高级培训机制,确保其输出不仅准确,而且负责任且符合人类价值观。

8.2 谷歌的 Gemini(2023 年至今)

- **Gemini Pro(2023 年):**谷歌的 Gemini 推出了一系列专为多模式任务而设计的模型,集成了文本、图像、音频和视频处理。Gemini Pro 尤其以其可扩展性和效率而脱颖而出,使高级 AI 可用于各种应用,从实时分析到跨不同媒体格式的复杂内容生成。

- Gemini 的多模态能力:Gemini 模型包括适用于不同规模应用的 Ultra 和 Nano 版本,旨在执行需要理解多种数据类型的任务。它们在视频摘要、多模态翻译和交互式学习环境等任务中表现出色,表明 Google 致力于提升 AI 在多媒体环境中的作用。

8.3 Claude 3.0 和 Claude 3.5(2023 年至今)

- **Claude 3.0(2023 年)**由 Anthropic 推出,该模型专注于提高人工智能响应的安全性和可靠性,并改进了情境理解和道德考量。它旨在更具对话性和帮助性,同时严格遵守避免有害或有偏见的输出。

- **Claude 3.5(2024)**进一步完善了 Claude 3.0 的功能,在复杂任务中表现更佳,处理效率更高,对用户请求的处理也更加细致入微。此版本还强调多模式交互,尽管它主要擅长文本和逻辑任务,但具有处理视觉或其他感官输入的新兴功能,可提供更集成的用户体验。

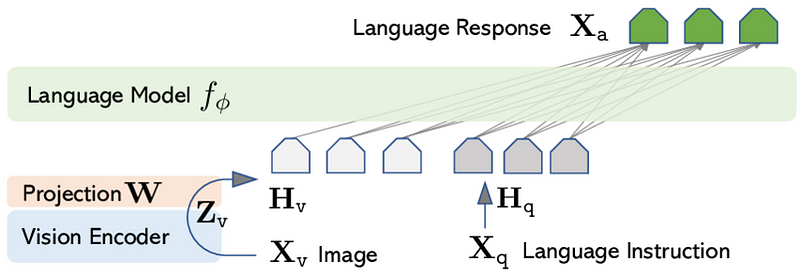

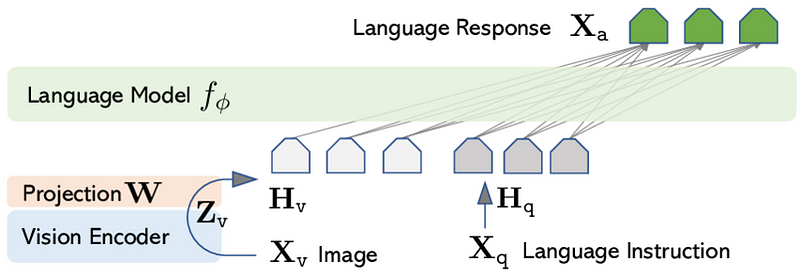

8.4 LLaVA(2023年)

- **LLaVA(大型语言和视觉助手)**代表了一种创新的多模态 AI 方法,将语言理解与视觉处理相结合。LLaVA 于 2023 年开发,可以解释图像并将其与文本内容联系起来,使其能够回答有关图像的问题、描述视觉内容,甚至根据视觉提示生成文本。其架构利用了 Transformer 模型的优势,在需要视觉和语言理解的任务中实现了最先进的性能。该模型因其开源性质而特别引人注目,鼓励对多模态 AI 应用进行进一步的研究和开发。

LLaVA 架构

8.5 OpenAI Sora(2024年)

OpenAI Sora 是一种新的文本转视频生成模型,它扩展了 OpenAI 多模态 AI 产品的功能。该模型允许用户根据文本描述创建视频,有效地弥合了文本与动态视觉内容之间的差距。Sora 与多模态框架的集成增强了创意应用的潜力,使用户能够以最少的输入生成丰富的多媒体内容。这一发展标志着朝着更直观、更具交互性的 AI 系统迈出了重要一步,这些 AI 系统可以理解和生成复杂的媒体形式。

这些模型共同标志着人工智能系统的发展,这些系统不仅能理解和生成文本,还能解释和创建各种形式的内容,更接近人类的认知能力。人工智能模型的这种演变促进了更具交互性、更直观的应用程序,能够通过混合不同的感官输入来处理现实世界的场景,从而拓展了人工智能在日常生活、研究和行业应用中所能实现的视野。

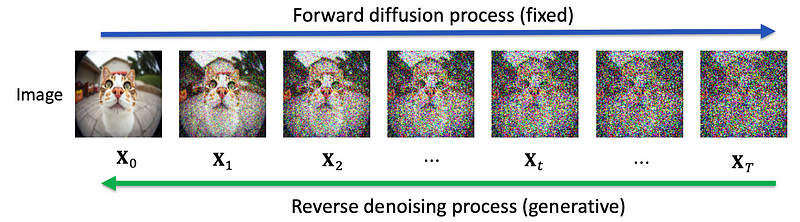

9. 扩散模型(2015-至今)

扩散模型已成为一种颇具影响力的生成模型,为从复杂的数据分布中创建高保真样本提供了一种全新的方法。与 GAN 和 VAE 等传统模型相比,扩散模型采用了一种渐进式去噪技术,该技术在许多应用中都表现出色。

9.1 扩散模型简介(2015)

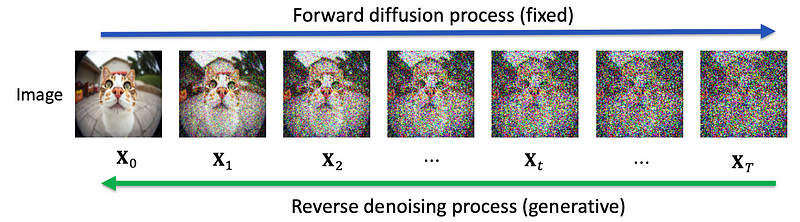

Sohl-Dickstein 等人 (2015) 在其论文中介绍了扩散模型,奠定了基础。他们概念化了一个生成过程,通过逆转逐渐增加的噪声可以将噪声重新转换为结构化数据。

9.2 扩散模型的主要特征

- **去噪过程:**这些模型逐步添加噪声(前向过程)并学习逆转噪声(后向过程),从而有效地去噪以生成样本。

- **马尔可夫链:**这两个过程都以马尔可夫链的形式构建,每个前向步骤都会添加高斯噪声,模型会反向学习去除高斯噪声。

- **训练目标:**目标是最小化每一步预测噪声和实际噪声之间的差异,优化证据下限(ELBO)的形式。

- **稳定性和鲁棒性:**它们比 GAN 具有更好的稳定性,避免了模式崩溃等问题,从而持续生成多样化、高质量的输出。

9.3 扩散模型的进展(2020 年至今)

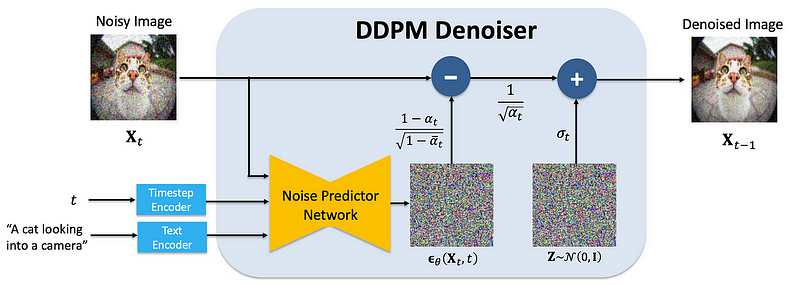

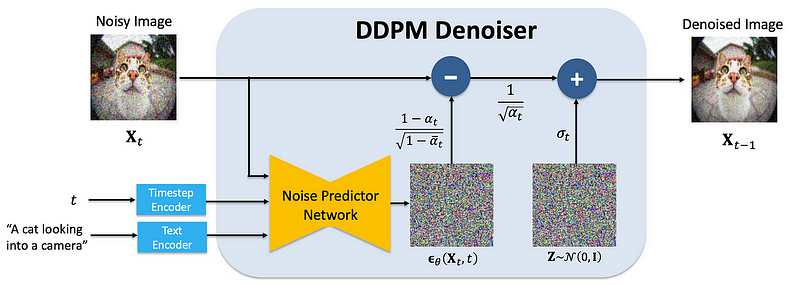

- 去噪扩散概率模型 (DDPM) (2020): 改进了扩散过程,为图像合成设定了新的基准。

- **去噪扩散隐式模型(DDIM)(2021):**通过非马尔可夫采样提高效率,使生成过程更加灵活。

- **基于随机微分方程的分数生成模型(2021):**利用随机微分方程进行有效的样本生成。

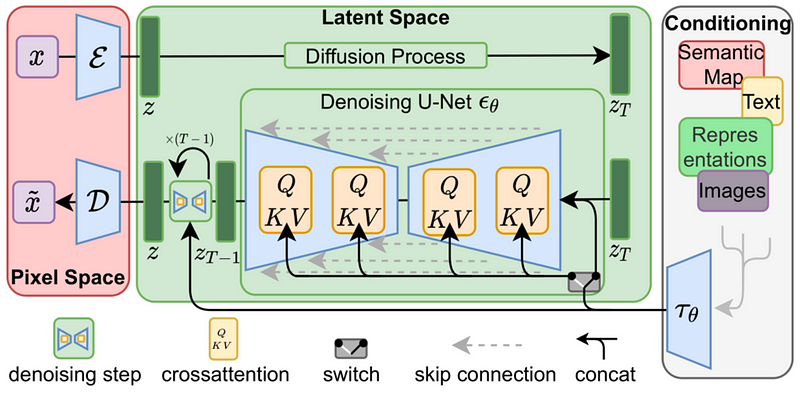

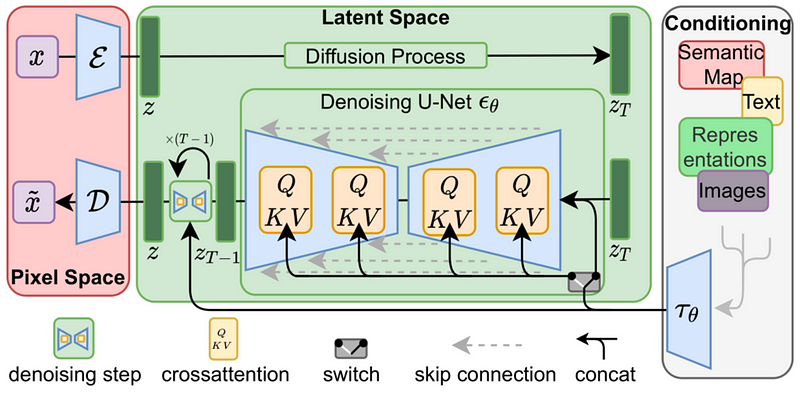

- 潜在扩散模型 (2022):成为稳定扩散等流行的文本到图像生成系统的基础,显著推动了人工智能生成图像领域的发展,并为更易于访问和更高效的生成人工智能工具铺平了道路。

潜在扩散模型的架构

9.3 应用

- 文本到图像生成: DALL-E 3 和 Stable Diffusion 3 等模型擅长根据文本描述生成高质量图像,其中 DALL-E 3 提供详细而准确的视觉效果,而 Stable Diffusion 则提供一种开源替代方案,使图像生成技术的访问变得民主化。

- FLUX.1 (2024): Black Forest Lab 推出了 FLUX.1,这是一种用于 AI 图像生成的高级扩散模型,可提供出色的速度、质量和及时遵守。FLUX.1 有三个版本 - Schnell、Dev 和 Pro - 利用 Rectified Flow Transformers 等创新技术来生成高度逼真的图像。FLUX.1 可以生成文本并处理手指和脚趾等细节 - 这些都是良好图像生成器所需的一切。

FLUX.1 Shenell 模型生成的图像,上面有一个简单的“侧面写着 FLUX.1 的咖啡杯”。 咖啡杯的高质量图像,清晰可见文字“FLUX.1”,展示了 FLUX.1 生成文本的能力。(来源)

- **DreamBooth(2022):**能够在特定主题的少量图像上训练扩散模型,从而实现个性化的图像生成。

- **LoRA(2022):**代表低秩自适应,这是一种允许使用最少的附加参数对扩散模型进行微调的技术,从而更容易使模型适应特定任务或数据集。

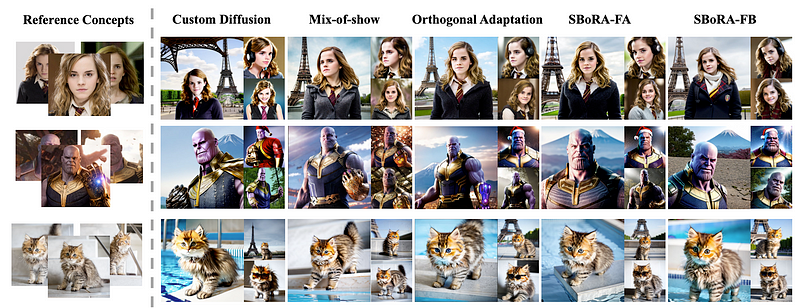

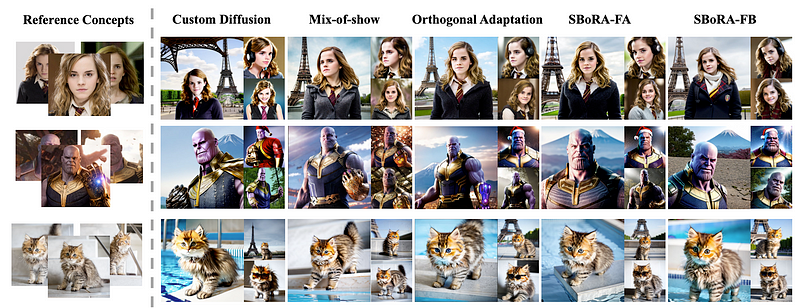

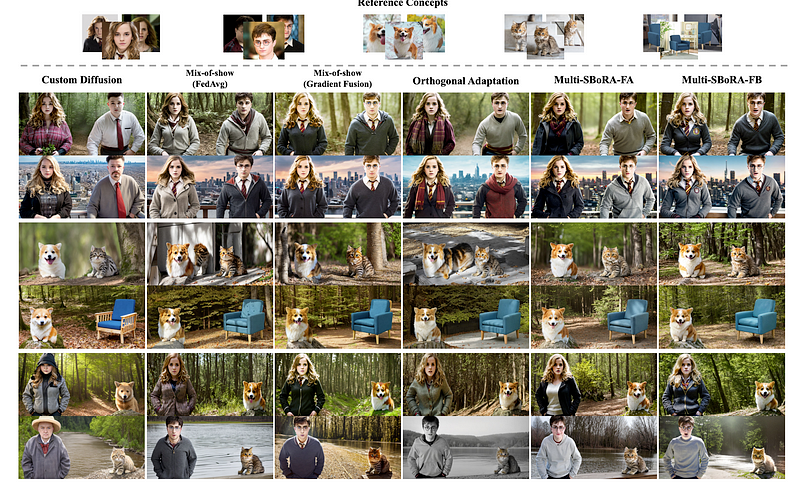

单概念生成的定性比较。左栏显示了每个概念的参考图像。基于 LoRA 的方法在保真度方面优于自定义扩散。此外,正交自适应和 SBoRA 表现出与 Mix-of-show 相当的性能,同时还引入了在多概念场景中具有优势的正交约束。

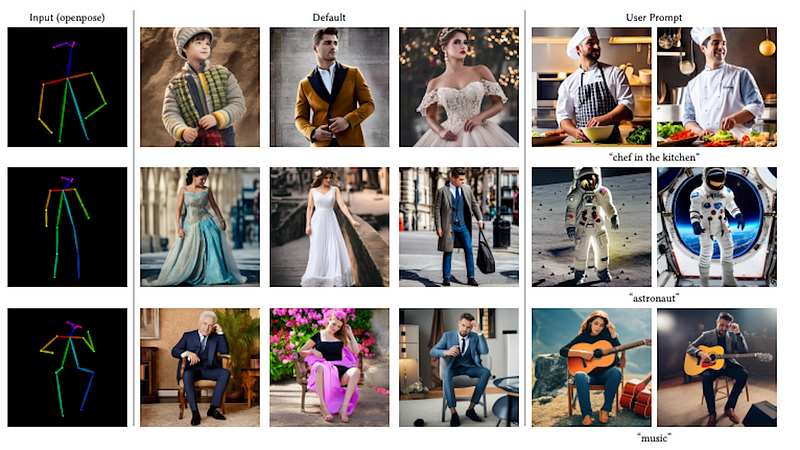

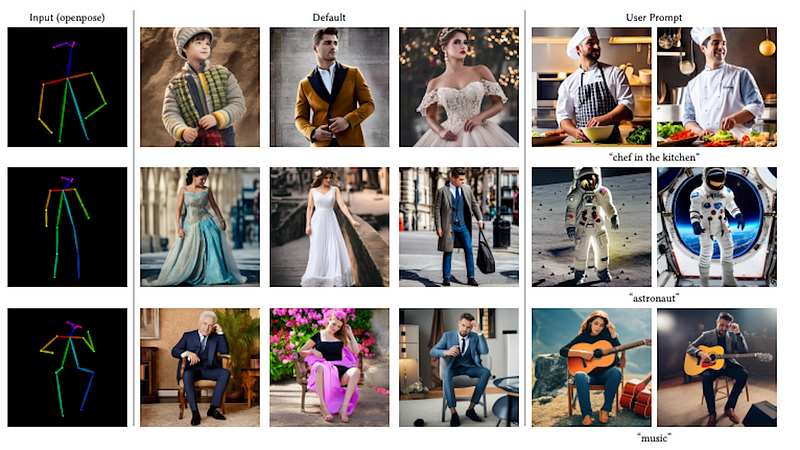

- **ControlNet(2023):**根据草图或深度图等附加输入来条件扩散模型,从而对生成的图像提供更多的控制。

使用带有姿势控制的 ControlNet 进行稳定扩散(来源)

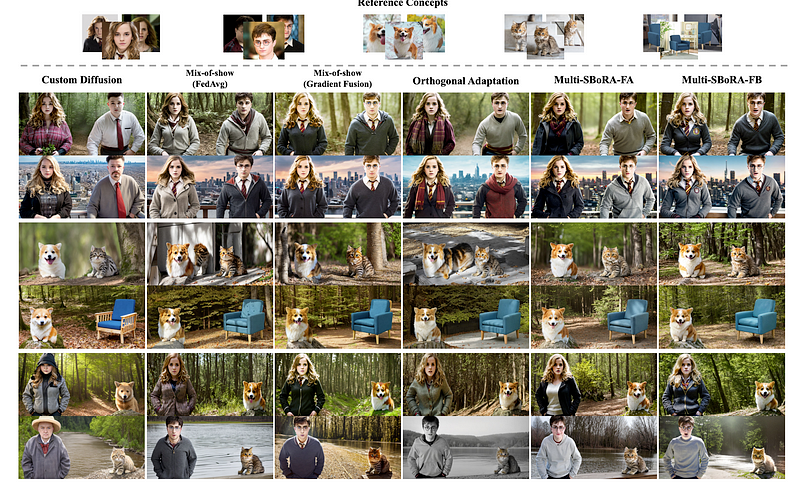

- Multi-SBoRA (2024):Multi-SBoRA 是一种为多个概念定制扩散模型的新方法。它使用正交标准基向量构建低秩矩阵进行微调,允许区域和非重叠权重更新,从而减少跨概念干扰。这种方法保留了预训练模型的知识,减少了计算开销,并增强了模型灵活性。实验结果表明,Multi-SBoRA 在多概念定制中实现了最佳性能,同时保持了独立性并减轻了串扰效应。

多概念生成的定性比较。结果分为三种情况:(1)角色生成,(2)对象生成,以及(3)组合角色和对象生成。顶行显示了每个概念的参考图像。缺乏正交设计的方法(例如自定义扩散和混合显示)表现出概念身份的严重损失,尤其是在面部特征复杂的角色中。正交自适应表现出身份保留的改进,但可能会损害模型的整体知识,导致崩溃。相比之下,我们提出的方法取得了卓越的成果,有效地保留了每个概念的身份,同时确保了更稳定的生成。

扩散模型研究的轨迹预示着一个光明的未来,集成模型有潜力结合各种人工智能架构的优势,同时优化速度和质量。

10. 结论

人工智能和深度学习的历史充满了重大进步和变革性创新。从早期的神经网络到复杂的架构,如卷积神经网络 (CNN)、循环神经网络 (RNN)、Transformers 和扩散模型,该领域已经彻底改变了各个领域。

最近的进展推动了大型语言模型 (LLM) 和大型多模态模型 (LMM) 的发展,例如 OpenAI 的 GPT-4o、Google 的 Gemini Pro、Antropic 的 Claude 3.5 Sonnet 和 Meta 的 LLaMA3.1,它们展示了令人印象深刻的自然语言和多模态能力。此外,生成式 AI 方面的突破,包括文本转图像和文本转视频生成模型(如 Midjourney、DALL-E 3、Stable Diffusion、FLUX.1 和 Sora),拓展了 AI 的创造潜力。

扩散模型也已成为具有多种应用的强大生成模型。随着研究继续专注于开发更高效、可解释且功能更强大的模型,人工智能和深度学习对社会和技术的影响只会越来越大。这些进步正在推动传统领域的创新,并为创造性表达、解决问题和人机协作创造新的可能性。# 深度学习与人工智能简史

人工智能 (AI) 和深度学习在过去几十年中取得了显著进展,改变了计算机视觉、自然语言处理和机器人等领域。本文概述了人工智能历史上使用深度学习的重要里程碑,从早期的神经网络模型到现代的大型语言模型和多模态人工智能系统。

1.人工智能的诞生(1956年)

人工智能 (AI) 的概念已经存在了几个世纪,但我们今天所知道的现代人工智能领域是在 20 世纪中叶开始形成的。“人工智能”一词最早是由计算机科学家和认知科学家约翰·麦卡锡于 1956 年在达特茅斯人工智能夏季研究项目中创造的。

达特茅斯会议通常被认为是人工智能研究领域的发源地。会议汇集了一群计算机科学家、数学家和认知科学家,探讨创造能够模拟人类智能的机器的可能性。与会者包括马文·明斯基、纳撒尼尔·罗切斯特和克劳德·香农等著名人物。

马文·明斯基、克劳德·香农、雷·所罗门诺夫和其他科学家在达特茅斯人工智能夏季研究项目中(图片:玛格丽特·明斯基)来源

1.1 人工智能的演变:从基于规则的系统到深度学习

人工智能的发展始于 20 世纪 50 年代,当时出现了用于国际象棋和解决问题等任务的算法,第一个人工智能程序 Logical Theorist 于 1956 年诞生。20 世纪 60 年代和 70 年代引入了基于规则的专家系统,例如 MYCIN,它可以协助复杂的决策过程。20 世纪 80 年代出现了机器学习,它使人工智能系统能够从数据中学习并随着时间的推移不断改进,为现代深度学习技术奠定了基础。

如今,大多数尖端人工智能技术都由深度学习技术驱动,这些技术已经改变了人工智能的格局。深度学习是机器学习的一个专门分支,它利用多层人工神经网络从原始输入数据中提取复杂特征。在本文中,我们将探索人工智能的历史,重点介绍深度学习在其发展中的作用。

2.早期人工神经网络(20 世纪 40 年代 - 20 世纪 60 年代)

2.1 Muclloch-Pitts神经元(1943年)

神经网络的概念可以追溯到 1943 年,当时 Warren McCulloch 和 Walter Pitts 提出了第一个人工神经元模型。McCulloch-Pitts (MP) 神经元模型是对生物神经元的突破性简化。该模型通过聚合二进制输入并使用阈值激活函数根据此聚合做出决策,从而产生二进制输出 {0, 1},为人工神经网络奠定了基础。

这个简化模型抓住了神经元行为的本质——接收多个输入,整合它们,并根据整合信号是否超过阈值产生二进制输出。尽管 MP 神经元模型很简单,但它能够实现基本的逻辑运算,展示了神经计算的潜力。

2.2 罗森布拉特的感知器模型(1957)

1957 年,弗兰克·罗森布拉特 (Frank Rosenblatt) 发明了感知器,这是一种能够学习和识别模式的单层神经网络。感知器模型是一种比 MP 神经元更通用的计算模型,旨在处理实值输入并调整权重以最大限度地减少分类错误。

罗森布拉特还为感知器开发了一种监督学习算法,使得网络可以直接从训练数据中学习。

罗森布拉特雄心勃勃地宣称感知器具有识别个体和翻译语言的潜力,这在当时引起了公众对人工智能的极大兴趣。感知器模型及其相关学习算法标志着神经网络发展的重要里程碑。然而,一个关键的限制很快就显现出来:感知器的学习规则在呈现非线性可分离训练数据时无法收敛。

2.3 艾达琳(1959)

1959 年,Widrow 和 Hoff提出了ADALINE(自适应线性神经元,又称 Delta 学习规则),这是对感知器学习规则的改进。ADALINE 解决了二进制输出和噪声敏感性等限制,并且可以学习和收敛非线性可分离数据,这是神经网络开发的一个重大突破。

ADALINE 的主要功能包括:

- 线性激活函数:与感知器的阶跃函数不同,ADALINE 使用线性激活函数,使其适用于回归任务和连续输出。

- 最小均方 (LMS) 算法:ADALINE 采用 LMS 算法,最小化预测输出和实际输出之间的均方误差,提供更高效、更稳定的学习过程。

- 自适应权重:LMS 算法根据输出中的误差自适应地调整权重,使得 ADALINE 即使在存在噪声的情况下也能够有效地学习和收敛。

ADALINE 的推出标志着神经网络第一个黄金时代的开始,它克服了罗森布拉特感知器学习的局限性。这一突破实现了高效学习、连续输出和对噪声数据的适应,引发了该领域的创新浪潮和快速进步。

然而,与感知器一样,ADALINE 仍然局限于线性可分离问题,**无法解决更复杂和非线性的任务。**这一限制后来被 XOR 问题凸显出来,从而导致了更先进的神经网络架构的发展。

2.4 异或问题(1969)

1969 年,Marvin Minsky 和 Seymour Papert 在他们的著作《感知器》中强调了单层感知器的一个关键限制。他们证明,由于感知器的决策边界是线性的,它无法解决异或 (XOR) 问题(一个简单的二元分类任务)。XOR 问题不是线性可分的,这意味着没有一个线性边界可以正确地对所有输入模式进行分类。

这一发现强调了对更复杂的神经网络架构的需求,这些架构能够学习非线性决策边界。感知器局限性的暴露导致人们对神经网络失去信心,并转向符号人工智能方法,标志着从 20 世纪 70 年代初到 80 年代中期的“神经网络第一个黑暗时代”的开始。

神经网络的第一个黑暗时代。

然而,从解决 XOR 问题中获得的见解使研究人员认识到需要更复杂的模型来捕捉非线性关系。这一认识最终导致了多层感知器和其他高级神经网络模型的发展,为后来几十年神经网络和深度学习的复兴奠定了基础。

3.多层感知器(20 世纪 60 年代)

多层感知器 (MLP) 于 20 世纪 60 年代推出,是对单层感知器的改进。它由多层互连的神经元组成,可以解决单层模型的局限性。苏联科学家AG Ivakhnenko 和 V. Lapa在感知器的基础工作的基础上,为 MLP 的开发做出了重大贡献。

3.1 隐藏层

添加隐藏层使 MLP 能够捕获和表示数据中复杂的非线性关系。这些隐藏层显著增强了网络的学习能力,使其能够解决非线性可分的问题,例如 XOR 问题。

3.2 MLP 的历史背景和挑战

MLP 标志着神经网络研究的重大进步,展示了深度学习架构在解决复杂问题方面的潜力。然而,在 20 世纪 60 年代和 70 年代,MLP 的发展受到了以下几个挑战的阻碍:

- 缺乏训练算法:早期的 MLP 模型缺乏有效的训练算法,无法有效地调整网络的权重。缺乏反向传播使得训练多层深度网络变得困难。

- 计算限制:当时的计算能力不足以处理训练深度神经网络所需的复杂计算。这一限制减缓了 MLP 研发的进度。

神经网络的第一个黑暗时代于 1986 年随着反向传播算法的重新发现和发表而结束,从而开启了神经网络的第二个黄金时代。

神经网络的第二个黄金时代。

4.反向传播(1970年代-1980年代)

1969 年,XOR 问题凸显了感知器(单层神经网络)的局限性。研究人员意识到多层神经网络可以克服这些局限性,但他们缺乏一种实用的算法来训练这些复杂的网络。反向传播算法花了 17 年的时间才开发出来,使神经网络在理论上能够近似任何函数。有趣的是,后来人们发现,该算法实际上是在发表之前就被发明出来的。如今,反向传播是深度学习的一个基本组成部分,自 20 世纪 60 年代和 70 年代诞生以来,它经历了重大的进步和改进。

4.1 早期发展(20 世纪 70 年代)

- Seppo Linnainmaa (1970):引入了自动微分的概念,这是反向传播算法的关键组成部分。

- Paul Werbos (1974):提出使用微积分的链式法则来计算误差函数关于网络权重的梯度,从而实现多层神经网络的训练。

4.2 细化与普及(20 世纪 80 年代)

- David Rumelhart、Geoffrey Hinton 和 Ronald Williams (1986):提出反向传播作为一种训练深度神经网络的实用而有效的方法,并展示了其在各种问题中的应用。

4.3 反向传播的主要特点:

- 梯度下降:反向传播与梯度下降结合使用,以最小化误差函数。该算法计算网络中每个权重的误差梯度,从而允许迭代更新权重以减少误差。

- 链式法则:反向传播算法的核心是应用微积分的链式法则。该法则允许将误差的梯度分解为一系列偏导数,这些偏导数可以通过网络的反向传播有效地计算出来。

- 分层计算:反向传播以逐层方式运行,从输出层开始向后工作到输入层。这种分层计算可确保梯度在网络中正确传播,从而实现深度架构的训练。

4.5 通用逼近定理(1989)

乔治·西本科 (George Cybenko) 于 1989 年提出的通用近似定理为多层神经网络的功能提供了数学基础。该定理指出,**在给定足够多的神经元并使用非线性激活函数的情况下,具有单个隐藏层的前馈神经网络可以将任何连续函数近似到任意精度。**该定理强调了神经网络的强大功能和灵活性,使其适用于广泛的应用。

具有单个隐藏层的多层神经网络可以将任何连续函数近似到任何所需的精度,从而能够解决各个领域的复杂问题。

4.6 第二个黄金时代(20 世纪 80 年代末 — 90 年代初)

反向传播和通用近似定理 (UAT) 的发展标志着神经网络的第二个黄金时代的开始。反向传播提供了一种训练多层神经网络的有效方法,使研究人员能够训练更深、更复杂的模型。UAT 为使用多层神经网络提供了理论依据,并增强了人们对其解决复杂问题能力的信心。这一时期跨越 20 世纪 80 年代末至 90 年代初,人们对该领域的兴趣重新燃起,并取得了重大进展。

4.7 第二次黑暗时代(20 世纪 90 年代初 — 21 世纪初)

然而,由于以下几个因素,神经网络领域在 20 世纪 90 年代初至 21 世纪初经历了“第二个黑暗时代”:

- 支持向量机(SVM)的兴起,为分类和回归任务提供了一种数学上优雅的方法。

- 计算限制,因为训练深度神经网络仍然耗时且需要大量硬件。

- 过度拟合和泛化问题,早期的神经网络在训练数据上表现良好,但在未知数据上表现不佳,这使得它们在实际应用中的可靠性较低。

这些挑战导致许多研究人员将注意力从神经网络转移,导致该领域陷入停滞。

4.8 深度学习的复兴(2000 年代末至今):

神经网络领域在 2000 年代末和 2010 年代初经历了复兴,推动力包括:

- 深度学习架构(CNN、RNN、Transformers、扩散模型)

- 硬件(GPU、TPU、LPU)

- 大型数据集(ImageNet、COCO、OpenWebText、WikiText 等)

- 训练算法(SGD、Adam、dropout)

这些进步推动了计算机视觉、自然语言处理、语音识别和强化学习领域的重大突破。通用近似定理与实践进步相结合,为深度学习技术的广泛采用和成功铺平了道路。

5.卷积神经网络(1980 年代 - 2010 年代)

卷积神经网络 (CNN) 极大地改变了深度学习的格局,尤其是在计算机视觉和图像处理领域。从 20 世纪 80 年代到 21 世纪 10 年代,CNN 的发展反映了架构、训练技术和应用方面的重大进步。

5.1 早期发展(1989-1998)

CNN 的概念最早由福岛健二在 20 世纪 80 年代提出,他提出了Neocognitron,这是一种模仿人类视觉皮层结构的分层神经网络。这项开创性的工作为 CNN 的发展奠定了基础。20 世纪 80 年代末和 90 年代初,Yann LeCun 和他的团队进一步开发了 CNN,推出了专为手写数字识别而设计的LeNet-5架构。

5.2 CNN 的关键组件

CNN 由三个关键组件构成:

- 卷积层:这些层通过应用一组可学习的过滤器自动从输入图像中学习特征的空间层次结构。

- 池化层:池化层减少了输入的空间维度,增强了对变化的鲁棒性并减少了计算负荷。

- 全连接层:在卷积层和池化层之后,全连接层用于分类任务,整合从先前层学习到的特征。

5.3 CNN 的主要特点

- 局部感受野:CNN 使用局部感受野来捕获输入数据中的局部模式,使其对于图像和视觉任务非常有效。

- 共享权重:在卷积层中使用共享权重减少了网络中的参数数量,使其更高效且更易于训练。

- **平移不变性:**池化层引入了平移不变性,使得网络能够识别模式,而不管其在输入图像中的位置。

5.4 CNN 的崛起:AlexNet 的影响(2012 年)

2012年,CNN发展迎来了重要的里程碑:AlexNet在ImageNet大规模视觉识别挑战赛(ILSVRC)中脱颖而出,取得了显著的胜利,标志着图像分类领域取得了重大突破。

AlexNet 的架构(2012)

ILSVRC 是一项年度图像识别基准测试,它基于包含 1000 多万张带注释图像的数据集评估算法,这些图像分为 1000 个类别。AlexNet 的创新包括:

- ReLU 激活函数:ReLU 是为了克服传统激活函数的问题而引入的,它可以加快训练速度并提高性能。

- 丢弃正则化:该技术通过在训练期间随机删除单元来减少过度拟合。

- 数据增强:通过人为增加训练数据的多样性,对训练数据集的增强提高了泛化能力。

AlexNet 的成功标志着 CNN 发展的一个转折点,为图像分类和物体检测的进一步发展铺平了道路。

AlexNet 开启神经网络的第三个黄金时代

当前的黄金时代(2010 年代至今)以深度学习、大数据和强大计算平台的融合为标志。这个时代在图像识别、自然语言处理和机器人技术方面取得了显著突破。正在进行的研究继续推动人工智能能力的边界。

AlexNet 开启神经网络的第三个黄金时代。

5.5 后续架构

继 AlexNet 之后,出现了几种有影响力的架构:

- VGGNet(2014):VGGNet 由牛津大学视觉几何小组开发,强调更深的架构和更小的卷积滤波器(3x3),实现了非凡的准确性。

- GoogLeNet/Inception(2014):引入了 Inception 模块,使网络能够有效地捕获多尺度特征。

- ResNet(2015):残差网络引入了跳过连接,使得非常深的网络的训练成为可能,同时缓解了梯度消失问题。

ResNet 和 GoogeNet 架构

5.6 CNN 的应用

CNN 的进步彻底改变了各个领域:

- 计算机视觉:CNN 已成为现代计算机视觉的支柱,推动了图像分类、对象检测和语义分割方面的突破。

- 医学成像:CNN 用于疾病诊断、肿瘤检测和图像引导手术等任务,显著提高诊断准确性。

- 自动驾驶汽车:CNN 是自动驾驶汽车感知系统不可或缺的一部分,使它们能够解读和响应周围环境。

CNN 的计算机视觉应用。

CNN 从诞生到如今成为深度学习基石的历程表明了其对 AI 的深远影响。CNN 的成功也为深度学习的进一步发展铺平了道路,并启发了其他专用神经网络架构(如 RNN 和 Transformers)的发展。CNN 的理论基础和实践创新为深度学习技术在各个领域的广泛采用和成功做出了重大贡献。

6.循环神经网络(1986-2017)

循环神经网络 (RNN) 是一种强大的架构,可用于处理顺序和时间数据。与前馈神经网络不同,RNN 旨在处理输入序列,因此对于语言建模、时间序列预测和语音识别等任务特别有效。

6.1 早期发展(20 世纪 80 年代 - 90 年代)

RNN 的概念可以追溯到 20 世纪 80 年代,John Hopfield、Michael I. Jordan 和 Jeffrey L. Elman 等先驱为这些网络的发展做出了贡献。John Hopfield 于 1982 年提出的 Hopfield 网络为理解神经网络中的循环连接奠定了基础。Jordan 网络和 Elman 网络分别于 20 世纪 80 年代和 90 年代提出,是捕捉序列数据中时间依赖关系的早期尝试。

6.2 LSTM、GRU 和 Seq2Seq 模型(1997 — 2014)

- 长短期记忆 (LSTM) 网络 (1997):Sepp Hochreiter 和 Jürgen Schmidhuber 引入了长短期记忆 (LSTM) 网络,解决了传统 RNN 中的梯度消失问题。LSTM 使用门控机制来控制信息流,从而使其能够捕获序列数据中的长期依赖关系。

- 门控循环单元 (GRU) (2014):Kyunghyun Cho 等人提出了门控循环单元 (GRU),这是 LSTM 的简化版本,也使用门控机制来控制信息流。GRU 的参数比 LSTM 少,并且训练速度通常更快。

- 序列到序列模型 (Seq2Seq) (2014):Ilya Sutskever 和他的团队提出了 Seq2Seq 模型,该模型使用编码器-解码器架构将输入序列映射到输出序列。该模型已广泛用于机器翻译、语音识别和文本摘要等任务。

6.3 RNN 循环连接的主要特点:

RNN 使用循环连接来维持隐藏状态,以捕获来自先前时间步骤的信息。这使得网络能够对顺序数据中的时间依赖性进行建模。

- 随时间反向传播 (BPTT):RNN 使用反向传播的变体(称为随时间反向传播 (BPTT))进行训练,它会随时间展开循环网络,并将标准反向传播算法应用于展开的网络。

- 门控机制:先进的 RNN 架构,例如 LSTM 和 GRU,使用门控机制来控制信息流,有助于缓解梯度消失问题并使网络能够捕获长期依赖关系。

6.4 RNN 应用

RNN 对各个领域产生了重大影响,其中包括:

- 自然语言处理:RNN 彻底改变了自然语言处理领域,推动了语言建模、机器翻译、情感分析和文本生成等任务的重大进步。

- 语音识别:RNN 广泛应用于语音识别系统,它们对口语中的时间依赖性进行建模,以将语音信号转换为文本。

- 时间序列预测:RNN 适用于时间序列预测,它们对序列数据中的时间依赖性进行建模以预测未来值。

6.5 RNN 的挑战

尽管取得了成功,RNN 仍面临着一些挑战:

- 梯度消失和梯度爆炸:尽管 LSTM 和 GRU 提供了一些解决方案,但传统的 RNN 仍难以解决这些问题。

- 计算复杂性:训练 RNN 可能需要大量资源,尤其是在处理大型数据集时。

- 并行化:RNN 的顺序特性使得并行训练和推理过程变得复杂。

RNN 的成功为深度学习的进一步发展铺平了道路,并激发了其他专用神经网络架构(如 Transformers)的发展,这些架构在各种顺序数据任务中都取得了最佳性能。RNN 的理论基础和实践创新为深度学习技术在各个领域的广泛采用和成功做出了重大贡献。

7.《变形金刚》(2017 年至今)

Transformer 凭借其处理序列数据的卓越能力彻底改变了深度学习的格局,并成为从自然语言处理 (NLP) 到计算机视觉等许多领域的关键。

7.1 Transformer 简介(2017)

Transformer 模型是由Vaswani 等人(2017) 在开创性论文“ Attention is All You Need ”中提出的。该模型放弃了传统的 RNN 顺序处理,转而采用自注意力机制,从而实现并行处理并更好地处理长距离依赖关系。

自注意力机制(来源)

7.2 Transformer 的主要特点

- 自注意力机制:允许序列中的每个位置关注所有位置,从而比 RNN 或 LSTM 更灵活地捕获上下文。

- 并行化:通过同时处理所有输入数据来提高训练速度,这与 RNN 的顺序性形成鲜明对比。

- **编码器-解码器结构:**编码器和解码器堆栈都利用自注意力和前馈神经网络层,并使用位置编码来维持序列顺序。

具有编码器-解码器结构和多头注意力机制的原始 Transformer 架构。

基于 Transformer 的语言模型

7.3 基于 Transformer 的语言模型(2017 年至今)

- BERT(2018): Transformers 的双向编码器表示,一种仅编码器的 Transformer,通过对掩蔽语言建模和下一句预测进行预训练,彻底改变了 NLP。

- T5(2019):文本到文本传输转换器,一种编码器-解码器转换器,将 NLP 任务重新定义为文本到文本的格式,简化了模型架构和训练。

OpenAI 的 GPT 系列:

- GPT(2018): OpenAI 推出的生成式预训练变压器,一种自回归解码器专用变压器,专注于预测文本序列中的下一个单词,展示了令人印象深刻的语言理解和生成能力。

- GPT-2(2019):它比其前身大得多,展示了零样本任务执行等新兴能力,引发了关于人工智能可能被滥用的讨论,因为它能够生成连贯的、但有时具有误导性的文本。

- GPT-3(2020 年):GPT-3 拥有 1750 亿个参数,进一步扩展了语言模型的可能性,在微调最少的任务(即少样本学习)中表现出色。作为仅用于解码器的转换器,GPT-3 的自回归架构使其能够根据序列中的前几个单词一次生成一个单词的文本。

GPT 的自回归语言模型架构旨在根据输入的前一个标记来预测序列中的下一个标记。

- ChatGPT(2022):GPT-3.5 系列中模型的微调版本,针对对话参与进行了优化,展示了指令调整的强大功能,使模型响应与用户意图保持一致。

高级大型语言模型 (LLM) 训练流程涉及预训练、指令调整和偏好调整的组合,使用人类反馈强化学习 (RLHF) 或直接偏好优化 (DPO)。

7.4 其他著名的大型语言模型(LLM)

各种著名模型极大地丰富了大型语言模型 (LLM) 的格局,每种模型都提供了独特的功能和人工智能方面的进步。以下是一些知名 LLM 的最新概述:

- **Anthropic 的 Claude (2022):**优先考虑人工智能输出的安全性和道德考虑,旨在与人类价值观保持一致。

- **Meta 的 LLaMA(2023):**为不同的计算需求提供不同大小的模型,在自然语言处理基准测试中取得了令人印象深刻的成果。

- **Mistral.AI 的 Mistral (2023):**平衡高性能和资源效率,非常适合实时应用,专注于开源 AI 解决方案。

- **阿里巴巴的Qwen(2023年):**为英语和中文创建高质量的双语AI模型,促进跨语言应用并鼓励创新。

- **微软的 Phi(2023):**强调跨各种应用程序的多功能性和集成性,并具有用于情境理解和用户交互的高级培训技术。

- **Google 的 Gemma 系列 (2024):**轻量级、最先进的开放模型,适用于多种应用,包括文本生成、摘要和提取,重点关注性能和效率。

Build Large Language Models from Scratch - Analytics Vidhya

https://readmedium.com/fine-tune-llama-3-1-ultra-efficiently-with-unsloth-7196c7165bab

8.多模态模型(2023 年至今)

8.1 GPT-4V (2023) 和 GPT-4-o (2024)

- **GPT-4V(2023 年)**将多模态功能集成到已经非常强大的基于文本的模型中,标志着人工智能发展迈出了重要一步。它不仅可以处理和生成文本内容,还可以处理和生成图像内容,为更全面的人工智能交互奠定了基础。

- **GPT-4-o (2024)**是 GPT-4V 的演进版本,它通过复杂的上下文理解增强了多模态集成。它通过提供跨不同媒体的更好连贯性、根据文本提示生成高级图像以及基于视觉输入的精细推理,在其前身的基础上进行了改进。此外,GPT-4-o 还包括用于道德协调的高级培训机制,确保其输出不仅准确,而且负责任且符合人类价值观。

8.2 谷歌的 Gemini(2023 年至今)

- **Gemini Pro(2023 年):**谷歌的 Gemini 推出了一系列专为多模式任务而设计的模型,集成了文本、图像、音频和视频处理。Gemini Pro 尤其以其可扩展性和效率而脱颖而出,使高级 AI 可用于各种应用,从实时分析到跨不同媒体格式的复杂内容生成。

- Gemini 的多模态能力:Gemini 模型包括适用于不同规模应用的 Ultra 和 Nano 版本,旨在执行需要理解多种数据类型的任务。它们在视频摘要、多模态翻译和交互式学习环境等任务中表现出色,表明 Google 致力于提升 AI 在多媒体环境中的作用。

8.3 Claude 3.0 和 Claude 3.5(2023 年至今)

- **Claude 3.0(2023 年)**由 Anthropic 推出,该模型专注于提高人工智能响应的安全性和可靠性,并改进了情境理解和道德考量。它旨在更具对话性和帮助性,同时严格遵守避免有害或有偏见的输出。

- **Claude 3.5(2024)**进一步完善了 Claude 3.0 的功能,在复杂任务中表现更佳,处理效率更高,对用户请求的处理也更加细致入微。此版本还强调多模式交互,尽管它主要擅长文本和逻辑任务,但具有处理视觉或其他感官输入的新兴功能,可提供更集成的用户体验。

8.4 LLaVA(2023年)

- **LLaVA(大型语言和视觉助手)**代表了一种创新的多模态 AI 方法,将语言理解与视觉处理相结合。LLaVA 于 2023 年开发,可以解释图像并将其与文本内容联系起来,使其能够回答有关图像的问题、描述视觉内容,甚至根据视觉提示生成文本。其架构利用了 Transformer 模型的优势,在需要视觉和语言理解的任务中实现了最先进的性能。该模型因其开源性质而特别引人注目,鼓励对多模态 AI 应用进行进一步的研究和开发。

LLaVA 架构

8.5 OpenAI Sora(2024年)

OpenAI Sora 是一种新的文本转视频生成模型,它扩展了 OpenAI 多模态 AI 产品的功能。该模型允许用户根据文本描述创建视频,有效地弥合了文本与动态视觉内容之间的差距。Sora 与多模态框架的集成增强了创意应用的潜力,使用户能够以最少的输入生成丰富的多媒体内容。这一发展标志着朝着更直观、更具交互性的 AI 系统迈出了重要一步,这些 AI 系统可以理解和生成复杂的媒体形式。

这些模型共同标志着人工智能系统的发展,这些系统不仅能理解和生成文本,还能解释和创建各种形式的内容,更接近人类的认知能力。人工智能模型的这种演变促进了更具交互性、更直观的应用程序,能够通过混合不同的感官输入来处理现实世界的场景,从而拓展了人工智能在日常生活、研究和行业应用中所能实现的视野。

9. 扩散模型(2015-至今)

扩散模型已成为一种颇具影响力的生成模型,为从复杂的数据分布中创建高保真样本提供了一种全新的方法。与 GAN 和 VAE 等传统模型相比,扩散模型采用了一种渐进式去噪技术,该技术在许多应用中都表现出色。

9.1 扩散模型简介(2015)

Sohl-Dickstein 等人 (2015) 在其论文中介绍了扩散模型,奠定了基础。他们概念化了一个生成过程,通过逆转逐渐增加的噪声可以将噪声重新转换为结构化数据。

9.2 扩散模型的主要特征

- **去噪过程:**这些模型逐步添加噪声(前向过程)并学习逆转噪声(后向过程),从而有效地去噪以生成样本。

- **马尔可夫链:**这两个过程都以马尔可夫链的形式构建,每个前向步骤都会添加高斯噪声,模型会反向学习去除高斯噪声。

- **训练目标:**目标是最小化每一步预测噪声和实际噪声之间的差异,优化证据下限(ELBO)的形式。

- **稳定性和鲁棒性:**它们比 GAN 具有更好的稳定性,避免了模式崩溃等问题,从而持续生成多样化、高质量的输出。

9.3 扩散模型的进展(2020 年至今)

- 去噪扩散概率模型 (DDPM) (2020): 改进了扩散过程,为图像合成设定了新的基准。

- **去噪扩散隐式模型(DDIM)(2021):**通过非马尔可夫采样提高效率,使生成过程更加灵活。

- **基于随机微分方程的分数生成模型(2021):**利用随机微分方程进行有效的样本生成。

- 潜在扩散模型 (2022):成为稳定扩散等流行的文本到图像生成系统的基础,显著推动了人工智能生成图像领域的发展,并为更易于访问和更高效的生成人工智能工具铺平了道路。

潜在扩散模型的架构

9.3 应用

- 文本到图像生成: DALL-E 3 和 Stable Diffusion 3 等模型擅长根据文本描述生成高质量图像,其中 DALL-E 3 提供详细而准确的视觉效果,而 Stable Diffusion 则提供一种开源替代方案,使图像生成技术的访问变得民主化。

- FLUX.1 (2024): Black Forest Lab 推出了 FLUX.1,这是一种用于 AI 图像生成的高级扩散模型,可提供出色的速度、质量和及时遵守。FLUX.1 有三个版本 - Schnell、Dev 和 Pro - 利用 Rectified Flow Transformers 等创新技术来生成高度逼真的图像。FLUX.1 可以生成文本并处理手指和脚趾等细节 - 这些都是良好图像生成器所需的一切。

FLUX.1 Shenell 模型生成的图像,上面有一个简单的“侧面写着 FLUX.1 的咖啡杯”。 咖啡杯的高质量图像,清晰可见文字“FLUX.1”,展示了 FLUX.1 生成文本的能力。(来源)

- **DreamBooth(2022):**能够在特定主题的少量图像上训练扩散模型,从而实现个性化的图像生成。

- **LoRA(2022):**代表低秩自适应,这是一种允许使用最少的附加参数对扩散模型进行微调的技术,从而更容易使模型适应特定任务或数据集。

单概念生成的定性比较。左栏显示了每个概念的参考图像。基于 LoRA 的方法在保真度方面优于自定义扩散。此外,正交自适应和 SBoRA 表现出与 Mix-of-show 相当的性能,同时还引入了在多概念场景中具有优势的正交约束。

- **ControlNet(2023):**根据草图或深度图等附加输入来条件扩散模型,从而对生成的图像提供更多的控制。

使用带有姿势控制的 ControlNet 进行稳定扩散(来源)

- Multi-SBoRA (2024):Multi-SBoRA 是一种为多个概念定制扩散模型的新方法。它使用正交标准基向量构建低秩矩阵进行微调,允许区域和非重叠权重更新,从而减少跨概念干扰。这种方法保留了预训练模型的知识,减少了计算开销,并增强了模型灵活性。实验结果表明,Multi-SBoRA 在多概念定制中实现了最佳性能,同时保持了独立性并减轻了串扰效应。

多概念生成的定性比较。结果分为三种情况:(1)角色生成,(2)对象生成,以及(3)组合角色和对象生成。顶行显示了每个概念的参考图像。缺乏正交设计的方法(例如自定义扩散和混合显示)表现出概念身份的严重损失,尤其是在面部特征复杂的角色中。正交自适应表现出身份保留的改进,但可能会损害模型的整体知识,导致崩溃。相比之下,我们提出的方法取得了卓越的成果,有效地保留了每个概念的身份,同时确保了更稳定的生成。

扩散模型研究的轨迹预示着一个光明的未来,集成模型有潜力结合各种人工智能架构的优势,同时优化速度和质量。

10. 结论

人工智能和深度学习的历史充满了重大进步和变革性创新。从早期的神经网络到复杂的架构,如卷积神经网络 (CNN)、循环神经网络 (RNN)、Transformers 和扩散模型,该领域已经彻底改变了各个领域。

最近的进展推动了大型语言模型 (LLM) 和大型多模态模型 (LMM) 的发展,例如 OpenAI 的 GPT-4o、Google 的 Gemini Pro、Antropic 的 Claude 3.5 Sonnet 和 Meta 的 LLaMA3.1,它们展示了令人印象深刻的自然语言和多模态能力。此外,生成式 AI 方面的突破,包括文本转图像和文本转视频生成模型(如 Midjourney、DALL-E 3、Stable Diffusion、FLUX.1 和 Sora),拓展了 AI 的创造潜力。

扩散模型也已成为具有多种应用的强大生成模型。随着研究继续专注于开发更高效、可解释且功能更强大的模型,人工智能和深度学习对社会和技术的影响只会越来越大。这些进步正在推动传统领域的创新,并为创造性表达、解决问题和人机协作创造新的可能性。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)