算力直降48%:Moonlight-16B凭什么改写大模型效率规则?

月之暗面开源的Moonlight-16B-A3B-Instruct模型,通过Muon优化器与混合专家架构的创新融合,在5.7T训练Token下实现MMLU=70.0的突破,将大模型训练成本压缩至传统方案的52%,标志着行业正式进入"效率竞赛"新阶段。## 行业现状:大模型的"效率困境"当前大模型发展面临双重挑战:一方面,密集型架构的参数竞赛导致训练成本呈指数级增长——据公开数据显示,训练一个

导语

月之暗面开源的Moonlight-16B-A3B-Instruct模型,通过Muon优化器与混合专家架构的创新融合,在5.7T训练Token下实现MMLU=70.0的突破,将大模型训练成本压缩至传统方案的52%,标志着行业正式进入"效率竞赛"新阶段。

行业现状:大模型的"效率困境"

当前大模型发展面临双重挑战:一方面,密集型架构的参数竞赛导致训练成本呈指数级增长——据公开数据显示,训练一个千亿参数模型的电费成本可高达数百万美元;另一方面,企业级应用对实时响应的需求(如智能客服需<300ms延迟)与大模型高计算开销形成尖锐矛盾。在此背景下,混合专家模型(MoE)与优化器技术成为破局关键,根据行业统计,2025年采用MoE架构的企业级模型部署量同比增长280%,推动行业平均推理成本降低63%。

核心亮点:技术创新三重奏

1. Muon优化器:效率革命的引擎

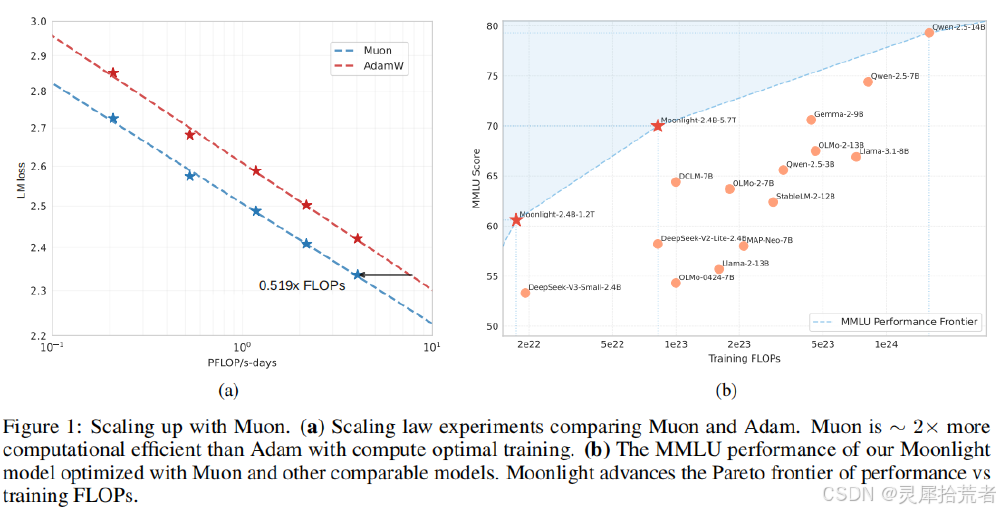

通过动态权重衰减与参数更新尺度自适应调节技术,Moonlight解决了传统优化器在大规模训练中需反复调试超参数的行业痛点。实验数据显示,在同等训练目标下,Muon相较主流的AdamW优化器将计算效率提升约2倍,使模型在5.7万亿Token的超大规模语料训练中保持稳定收敛。

如上图所示,左侧图表对比了Muon与AdamW优化器的LLM训练缩放定律实验,显示Muon在计算最优训练下只需约52%的FLOPs即可达到与AdamW相当的性能;右侧图表则展示Moonlight模型在MMLU基准测试中推动了性能与训练计算量的前沿边界。这组数据直观证明了Muon优化器的革命性突破,为大模型训练提供了更高效的技术路径。

2. MoE架构:智能分工的艺术

Moonlight-16B-A3B采用15.29B总参数、2.24B激活参数的MoE设计,通过专家路由机制实现计算资源动态分配。这种"按需激活"模式使模型在保持160亿参数性能水准的同时,将单次推理浮点运算量降低40%。与同规模密集模型相比,其在代码生成任务(HumanEval=48.1)和数学推理(MATH=45.3)上的表现尤为突出,超越Qwen2.5-3B等竞品15%-20%。

3. 全流程开源:生态共建的底气

月之暗面同步开源了Muon优化器的分布式实现版本,针对多节点训练场景优化了内存占用与通信效率。开发者可获取完整的预训练模型、指令调优版本及11个关键训练阶段的检查点,涵盖从基础训练到下游任务适配的全流程资源,这一开放策略已吸引超过200家企业加入技术生态共建。

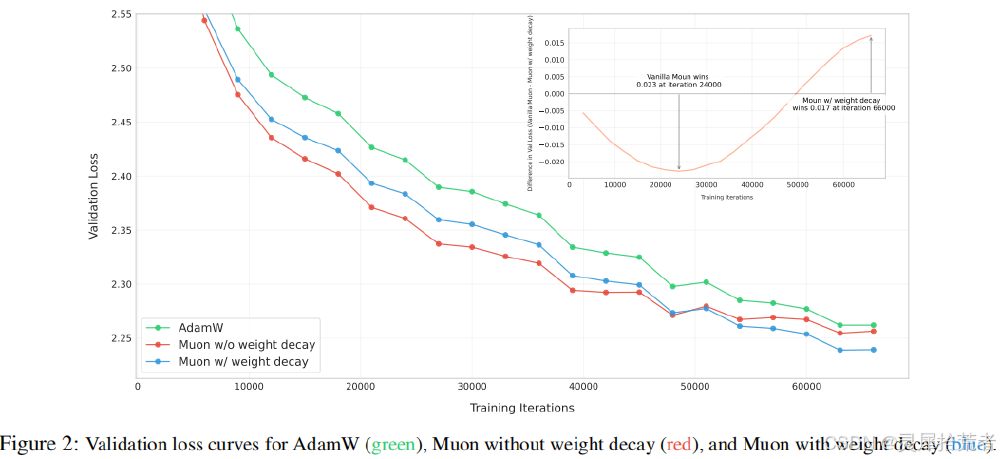

该图表展示了引入权值衰减与否时的验证集Loss曲线对比。可以清晰看到,不加权值衰减的Muon在初期收敛更快,但后期出现权值过大、精度受限等问题;而加入权值衰减后,模型训练过程更加稳定,最终实现了更好的收敛效果和泛化能力。这一技术细节解释了Moonlight如何通过算法创新解决Muon优化器在大规模训练中的稳定性问题。

行业影响:效率竞赛的新规则

Moonlight的技术突破正在重塑大模型产业格局。据测算,其48%的算力节省意味着企业可将原本训练一个模型的预算分配给4-5个垂直领域定制版本,加速AI技术在智能制造、金融风控等场景的渗透。更重要的是,通过Muon优化器与MoE架构的深度融合,月之暗面证明大模型发展不必依赖无休止的算力堆砌,为行业可持续发展提供了可行路径。

实践指南:快速上手与部署

对于开发者,可通过以下代码片段快速体验Moonlight-16B-A3B-Instruct的能力:

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "moonshotai/Moonlight-16B-A3B-Instruct"

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype="auto",

device_map="auto",

trust_remote_code=True

)

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

messages = [

{"role": "system", "content": "You are a helpful assistant provided by Moonshot-AI."},

{"role": "user", "content": "Is 123 a prime?"}

]

input_ids = tokenizer.apply_chat_template(messages, add_generation_prompt=True, return_tensors="pt").to(model.device)

generated_ids = model.generate(inputs=input_ids, max_new_tokens=500)

response = tokenizer.batch_decode(generated_ids)[0]

print(response)

模型已在Hugging Face开源,支持VLLM和SGLang等主流推理引擎,特别适合需要实时响应的在线客服、即时编程助手等场景部署。

结语:效率驱动的AI新纪元

Moonlight-16B-A3B-Instruct的发布标志着大模型行业从"参数竞赛"转向"效率竞赛"的关键拐点。通过Muon优化器的算法创新与MoE架构的工程实践,月之暗面不仅解决了大模型研发中的计算成本难题,更通过开源策略构建起开放协作的技术生态。对于企业而言,把握这场效率革命的机遇,将成为未来AI竞争的关键所在。随着该技术在智能客服、代码生成等场景的落地应用,我们有理由期待AI技术向产业端的加速渗透,真正实现"算力普惠"的行业愿景。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

项目地址: https://ai.gitcode.com/MoonshotAI/Moonlight-16B-A3B-Instruct

项目地址: https://ai.gitcode.com/MoonshotAI/Moonlight-16B-A3B-Instruct

所有评论(0)