YOLO目标检测算法:从原理到实践

本文详细介绍了YOLO(You Only Look Once)系列算法在目标检测领域的应用与发展。YOLO通过将目标检测视为单一的回归问题,直接从图像像素映射到边界框坐标和类别概率,显著提高了检测速度。文章从YOLO的基本思想、网络结构、损失函数等方面阐述了其原理,并回顾了从YOLOv1到YOLOv5的演进历程,重点介绍了各版本的改进与优化。此外,文章还探讨了YOLO在安防监控、自动驾驶、工业检测

一、引言

目标检测是计算机视觉领域中的一个核心任务,它不仅需要定位图像中的物体,还需要识别这些物体的类别。随着深度学习的发展,目标检测技术取得了巨大的进步,而YOLO(You Only Look Once)系列算法无疑是其中的佼佼者。YOLO以其快速的检测速度和良好的检测效果在学术界和工业界都得到了广泛的应用。本文将详细介绍YOLO算法的原理、发展历程以及如何在实际项目中应用YOLO进行目标检测。

二、YOLO算法原理

(一)基本思想

YOLO的核心思想是将目标检测任务视为一个单一的回归问题,直接从图像像素到边界框坐标和类别概率的映射。与传统的两阶段检测方法(如R-CNN系列)不同,YOLO不需要先提取候选区域,而是直接在整个图像上进行预测。这种方法大大提高了检测速度,使其能够在实时场景中快速运行。

(二)网络结构

YOLO的网络结构基于卷积神经网络(CNN)。以YOLOv1为例,其网络结构包括多个卷积层和池化层,最后通过全连接层输出检测结果。网络的输入是一个固定大小的图像,经过一系列的卷积和池化操作后,特征图的尺寸逐渐减小,同时特征的语义信息逐渐增强。最终,网络会输出一个包含边界框坐标、置信度和类别概率的张量。

(三)损失函数

YOLO的损失函数由两部分组成:定位损失和分类损失。定位损失用于衡量预测的边界框与真实边界框之间的差异,通常采用平方和误差;分类损失用于衡量预测的类别概率与真实类别之间的差异,通常采用交叉熵损失。通过最小化总损失函数,YOLO可以优化网络参数,提高检测的准确性和鲁棒性。

三、YOLO的发展历程

(一)YOLOv1

YOLOv1是YOLO系列的开山之作,它首次提出了将目标检测任务视为一个单一的回归问题,并通过端到端的网络结构实现了快速的目标检测。YOLOv1在速度上取得了显著的优势,但在精度上与当时的先进方法相比还有一定的差距。尽管如此,YOLOv1为后续的改进奠定了基础。

(二)YOLOv2(Darknet-19)

YOLOv2在YOLOv1的基础上进行了多项改进,包括引入了批量归一化(Batch Normalization)、高分辨率分类器、锚框机制等。这些改进不仅提高了检测的精度,还进一步提升了检测的速度。YOLOv2还引入了数据增强技术,增强了模型对不同场景的适应能力。

(三)YOLOv3

YOLOv3进一步改进了网络结构和损失函数。它采用了Darknet-53作为骨干网络,通过多尺度预测机制,能够同时检测不同大小的目标。YOLOv3还引入了类别无关的锚框机制,提高了模型对不同形状目标的检测能力。此外,YOLOv3还改进了损失函数,使其更加适合多类别的目标检测任务。

(四)YOLOv4

YOLOv4在YOLOv3的基础上引入了更多的优化技术,如权重衰减、CSPDarknet53骨干网络、Mish激活函数等。这些改进使得YOLOv4在速度和精度上都取得了更好的平衡。YOLOv4还引入了Bag of Freebies(BoF)和Bag of Specials(BoS)的概念,通过一系列的优化技巧进一步提升了模型的性能。

(五)YOLOv5

YOLOv5是YOLO系列的一个重大改进版本,它采用了PyTorch框架进行实现,并对网络结构进行了简化和优化。YOLOv5支持自动锚框计算、动态调整学习率等功能,使得模型的训练更加方便和高效。此外,YOLOv5还提供了丰富的API接口,方便开发者进行二次开发和应用。

四、YOLO的应用场景

(一)安防监控

YOLO在安防监控领域具有广泛的应用。它可以实时检测监控视频中的目标,如行人、车辆、动物等,并对异常行为进行预警。通过与报警系统相结合,YOLO可以有效地提高安防监控的效率和安全性。

(二)自动驾驶

在自动驾驶领域,YOLO可以用于检测道路上的车辆、行人、交通标志等目标。通过实时的目标检测和跟踪,自动驾驶系统可以做出更加准确的决策,提高驾驶的安全性和舒适性。

(三)工业检测

YOLO还可以应用于工业生产中的质量检测。它可以检测生产线上的产品是否存在缺陷、是否符合标准等。通过与自动化设备相结合,YOLO可以实现自动化的质量检测,提高生产效率和产品质量。

(四)医疗影像分析

在医疗影像领域,YOLO可以用于检测医学图像中的病变区域、器官等目标。通过与医生的诊断相结合,YOLO可以提高诊断的准确性和效率,为疾病的早期发现和治疗提供支持。

五、YOLO的实践案例

(一)环境准备

在开始实践之前,我们需要准备好相应的环境。以YOLOv5为例,我们需要安装Python、PyTorch等依赖库,并下载YOLOv5的源代码。以下是具体的安装步骤:

bash

复制

pip install torch torchvision

git clone https://github.com/ultralytics/yolov5

cd yolov5

pip install -r requirements.txt(二)数据准备

我们需要准备一个包含目标标注的数据集。以COCO数据集为例,它包含了80个类别的目标标注信息。我们可以使用YOLOv5提供的工具将COCO数据集转换为YOLO格式的数据集。

(三)模型训练

在数据准备完成后,我们可以开始训练YOLO模型。YOLOv5提供了简单的训练命令,如下所示:

bash

复制

python train.py --img 640 --batch 16 --epochs 50 --data coco.yaml --cfg models/yolov5s.yaml --weights '' --name yolov5s_results该命令将使用COCO数据集训练一个YOLOv5s模型,训练结果将保存在runs/train/yolov5s_results目录下。

(四)模型评估

在模型训练完成后,我们需要对模型的性能进行评估。YOLOv5提供了评估脚本,可以计算模型的准确率、召回率、mAP等指标。以下是评估命令:

bash

复制

python val.py --weights runs/train/yolov5s_results/weights/best.pt --data coco.yaml --img 640该命令将使用训练好的模型在COCO数据集上进行评估,并输出评估结果。

(五)模型推理

最后,我们可以使用训练好的模型进行推理。YOLOv5提供了推理脚本,可以对单张图片或视频进行目标检测。以下是推理命令:

bash

复制

python detect.py --weights runs/train/yolov5s_results/weights/best.pt --img 640 --conf 0.25 --source data/images该命令将使用训练好的模型对data/images目录下的图片进行目标检测,并将检测结果保存在runs/detect目录下。

六、总结

YOLO系列算法以其快速的检测速度和良好的检测效果在目标检测领域取得了巨大的成功。从YOLOv1到YOLOv5,YOLO不断改进和优化,使其在速度和精度上都取得了更好的平衡。通过本文的介绍,相信读者对YOLO算法有了更深入的了解。在未来的研究中,我们可以进一步探索YOLO算法的改进方向,如引入Transformer架构、改进损失函数等,以进一步提升YOLO的性能。同时,我们也可以将YOLO应用于更多的实际场景中,为解决实际问题提供支持。

七、参考文献

[1] Redmon J, Divvala S, Girshick R, et al. You Only Look Once: Unified, Real-Time Object Detection[J]. 2016.

[2] Redmon J, Farhadi A. YOLO9000: Better, Faster, Stronger[J]. 2017.

[3] Redmon J, Farhadi A. YOLOv3: An Incremental Improvement[J]. 2018.

[4] Bochkovskiy A, Wang C Y, Liao H Y M. YOLOv4: Optimal Speed and Accuracy of Object Detection[J]. 2020.

[5] Glenn Jocher. YOLOv5: Scalable Settings[J]. 2020.

如果你对YOLO算法感兴趣,或者在实践过程中遇到了问题,欢迎在评论区留言,我们一起交流学习!

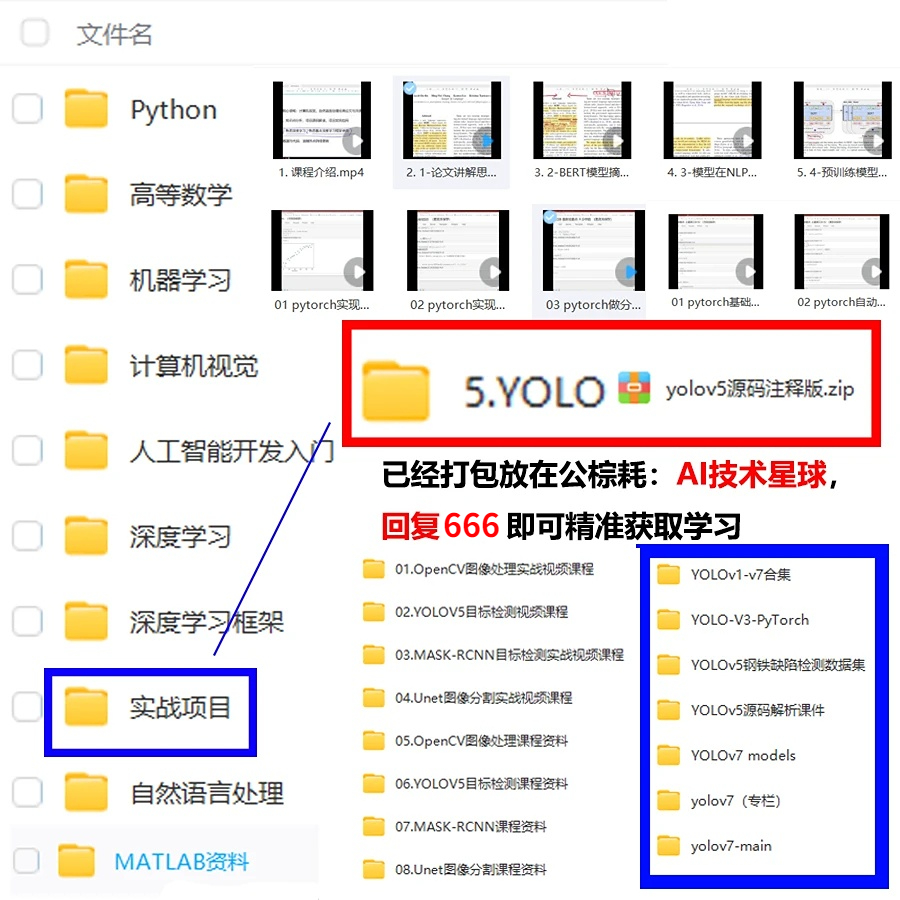

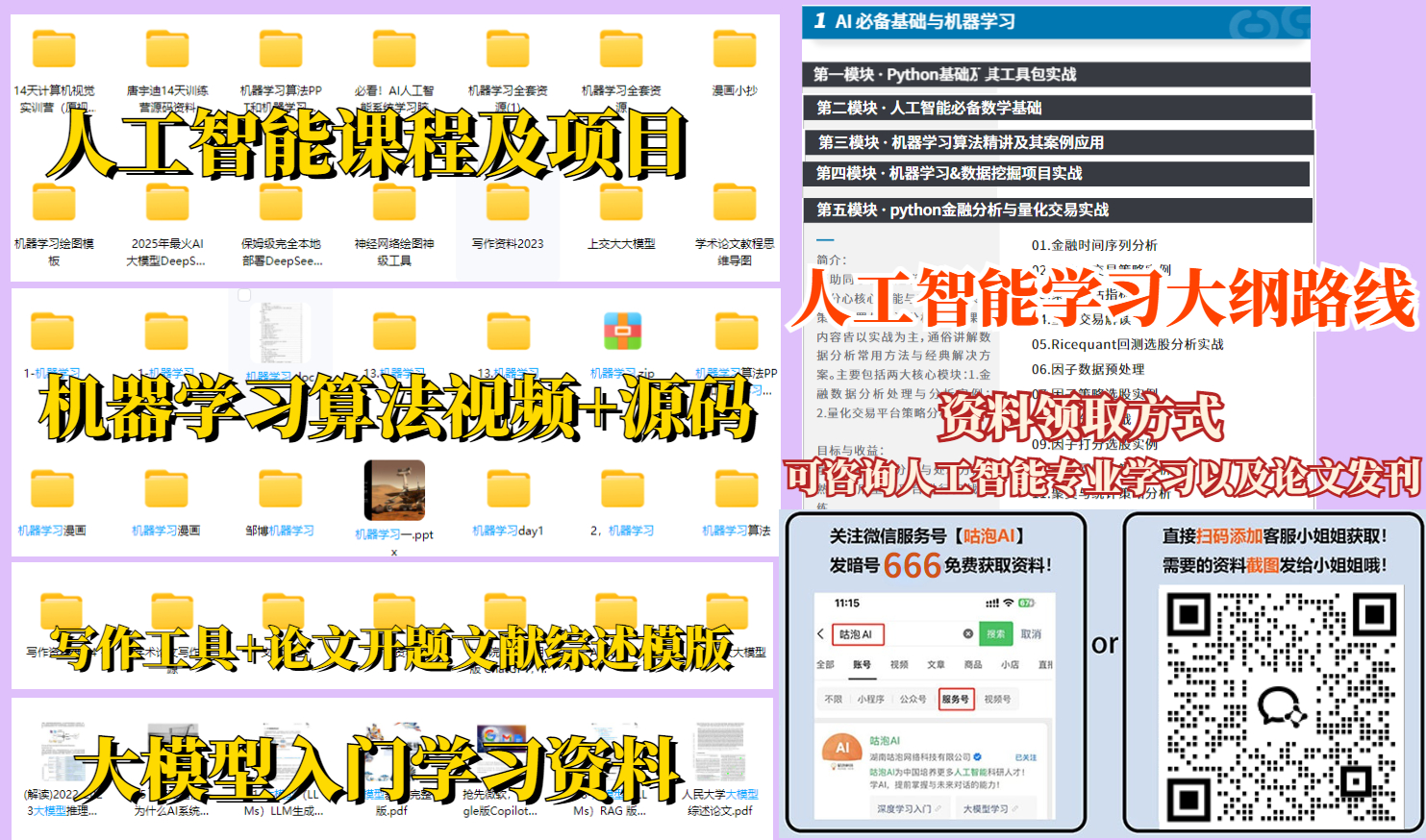

免费分享一些我整理的人工智能学习资料给大家,包括一些AI常用框架实战视频、图像识别、OpenCV、NLQ、机器学习、pytorch、计算机视觉、深度学习与神经网络等视频、课件源码、国内外知名精华资源、AI热门论文、行业报告等。

为了更好的系统学习AI,推荐大家收藏一份。

一、人工智能课程及项目

二、国内外知名精华资源

三、人工智能论文合集

四、人工智能行业报告

学好人工智能,要多看书,多动手,多实践,要想提高自己的水平,一定要学会沉下心来慢慢的系统学习,最终才能有所收获。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)