探索基于强化学习的车间调度:DQN 与 PPO 的应用之旅

基于强化学习的车间调度,dqn,ppo在当今制造业追求高效、智能生产的大背景下,车间调度这一古老而又关键的问题,正借助强化学习的力量焕发出新的活力。今天,咱们就来深入探讨一下基于强化学习的车间调度,重点聚焦深度 Q 网络(DQN)和近端策略优化算法(PPO)在其中的应用。

基于强化学习的车间调度,dqn,ppo

在当今制造业追求高效、智能生产的大背景下,车间调度这一古老而又关键的问题,正借助强化学习的力量焕发出新的活力。今天,咱们就来深入探讨一下基于强化学习的车间调度,重点聚焦深度 Q 网络(DQN)和近端策略优化算法(PPO)在其中的应用。

一、车间调度问题简述

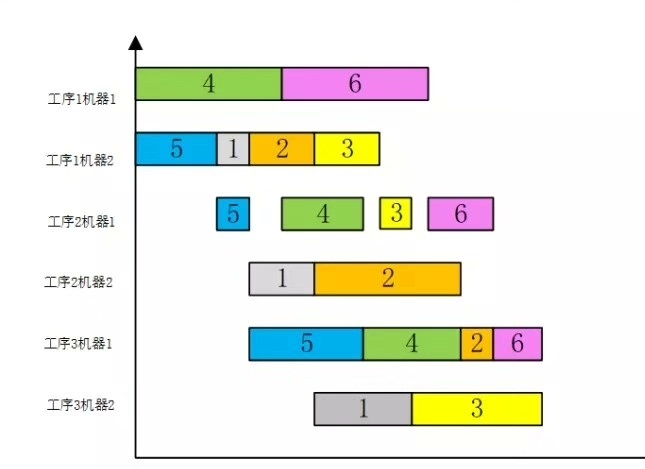

车间调度,简单来说,就是合理安排生产任务在各个机器上的加工顺序和时间,以达到诸如最小化完工时间、最大化设备利用率等目标。传统的车间调度方法,如启发式算法,虽然在一些场景下有不错的表现,但面对复杂多变的生产环境,往往显得力不从心。强化学习则提供了一种全新的思路,它让智能体在与环境的交互中不断学习,找到最优的调度策略。

二、深度 Q 网络(DQN)在车间调度中的应用

DQN 是一种将深度学习与 Q 学习相结合的算法,它能处理高维状态空间和动作空间的问题,非常适合车间调度这种复杂场景。

(1)DQN 的核心原理

Q 学习的核心是维护一个 Q 表,记录在每个状态下采取每个动作的预期回报。但在实际的车间调度中,状态空间巨大,用传统的 Q 表根本无法存储。DQN 则利用神经网络来近似这个 Q 函数。

(2)代码示例与分析

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

# 定义 Q 网络

class QNetwork(nn.Module):

def __init__(self, state_size, action_size):

super(QNetwork, self).__init__()

self.fc1 = nn.Linear(state_size, 64)

self.fc2 = nn.Linear(64, 64)

self.fc3 = nn.Linear(64, action_size)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = torch.relu(self.fc2(x))

return self.fc3(x)

# 初始化环境和网络

state_size = 10 # 假设状态空间维度为 10

action_size = 5 # 假设动作空间维度为 5

q_network = QNetwork(state_size, action_size)

optimizer = optim.Adam(q_network.parameters(), lr=0.001)

criterion = nn.MSELoss()

# 模拟训练过程

for episode in range(100):

state = np.random.rand(state_size)

state = torch.FloatTensor(state).unsqueeze(0)

for step in range(50):

q_values = q_network(state)

action = torch.argmax(q_values).item()

# 这里模拟与环境交互,获取新状态和奖励

new_state = np.random.rand(state_size)

new_state = torch.FloatTensor(new_state).unsqueeze(0)

reward = np.random.rand()

# 计算目标 Q 值

with torch.no_grad():

target_q = reward + 0.9 * torch.max(q_network(new_state))

current_q = q_values[0][action]

loss = criterion(current_q, target_q)

optimizer.zero_grad()

loss.backward()

optimizer.step()

state = new_state在这段代码中,首先定义了一个简单的 Q 网络 QNetwork,它有三层全连接层。forward 方法定义了数据在网络中的前向传播过程。然后初始化网络、优化器和损失函数。在训练循环中,每次从环境中获取一个状态,通过 Q 网络得到每个动作的 Q 值,选择 Q 值最大的动作执行(这里是简单模拟,实际车间调度要根据具体环境和动作定义)。与环境交互后得到新状态和奖励,根据贝尔曼方程计算目标 Q 值,再通过计算当前 Q 值与目标 Q 值的均方误差损失来更新网络参数。

三、近端策略优化算法(PPO)在车间调度中的应用

PPO 是一种基于策略梯度的算法,它直接优化策略网络,相比基于价值的 DQN 有一些独特的优势,比如在连续动作空间场景下表现更好,且策略更新更稳定。

(1)PPO 的核心原理

PPO 通过限制策略更新的幅度,避免更新过大导致策略性能急剧下降。它使用重要性采样来估计策略梯度,并引入一个裁剪函数,确保新策略和旧策略之间的差异在可控范围内。

(2)代码示例与分析

import torch

import torch.nn as nn

import torch.optim as optim

from torch.distributions import Categorical

# 定义策略网络

class PolicyNetwork(nn.Module):

def __init__(self, state_size, action_size):

super(PolicyNetwork, self).__init__()

self.fc1 = nn.Linear(state_size, 64)

self.fc2 = nn.Linear(64, 64)

self.fc3 = nn.Linear(64, action_size)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = torch.relu(self.fc2(x))

logits = self.fc3(x)

return Categorical(logits=logits)

# 初始化环境和网络

state_size = 10

action_size = 5

policy_network = PolicyNetwork(state_size, action_size)

optimizer = optim.Adam(policy_network.parameters(), lr=0.001)

# 模拟训练过程

for episode in range(100):

state = np.random.rand(state_size)

state = torch.FloatTensor(state).unsqueeze(0)

log_probs = []

rewards = []

for step in range(50):

dist = policy_network(state)

action = dist.sample()

log_prob = dist.log_prob(action)

log_probs.append(log_prob)

# 这里模拟与环境交互,获取新状态和奖励

new_state = np.random.rand(state_size)

new_state = torch.FloatTensor(new_state).unsqueeze(0)

reward = np.random.rand()

rewards.append(reward)

state = new_state

# 计算优势和目标

returns = []

discounted_return = 0

for r in rewards[::-1]:

discounted_return = r + 0.9 * discounted_return

returns.insert(0, discounted_return)

returns = torch.FloatTensor(returns)

advantages = returns - torch.mean(returns)

log_probs = torch.stack(log_probs)

old_log_probs = log_probs.detach()

for _ in range(3): # 多次更新

dist = policy_network(state)

new_log_probs = dist.log_prob(action)

ratio = torch.exp(new_log_probs - old_log_probs)

surr1 = ratio * advantages

surr2 = torch.clamp(ratio, 0.8, 1.2) * advantages

loss = -torch.min(surr1, surr2).mean()

optimizer.zero_grad()

loss.backward()

optimizer.step()在这段代码中,定义了一个策略网络 PolicyNetwork,它输出动作的概率分布(这里使用 Categorical 分布处理离散动作空间)。在训练过程中,智能体根据策略网络采样动作,记录动作的对数概率和奖励。之后计算回报和优势,通过重要性采样得到新旧策略的比率,利用裁剪函数计算损失并更新策略网络。多次更新策略网络可以让策略更加稳定地优化。

四、DQN 与 PPO 在车间调度中的比较

DQN 基于价值估计,通过学习 Q 函数来选择最优动作,适用于离散动作空间且状态空间可以较好地被神经网络近似的场景。它的优点是理论相对成熟,实现相对简单。但在面对连续动作空间或复杂的多目标优化时,可能会遇到困难。

PPO 基于策略梯度直接优化策略网络,在连续动作空间和多目标优化场景下表现更出色,且策略更新更稳定。不过,PPO 的实现相对复杂一些,需要更多的超参数调优。

基于强化学习的车间调度,dqn,ppo

在实际的车间调度应用中,要根据具体的生产环境特点、目标函数以及动作空间和状态空间的性质,合理选择 DQN 或 PPO,甚至可以考虑将两者结合,发挥各自的优势。

基于强化学习的车间调度为提升制造业生产效率开辟了广阔的道路,DQN 和 PPO 作为其中的重要算法,各有千秋。随着技术的不断发展,相信它们在车间调度以及更广泛的生产优化领域会有更出色的表现。希望今天的分享能让大家对基于强化学习的车间调度有更深入的理解,一起在这个充满挑战与机遇的领域探索前行。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)