【强烈收藏】RAG实战:腾讯开源WeKnora,让文档库秒变智能问答系统(保姆级教程)

【强烈收藏】RAG实战:腾讯开源WeKnora,让文档库秒变智能问答系统(保姆级教程)

腾讯开源了一个知识库系统,名字是WeKnora。

值得关注的是,这款系统在核心设计思路上,与 IMA 知识库存在一定相似性,至少说明这类基于 RAG 的智能知识库正在变得越来越热门。

- 选 WeKnora:若需处理复杂文档、私有化部署或行业垂直场景(如法律、医疗),其开源性和深度解析能力更具优势。

- 选 IMA:若侧重个人 / 团队知识管理、云端、微信生态协同及轻量级创作,IMA 的易用性和云端服务更贴合需求。

1、WeKnora 是什么?

简单来说,WeKnora 是一个基于 RAG(检索增强生成)架构的智能知识库框架。专为企业级复杂文档场景设计的开源智能知识库框架。 它会先对文档进行语义检索,找到和问题最相关的上下文,再交由大语言模型生成答案。这样回答内容更准确、更可追溯,也避免了胡编乱造。

目前在 GitHub 上,WeKnora 的 star 已经超过 6.1k。

WeKnora项目地址:https://github.com/Tencent/WeKnora

WeKnora 采用了模块化设计,构建了一条完整的“文档理解 + 检索 + 大模型推理”流水线。主要包括:

文档解析:支持上传常见的文本和 PDF。

向量化处理:把文档内容转化为向量,便于语义检索。

检索引擎:快速找到与提问最相关的片段。

大模型推理:调用本地或远程大模型生成答案。

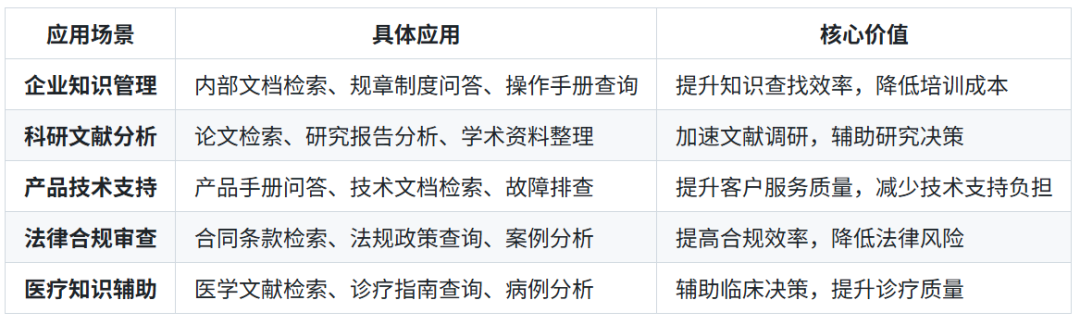

适用场景:

功能模块:

要是把企业里的文档堆比作 “乱成一锅粥的储物柜”—— 既有藏着表格公式的技术手册,又有混着图片的合同模板,还有存了三年的旧报告,那WeKnora就是个自带 “整理术 + 读心术” 的智能管家,专治各种 “找文档抓狂、问问题没谱” 的毛病。

2、FAQ常见问题

- 需要GPU吗? 答:推理阶段可选。用本地 Ollama + Qwen-7B,4 核 CPU 也能跑;追求速度可加一张 8 GB 显存的显卡。

- 数据会不会泄露? 答:完全离线部署时,数据只在内网硬盘。Docker 镜像可拉取后断网运行。

- 支持中文合同里的表格吗? 答:支持。表格会被解析成 Markdown 格式,再向量化检索,问答时能精确到“表 2-1 第三行”。

- 可以集成到公司现有系统吗? 答:提供 RESTful API,任何语言都可调用。返回 JSON 含答案、置信度、原文片段与页码。

- 如何更新知识库? 答:Web 界面支持“增量上传”。同名文件会覆盖旧版本,向量库自动更新。

- 是否支持权限管理? 答:开源版提供最基础的登录验证;企业版可对接 LDAP、OAuth2。

- 检索命中率低怎么办? 答:先在“链路追踪”里查看召回片段,如果相关度低,可调 BM25 权重或换 embedding 模型。

- 可以只搜索标题不搜索正文吗? 答:可以。检索策略支持“标题加权”,在配置文件里把 title_weight 调高即可。

- Docker 镜像多大? 答:完整镜像约 6 GB,含 Ollama+模型;如果自行托管模型,可缩减到 1.2 GB。

- 许可证允许商用吗? 答:MIT 许可证,可商用,只需保留原始版权声明。

3、本地部署教程和测试流程

1 本地部署

本地部署的环境要求:Docker、Docker Compose、Git

安装步骤如下:

1、克隆代码仓库

克隆主仓库

git clone https://github.com/Tencent/WeKnora.git

cd WeKnora

2、配置环境变量

复制示例配置文件

cp .env.example .env

编辑 .env,填入对应配置信息# 所有变量说明详见 .env.example 注释

3、启动服务

启动全部服务(含 Ollama 与后端容器)

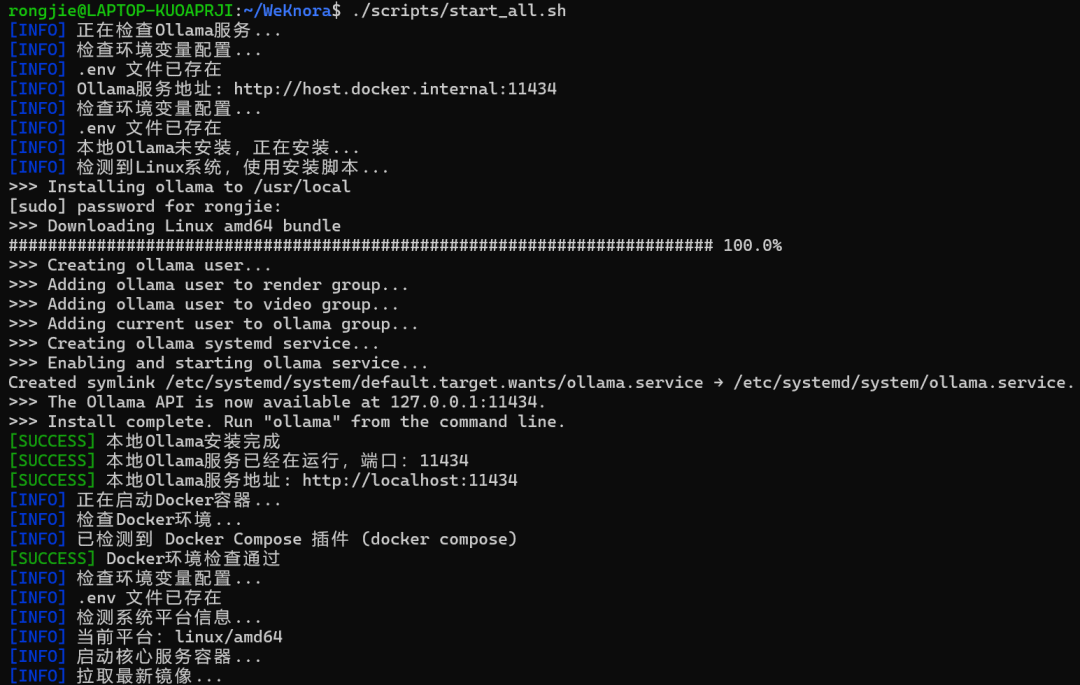

./scripts/start_all.sh

或

make start-all

4、停止服务

./scripts/start_all.sh --stop

或

make stop-all

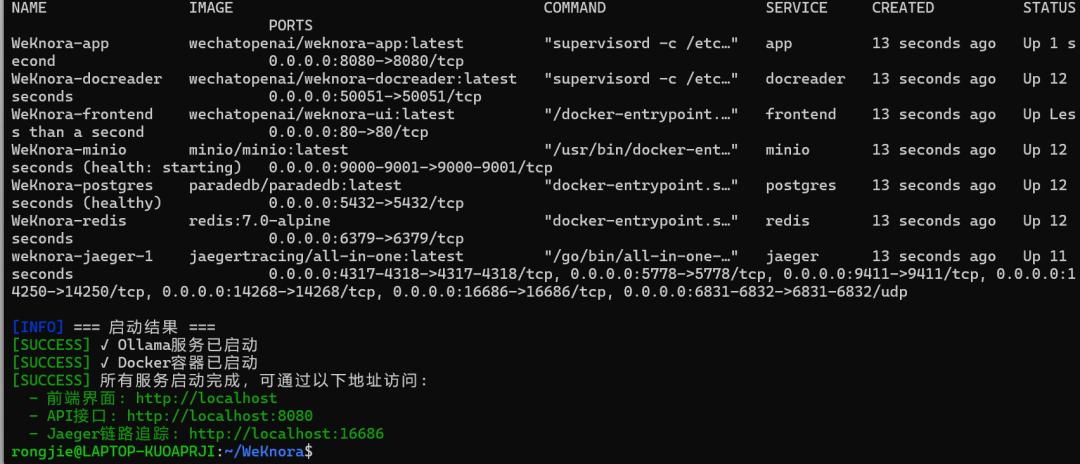

启动成功是这样子的:

成功后,访问地址:http://localhost,可以看到初始化配置页面。

2 系统初始化配置

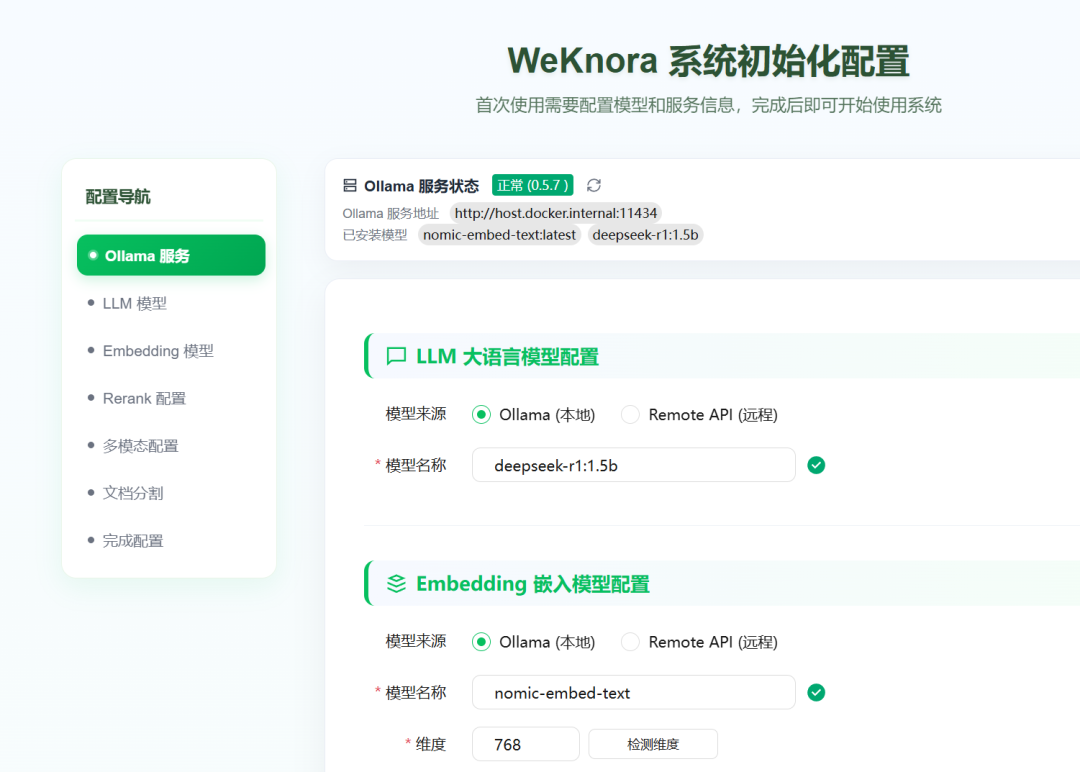

首次访问localhost会自动跳转到初始化配置页面,配置完成后会自动跳转到知识库页面。

请按照页面提示信息完成模型的配置。

不过这里有个小重点:WeKnora 特 “接地气”,能认你电脑本地装的 Ollama 模型。咱先 “自查” 一下,看看自己电脑里到底有没有

再打开 http://localhost 这个地址,一眼就能瞅见 Ollama 的服务状态:亮着 “正常” 的绿灯,说明它在好好干活儿。

已经检测到了我本地安装的deepseek-r1:1.5b和nomic-embed-text:latest模型。

如果你使用本地模型,就把这两个模型添加到LLM大语言模型和Embedding嵌入模型配置中。

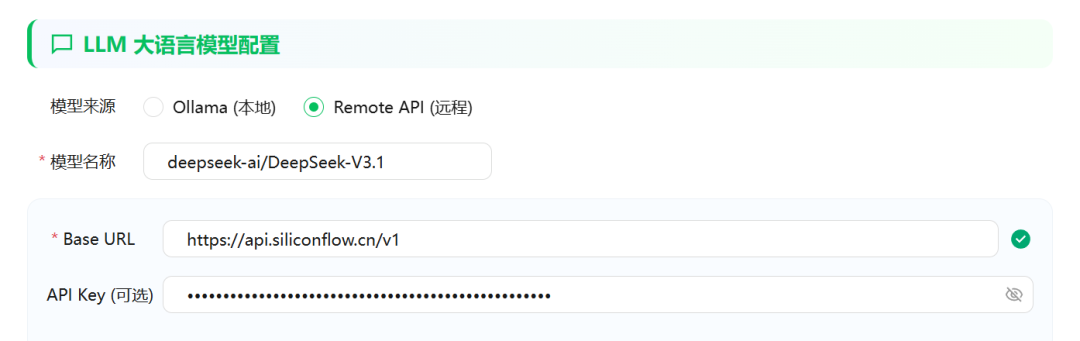

当然了,如果我们想要远程的模型也是可以的。

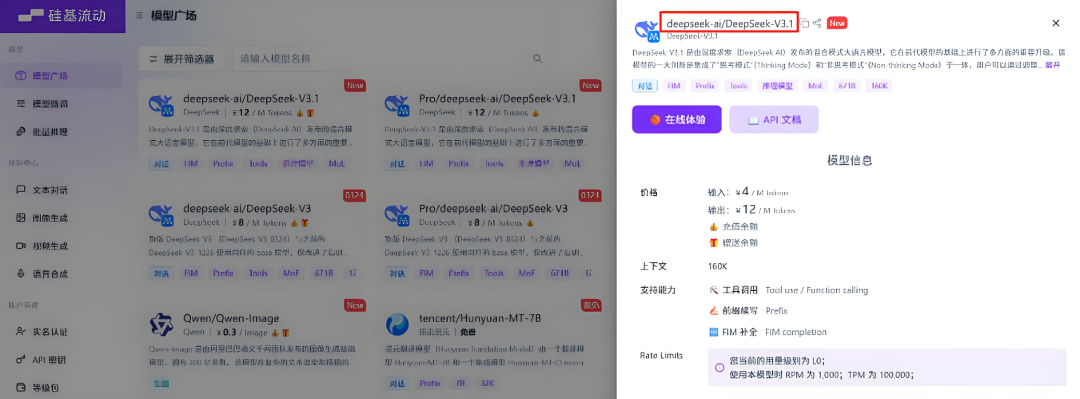

这里我就都改成硅基流动上面的DeepSeek最新的V3.1模型。

硅基流动API的URL地址:https://api.siliconflow.cn/v1

这个模型名称须要和硅基流动中的模型名称一样。

向量模型也改成硅基流动的BAAI/bge-m3模型。

Rerank重新排序模型选择了BAAI/bge-reranker-v2-m3,都可以根据自己实际情况进行更改。

多模态选择了千问的Qwen/Qwen2.5-VL-72B-Instruct。

需要上传一张本地的图片进行测试,可以看到图片被正常识别出来了。

只上传单张图片:

最后就是文档分割配置,分割策略可以选择均衡模式、精准模式、上下文模式、自定义。

只有在自定义模型下,才可以手动设置参数,分块大小、分块重叠及分隔符设置。

这样我们就完成了配置,后续也可以在设置中进行更改。

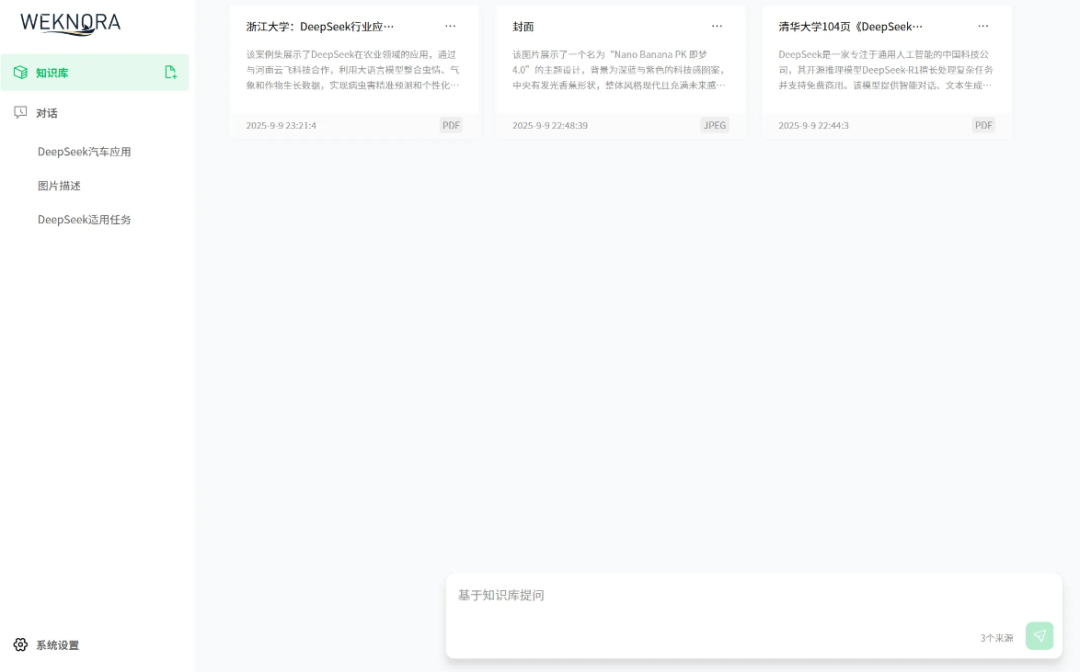

3 使用知识库

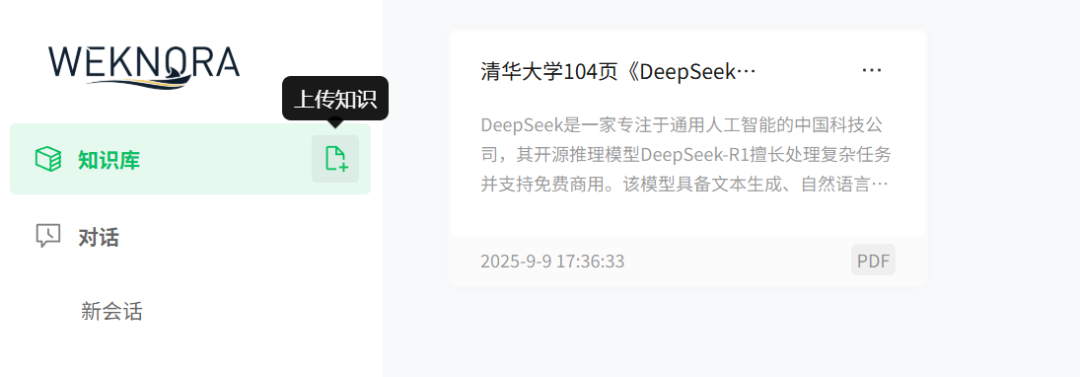

配置完成后就可以使用知识库了。

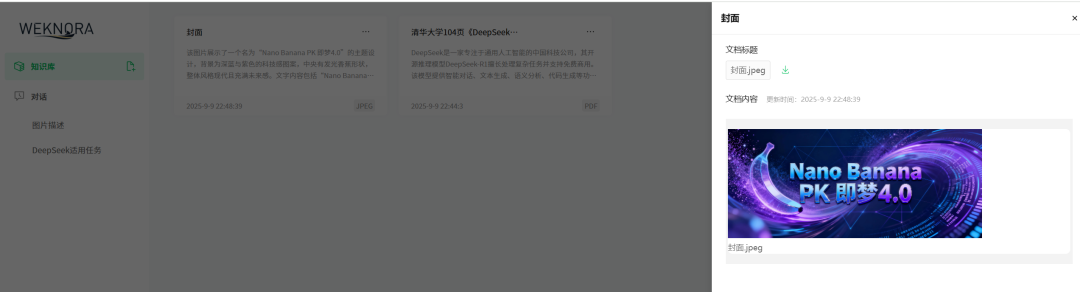

3.1 测试PDF文档

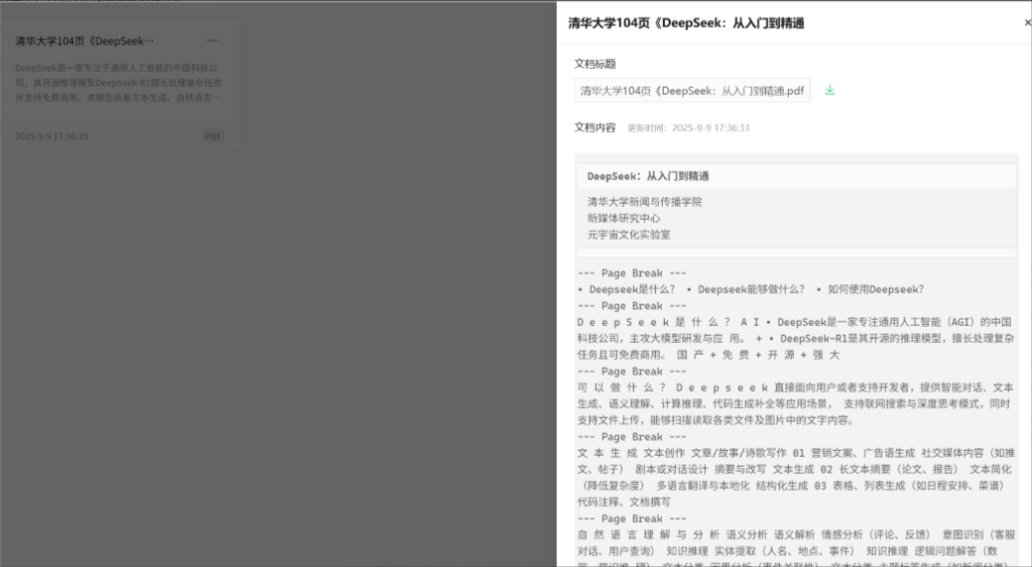

先上传一个PDF文件,清华大学那个DeepSeek使用的文档。

点击文档可以看到右侧显示分段的详情信息。

然后就是我们熟悉的向知识库提问环节。

这个问题DeepSeek适合做什么任务是结合了PDF中好几页的内容。

系统能从文档的多个部分整合答案,并在结果中显示引用来源。

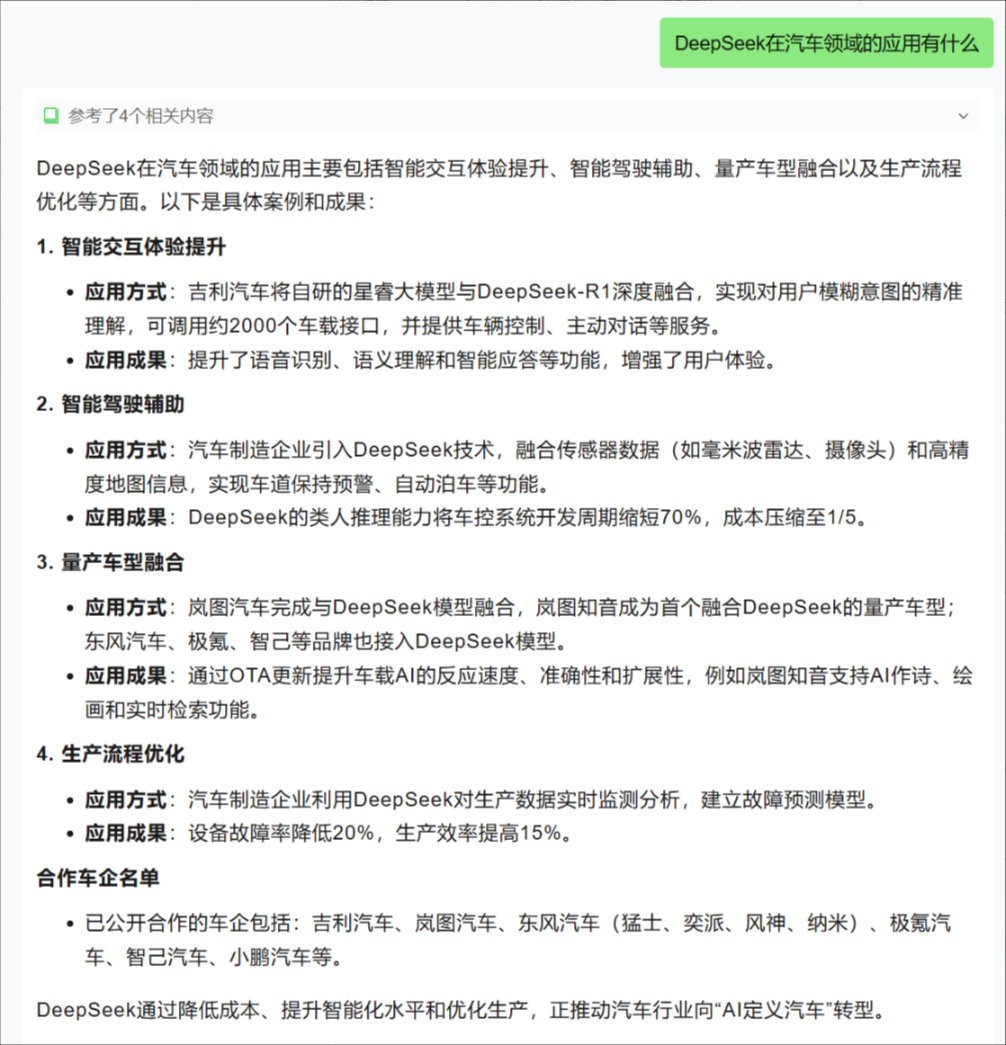

在测试一个,我又上传了《浙江大学:DeepSeek行业应用案例集》的PDF文件测试:

问个无关的问题,现在正火的预置菜问题,可以看到如果知识库没有此内容,回复是无法回答。

WeKnora 目前还有一些限制,比如:

暂时只支持单文件上传;

不能同时管理多个知识库;

总结下:WeKnora 就是帮用户解决 “文档乱、找得慢、用得慌” 的痛点 —— 不用再对着一堆文件抓狂,不用再怕问问题没依据,不用担心里敏感数据泄密,像个靠谱的 “文档小助手”,把复杂的知识捋顺了,让你用着省心又省事。

4、如何从零学会大模型?小白&程序员都能跟上的入门到进阶指南

当AI开始重构各行各业,你或许听过“岗位会被取代”的焦虑,但更关键的真相是:技术迭代中,“效率差”才是竞争力的核心——新岗位的生产效率远高于被替代岗位,整个社会的机会其实在增加。

但对个人而言,只有一句话算数:

“先掌握大模型的人,永远比后掌握的人,多一次职业跃迁的机会。”

回顾计算机、互联网、移动互联网的浪潮,每一次技术革命的初期,率先拥抱新技术的人,都提前拿到了“职场快车道”的门票。我在一线科技企业深耕12年,见过太多这样的案例:3年前主动学大模型的同事,如今要么成为团队技术负责人,要么薪资翻了2-3倍。

深知大模型学习中,“没人带、没方向、缺资源”是最大的拦路虎,我们联合行业专家整理出这套 《AI大模型突围资料包》,不管你是零基础小白,还是想转型的程序员,都能靠它少走90%的弯路:

- ✅ 小白友好的「从零到一学习路径图」(避开晦涩理论,先学能用的技能)

- ✅ 程序员必备的「大模型调优实战手册」(附医疗/金融大厂真实项目案例)

- ✅ 百度/阿里专家闭门录播课(拆解一线企业如何落地大模型)

- ✅ 2025最新大模型行业报告(看清各行业机会,避免盲目跟风)

- ✅ 大厂大模型面试真题(含答案解析,针对性准备offer)

- ✅ 2025大模型岗位需求图谱(明确不同岗位需要掌握的技能点)

所有资料已整理成包,想领《AI大模型入门+进阶学习资源包》的朋友,直接扫下方二维码获取~

① 全套AI大模型应用开发视频教程:从“听懂”到“会用”

不用啃复杂公式,直接学能落地的技术——不管你是想做AI应用,还是调优模型,这套视频都能覆盖:

- 小白入门:提示工程(让AI精准输出你要的结果)、RAG检索增强(解决AI“失忆”问题)

- 程序员进阶:LangChain框架实战(快速搭建AI应用)、Agent智能体开发(让AI自主完成复杂任务)

- 工程落地:模型微调与部署(把模型用到实际业务中)、DeepSeek模型实战(热门开源模型实操)

每个技术点都配“案例+代码演示”,跟着做就能上手!

课程精彩瞬间

② 大模型系统化学习路线:避免“学了就忘、越学越乱”

很多人学大模型走弯路,不是因为不努力,而是方向错了——比如小白一上来就啃深度学习理论,程序员跳过基础直接学微调,最后都卡在“用不起来”。

我们整理的这份「学习路线图」,按“基础→进阶→实战”分3个阶段,每个阶段都明确:

- 该学什么(比如基础阶段先学“AI基础概念+工具使用”)

- 不用学什么(比如小白初期不用深入研究Transformer底层数学原理)

- 学多久、用什么资料(精准匹配学习时间,避免拖延)

跟着路线走,零基础3个月能入门,有基础1个月能上手做项目!

③ 大模型学习书籍&文档:打好理论基础,走得更稳

想长期在大模型领域发展,理论基础不能少——但不用盲目买一堆书,我们精选了「小白能看懂、程序员能查漏」的核心资料:

- 入门书籍:《大模型实战指南》《AI提示工程入门》(用通俗语言讲清核心概念)

- 进阶文档:大模型调优技术白皮书、LangChain官方中文教程(附重点标注,节省阅读时间)

- 权威资料:斯坦福CS224N大模型课程笔记(整理成中文,避免语言障碍)

所有资料都是电子版,手机、电脑随时看,还能直接搜索重点!

④ AI大模型最新行业报告:看清机会,再动手

学技术的核心是“用对地方”——2025年哪些行业需要大模型人才?哪些应用场景最有前景?这份报告帮你理清:

- 行业趋势:医疗(AI辅助诊断)、金融(智能风控)、教育(个性化学习)等10大行业的大模型落地案例

- 岗位需求:大模型开发工程师、AI产品经理、提示工程师的职责差异与技能要求

- 风险提示:哪些领域目前落地难度大,避免浪费时间

不管你是想转行,还是想在现有岗位加技能,这份报告都能帮你精准定位!

⑤ 大模型大厂面试真题:针对性准备,拿offer更稳

学会技术后,如何把技能“变现”成offer?这份真题帮你避开面试坑:

- 基础题:“大模型的上下文窗口是什么?”“RAG的核心原理是什么?”(附标准答案框架)

- 实操题:“如何优化大模型的推理速度?”“用LangChain搭建一个多轮对话系统的步骤?”(含代码示例)

- 场景题:“如果大模型输出错误信息,该怎么解决?”(教你从技术+业务角度回答)

覆盖百度、阿里、腾讯、字节等大厂的最新面试题,帮你提前准备,面试时不慌!

以上资料如何领取?

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

为什么现在必须学大模型?不是焦虑,是事实

最近英特尔、微软等企业宣布裁员,但大模型相关岗位却在疯狂扩招:

- 大厂招聘:百度、阿里的大模型开发岗,3-5年经验薪资能到50K×20薪,比传统开发岗高40%;

- 中小公司:甚至很多传统企业(比如制造业、医疗公司)都在招“会用大模型的人”,要求不高但薪资可观;

- 门槛变化:不出1年,“有大模型项目经验”会成为很多技术岗、产品岗的简历门槛,现在学就是抢占先机。

风口不会等任何人——与其担心“被淘汰”,不如主动学技术,把“焦虑”变成“竞争力”!

最后:全套资料再领一次,别错过这次机会

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)