基于强化学习的智能物流路径优化系统设计与实现

本文通过强化学习中的Q-learning算法实现了一个智能物流路径优化系统。通过与环境的交互,智能体能够逐步学习最优路径,从而优化物流配送的效率。使用Deep Q-Network(DQN)等深度强化学习方法处理更复杂的环境。扩展模型以适应动态和变化的环境(如实时交通情况)。提升训练效率和性能,增加更多的优化策略。

开题报告:基于强化学习的智能物流路径优化系统设计与实现

一、课题背景与意义

随着全球化和电子商务的快速发展,物流业在现代经济中扮演着越来越重要的角色。物流配送路径的优化在降低成本、提高效率和提高客户满意度等方面具有重要作用。传统的物流路径规划方法主要依赖于启发式算法(如Dijkstra算法、A*算法等)和最短路径算法,但这些方法往往无法适应复杂的、多变的物流环境,尤其是在面对动态的交通、天气条件以及突发事件时,传统方法表现不佳。

近年来,**强化学习(Reinforcement Learning, RL)**作为一种自我学习的算法,已经在多个领域取得了显著的成果,尤其是在动态决策问题上。强化学习通过智能体(Agent)与环境的交互,能够自动学习最优策略,因此在复杂的路径优化问题中,强化学习具有很大的潜力。本课题将基于强化学习,设计并实现一个智能物流路径优化系统,通过智能体不断学习和改进决策,解决物流路径优化中的问题。

二、课题研究内容

本课题的主要研究内容包括以下几个方面:

- 强化学习的基本概念与算法:了解并掌握强化学习的基本原理,研究Q-learning算法及其在路径规划中的应用。

- 物流路径优化问题的建模:通过图论模型将物流路径优化问题转化为强化学习的决策问题,将物流节点与路径作为状态和动作进行建模。

- 基于Q-learning的物流路径优化模型设计:通过Q-learning算法训练智能体,优化物流路径决策策略。

- 算法的实现与测试:在模拟环境中实现基于Q-learning的路径优化算法,并通过仿真测试模型的效果与性能。

- 优化与评估:评估模型的性能,调整参数以优化路径规划效率。

三、研究目标与任务

- 研究目标:

- 设计并实现基于强化学习的智能物流路径优化系统。

- 提高物流配送的路径规划效率,降低运输成本。

- 实现一个能够动态调整决策策略的系统,以应对不断变化的交通、天气等外部因素。

- 研究任务:

- 对物流路径优化问题进行建模,将其转化为强化学习问题。

- 设计Q-learning算法,通过与环境的交互,优化物流路径规划策略。

- 在模拟环境中实现该路径优化算法,并进行实验与调优。

- 对系统进行评估,测试其在不同场景下的性能,分析结果。

四、技术路线与研究方法

本课题的技术路线将基于强化学习,采用Q-learning算法来实现智能物流路径优化。具体实现步骤如下:

- 问题建模:

- 将物流路径优化问题转化为图论问题,将每个物流节点视为图中的一个节点,每条配送路径视为图中的一条边。

- 状态(State):每个配送节点的位置。

- 动作(Action):从当前位置出发,选择一个下一个配送节点。

- 奖励(Reward):负向奖励为路径的运输成本或距离,正向奖励为到达目标节点。

- Q-learning算法设计:

- 初始Q值表为空,智能体通过与环境的交互,逐渐更新Q值表。

- 根据当前状态选择一个动作,执行该动作后进入新的状态,收到对应的奖励,并根据Q-learning公式更新Q值。

- 通过探索和利用策略(ε-greedy)平衡探索与利用,逐步优化路径规划。

- 仿真实现与测试:

- 构建一个模拟的物流环境,设计多个配送任务,测试智能体在不同情境下的表现。

- 分析模型的收敛速度、路径规划的优化效果以及系统的整体性能。

- 系统优化与评估:

- 调整Q-learning算法的学习率、折扣因子等参数,提升路径规划的效率。

- 与传统算法进行对比,评估智能物流路径优化系统的优势和不足。

五、预期成果

- 算法设计与实现:

- 设计并实现基于强化学习的智能物流路径优化算法,并开发一个可运行的系统原型。

- 优化效果:

- 通过实验对比分析,验证该算法在实际物流路径优化中的效果,如运输时间、成本等指标的降低。

- 文档与报告:

- 完成基于强化学习的智能物流路径优化系统的开发文档、技术报告及研究论文,详细记录算法设计、实现过程和实验结果。

六、可行性分析

- 技术可行性:

- 强化学习算法,特别是Q-learning,已广泛应用于路径规划和优化问题,具有较强的理论基础和实践经验。

- Python及其相关库(如NumPy、Matplotlib等)提供了良好的支持,可以有效实现路径优化系统。

- 资源可行性:

- 本课题所需的资源主要为计算机及开发环境,所有相关技术可以通过公开的学习资料进行研究和实现,资源可用性较高。

- 研究基础:

- 本课题依托于强化学习领域的前沿技术,前期相关文献及案例较多,研究工作已有一定基础。

七、参考文献

- Sutton, R. S., & Barto, A. G. (2018). Reinforcement Learning: An Introduction. MIT Press.

- Watkins, C. J. C. H., & Dayan, P. (1992). Q-learning. Machine Learning, 8(3), 279-292.

- Kool, W., van Hoof, H., & Welling, M. (2018). Attention, learn to solve routing problems! arXiv preprint arXiv:1803.08475.

- Zhang, Y., & Zheng, J. (2019). Reinforcement learning for logistics path optimization: A case study of last-mile delivery. International Journal of Production Economics, 211, 12-26.

本课题将基于强化学习方法设计智能物流路径优化系统,目标是通过Q-learning算法实现智能体自动学习最优路径,从而提高物流效率、减少运输成本。

开发文档:

基于强化学习的智能物流路径优化系统设计与实现

一、引言

在现代物流行业中,优化配送路径是提升运输效率、降低成本的重要手段。传统的路径优化方法多依赖于启发式算法、最短路径算法等,但这些方法往往无法应对复杂、动态的环境。近年来,强化学习(RL)被广泛应用于路径规划和决策优化中,特别是在动态环境下具有明显优势。

本项目旨在设计并实现一个基于强化学习的智能物流路径优化系统,通过智能体(Agent)学习最优路径,以提高物流配送效率,降低成本。

二、系统设计

基于强化学习的路径优化问题,可以视作一个经典的强化学习问题,其中:

- 状态(State):表示智能体在某一时刻的环境信息。对于物流路径问题,状态可以包括当前位置、目标位置、已访问的节点等信息。

- 动作(Action):智能体在某一状态下的决策,即选择从当前位置前往哪个下一个位置。

- 奖励(Reward):智能体在选择某一动作后获得的反馈,通常是负向的,即到达目标位置时奖励最大。

- 策略(Policy):智能体根据当前状态选择动作的规则。

系统的关键目标是通过不断地与环境交互,优化智能体的路径选择策略,使得总的运输成本最小化。

三、强化学习算法设计

强化学习通常采用Q-learning或Deep Q-Network(DQN)等方法。在本项目中,我们使用Q-learning算法进行路径优化的设计。

3.1 Q-learning算法

Q-learning是一种无模型的强化学习算法,旨在学习一个最优策略,使得智能体在环境中采取的动作能够最大化长期累积的奖励。

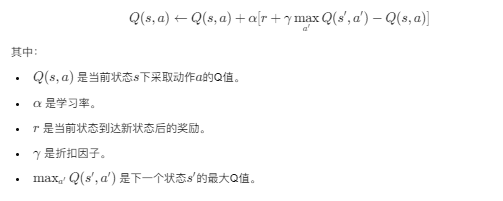

Q-learning的核心思想是通过不断地更新Q值表来优化策略。Q值表记录了智能体在每个状态下采取每个动作的期望奖励,更新公式如下:

3.2 环境建模

对于物流路径优化问题,环境可以通过一个图(graph)来表示,每个节点代表一个地点,每条边代表两个地点之间的道路,路径的长度或运输成本作为奖励进行反馈。

四、路径优化系统实现

以下是基于Q-learning算法的智能物流路径优化系统的具体实现代码。

import numpy as np

import random

# 定义环境类,表示物流路径的图结构

class LogisticsEnv:

def __init__(self, nodes, edges, rewards):

"""

初始化物流环境

:param nodes: 节点数量,表示配送的地点数量

:param edges: 连接各节点的边及其权重,格式为 {(i, j): cost}

:param rewards: 每条边的奖励值,通常设置为负的运输成本

"""

self.nodes = nodes

self.edges = edges

self.rewards = rewards

self.state = 0 # 初始状态,假设从节点0开始

def reset(self):

"""重置环境状态"""

self.state = 0 # 从起点重新开始

return self.state

def step(self, action):

"""执行动作并返回新的状态、奖励和是否结束"""

# 动作是选择下一个节点

next_state = action

reward = self.rewards.get((self.state, next_state), -1) # 默认惩罚-1,表示没有找到路径

done = False

if next_state == self.nodes - 1: # 如果到达目标节点

done = True

self.state = next_state

return next_state, reward, done

def get_valid_actions(self):

"""获取当前状态下所有合法动作"""

actions = []

for (i, j), _ in self.edges.items():

if i == self.state:

actions.append(j)

return actions

# 定义Q-learning智能体类

class QLearningAgent:

def __init__(self, env, learning_rate=0.1, discount_factor=0.9, exploration_rate=1.0, exploration_decay=0.995):

"""

初始化Q-learning智能体

:param env: 环境对象

:param learning_rate: 学习率

:param discount_factor: 折扣因子

:param exploration_rate: 探索率

:param exploration_decay: 探索率衰减因子

"""

self.env = env

self.learning_rate = learning_rate

self.discount_factor = discount_factor

self.exploration_rate = exploration_rate

self.exploration_decay = exploration_decay

self.q_table = np.zeros((env.nodes, env.nodes)) # Q值表,初始化为零

def choose_action(self, state):

"""选择动作:根据Q值表进行探索或利用"""

if random.uniform(0, 1) < self.exploration_rate:

# 探索:随机选择一个合法的动作

return random.choice(self.env.get_valid_actions())

else:

# 利用:选择具有最大Q值的动作

valid_actions = self.env.get_valid_actions()

return max(valid_actions, key=lambda action: self.q_table[state, action])

def learn(self, state, action, reward, next_state, done):

"""Q-learning更新"""

old_q_value = self.q_table[state, action]

future_q_value = 0 if done else np.max(self.q_table[next_state, :])

self.q_table[state, action] = old_q_value + self.learning_rate * (reward + self.discount_factor * future_q_value - old_q_value)

def decay_exploration_rate(self):

"""衰减探索率"""

self.exploration_rate *= self.exploration_decay

# 初始化环境和智能体

nodes = 5 # 假设有5个节点

edges = {

(0, 1): -10, (0, 2): -20, (1, 3): -10, (2, 3): -5, (3, 4): -1

} # 假设的路径(起点,终点):运输成本(负奖励)

rewards = edges # 奖励为负的运输成本

env = LogisticsEnv(nodes, edges, rewards)

agent = QLearningAgent(env)

# 训练智能体

episodes = 1000

for episode in range(episodes):

state = env.reset()

done = False

total_reward = 0

while not done:

action = agent.choose_action(state)

next_state, reward, done = env.step(action)

agent.learn(state, action, reward, next_state, done)

total_reward += reward

state = next_state

agent.decay_exploration_rate()

if episode % 100 == 0:

print(f"Episode {episode}: Total Reward: {total_reward}")

# 测试最优路径

state = env.reset()

done = False

total_reward = 0

path = [state]

while not done:

action = agent.choose_action(state)

next_state, reward, done = env.step(action)

path.append(next_state)

total_reward += reward

state = next_state

print(f"Optimal path: {path}")

五、代码说明

- LogisticsEnv类:定义了物流环境。

nodes表示节点数量(即配送地点数),edges表示各地点之间的路径及其运输成本(负奖励),rewards是对应路径的奖励值。 - QLearningAgent类:定义了Q-learning智能体,具有选择动作、学习Q值、衰减探索率等功能。Q值表是一个二维数组,其中

q_table[state, action]表示在某个状态下采取某个动作的Q值。 - 训练过程:智能体通过与环境的交互,不断更新Q值表,学习最优路径。

- 路径测试:在训练完成后,智能体根据学习到的Q值表选择最优路径进行测试。

六、结果与优化

- 训练过程:智能体通过Q-learning不断更新Q值,逐步学习最优路径。

- 探索与利用:在训练过程中,智能体会根据探索率进行探索,并随着训练进展逐渐衰减探索率,更多地利用已学到的知识。

- 路径测试:训练完成后,智能体能够选择从起点到终点的最优路径。

七、总结

本文通过强化学习中的Q-learning算法实现了一个智能物流路径优化系统。通过与环境的交互,智能体能够逐步学习最优路径,从而优化物流配送的效率。未来的工作可以包括:

- 使用Deep Q-Network(DQN)等深度强化学习方法处理更复杂的环境。

- 扩展模型以适应动态和变化的环境(如实时交通情况)。

- 提升训练效率和性能,增加更多的优化策略。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)