DDPG深度确定性策略梯度强化学习控制系统matlab仿真实现

DDPG(Deep Deterministic Policy Gradient)是一种用于连续动作空间的无模型强化学习算法。它结合了深度神经网络和确定性策略梯度定理,能够有效地学习到最优策略。该算法的目标是在环境中找到一个最优策略,使得智能体(agent)能够最大化累积奖励。

目录

1.DDPG简介

DDPG(Deep Deterministic Policy Gradient)是一种用于连续动作空间的无模型强化学习算法。它结合了深度神经网络和确定性策略梯度定理,能够有效地学习到最优策略。该算法的目标是在环境中找到一个最优策略,使得智能体(agent)能够最大化累积奖励。

1.Actor-Critic 架构

DDPG采用了 Actor-Critic 架构,包含两个主要部分:

2.经验回放

3.目标网络(Target Network)

4.Critic网络的更新

Critic网络的目标是最小化时间差分(TD)误差。TD 误差的计算基于贝尔曼方程(Bellman Equation):

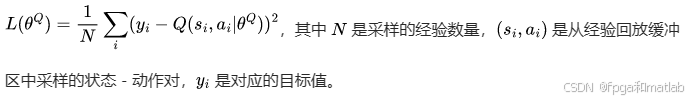

Critic网络的损失函数可以定义为均方误差(MSE)损失:

5.Actor网络的更新

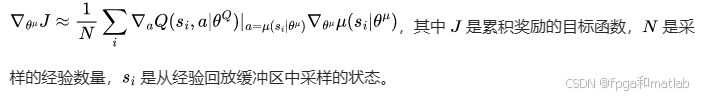

演员网络的更新是基于评论家网络的输出。演员网络的目标是最大化状态 - 动作价值函数 ,因此其策略梯度可以通过以下公式计算:

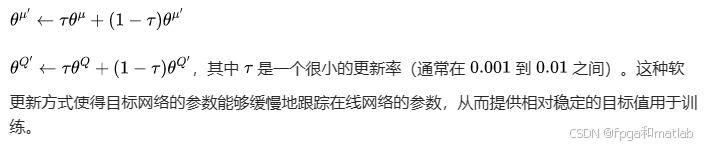

目标网络的参数通过软更新(Soft - update)的方式进行更新,公式如下:

2. DDPG在控制系统中的应用案例

(一)机器人运动控制

在机器人运动控制领域,DDPG可以用于控制机器人的关节角度和速度,以实现精确的轨迹跟踪和任务执行。例如,对于一个机械臂,状态空间(S)可以包括机械臂各关节的角度、角速度以及末端执行器的位置和姿态等信息。动作空间(A)可以是各关节的扭矩或速度指令。

通过DDPG算法,机械臂可以学习到在不同的初始状态下,如何通过调整关节的动作来完成特定的任务,如抓取物体、在特定路径上移动等。在训练过程中,奖励函数可以根据机械臂是否准确地到达目标位置、是否稳定地执行任务等因素来设计。与传统的控制方法相比,DDPG能够更好地适应复杂的环境和任务需求,提高机器人的控制精度和灵活性。

(二)自动驾驶车辆控制

在自动驾驶领域,DDPG可以用于控制车辆的行驶速度、转向角度等。状态空间(S)可以包括车辆的速度、位置、周围障碍物的信息等。动作空间(A)可以是加速、减速、左转、右转等操作。

DDPG算法可以使车辆学习到在不同的路况和交通环境下,如何做出最优的驾驶决策,以确保行驶的安全和高效。例如,在遇到前方车辆突然减速时,车辆能够通过学习到的策略自动调整速度和行驶方向,避免碰撞。与基于规则的自动驾驶控制方法相比,DDPG能够通过大量的训练数据学习到更加复杂和灵活的驾驶策略,提高自动驾驶的可靠性。

(三)电力系统控制

在电力系统中,DDPG可以用于控制电力设备的运行,如发电机的输出功率、变压器的分接头调节等。状态空间(S)可以包括电网的电压、频率、功率分布等信息。动作空间(A)可以是发电机的励磁调节、变压器的分接头调整等操作。

通过DDPG算法,电力系统可以学习到在不同的负荷需求和电网状态下,如何优化设备的运行,以提高电力系统的稳定性和效率。例如,在电网负荷高峰期,通过调整发电机的输出功率,确保电网的电压和频率稳定。DDPG在电力系统控制中的应用可以有效地提高电力系统的智能化水平,降低运行成本。

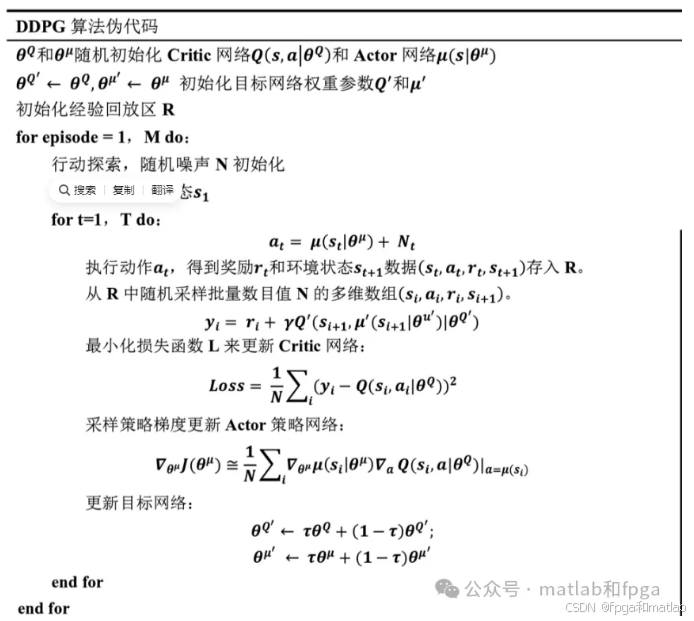

3. DDPG伪代码

4. matlab代码

% 清除工作区和命令窗口

clear;

clc;

% 定义环境,这里以连续的CartPole环境为例

env = rlPredefinedEnv("CartPole-Continuous");

% 获取状态和动作信息

stateInfo = getObservationInfo(env);

actionInfo = getActionInfo(env);

% 定义Actor网络

actorNet = [

featureInputLayer(stateInfo.Dimension(1),'Normalization','none','Name','state')

fullyConnectedLayer(256,'Name','fc1')

reluLayer('Name','relu1')

fullyConnectedLayer(256,'Name','fc2')

reluLayer('Name','relu2')

fullyConnectedLayer(actionInfo.Dimension(1),'Name','action')

tanhLayer('Name','tanh')

scaleLayer(actionInfo.UpperLimit - actionInfo.LowerLimit,'Name','scale')

biasLayer(actionInfo.LowerLimit,'Name','bias')

];

actorOpts = rlRepresentationOptions('LearnRate',1e-4,'GradientThreshold',1);

actor = rlDeterministicActorRepresentation(actorNet,stateInfo,'Observation',{'state'},'Action',{'action'},actorOpts);

% 定义Critic网络

criticNet = [

featureInputLayer(stateInfo.Dimension(1),'Normalization','none','Name','state')

fullyConnectedLayer(256,'Name','fc1')

reluLayer('Name','relu1')

additionLayer(2,'Name','add')

fullyConnectedLayer(256,'Name','fc2')

reluLayer('Name','relu2')

fullyConnectedLayer(1,'Name','value')

];

criticOpts = rlRepresentationOptions('LearnRate',1e-3,'GradientThreshold',1);

critic = rlQValueRepresentation(criticNet,stateInfo,actionInfo,'Observation',{'state'},'Action',{'action'},criticOpts);

% 定义DDPG Agent

agentOpts = rlDDPGOptions('SampleTime',env.SampleTime,'TargetSmoothFactor',1e-3,'ExperienceBufferLength',1e6,...

'MiniBatchSize',128,'DiscountFactor',0.99,'ActorOptimizerOptions',actorOpts,...

'CriticOptimizerOptions',criticOpts);

agent = rlDDPGAgent(actor,critic,agentOpts);

% 训练选项

maxEpisodes = 500;

maxStepsPerEpisode = 500;

trainOpts = rlTrainingOptions('MaxEpisodes',maxEpisodes,'MaxStepsPerEpisode',maxStepsPerEpisode,...

'Verbose',true,'Plots','training-progress');

% 开始训练

trainingStats = train(agent, env, trainOpts);

% 保存训练好的agent

save('trainedDDPGAgent.mat','agent');

% 测试训练好的agent

load('trainedDDPGAgent.mat');

simOptions = rlSimulationOptions('MaxSteps',1000);

experience = sim(env, agent, simOptions);

% 绘制测试结果

plot(experience.Steps, experience.Observations);

title('State Trajectories during Testing');

xlabel('Step');

ylabel('State Value');

% 定义自定义环境的示例代码(可根据需要实现自己的环境)

classdef CustomEnv < rl.env.MATLABEnvironment

properties

% 定义状态空间的维度

StateDimension = 4;

% 定义动作空间的维度

ActionDimension = 1;

% 定义动作的上下限

ActionInfo = rlNumericSpec([1 1],'LowerLimit',-1,'UpperLimit',1);

% 定义状态的上下限

ObservationInfo = rlNumericSpec([4 1],'LowerLimit',-inf,'UpperLimit',inf);

% 定义折扣因子

DiscountFactor = 0.99;

end

methods

function [nextObservation, reward, isDone, loggedSignals] = step(obj, action)

% 这里实现环境的动态

% 例如,假设一个简单的线性动态系统

% 当前状态

currentObservation = obj.Observation;

% 状态转移

nextObservation = [currentObservation(2:end); action];

% 奖励函数

reward = -sum(abs(currentObservation));

% 终止条件

isDone = false;

if abs(currentObservation(1)) > 2

isDone = true;

end

loggedSignals = [];

end

function reset(obj)

% 初始化状态

obj.Observation = rand(obj.StateDimension, 1);

end

end

end

% 可以使用自定义环境进行训练

customEnv = CustomEnv();

agentOpts = rlDDPGOptions('SampleTime',1,'TargetSmoothFactor',1e-3,'ExperienceBufferLength',1e6,...

'MiniBatchSize',128,'DiscountFactor',0.99,'ActorOptimizerOptions',actorOpts,...

'CriticOptimizerOptions',criticOpts);

agent = rlDDPGAgent(actor,critic,agentOpts);

trainOpts = rlTrainingOptions('MaxEpisodes',maxEpisodes,'MaxStepsPerEpisode',maxStepsPerEpisode,...

'Verbose',true,'Plots','training-progress');

trainingStats = train(agent, customEnv, trainOpts);5. 测试结果

待测试......

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)