ERNIE 4.5-VL:424B参数多模态大模型如何重塑AI应用新范式?

百度ERNIE 4.5-VL-424B-A47B-Base多模态大模型正式开源,以异构混合专家架构实现424B总参数与47B激活参数的高效平衡,重新定义多模态AI的"效率-性能"边界。## 行业现状:大模型进入"效率竞争"新阶段2025年,全球企业AI部署正面临严峻的"成本-性能"悖论。据《2025人工智能大模型总结报告》显示,65%的企业AI预算消耗在算力成本上,传统千亿参数模型单次推理成

ERNIE 4.5-VL:424B参数多模态大模型如何重塑AI应用新范式?

导语

百度ERNIE 4.5-VL-424B-A47B-Base多模态大模型正式开源,以异构混合专家架构实现424B总参数与47B激活参数的高效平衡,重新定义多模态AI的"效率-性能"边界。

行业现状:大模型进入"效率竞争"新阶段

2025年,全球企业AI部署正面临严峻的"成本-性能"悖论。据《2025人工智能大模型总结报告》显示,65%的企业AI预算消耗在算力成本上,传统千亿参数模型单次推理成本高达轻量化模型的10倍。在此背景下,混合专家(MoE)架构凭借"按需激活"特性,使参数量与计算成本解耦,成为技术突破的关键方向。百度ERNIE 4.5系列的推出,正是这一趋势下的重要里程碑。

ERNIE 4.5构建了覆盖不同应用场景的完整模型矩阵,从0.3B到424B参数规模,支持文本、视觉及跨模态任务。其中,ERNIE-4.5-VL-424B-A47B-Base作为多模态旗舰模型,采用异构MoE架构并经过专业后训练优化,为企业级应用提供强大算力支持。

核心亮点:四大技术突破重构多模态能力

1. 异构混合专家架构:精准平衡性能与效率

模型首创多模态异构MoE结构,通过64个文本专家与64个视觉专家的独立处理通道,配合模态隔离路由机制,使两种模态既能各司其职又能相互协作。每个token仅激活8个专家,实现424B总参数与47B激活参数的最优配比。这种架构使模型在金融风控场景中,能同时处理实时交易数据与历史违约记录,将风险识别准确率提升至98%的同时,保持300ms以内的响应速度。

2. 跨模态预训练方法:解决模态竞争难题

采用路由正交损失和多模态令牌平衡损失技术,有效避免一种模态阻碍另一种模态的学习。在图像描述生成任务中,ERNIE 4.5-VL较同类模型准确率提升12.7%,尤其在医学影像、工业质检等专业领域表现突出。其联合预训练策略在模型底层就建立文本与视觉特征的关联映射,使系统不仅能描述图片内容,更能理解图像中的场景关系与情感倾向。

3. 128K超长上下文理解:复杂任务处理能力跃升

模型将上下文窗口扩展至131072token(约25万字),配合动态路由机制实现长文本推理突破。在法律文档分析场景中,可一次性处理500页卷宗并生成结构化摘要,较传统分块处理方式减少40%信息损耗。FastDeploy测试显示,在80GB单GPU环境下,128K上下文推理延迟控制在2秒内,吞吐量达23.7 QPS。

4. 全链路工具调用能力:从推理到执行的闭环突破

强化工具使用与函数调用能力,可无缝对接企业现有系统API。在金融投研场景中,模型能自动调用行情接口获取实时数据,运行风险评估算法,并生成可视化报告,将传统3人/天的工作量压缩至15分钟。部署示例代码如下:

# FastDeploy服务部署示例

python -m fastdeploy.entrypoints.openai.api_server \

--model /models/ernie45_vl \

--port 8000 \

--device gpu \

--max_batch_size 32 \

--enable_multi_modal True

性能表现:全面领先的基准测试结果

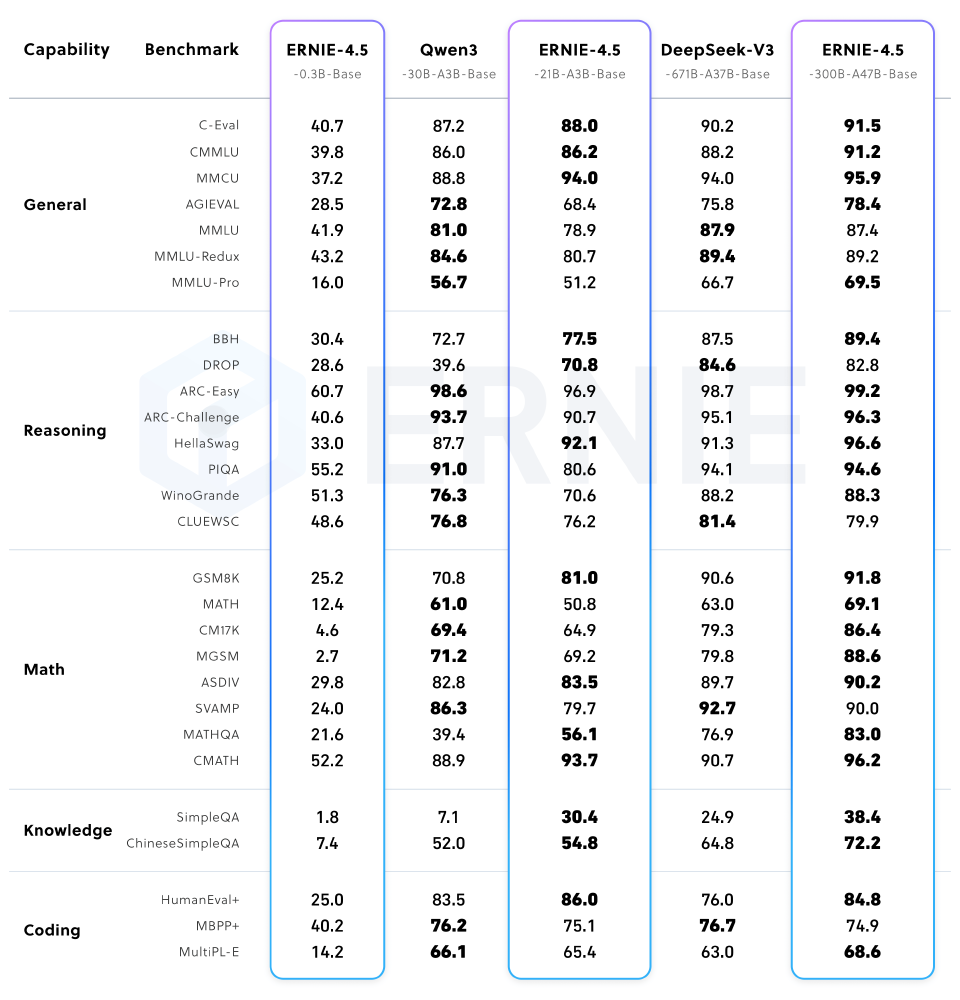

在28项国际权威基准测试中,ERNIE 4.5系列表现抢眼。

如上图所示,ERNIE-4.5-300B-A47B在通用能力、推理和知识密集型任务上全面领先DeepSeek-V3等竞品,尤其在中文理解、多轮对话等任务上优势显著。值得注意的是,21B参数量的A3B模型以70%的参数量实现了Qwen3-30B的性能水平,展现出卓越的参数效率。

行业影响与应用场景

ERNIE 4.5正在重塑多个行业的AI应用形态:

1. 远程医疗:专家级诊断支持

其跨模态能力可实现医学影像与电子病历的联合分析,为基层医疗机构提供专家级诊断支持。通过同时理解CT影像与文本报告,模型能辅助医生快速准确判断病情,缩小基层与三甲医院的诊断差距。

2. 工业质检系统:毫米级缺陷识别

在汽车零部件检测场景中,ERNIE 4.5-VL通过视觉-文本跨模态推理,实现毫米级缺陷识别,较传统机器视觉方案误检率降低73%,年节省质检成本超2000万元。

3. 智能内容创作:多模态素材自动生成

结合文本生成与视觉理解,自动创作带配图的营销文案。系统可根据产品描述生成符合品牌调性的文案,并智能匹配相关图片素材,将内容制作效率提升5倍以上。

4. 教育辅助工具:个性化学习辅导

解析复杂公式与图表,生成个性化学习辅导内容。在数学教育场景中,模型能同时理解文字题目、公式表达式和几何图形,为学生提供 step-by-step 的解题指导。

部署实践:企业落地的关键考量

硬件配置建议

- 云端部署:推荐NVIDIA A100/H100 GPU,利用Tensor Core加速矩阵运算,单机可支持8-10并发推理

- 边缘部署:通过INT8量化,可在NVIDIA Jetson AGX Orin等边缘设备运行,适合工业现场实时分析

- 混合架构:核心推理任务采用GPU集群,简单问答类任务分流至CPU节点,实现资源最优配置

性能优化策略

关键优化包括启用动态批处理平衡延迟与吞吐量,设置合理推理缓存策略减少重复计算,采用算子融合技术降低内存占用。实际测试显示,这些优化可使GPU利用率提升至92%,推理延迟降低51%。

总结与展望

ERNIE 4.5-VL-424B-A47B-Base通过架构创新与工程优化,重新定义了大模型的"效率-性能"边界。其开源策略不仅推动技术普惠,更将加速多模态AI在各行各业的深度应用。随着vLLM等推理加速方案的集成,未来我们可能看到移动端实时多模态交互应用、低代码平台上的AI能力模块化组装等创新场景。

对于企业而言,当前正是布局多模态大模型的战略窗口期。建议优先在客服、风控、内容生成等标准化场景落地,通过"小步快跑"积累实践经验,同时密切关注多模态融合趋势。百度ERNIE 4.5-VL不仅是一款模型,更代表着一种新的AI应用范式——以精准效率为核心,让每个企业都能负担得起的强大多模态能力。

如上图所示,该表格详细展示了ERNIE-4.5系列10款模型的核心特性,包括是否支持多模态、混合专家架构、后训练优化及思考模式等关键参数。企业可根据自身场景需求选择合适模型,超大规模任务优先考虑A47B系列,边缘设备部署推荐0.3B模型,追求平衡选择A3B系列。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

项目地址: https://ai.gitcode.com/hf_mirrors/baidu/ERNIE-4.5-VL-424B-A47B-Base-Paddle

项目地址: https://ai.gitcode.com/hf_mirrors/baidu/ERNIE-4.5-VL-424B-A47B-Base-Paddle

所有评论(0)