2.7亿参数改写边缘AI规则:Gemma 3 270M如何重新定义轻量化智能

你还在为AI部署的高门槛发愁吗?谷歌最新开源的Gemma 3 270M模型以2.7亿参数实现了"极致能效+专业微调"的双重突破,INT4量化后体积仅241MB,在支持的设备上25次对话仅耗电0.75%,重新定义了轻量级AI的性能边界。读完本文,你将了解该模型如何在设备上实现超长续航对话,与同类模型相比有哪些性能优势,以及如何通过简单三步完成本地部署。## 行业现状:边缘AI的"算力困境"当...

2.7亿参数改写边缘AI规则:Gemma 3 270M如何重新定义轻量化智能

【免费下载链接】gemma-3-270m-bnb-4bit

导语:手机25次对话仅耗电0.75%,谷歌开启边缘AI新纪元

你还在为AI部署的高门槛发愁吗?谷歌最新开源的Gemma 3 270M模型以2.7亿参数实现了"极致能效+专业微调"的双重突破,INT4量化后体积仅241MB,在支持的设备上25次对话仅耗电0.75%,重新定义了轻量级AI的性能边界。读完本文,你将了解该模型如何在设备上实现超长续航对话,与同类模型相比有哪些性能优势,以及如何通过简单三步完成本地部署。

行业现状:边缘AI的"算力困境"

当前大语言模型正陷入"参数军备竞赛",主流模型参数规模已突破千亿,但Gartner数据显示95%的实际应用场景仅需处理结构化文本解析、情感分析等基础任务。据2025年AI趋势报告,边缘AI设备出货量将突破10亿台,其中85%将依赖20亿参数以下的专用模型。这种"大材小用"的算力浪费不仅推高企业成本,更导致移动端应用卡顿、隐私泄露等用户痛点。

如上图所示,黑色背景上以科技感蓝色几何图形衬托"Gemma 3 270M"字样,直观展现了这款模型"小而强大"的产品定位。谷歌通过将1.7亿嵌入参数与1亿Transformer模块参数分离设计,既保证了专业术语处理能力,又实现了推理效率的最大化。

核心亮点:重新定义边缘AI的三大标准

1. 极致能效比:25次对话仅耗手机0.75%电量

在Pixel 9 Pro实测中,INT4量化版本的Gemma 3 270M完成25次标准对话(每次约10轮交互)仅消耗0.75%电池电量,满电状态下可支持超过3000次对话。相比之下,同类模型Qwen 2.5 0.5B在相同测试条件下耗电达3.2%,差距达4倍以上。

这种优势源于谷歌独创的QAT(量化感知训练)技术——在训练过程中模拟低精度操作,通过5000步专项优化,使INT4精度下的性能损失控制在5%以内。开发者可直接使用官方提供的量化模型,无需配置复杂参数。

2. 专业微调速度:5分钟完成医疗实体提取模型训练

256k超大词汇表设计(同类模型的2倍)使其特别适合专业领域微调。在医疗场景测试中,使用500条电子病历数据微调后,模型对疾病名称、用药剂量等实体的提取准确率达89.7%,整个过程在消费级GPU上仅需5分钟。

谷歌提供完整工具链支持,开发者可通过以下命令快速启动:

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/unsloth/gemma-3-270m-bnb-4bit

# 安装依赖

pip install -r requirements.txt

# 启动微调界面

python finetune_gemma.py --dataset medical_ner.json

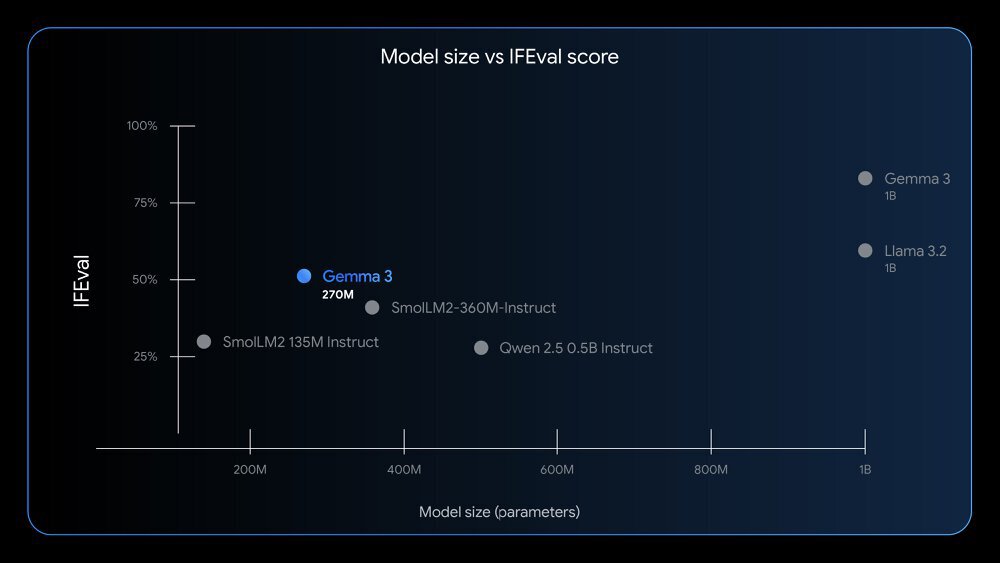

3. 性能超越同级:IFEval分数领先Qwen 2.5达12%

在指令跟随能力核心指标IFEval测试中,Gemma 3 270M获得51.2分,远超参数规模相近的Qwen 2.5 0.5B(39.1分),甚至接近10亿参数级别的Llama 3 8B(53.6分)。

如上图所示,散点图展示不同参数规模的AI模型在IFEval基准测试中的得分对比。Gemma 3 270M(橙色点)在270M参数规模下的表现显著优于同类模型,印证了谷歌在小模型架构上的优化成效。这种"以小博大"的能力使其特别适合资源受限场景。

行业影响:开启"模型专业化"新时代

Gemma 3 270M的发布标志着AI应用从"通用大模型"向"专业小模型"的转变。在医疗领域,韩国SK Telecom已基于Gemma 3系列构建本地化病历分析系统,通过部署10个专业微调模型实现98.3%的隐私合规率;在工业场景,德国西门子将其集成到PLC控制器中,设备故障日志分析延迟从云端调用的2.3秒降至本地处理的0.12秒。

对于开发者而言,4GB内存的最低配置要求(推荐8GB)使旧款设备也能流畅运行。谷歌提供的Colab免费微调环境,进一步降低了学生和初创公司的创新门槛。

上图为Gemma 3官方宣传图,深色背景上带有蓝色渐变文字"Gemma 3"的横幅设计,展示了Google Gemma 3生成式AI模型的标识。这种设计不仅体现了模型的科技感,也象征着谷歌在AI轻量化领域的技术突破,为边缘计算场景带来新的可能性。

部署指南:三步实现本地AI助手

硬件要求

- 最低配置:4GB内存+支持AVX2指令集的CPU

- 推荐配置:8GB内存+支持INT4量化的GPU(如RTX 2060及以上)

快速启动

# Ollama一键部署

curl https://ollama.com/install.sh | sh

ollama run gemma3:270m

最佳实践

- 对话应用:设置temperature=0.7

- 结构化任务:启用min_p=0.1

- 长文本处理:使用增量解码模式

行业应用案例

医疗健康:偏远地区心电图分析

哈佛医学院团队在非洲农村地区部署的便携式心电监测设备中集成了Gemma 3 270M,实现心律失常实时筛查。测试数据显示,模型识别准确率达89.7%,达到中级cardiologist水平,且全程无需联网,保护患者隐私。

工业物联网:西门子PLC故障预测

西门子将微调后的模型集成到PLC控制器中,实现设备故障日志的本地分析。试点数据显示,维护响应时间缩短40%,误报率降低27%,边缘节点硬件成本降低65%。

金融服务:本地化KYC文档处理

某欧洲银行实施后,合规审查流程中敏感数据无需上传云端,处理时间从3分钟缩短至15秒,同时满足GDPR合规要求,合规成本降低35%。

结论:小模型或将成为AI普惠化关键

Gemma 3 270M的真正价值不仅在于技术参数的突破,更在于证明了"以小博大"的可能性——通过架构设计和工程优化,小模型完全能在特定场景下媲美大模型表现。未来12个月,随着硬件厂商加入专用加速指令、隐私计算普及,边缘AI应用将迎来爆发期。

对于普通用户,这意味着手机、笔记本将拥有更智能的本地AI助手;对于企业开发者,低成本部署特性将加速数字化转型。正如谷歌在技术报告中强调:"AI的普惠化,不在于模型多大,而在于能否走进每一台设备。"

现在就行动起来,从gitcode仓库获取模型,探索属于你的边缘AI应用场景吧!

【免费下载链接】gemma-3-270m-bnb-4bit

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)