刚刚,DeepSeek公布新论文,R2确定要来了吗?

动态计算优化 论文可能提出在推理阶段动态调整模型计算路径的技术(如条件计算、自适应深度/宽度),根据输入复杂度分配资源,从而在保证精度的同时降低延迟与算力消耗。成本-性能均衡框架 提出量化评估推理效率的指标(如每美元推理吞吐量),并通过自动化工具链实现模型压缩、量化、蒸馏等技术的协同优化,帮助企业在成本与性能间找到最佳平衡。生态适配性 R2的成功依赖于开发者社区的支持与主流框架(PyTorch、T

刚刚,DeepSeek公布新论文,R2确定要来了吗?

原创 李玉侠 OxyAI Studio 李玉侠 2025年04月04日 14:50 广东

DeepSeek近期发布的关于推理时Scaling的新论文确实引发了行业对“R2”的广泛猜测。尽管目前官方尚未正式确认R2的具体形态和发布时间,但结合论文内容与行业动态,可以对其潜在方向与影响进行合理推测:

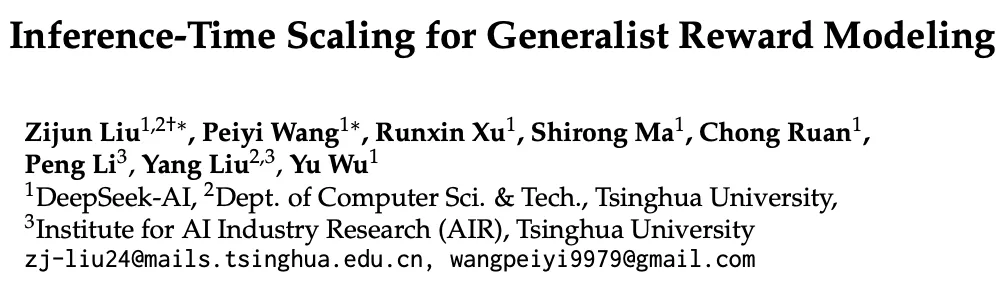

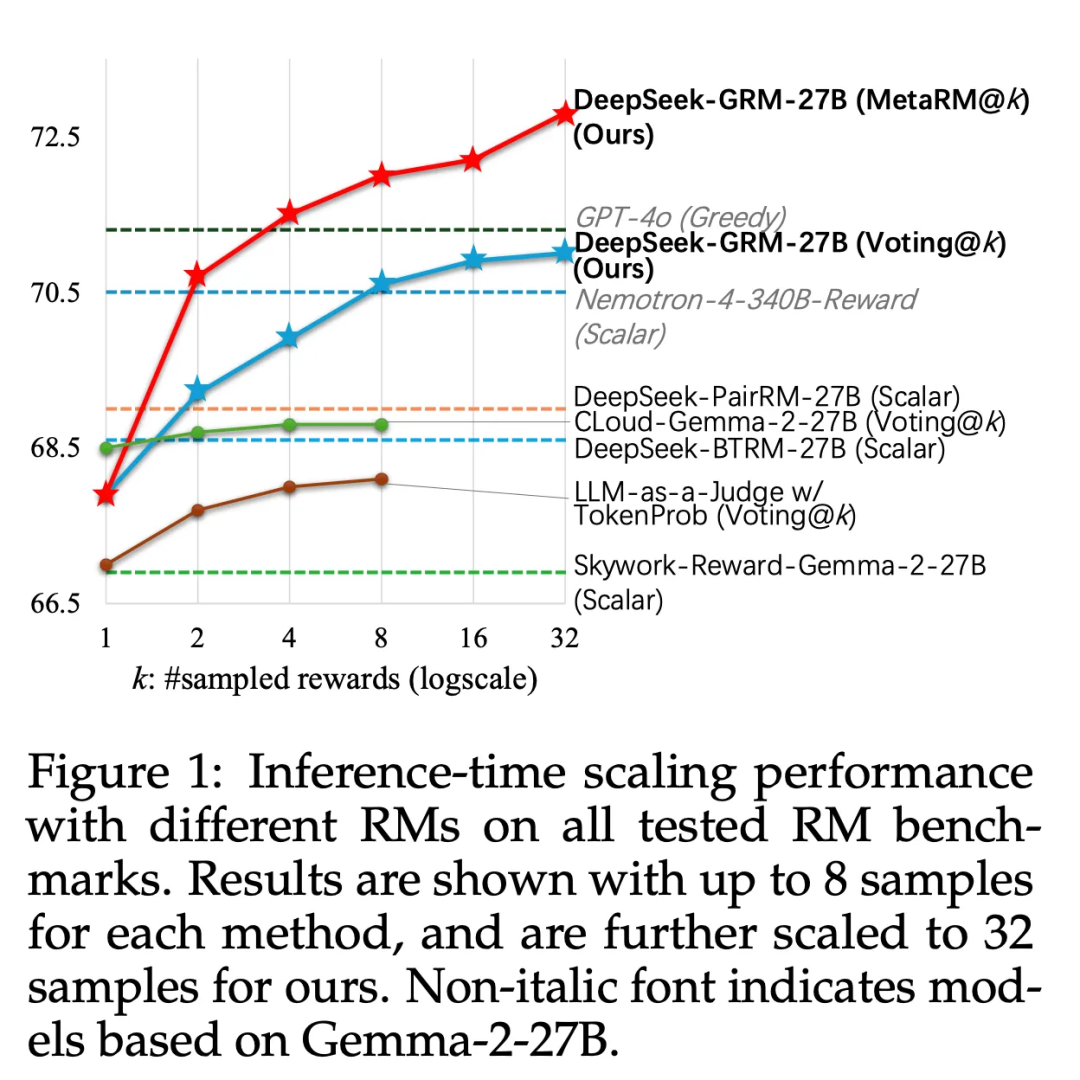

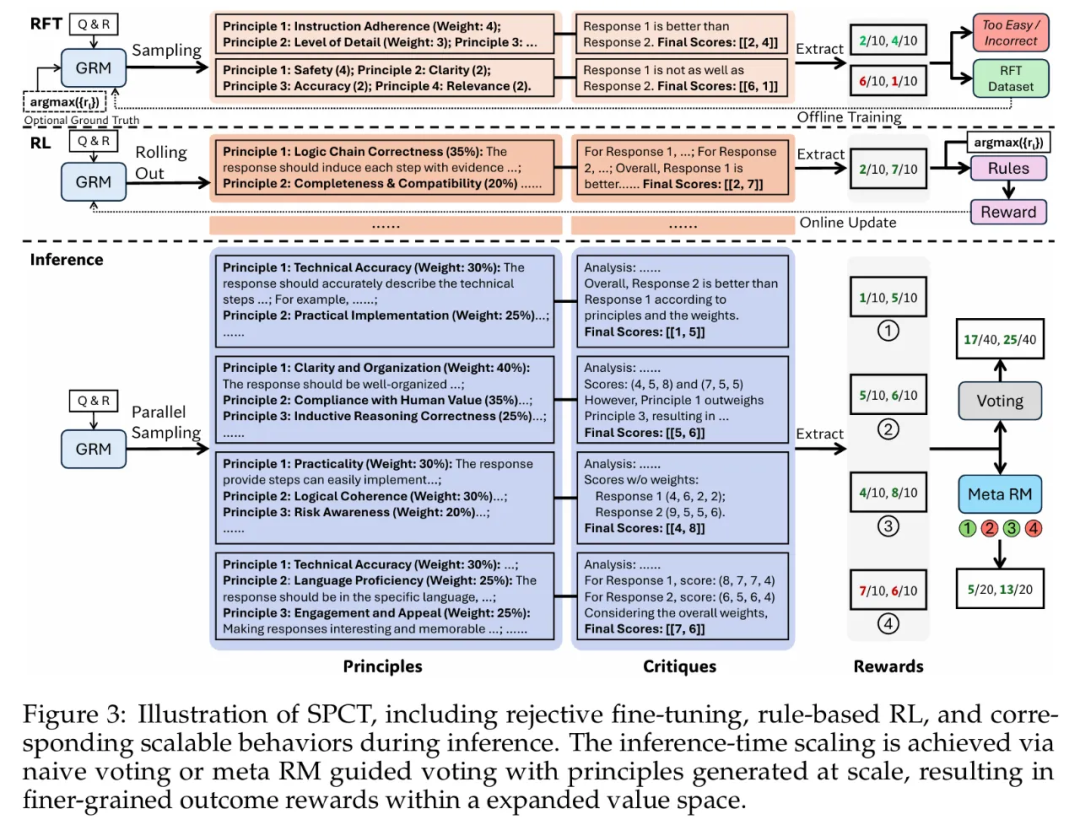

论文标题:Inference-Time Scaling for Generalist Reward Modeling

论文链接:https://arxiv.org/abs/2504.02495

1. 论文核心:推理时Scaling的创新点

动态计算优化 论文可能提出在推理阶段动态调整模型计算路径的技术(如条件计算、自适应深度/宽度),根据输入复杂度分配资源,从而在保证精度的同时降低延迟与算力消耗。类似Switch Transformer的稀疏激活机制,但更侧重推理阶段的灵活性。

硬件-算法协同设计 可能探索针对特定硬件(如GPU集群、边缘设备)的推理优化策略,通过模型架构与部署环境的深度适配,最大化硬件利用率。例如,结合张量并行与内存压缩技术减少通信开销。

成本-性能均衡框架 提出量化评估推理效率的指标(如每美元推理吞吐量),并通过自动化工具链实现模型压缩、量化、蒸馏等技术的协同优化,帮助企业在成本与性能间找到最佳平衡。

2. R2的潜在定位与价值

可能性一 新一代推理引擎

R2可能是基于论文技术的开源或商用推理框架,支持主流模型(如LLaMA、GPT系列)的高效部署,特点包括:

动态自适应计算 根据输入自动选择最优子模型或计算路径。

异构硬件支持 优化CPU/GPU/TPU及边缘设备的资源调度。

极简API与工具链 提供模型压缩、量化、服务监控的一站式解决方案。

可能性二 升级版模型架构

R2可能是DeepSeak新一代预训练模型,内置推理优化设计,例如:

模块化结构 支持按需激活不同功能模块,减少冗余计算。

多粒度量化原生支持 训练时即考虑低精度推理兼容性,提升部署效率。

可能性三 全栈AI基础设施

整合训练、推理、监控的端到端平台,R2作为核心组件提供:

弹性算力池 按需动态扩展推理资源,支持突发流量与长尾需求。

碳足迹追踪 将论文中的“AI脱碳”理念落地,量化推理能耗并推荐优化策略。

3. 对行业的影响与挑战

打破推理成本瓶颈 若R2能实现论文宣称的效率提升,将显著降低大模型落地门槛,推动AI在中小企业的普及。例如,实时视频分析、个性化推荐等场景的TCO(总拥有成本)可能下降30%以上。

重构竞争格局 现有推理服务商(如AWS Inferentia、NVIDIA Triton)可能面临压力,需加速技术迭代或与DeepSeek合作集成R2。

新风险与治理问题 动态计算可能引入输出不一致性(如同一输入在不同资源分配下结果漂移),需建立新的测试标准与监控体系。

4. 理性看待“R2到来

技术成熟度 论文成果通常需经过工程化打磨才能产品化,R2的实际性能可能受限于真实场景的复杂性(如网络延迟、数据噪声)。

生态适配性 R2的成功依赖于开发者社区的支持与主流框架(PyTorch、TensorFlow)的兼容性,DeepSeak需构建完善的文档与案例库。

商业化路径 若作为开源工具,需通过企业版增值服务盈利;若为闭源产品,则面临与云计算巨头的竞争。

结论:谨慎乐观,持续关注

DeepSeek的论文确实为推理优化提供了新思路,R2的推出可能性较高,但其具体形态、性能优势与市场接受度仍需时间验证。建议开发者与企业:

1. 技术预研 深入理解论文方法论,评估现有业务中可试验的场景(如高并发API服务)。

2. 生态对接 关注DeepSeek开源社区动态,提前规划技术栈适配。

3. 成本测算 对比R2与现有方案(如vLLM、TGI)的潜在收益,制定迁移路线图。

R2是否“确定到来”,取决于DeepSeak能否将学术突破转化为稳定、易用的产品,而这正是AI工程化最难的一环。

更多内容,可阅读论文

https://arxiv.org/abs/2504.02495

更多推荐

已为社区贡献81条内容

已为社区贡献81条内容

所有评论(0)