Clawdbot+Qwen3:32B开源方案:GPU算力优化下的AI代理平台实践

本文介绍了如何在星图GPU平台上自动化部署Clawdbot整合qwen3:32b代理网关与管理平台镜像,实现高效的AI代理服务构建与管理。该方案通过统一的Web界面简化了AI代理的创建和监控流程,典型应用于智能对话系统和多模型协同任务处理,显著降低了AI应用开发门槛并优化了GPU资源利用率。

Clawdbot+Qwen3:32B开源方案:GPU算力优化下的AI代理平台实践

1. 项目概述:当AI代理遇上大模型

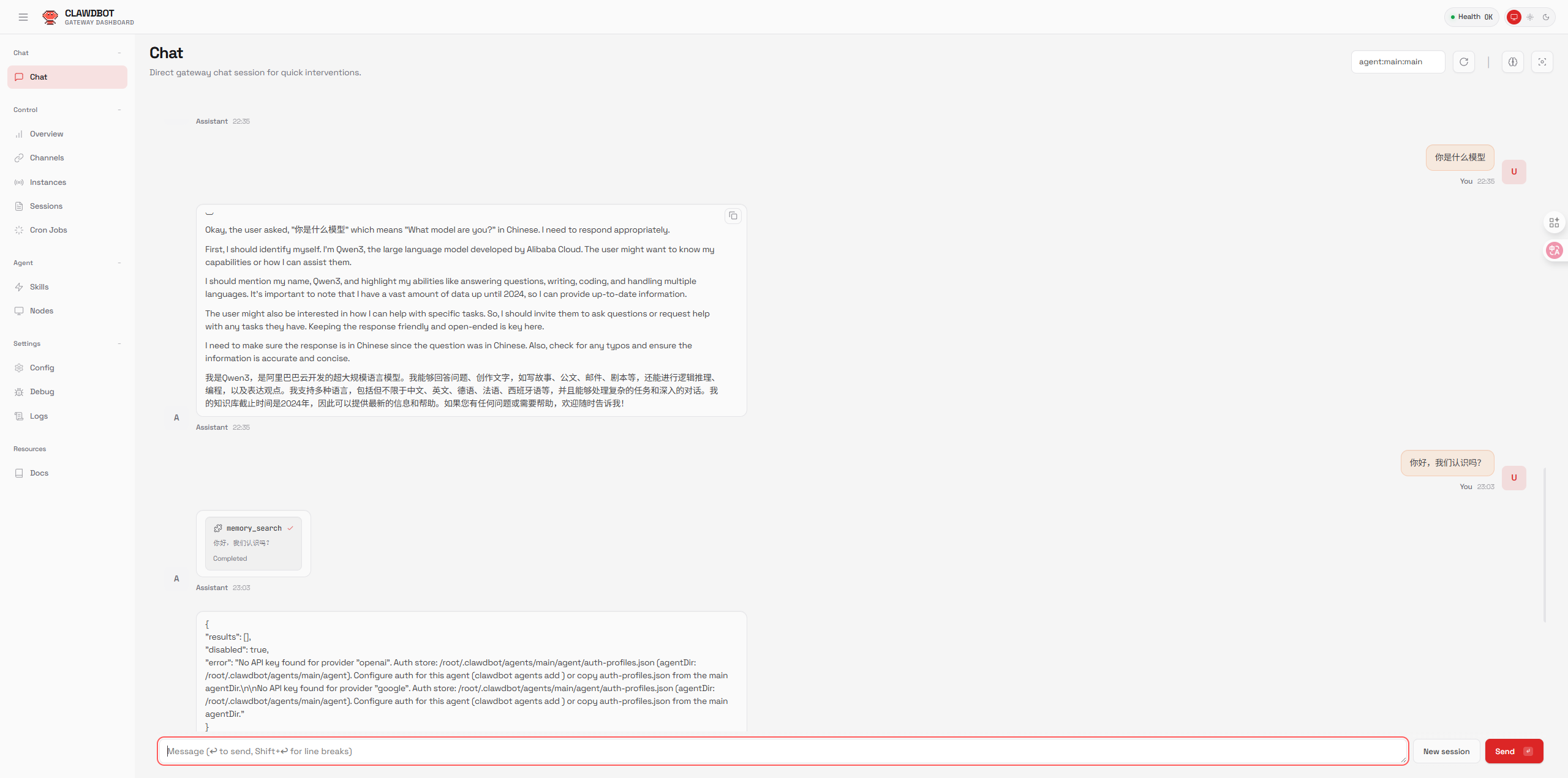

想象一下,你有一个功能强大的AI大模型,但每次使用都需要手动调用API、处理各种配置、监控运行状态——这就像拥有一辆超级跑车却要自己修路铺桥。Clawdbot的出现就是为了解决这个问题。

Clawdbot是一个统一的AI代理网关与管理平台,它让开发者能够通过直观的界面构建、部署和监控自主AI代理。简单来说,它就像AI模型的"操作系统",帮你管理各种模型资源,提供统一的访问入口,让AI应用开发变得像搭积木一样简单。

本次实践我们将Clawdbot与Qwen3:32B大模型结合,在有限的GPU资源下(24G显存)探索AI代理平台的最佳实践方案。虽然32B参数的大模型在24G显存上运行有些吃力,但通过合理的配置和优化,我们仍然能够获得可用的性能体验。

2. 快速上手:从零开始部署Clawdbot

2.1 环境准备与初次访问

Clawdbot的部署相对简单,但初次访问时需要特别注意token配置。很多新手在这里会遇到问题,其实解决方法很简单。

当你第一次启动Clawdbot并访问提供的URL时,通常会看到这样的错误提示:

disconnected (1008): unauthorized: gateway token missing

这是因为系统需要安全验证。别担心,只需要对URL做个小调整:

# 原始URL(会报错)

https://gpu-pod6978c4fda2b3b8688426bd76-18789.web.gpu.csdn.net/chat?session=main

# 修改后的正确URL

https://gpu-pod6978c4fda2b3b8688426bd76-18789.web.gpu.csdn.net/?token=csdn

关键修改步骤:

- 删除

chat?session=main部分 - 添加

?token=csdn参数 - 第一次成功访问后,后续就可以直接通过控制台快捷方式启动了

2.2 服务启动与基础配置

启动Clawdbot网关服务很简单:

# 启动网关服务

clawdbot onboard

这个命令会启动核心的代理网关,为你提供统一的管理界面。启动成功后,你就可以通过Web界面来管理和配置AI代理了。

3. 模型集成:Qwen3:32B的配置与优化

3.1 本地模型接入方案

在我们的实践中,使用的是本地私有部署的Qwen3:32B模型,通过Ollama提供API服务。这种方案的优势在于数据隐私性好,响应速度快,但也对本地硬件资源提出了较高要求。

以下是完整的模型配置示例:

{

"my-ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "ollama",

"api": "openai-completions",

"models": [

{

"id": "qwen3:32b",

"name": "Local Qwen3 32B",

"reasoning": false,

"input": ["text"],

"contextWindow": 32000,

"maxTokens": 4096,

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

}

}

]

}

}

这个配置告诉Clawdbot:

- 从哪里获取模型API(本地Ollama服务)

- 使用什么认证方式(简单的API密钥)

- 模型的基本能力和限制

3.2 24G显存下的性能优化

在24G显存上运行Qwen3:32B确实有些挑战,但通过以下策略可以改善体验:

内存优化技巧:

- 使用量化版本模型(如4-bit量化)

- 调整batch size减少内存占用

- 启用模型分片加载

性能调优建议:

# 在Clawdbot配置中调整这些参数可以提升性能

{

"optimization": {

"maxConcurrent": 2, # 最大并发数,根据GPU能力调整

"timeout": 30000, # 超时时间设置

"memoryManagement": "aggressive" # 激进的内存管理策略

}

}

如果你追求更好的交互体验,建议使用更大显存资源部署更新的Qwen模型。32B模型在40G+显存上会有显著更好的表现。

4. 实战应用:构建你的第一个AI代理

4.1 创建基础对话代理

通过Clawdbot创建AI代理非常简单。在Web界面中,你可以:

- 点击"新建代理"按钮

- 选择刚才配置的Qwen3:32B模型

- 设置代理名称和描述

- 配置基础参数(温度、最大token数等)

- 保存并测试

整个过程就像在电商网站购物一样直观,不需要编写复杂的代码。

4.2 多模型协同工作

Clawdbot的强大之处在于支持多模型协同。你可以创建这样的工作流:

- 用小模型处理简单查询(快速响应)

- 复杂问题路由到Qwen3:32B(高质量回答)

- 专用任务使用专用模型(如图像生成、代码编写)

这种架构既保证了响应速度,又确保了回答质量,还优化了资源利用。

5. 监控与管理:让AI代理运行更稳定

5.1 实时监控看板

Clawdbot提供了丰富的监控功能,让你随时了解代理运行状态:

- 性能指标:响应时间、吞吐量、错误率

- 资源使用:GPU内存、显存占用、计算利用率

- 业务指标:请求量、用户活跃度、功能使用分布

这些数据以直观的图表形式展示,帮助你快速发现和解决问题。

5.2 日志与故障排查

当代理出现问题时,详细的日志记录让你能够快速定位原因:

# 查看网关日志

clawdbot logs --service=gateway

# 查看特定代理日志

clawdbot logs --agent=my-agent

# 实时监控日志

clawdbot logs --follow

日志系统会记录每个请求的详细信息,包括输入、输出、处理时间、错误信息等,为故障排查提供完整线索。

6. 扩展与定制:打造专属AI代理生态

6.1 插件系统开发

Clawdbot支持插件扩展,你可以开发自定义功能:

// 简单的插件示例

class MyCustomPlugin {

constructor(config) {

this.name = 'custom-plugin';

this.version = '1.0.0';

}

async process(input, context) {

// 你的自定义处理逻辑

return await this.callExternalAPI(input);

}

}

插件可以处理特定类型的任务,访问外部API,或者实现特殊的业务逻辑。

6.2 工作流编排

通过Clawdbot的工作流功能,你可以构建复杂的AI应用:

- 多步骤处理:先理解用户意图,再调用相应工具

- 条件路由:根据输入内容选择最合适的处理路径

- 并行处理:同时执行多个不依赖的任务提升效率

这种编排能力让单个AI代理能够处理极其复杂的业务场景。

7. 实践总结与建议

经过实际测试,Clawdbot + Qwen3:32B的组合在24G显存环境下虽然有一定压力,但通过合理优化仍然可用。以下是一些关键总结:

成功经验:

- Clawdbot提供了极佳的统一管理体验,大幅降低AI应用开发门槛

- Qwen3:32B在有限资源下仍能提供不错的智能水平

- 插件系统和工作流功能让定制化开发变得简单

改进建议:

- 对于生产环境,建议使用更大显存或量化版本模型

- 复杂场景可以考虑模型组合策略,平衡性能和效果

- 定期监控资源使用,及时调整配置参数

最佳实践:

- 从小规模开始,逐步扩展代理复杂度

- 充分利用监控功能,持续优化性能

- 建立完善的测试流程,确保代理稳定性

- 考虑成本效益,选择合适的模型配置

Clawdbot作为一个开源AI代理平台,为开发者提供了强大的工具来构建和管理AI应用。与Qwen3:32B的结合展示了如何在有限资源下实现智能代理的部署和运行。随着模型的不断优化和硬件的发展,这种方案将会变得更加实用和高效。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)