蓝耘元生代云MaaS平台:DeepSeek-V3.2企业级落地更优解

蓝耘元生代云MaaS平台依托安全、高效、稳定的核心优势,以及深度沉淀的企业级服务基因,为企业搭建起一条将DeepSeek等前沿模型能力高效转化为实际业务价值的便捷通道,从数据防护、模型生态、接入体验、性能优化、算力支撑到规模化场景适配,全方位助力AI大模型技术无缝融入生产系统,真正落地为像水电一样标准化、高可靠的企业级服务。模型的性能释放,离不开坚实的算力支撑。针对金融、医疗、政务等高敏行业数据隔

当下,大模型技术正从“能力验证”阶段加速迈向产业落地深水区,DeepSeek-V3.2凭借逼近闭源顶尖水平的推理能力,迅速成为企业智能化升级的热门选择。但企业实际调用过程中,往往面临算力资源不足、部署流程复杂、数据安全难以保障、模型性能不及预期等多重挑战。蓝耘元生代云MaaS平台依托安全、高效、稳定的核心优势,以及深度沉淀的企业级服务基因,为企业搭建起一条将DeepSeek等前沿模型能力高效转化为实际业务价值的便捷通道,从数据防护、模型生态、接入体验、性能优化、算力支撑到规模化场景适配,全方位助力AI大模型技术无缝融入生产系统,真正落地为像水电一样标准化、高可靠的企业级服务。

隐私与合规:构筑企业级数据安全“防火墙”

数据资产的安全与合规性是企业接入AI模型的首要考量,蓝耘元生代云MaaS平台深知企业痛点,从架构底层即将数据安全视为生命线,为企业调用DeepSeek等前沿模型开辟了一片“私域净土”,确保信息安全管理无死角。平台已通过ISO27001信息安全管理体系认证,依托多地域容灾部署与数据加密传输、访问权限控制及物理隔离等多重保障机制,全面适配不同行业的合规需求,通过这种架构层面的原生安全设计,企业能够像使用内部系统一样,放心地调用顶尖AI能力,真正实现“数据可控,能力无界”。

针对金融、医疗、政务等高敏行业数据隔离需求,平台提供了灵活的部署选择,可实现本地私有化部署,让模型在企业的防火墙内运行,彻底消除数据出域的风险。

在企业级服务保障上,蓝耘提供了7×24小时的全栈技术支持与运维服务,实时监控QPS及资源利用率,动态扩缩容并自动修复故障,以99.95%的高可用性SLA服务保障,大幅降低业务中断风险,快速响应推理延迟波动,真正成为企业值得信赖的模型服务伙伴。

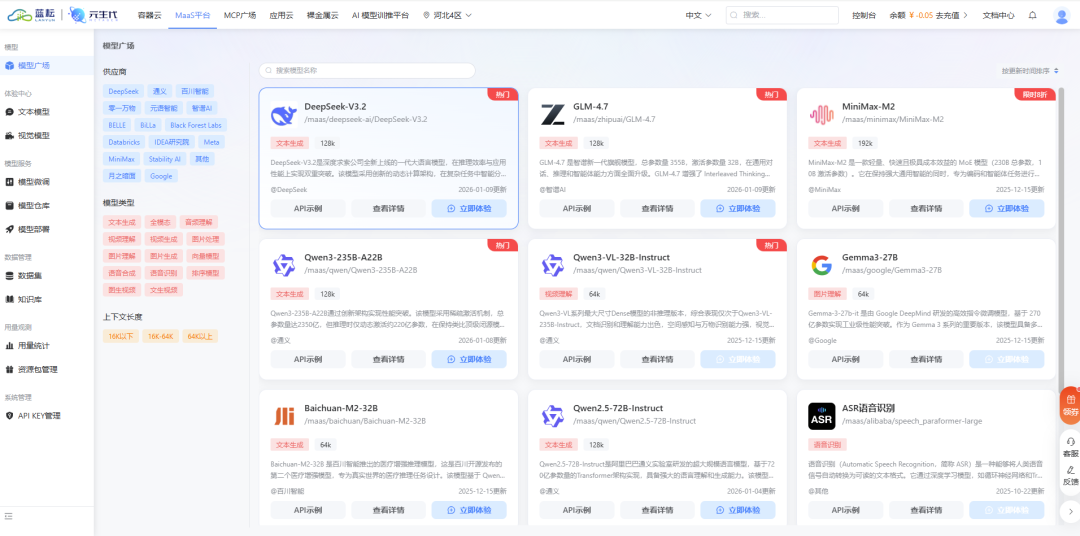

企业级API中心:极简接入零学习成本

技术落地不应被复杂的工程化问题所拖累。蓝耘MaaS平台深刻理解企业在集成AI能力时对效率与管控的双重需求,构建了专业的企业级API中心。

平台提供标准化API接口与全流程工具链,全面兼容OpenAI API及Anthropic API,最大化开发者的接入效率:

-

无缝迁移(兼容OpenAI):深度兼容OpenAI API标准。熟悉ChatGPT API的开发者无需学习新知识,仅需修改base_url和API Key两行配置,即可将现有应用无缝切换至DeepSeek等模型,实现从想法到上线的极速落地。

-

智能进阶(兼容Anthropic):同步支持Anthropic协议接口,在复杂的智能体(Agent)场景下,原生支持多轮推理与工具调用,帮助开发者快速构建具备规划、决策与执行能力的智能应用,轻松实现复杂任务的自动化处理与多系统协同。

API中心不仅仅是“连接”,更是“管理”。蓝耘元生代云MaaS平台为企业提供了完善的API Key权限管理功能,支持新增、查看、删除等精细化操作,保障接口调用的安全性;搭配实时用量看板与资源包管理功能,企业可随时监控每小时Token消耗情况,查看接口使用数据与剩余额度,实现成本的精细化管控,让每一笔AI投入都可追溯、可调控。

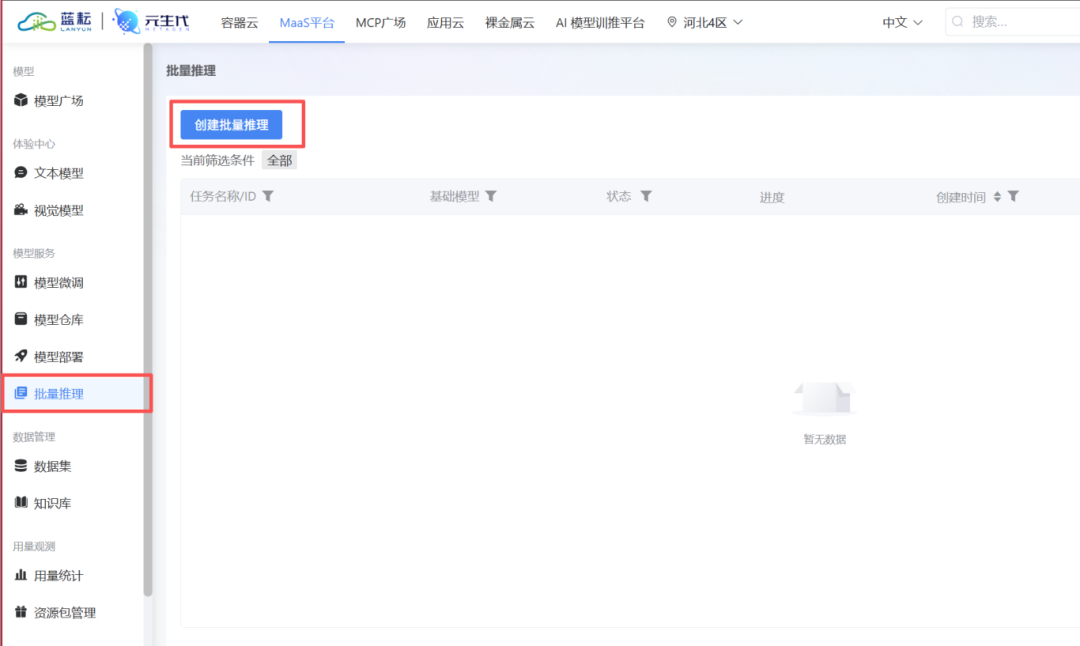

批量推理:规模化应用的“降本增效”引擎

随着AI与业务系统的深度融合,企业不可避免地面临着海量离线数据处理的挑战——知识库向量化、数据集的清洗与标注,大规模文档的批量生成等场景,都对算力提出了“高吞吐、低成本、非实时”的全新需求。传统的实时推理服务在处理这类任务时往往面临资源利用率低、单位成本过高的结构性困境。

蓝耘元生代云MaaS平台推出专属批量推理功能,以“化零为整”的架构破局:为企业提供一站式任务提交、统一调度与集中执行能力。该模式将海量碎片化请求整合为规模化作业,让宝贵的算力资源“好钢用在刀刃上”,从根本上简化运维复杂度。依托蓝耘自研的算力调度引擎,批量推理在性能与成本两端实现双重跃升:一方面,大幅优化GPU集群利用率、提升集群吞吐能力,另一方面,通过资源复用与任务整合,帮助企业以传统方案50%的成本,释放DeepSeek-V3.2等先进模型数倍的生产力——为企业规模化AI应用带来的确定性价值。

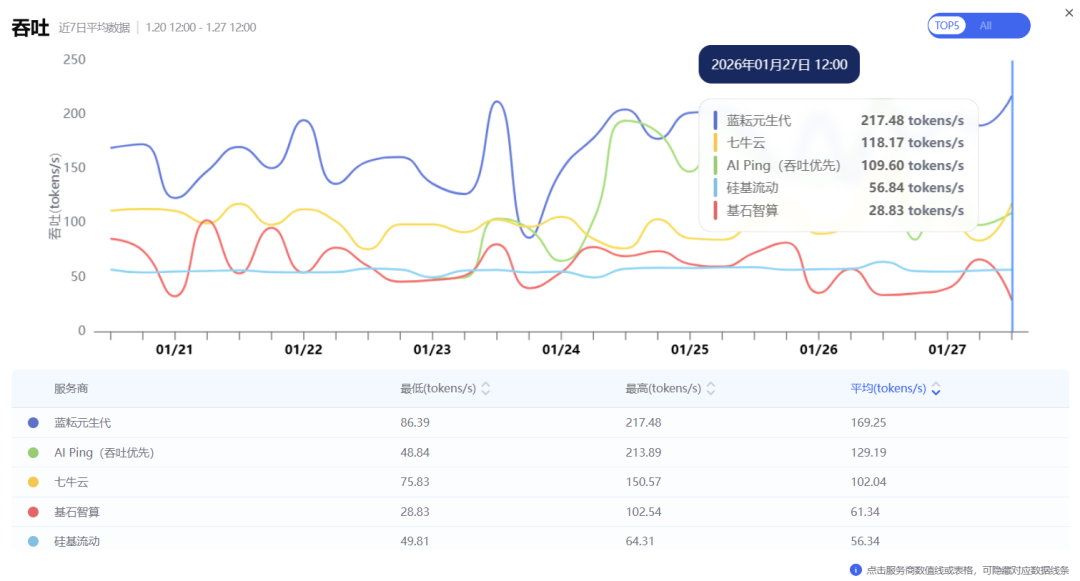

性能登顶:全栈优化铸就“断层领先”

性能的稳定输出,是衡量MaaS平台服务能力的最终标尺。蓝耘不仅止步于简单“上架”模型,而是针对每个模型的特性进行深度全栈优化,确保其性能在实际应用中发挥到极致。根据权威AI性能测试平台AI Ping截至2026年1月27日的最新评测数据,蓝耘元生代MaaS平台上的DeepSeek-V3.2模型以217.48 tokens/秒的吞吐表现和0.38秒的超低响应延迟,在诸多模型服务商中登顶榜首,较第二名实现近两倍领先。

这一断层领先的性能优势,源于蓝耘工程师团队对推理引擎的多轮迭代:通过针对DeepSeek模型特性进行包括算子融合与量化加速、KV缓存优化、动态批处理及分布式推理架构在内的全栈技术调优,不仅大幅提升了DeepSeek-V3.2模型的推理效率与并发处理能力,更将底层技术能力转化为上层应用的流畅与稳定。对企业而言,这意味着即便是高并发场景下的复杂调用,也能获得“无感”的丝滑体验。

此外,平台原生支持高达128K的超大上下文规模(特定需求可达200K),可实现更深度的逻辑推演与更连贯的内容生成,无论是长文档分析、法律合同审查还是代码库理解,都能轻松应对。

万P级硬核底座:筑牢算力保障

模型的性能释放,离不开坚实的算力支撑。蓝耘在全国部署了多个AIDC(智算中心)节点,算力规模超过万P级,从根本上解决了大模型推理的资源瓶颈。这一架构的核心优势在于“全栈可控”。基于自建数据中心的优势,蓝耘得以在硬件层面实施“量体裁衣”式的专项优化,从GPU集群调度、内存管理到网络传输的每一个环节都针对大模型的推理负载进行了深度适配。

在资源调度层面,蓝耘自研的智能网关系统扮演了“中枢神经”的角色。它不仅承担流量接入、协议转换与安全防护,更具备基于业务语义的智能路由能力。在面对论文提交高峰或电商大促等瞬时指数级流量冲击时,智能网关通过“全局调度+局部加速”的协同机制,可在毫秒级完成路径切换与资源动态扩容。这一能力确保了千台算力节点在极端负载下仍能保持稳定响应,将推理延迟与系统错误率控制在极低水平,为企业关键业务提供高可用的算力保障。

从数据安全保障到行业领先的性能表现,从万P级算力的稳定支撑到规模化场景的成本优化,蓝耘元生代云MaaS平台精准回应了企业在智能化升级进程中的每一个核心关切。它不仅是调用DeepSeek等热门模型的便捷通道,更是连接前沿AI技术与实际业务场景的坚实桥梁,将“触手可及的AI能力”真正交付到企业手中——让每一次调用,都享有安全、高效、稳定的企业级保障。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)