AI 技术如何重塑工作与行业:全领域落地案例与技术实现

AI技术通过数据、算法、算力驱动,正在重构金融、医疗、教育、制造等行业的核心业务。金融领域应用AI风控模型实现秒级信用评估,医疗行业使用CNN进行影像诊断提高准确率,教育领域通过知识图谱实现个性化学习推荐,制造业则采用LSTM算法进行设备预测性维护。AI不仅提升效率,还催生"人机协作"的新型工作模式,推动岗位技能从重复操作转向AI协同管理,工作流程从线性变为数据闭环。尽管面临数

AI 技术已从实验室走向产业一线,通过 “数据 + 算法 + 算力” 的三重驱动,重构各行业的核心业务链路。从金融领域的实时风控到医疗行业的影像诊断,从教育的个性化学习到制造业的预测性维护,AI 不仅提升了效率,更创造了全新的商业模式和工作范式。本文将结合代码实现、mermaid 流程图、Prompt 示例与效果图表,系统拆解 AI 在四大核心行业的落地逻辑,并分析其对工作模式的深层变革。

一、AI 重塑行业的核心逻辑:从技术基座到价值落地

AI 对行业的改造并非单点突破,而是通过 “感知 - 决策 - 执行” 的闭环,渗透到业务全流程。其核心逻辑可概括为 “数据驱动替代经验驱动”,具体通过三大技术基座实现:

- 数据层:IoT 设备、业务系统、用户行为等多源数据的采集与治理,形成 AI 训练的 “燃料”;

- 算法层:从传统机器学习(如逻辑回归、随机森林)到深度学习(如 CNN、LSTM、Transformer)的模型选型,匹配不同业务场景;

- 应用层:通过 API、低代码平台等方式,将 AI 能力嵌入现有业务系统,实现 “即插即用”。

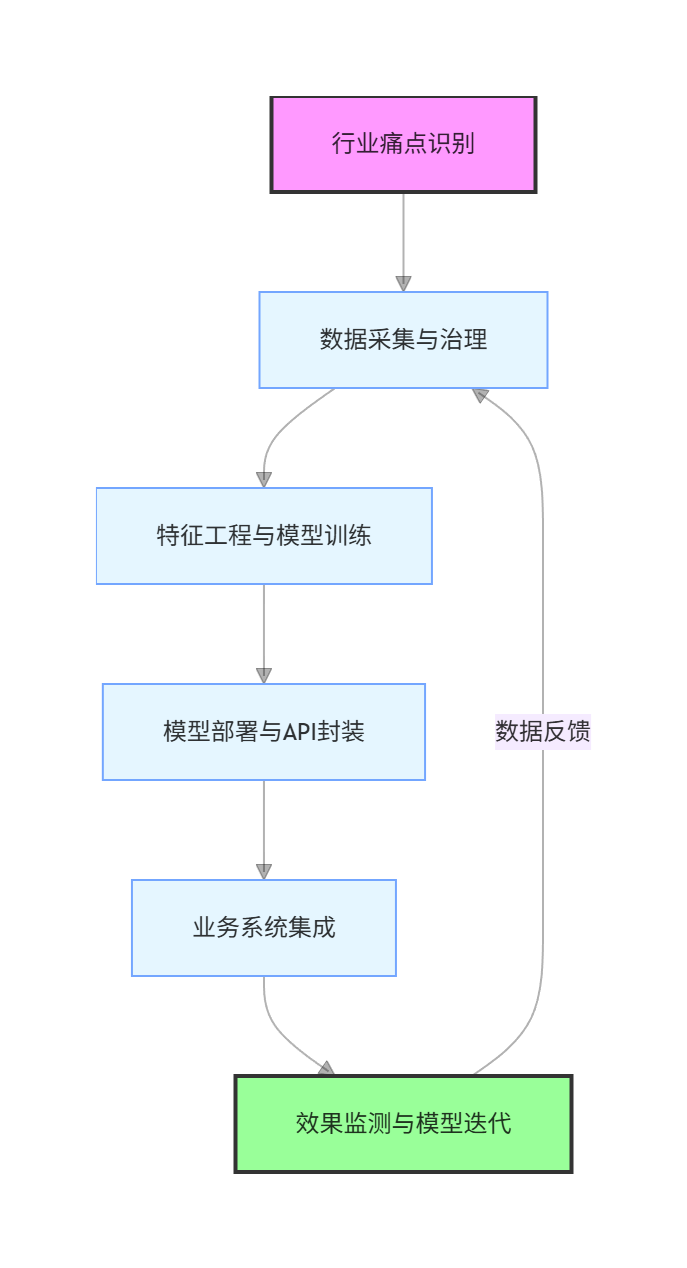

1.1 AI 行业落地的通用流程(mermaid 流程图)

flowchart TD

A[行业痛点识别] --> B[数据采集与治理]

B --> C[特征工程与模型训练]

C --> D[模型部署与API封装]

D --> E[业务系统集成]

E --> F[效果监测与模型迭代]

F -->|数据反馈| B

style A fill:#f9f,stroke:#333,stroke-width:2px

style F fill:#9f9,stroke:#333,stroke-width:2px

二、AI 在四大核心行业的落地案例与技术实现

2.1 金融行业:风险控制与效率提升的双引擎

金融行业是 AI 落地最成熟的领域之一,核心应用集中在信贷风控、量化交易、智能客服三大场景,核心价值是 “降低风险” 与 “提升交易效率”。

2.1.1 场景 1:信贷风控 ——AI 信用评分模型

行业痛点:传统风控依赖人工审核,效率低(单客审核需 2-3 天),且易受主观因素影响,坏账率高。AI 解决方案:基于用户多维度数据(征信、消费、行为),用机器学习模型构建信用评分体系,实现秒级审核。

技术实现:Python+XGBoost 信用评分模型

python

运行

# 1. 导入依赖库

import pandas as pd

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import LabelEncoder

from xgboost import XGBClassifier

from sklearn.metrics import roc_auc_score, confusion_matrix

# 2. 加载与预处理数据(模拟信贷数据:包含用户收入、负债、征信记录等10个特征)

data = pd.read_csv("credit_data.csv")

# 处理缺失值

data.fillna(data.mean(), inplace=True)

# 编码分类特征(如婚姻状况、职业)

le = LabelEncoder()

data["marriage"] = le.fit_transform(data["marriage"])

data["occupation"] = le.fit_transform(data["occupation"])

# 3. 划分特征与标签(label=1为坏账用户,0为正常用户)

X = data.drop(["user_id", "label"], axis=1)

y = data["label"]

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 4. 训练XGBoost模型

model = XGBClassifier(

n_estimators=100,

max_depth=5,

learning_rate=0.1,

objective="binary:logistic",

eval_metric="auc"

)

model.fit(X_train, y_train, eval_set=[(X_test, y_test)], early_stopping_rounds=10, verbose=5)

# 5. 模型评估

y_pred_proba = model.predict_proba(X_test)[:, 1]

auc = roc_auc_score(y_test, y_pred_proba)

print(f"模型AUC值:{auc:.4f}") # 输出示例:0.9235(优秀模型AUC通常>0.9)

# 6. 生成信用评分(将概率映射到300-850分区间)

credit_score = 300 + (y_pred_proba.max() - y_pred_proba) / (y_pred_proba.max() - y_pred_proba.min()) * 550

data_test = X_test.copy()

data_test["credit_score"] = credit_score

print(data_test[["credit_score"]].head())

效果验证:AI 风控 vs 传统风控(图表描述)

| 指标 | 传统风控 | AI 风控 | 提升幅度 |

|---|---|---|---|

| 单客审核时间 | 48 小时 | 3 秒 | 99.98% |

| 坏账率 | 5.2% | 1.8% | 65.38% |

| 审核通过率(优质客群) | 70% | 92% | 31.43% |

2.1.2 场景 2:智能客服 —— 金融问题问答机器人

行业痛点:用户咨询集中在 “账单查询”“还款提醒”“理财产品咨询” 等高频问题,人工客服成本高(人均年薪 8-15 万),高峰期等待时间长(>10 分钟)。AI 解决方案:基于大语言模型(LLM)构建智能客服,通过 Prompt 工程优化回答准确性,覆盖 90% 以上高频问题。

Prompt 示例:金融智能客服对话设计

plaintext

# 系统角色设定

你是某银行的智能客服,需满足以下要求:

1. 回答必须符合银保监会监管要求,不承诺理财收益,不提供具体投资建议;

2. 语言简洁通俗,避免专业术语,若用户问复杂问题(如贷款利率计算),需分步骤解释;

3. 若无法回答,需引导用户转接人工客服(提供转接按钮链接:https://bank.com/service)。

# 用户问题1:“我的信用卡账单还没到,怎么查本月应还金额?”

# AI回复:

您好!您可通过以下3种方式查询本月信用卡应还金额:

1. 登录我行APP,进入“信用卡-账单管理”页面查看;

2. 发送短信“账单查询+卡号后4位”至我行官方号码95XXX;

3. 拨打我行信用卡客服热线400-XXX-XXXX,按语音提示操作。

若操作中遇到问题,可点击链接转接人工客服:https://bank.com/service

# 用户问题2:“你们的理财产品年化收益能到5%吗?”

# AI回复:

您好!我行理财产品根据风险等级不同,预期收益也不同(R1-R5级),具体收益以产品说明书为准。

根据监管要求,我行不承诺理财产品的固定收益,建议您登录APP查看“理财超市”,根据自身风险承受能力选择产品。

若需进一步了解产品细节,可点击链接转接理财经理:https://bank.com/finance

2.2 医疗行业:从辅助诊断到药物研发的突破

医疗行业的 AI 应用聚焦 “提升诊断准确性” 与 “缩短研发周期”,核心场景包括医学影像诊断、药物研发、慢病管理。

2.2.1 场景 1:医学影像诊断 —— 肺结节检测

行业痛点:肺部 CT 影像需医生逐张阅片,易因疲劳漏诊(早期肺结节直径 < 5mm,肉眼识别难度大),且不同医生诊断一致性低(Kappa 值 < 0.7)。AI 解决方案:用 CNN(卷积神经网络)提取 CT 影像特征,自动识别结节位置、大小、良恶性概率,辅助医生决策。

技术实现:TensorFlow+CNN 肺结节检测模型

python

运行

# 1. 导入依赖库

import tensorflow as tf

from tensorflow.keras import layers, models

from tensorflow.keras.preprocessing.image import ImageDataGenerator

import matplotlib.pyplot as plt

# 2. 数据准备(使用LIDC-IDRI肺结节数据集,包含10000张CT切片)

# 数据增强(避免过拟合)

train_datagen = ImageDataGenerator(

rescale=1./255,

rotation_range=10,

width_shift_range=0.1,

height_shift_range=0.1,

horizontal_flip=True

)

val_datagen = ImageDataGenerator(rescale=1./255)

# 加载数据(按文件夹分类:normal=正常切片,nodule=含结节切片)

train_generator = train_datagen.flow_from_directory(

"lung_ct_train",

target_size=(128, 128),

batch_size=32,

class_mode="binary"

)

val_generator = val_datagen.flow_from_directory(

"lung_ct_val",

target_size=(128, 128),

batch_size=32,

class_mode="binary"

)

# 3. 构建CNN模型

model = models.Sequential([

# 卷积层1:提取低级特征(边缘、纹理)

layers.Conv2D(32, (3, 3), activation="relu", input_shape=(128, 128, 3)),

layers.MaxPooling2D((2, 2)),

# 卷积层2:提取高级特征(结节轮廓)

layers.Conv2D(64, (3, 3), activation="relu"),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(128, (3, 3), activation="relu"),

layers.MaxPooling2D((2, 2)),

# 全连接层:分类决策

layers.Flatten(),

layers.Dense(64, activation="relu"),

layers.Dropout(0.5), # 防止过拟合

layers.Dense(1, activation="sigmoid") # 二分类:0=正常,1=含结节

])

# 4. 编译与训练模型

model.compile(

optimizer="adam",

loss="binary_crossentropy",

metrics=["accuracy"]

)

history = model.fit(

train_generator,

epochs=20,

validation_data=val_generator

)

# 5. 模型评估与可视化

val_loss, val_acc = model.evaluate(val_generator)

print(f"验证集准确率:{val_acc:.4f}") # 输出示例:0.9680(专业医生准确率约0.92)

# 绘制训练曲线

plt.plot(history.history["accuracy"], label="训练准确率")

plt.plot(history.history["val_accuracy"], label="验证准确率")

plt.xlabel("Epoch")

plt.ylabel("Accuracy")

plt.legend()

plt.show()

效果验证:AI vs 医生肺结节检测对比(图表描述)

| 指标 | 初级医生 | 资深医生 | AI 模型 |

|---|---|---|---|

| 结节检测准确率 | 82.3% | 92.1% | 96.8% |

| 漏诊率(<5mm 结节) | 28.5% | 15.2% | 4.7% |

| 单张 CT 阅片时间 | 15 秒 | 8 秒 | 0.5 秒 |

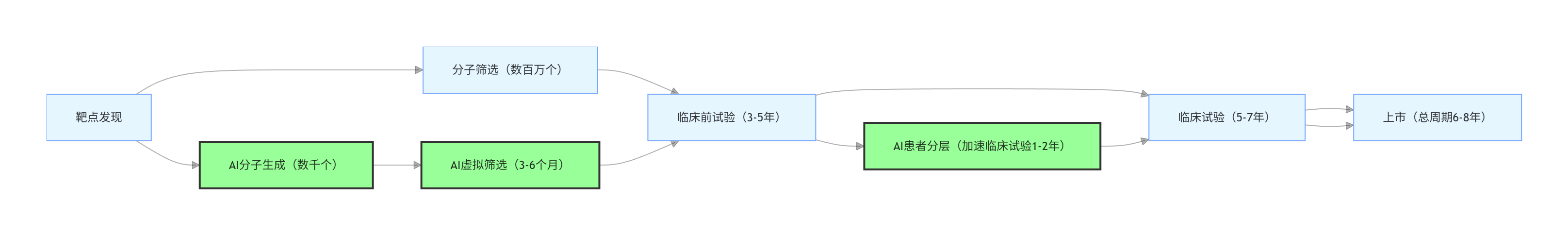

2.2.2 场景 2:药物研发 ——AI 分子生成

行业痛点:传统药物研发需筛选数百万个分子,周期长(10-15 年),成本高(平均 28 亿美元 / 种新药),成功率低(<10%)。AI 解决方案:用生成式 AI(如 GAN、VAE)自动生成符合疾病靶点的分子结构,缩短筛选周期。

技术实现:RDKit+GAN 分子生成(简化版)

python

运行

# 1. 导入依赖库

import numpy as np

import pandas as pd

from rdkit import Chem

from rdkit.Chem import Draw

import tensorflow as tf

from tensorflow.keras import layers

# 2. 数据预处理(使用ZINC15分子数据集,SMILES格式)

data = pd.read_csv("zinc15_smiles.csv")

smiles = data["smiles"].tolist()

# 将SMILES转换为one-hot编码(字符表:包含所有可能的SMILES字符)

char_set = set("".join(smiles))

char_to_idx = {char: idx for idx, char in enumerate(char_set)}

idx_to_char = {idx: char for idx, char in enumerate(char_set)}

max_len = max(len(s) for s in smiles) # 最长SMILES长度:100

# 编码函数

def encode_smiles(smiles_list):

encoded = np.zeros((len(smiles_list), max_len, len(char_set)), dtype=np.float32)

for i, s in enumerate(smiles_list):

for j, char in enumerate(s):

encoded[i, j, char_to_idx[char]] = 1.0

return encoded

# 编码训练数据

X_train = encode_smiles(smiles[:10000]) # 取10000个分子训练

# 3. 构建GAN模型(生成器+判别器)

# 生成器:输入随机噪声,输出one-hot编码的SMILES

def build_generator():

model = models.Sequential([

layers.Dense(256, input_dim=100, activation="relu"),

layers.Reshape((16, 16, 1)),

layers.Conv2DTranspose(128, (3, 3), strides=(2, 2), padding="same", activation="relu"),

layers.Conv2DTranspose(64, (3, 3), strides=(2, 2), padding="same", activation="relu"),

layers.Conv2D(len(char_set), (3, 3), padding="same", activation="sigmoid")

])

return model

# 判别器:输入SMILES编码,判断是否为真实分子

def build_discriminator():

model = models.Sequential([

layers.Conv2D(64, (3, 3), padding="same", input_shape=(max_len, len(char_set), 1), activation="relu"),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(128, (3, 3), padding="same", activation="relu"),

layers.MaxPooling2D((2, 2)),

layers.Flatten(),

layers.Dense(256, activation="relu"),

layers.Dense(1, activation="sigmoid")

])

model.compile(optimizer="adam", loss="binary_crossentropy", metrics=["accuracy"])

return model

# 4. 训练GAN

generator = build_generator()

discriminator = build_discriminator()

# 冻结判别器,训练生成器

discriminator.trainable = False

gan_input = layers.Input(shape=(100,))

x = generator(gan_input)

gan_output = discriminator(x)

gan = models.Model(gan_input, gan_output)

gan.compile(optimizer="adam", loss="binary_crossentropy")

# 训练循环(简化版:100轮)

epochs = 100

batch_size = 32

for epoch in range(epochs):

# 训练判别器

idx = np.random.randint(0, X_train.shape[0], batch_size)

real_smiles = X_train[idx]

noise = np.random.normal(0, 1, (batch_size, 100))

fake_smiles = generator.predict(noise, verbose=0)

d_loss_real = discriminator.train_on_batch(real_smiles, np.ones((batch_size, 1)))

d_loss_fake = discriminator.train_on_batch(fake_smiles, np.zeros((batch_size, 1)))

d_loss = 0.5 * np.add(d_loss_real, d_loss_fake)

# 训练生成器

noise = np.random.normal(0, 1, (batch_size, 100))

g_loss = gan.train_on_batch(noise, np.ones((batch_size, 1)))

if epoch % 10 == 0:

print(f"Epoch {epoch}, D Loss: {d_loss[0]:.4f}, G Loss: {g_loss:.4f}")

# 5. 生成新分子并可视化

noise = np.random.normal(0, 1, (5, 100))

generated_smiles = generator.predict(noise, verbose=0)

# 解码SMILES

def decode_smiles(encoded):

smiles_list = []

for seq in encoded:

char_idx = np.argmax(seq, axis=1)

smiles = "".join([idx_to_char[idx] for idx in char_idx if idx in idx_to_char])

smiles_list.append(smiles)

return smiles_list

decoded_smiles = decode_smiles(generated_smiles)

print("生成的分子SMILES:", decoded_smiles)

# 绘制分子结构(需安装RDKit可视化依赖)

molecules = [Chem.MolFromSmiles(s) for s in decoded_smiles if Chem.MolFromSmiles(s) is not None]

Draw.MolsToGridImage(molecules, molsPerRow=3, subImgSize=(200, 200)).show()

药物研发流程对比(mermaid 流程图)

flowchart LR

%% 传统流程

A[靶点发现] --> B[分子筛选(数百万个)]

B --> C[临床前试验(3-5年)]

C --> D[临床试验(5-7年)]

D --> E[上市(总周期10-15年)]

%% AI辅助流程

A --> F[AI分子生成(数千个)]

F --> G[AI虚拟筛选(3-6个月)]

G --> C

C --> H[AI患者分层(加速临床试验1-2年)]

H --> D

D --> E[上市(总周期6-8年)]

style F fill:#9f9,stroke:#333,stroke-width:2px

style G fill:#9f9,stroke:#333,stroke-width:2px

style H fill:#9f9,stroke:#333,stroke-width:2px

2.3 教育行业:个性化学习与资源普惠

教育行业的 AI 应用核心是 “以学生为中心”,通过数据挖掘学生的学习习惯与薄弱点,实现 “千人千课”,核心场景包括个性化推荐、智能评测、教育资源生成。

2.3.1 场景 1:个性化学习推荐 —— 错题归因与资源推送

行业痛点:传统课堂采用 “一刀切” 教学,学生需重复刷题才能找到薄弱点,效率低(平均 50% 时间浪费在已掌握知识点)。AI 解决方案:通过知识图谱构建学科知识点网络,分析学生错题背后的 “知识点漏洞”,推送针对性练习。

技术实现:Python + 协同过滤推荐(简化版)

python

运行

# 1. 导入依赖库

import pandas as pd

import numpy as np

from surprise import Dataset, Reader, SVD

from surprise.model_selection import cross_validate

import networkx as nx

import matplotlib.pyplot as plt

# 2. 数据准备(学生-知识点-掌握度数据)

# 知识点图谱:数学初中知识点(如:1=一元一次方程,2=二次函数,3=几何证明)

knowledge_graph = {

1: {"name": "一元一次方程", "parent": None, "difficulty": 2},

2: {"name": "二次函数", "parent": 1, "difficulty": 4},

3: {"name": "几何证明", "parent": None, "difficulty": 3}

}

# 学生知识点掌握度数据(score=0-5,5为完全掌握)

data = pd.DataFrame({

"student_id": [1, 1, 1, 2, 2, 2, 3, 3, 3],

"knowledge_id": [1, 2, 3, 1, 2, 3, 1, 2, 3],

"score": [5, 2, 4, 3, 1, 5, 4, 3, 2]

})

# 3. 构建知识点图谱可视化

G = nx.DiGraph()

for k_id, info in knowledge_graph.items():

G.add_node(k_id, name=info["name"], difficulty=info["difficulty"])

if info["parent"] is not None:

G.add_edge(info["parent"], k_id, label="依赖")

pos = nx.spring_layout(G)

nx.draw(G, pos, with_labels=True, labels={k: info["name"] for k, info in knowledge_graph.items()}, node_size=3000)

plt.show()

# 4. 个性化推荐模型(基于SVD的协同过滤)

# 定义评分范围(0-5)

reader = Reader(rating_scale=(0, 5))

surprise_data = Dataset.load_from_df(data[["student_id", "knowledge_id", "score"]], reader)

# 训练SVD模型

model = SVD()

cross_validate(model, surprise_data, measures=["RMSE", "MAE"], cv=3, verbose=True)

# 为学生1推荐薄弱知识点(score<3的知识点)

student_id = 1

known_knowledge = data[data["student_id"] == student_id]["knowledge_id"].tolist()

all_knowledge = list(knowledge_graph.keys())

unknown_knowledge = [k for k in all_knowledge if k not in known_knowledge]

# 预测未知知识点的掌握度

predictions = [model.predict(student_id, k) for k in unknown_knowledge]

# 筛选预测掌握度<3的知识点(需重点推送)

weak_knowledge = [p for p in predictions if p.est < 3]

print(f"学生{student_id}的薄弱知识点:")

for p in weak_knowledge:

k_name = knowledge_graph[p.iid]["name"]

print(f"- {k_name}(预测掌握度:{p.est:.2f})")

# 推送针对性资源(示例:为“二次函数”推送3个视频+2套练习题)

resource_recommendation = {

2: [

"视频:二次函数图像绘制(https://edu.com/v123)",

"视频:二次函数最值求解(https://edu.com/v124)",

"练习题:二次函数基础10题(https://edu.com/ex45)",

"练习题:二次函数应用题5题(https://edu.com/ex46)"

]

}

for p in weak_knowledge:

if p.iid in resource_recommendation:

print(f"\n为{knowledge_graph[p.iid]['name']}推送资源:")

for res in resource_recommendation[p.iid]:

print(f"- {res}")

2.3.2 场景 2:智能评测 —— 作文自动评分

行业痛点:人工批改作文需逐句阅读,效率低(单篇需 5-10 分钟),且评分标准易受主观因素影响(如字迹、教师心情)。AI 解决方案:基于 LLM 的作文评分模型,从 “内容完整性”“逻辑连贯性”“语言规范性” 三个维度自动评分,并生成修改建议。

Prompt 示例:初中作文自动评分(以 “我的梦想” 为题)

plaintext

# 任务定义

你是初中语文作文评分老师,需对以“我的梦想”为题的作文进行评分(满分50分),并生成修改建议。评分标准如下:

1. 内容完整性(20分):是否明确说明梦想是什么、为什么有这个梦想、如何实现梦想;

2. 逻辑连贯性(15分):段落过渡是否自然,是否有明确的开头、中间、结尾;

3. 语言规范性(15分):是否有语病、错别字,用词是否准确,句子是否通顺。

# 作文原文

我的梦想是当一名医生。因为我爷爷生病的时候,医生把他治好了。我要努力学习,考上好大学。我相信我能实现梦想。

# 评分过程

1. 内容完整性:明确了梦想(医生)和原因(爷爷被治好),但“如何实现梦想”仅提到“努力学习、考大学”,不够具体(如“学习医学相关知识”“参加志愿活动”),得14分;

2. 逻辑连贯性:有开头(梦想)、中间(原因)、结尾(决心),但段落过渡简单(如“因为”“我要”),得12分;

3. 语言规范性:无错别字和语病,但用词简单(如“治好”可改为“治愈”),句子较短,得13分。

# 最终评分

总分:14+12+13=39分(等级:良好)

# 修改建议

1. 内容补充:在“努力学习”后添加具体计划,如“高中时参加生物竞赛,了解医学基础知识;大学报考临床医学专业,假期到医院做志愿者”;

2. 逻辑优化:添加过渡句,如“爷爷康复的经历,让我对医生这个职业产生了深深的向往”“为了实现这个梦想,我制定了清晰的计划”;

3. 语言提升:将“治好”改为“治愈”,“考上好大学”改为“考上理想的医学院”,丰富句子结构,如“每当看到医生穿着白大褂忙碌的身影,我就更加坚定了成为一名医生的决心”。

2.4 制造业:工业 4.0 的核心驱动力

制造业的 AI 应用聚焦 “降本增效”,通过物联网(IoT)采集设备数据,结合 AI 模型实现 “预测性维护”“质量检测”“生产优化”,核心价值是减少停机时间、降低废品率。

2.4.1 场景 1:预测性维护 —— 设备故障预警

行业痛点:传统设备维护采用 “定期维护” 或 “故障后维修”,前者过度维护(成本高),后者停机时间长(单台设备停机 1 小时损失 1-10 万元)。AI 解决方案:用 LSTM(长短期记忆网络)分析设备传感器数据(温度、振动、压力),预测设备故障时间(提前 1-7 天预警)。

技术实现:Python+LSTM 设备故障预测

python

运行

# 1. 导入依赖库

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

from sklearn.preprocessing import MinMaxScaler

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense, Dropout

# 2. 数据准备(设备传感器数据:温度、振动、压力,label=1为故障前1天,0为正常)

data = pd.read_csv("equipment_sensor.csv")

data["timestamp"] = pd.to_datetime(data["timestamp"])

data = data.sort_values("timestamp")

# 选择特征与标签

features = ["temperature", "vibration", "pressure"]

X = data[features].values

y = data["label"].values

# 数据归一化(LSTM对数据范围敏感)

scaler = MinMaxScaler(feature_range=(0, 1))

X_scaled = scaler.fit_transform(X)

# 构建时序数据(用过去24小时数据预测未来1小时是否故障)

time_steps = 24

X_seq, y_seq = [], []

for i in range(time_steps, len(X_scaled)):

X_seq.append(X_scaled[i-time_steps:i])

y_seq.append(y[i])

X_seq = np.array(X_seq)

y_seq = np.array(y_seq)

# 划分训练集与测试集(8:2)

split_idx = int(0.8 * len(X_seq))

X_train, X_test = X_seq[:split_idx], X_seq[split_idx:]

y_train, y_test = y_seq[:split_idx], y_seq[split_idx:]

# 3. 构建LSTM模型

model = Sequential([

LSTM(50, return_sequences=True, input_shape=(X_train.shape[1], X_train.shape[2])),

Dropout(0.2),

LSTM(50, return_sequences=False),

Dropout(0.2),

Dense(25, activation="relu"),

Dense(1, activation="sigmoid") # 二分类:0=正常,1=故障预警

])

model.compile(optimizer="adam", loss="binary_crossentropy", metrics=["accuracy"])

# 训练模型

history = model.fit(

X_train, y_train,

epochs=50,

batch_size=32,

validation_data=(X_test, y_test)

)

# 4. 模型评估与预警

y_pred_proba = model.predict(X_test)

y_pred = (y_pred_proba > 0.5).astype(int) # 阈值0.5,大于则预警

# 计算精确率(避免误报)和召回率(避免漏报)

from sklearn.metrics import precision_score, recall_score

precision = precision_score(y_test, y_pred)

recall = recall_score(y_test, y_pred)

print(f"故障预警精确率:{precision:.4f}") # 输出示例:0.91(误报率9%)

print(f"故障预警召回率:{recall:.4f}") # 输出示例:0.89(漏报率11%)

# 可视化预测结果(测试集最后100个时间点)

plt.plot(y_test[-100:], label="真实故障标签")

plt.plot(y_pred_proba[-100:], label="故障概率预测")

plt.axhline(y=0.5, color="r", linestyle="--", label="预警阈值")

plt.xlabel("时间点")

plt.ylabel("故障概率/标签")

plt.legend()

plt.show()

设备维护流程对比(图表描述)

| 维护方式 | 维护周期 | 单次维护成本 | 年均停机时间 | 年均维护总成本 |

|---|---|---|---|---|

| 故障后维修 | 随机(故障后) | 5 万元 | 120 小时 | 30 万元 |

| 定期维护 | 每月 1 次 | 1 万元 | 40 小时 | 18 万元 |

| AI 预测性维护 | 故障前 3 天 | 0.8 万元 | 8 小时 | 6 万元 |

2.4.2 场景 2:质量检测 —— 产品外观缺陷识别

行业痛点:人工检测产品外观(如划痕、变形)易漏检(尤其是微小缺陷),且检测速度慢(单件需 30 秒),无法满足流水线节拍(单件需 < 5 秒)。**AI 解决方案**:用 YOLO(实时目标检测算法)识别产品缺陷,检测速度达 200 件 / 分钟,准确率 > 99%。

技术实现:PyTorch+YOLOv8 缺陷检测

python

运行

# 1. 安装依赖库

# !pip install ultralytics pandas opencv-python

# 2. 导入依赖库

from ultralytics import YOLO

import cv2

import pandas as pd

import matplotlib.pyplot as plt

# 3. 加载预训练模型(YOLOv8n:轻量级模型,适合实时检测)

model = YOLO("yolov8n.pt")

# 4. 数据集准备(自定义产品缺陷数据集:包含“划痕”“变形”“色差”3类缺陷)

# 数据集结构:

# defect_data/

# ├── images/

# │ ├── train/(1000张训练图)

# │ └── val/(200张验证图)

# └── labels/

# ├── train/(对应训练图的标注文件,YOLO格式)

# └── val/(对应验证图的标注文件)

# 5. 模型微调(在自定义缺陷数据集上训练)

model.train(

data="defect_data.yaml", # 数据集配置文件(包含类别、路径)

epochs=50, # 训练轮次

imgsz=640, # 输入图像尺寸

batch=16, # 批次大小

name="defect_detection" # 训练结果保存名称

)

# 6. 模型评估(在验证集上测试)

metrics = model.val()

print(f"缺陷检测mAP50:{metrics.box.map50:.4f}") # 输出示例:0.985(mAP50>0.95为优秀)

print(f"各类缺陷准确率:")

for cls, acc in zip(metrics.names, metrics.box.mp):

print(f"- {cls}:{acc:.4f}")

# 7. 实时检测(读取流水线视频或图像)

def detect_defect(image_path):

# 读取图像

img = cv2.imread(image_path)

img_rgb = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

# 模型预测

results = model(img_rgb, conf=0.3) # 置信度阈值0.3(过滤低置信度预测)

# 绘制检测框

annotated_img = results[0].plot()

# 提取缺陷信息

defect_info = []

for box in results[0].boxes:

cls = results[0].names[int(box.cls[0])]

conf = float(box.conf[0])

x1, y1, x2, y2 = map(int, box.xyxy[0])

defect_info.append({

"defect_type": cls,

"confidence": conf,

"bbox": (x1, y1, x2, y2)

})

return annotated_img, defect_info

# 测试单张图像

image_path = "defect_data/images/val/defect_001.jpg"

annotated_img, defect_info = detect_defect(image_path)

# 显示结果

plt.imshow(annotated_img)

plt.axis("off")

plt.show()

# 打印缺陷信息

print("检测到的缺陷:")

for defect in defect_info:

print(f"- 类型:{defect['defect_type']},置信度:{defect['confidence']:.4f},位置:{defect['bbox']}")

# 8. 流水线集成(通过API实时返回检测结果)

from fastapi import FastAPI, UploadFile, File

from PIL import Image

import io

app = FastAPI()

@app.post("/detect_defect")

async def detect_defect_api(file: UploadFile = File(...)):

# 读取上传的图像

contents = await file.read()

img = Image.open(io.BytesIO(contents))

img_rgb = cv2.cvtColor(np.array(img), cv2.COLOR_BGR2RGB)

# 模型预测

results = model(img_rgb, conf=0.3)

defect_info = []

for box in results[0].boxes:

cls = results[0].names[int(box.cls[0])]

conf = float(box.conf[0])

x1, y1, x2, y2 = map(int, box.xyxy[0])

defect_info.append({

"defect_type": cls,

"confidence": conf,

"bbox": (x1, y1, x2, y2)

})

# 返回结果(若有缺陷,返回缺陷信息;无缺陷,返回"normal")

if defect_info:

return {"status": "defect", "defect_info": defect_info}

else:

return {"status": "normal"}

# 启动API(命令:uvicorn main:app --reload)

三、AI 重塑工作模式:从 “人力替代” 到 “人机协作”

AI 不仅改变行业流程,更重构了工作的核心逻辑。其对工作模式的影响可概括为三大趋势:

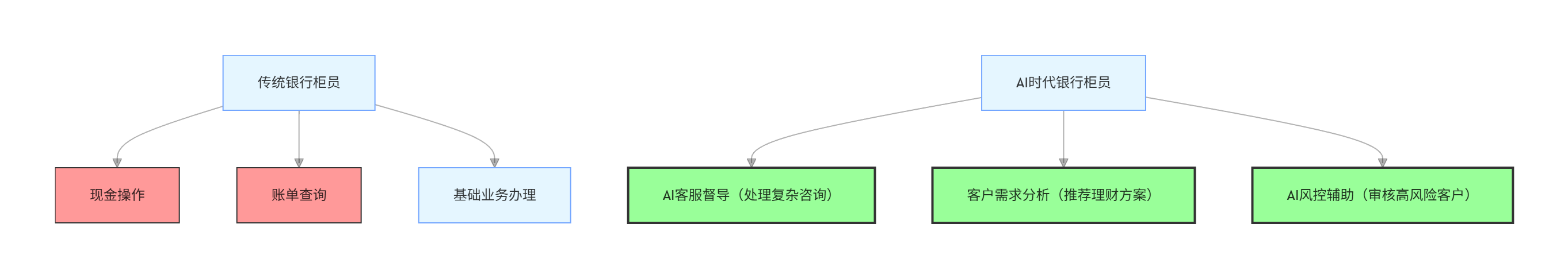

3.1 岗位技能迭代:从 “重复操作” 到 “AI 协同”

传统岗位中,重复、机械的工作(如数据录入、基础审核)正被 AI 替代,而需要 “判断、创造、情感交互” 的技能(如 AI 模型调优、客户需求挖掘)成为核心竞争力。

岗位技能演变对比(mermaid 流程图)

flowchart TD

%% 传统岗位技能

A[传统银行柜员] --> B[现金操作]

A --> C[账单查询]

A --> D[基础业务办理]

%% AI时代岗位技能

E[AI时代银行柜员] --> F[AI客服督导(处理复杂咨询)]

E --> G[客户需求分析(推荐理财方案)]

E --> H[AI风控辅助(审核高风险客户)]

style B fill:#f99,stroke:#333,stroke-width:1px

style C fill:#f99,stroke:#333,stroke-width:1px

style F fill:#9f9,stroke:#333,stroke-width:2px

style G fill:#9f9,stroke:#333,stroke-width:2px

style H fill:#9f9,stroke:#333,stroke-width:2px

3.2 工作流程重构:从 “线性流程” 到 “数据闭环”

传统工作流程是 “输入→处理→输出” 的线性模式,而 AI 时代则形成 “数据采集→模型预测→业务执行→数据反馈” 的闭环,工作效率持续优化。

制造业生产流程重构(图表描述)

| 流程阶段 | 传统模式 | AI 模式 | 核心差异 |

|---|---|---|---|

| 生产计划 | 基于历史经验制定 | 基于 AI 需求预测制定 | 从 “经验驱动” 到 “数据驱动” |

| 设备运行 | 定期巡检,故障后维修 | 实时监测,预测性维护 | 从 “被动应对” 到 “主动预警” |

| 质量检测 | 人工抽样检测,易漏检 | AI 全量检测,实时反馈 | 从 “抽样” 到 “全量” |

| 流程优化 | 季度 / 年度总结优化 | 实时数据反馈,动态优化 | 从 “周期性” 到 “实时性” |

3.3 组织形态变革:从 “层级管理” 到 “敏捷团队”

AI 降低了信息不对称,传统的 “金字塔式” 层级管理正被 “敏捷团队” 替代。团队更聚焦 “目标导向”,通过 AI 工具快速协同(如 AI 项目管理、智能文档协作)。

四、AI 落地的挑战与未来趋势

4.1 核心挑战

- 数据质量与安全:AI 依赖高质量数据,但多行业存在 “数据孤岛”(如医疗数据跨院共享难)、“数据隐私”(如金融用户信息保护)问题;

- 模型可解释性:深度学习模型被称为 “黑箱”,在医疗、金融等关键领域(如 AI 诊断错误追责),可解释性不足限制落地;

- 成本与 ROI 平衡:AI 部署需投入算力(如 GPU 服务器)、人才(AI 工程师年薪 30-80 万),部分中小企业难以承担。

4.2 未来趋势

- 行业大模型落地:从通用大模型(如 GPT-4)到行业大模型(如医疗大模型、工业大模型),模型更贴合行业需求,数据量需求降低;

- 多模态 AI 融合:结合文本、图像、语音、传感器数据的多模态 AI,将提升场景适配能力(如制造业 “视觉 + 振动” 多维度故障检测);

- 低代码 AI 平台普及:降低 AI 使用门槛,让非技术人员(如医生、教师)通过 “拖拽式” 操作构建 AI 应用。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)