AICropCAM: 一套将边缘计算和堆栈式深度学习模型应用于田间作物分类、分割、识别及计数的成像系统...

精准农业有望在保持生产的可持续性和环境友好性的同时,满足人类未来对食物、饲料、纤维和燃料的需求。精准农业在很大程度上依赖传感器和相应的数据处理技术为种植、灌溉、施肥、施药和收割提供决策支持。与传统点式传感器相比,与人工智能模型结合的成像传感器在测量作物冠层相关参数的能力更为强大。然而严苛的大田环境对算力、电力和网络连接的限制形成了对此技术充分利用的阻碍。本文报告了AICropCAM,一个整合了大田

精准农业有望在保持生产的可持续性和环境友好性的同时,满足人类未来对食物、饲料、纤维和燃料的需求。精准农业在很大程度上依赖传感器和相应的数据处理技术为种植、灌溉、施肥、施药和收割提供决策支持。与传统点式传感器相比,与人工智能模型结合的成像传感器在测量作物冠层相关参数的能力更为强大。然而严苛的大田环境对算力、电力和网络连接的限制形成了对此技术充分利用的阻碍。

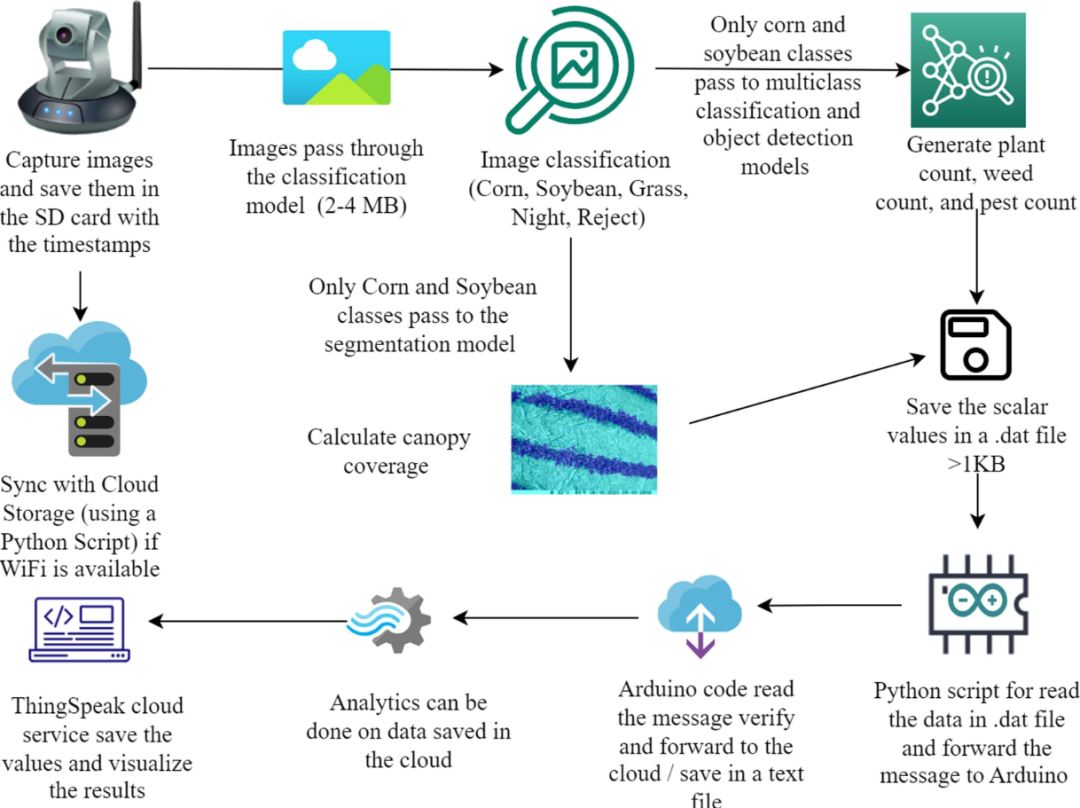

本文报告了AICropCAM,一个整合了大田图像采集、边缘深度图像处理、物联网、低功耗远距离通信等技术的系统。AICropCAM的核心是一个由四个深度卷积神经网络模型(DCNN)顺序运行的堆栈,其中CropClassiNet用于作物类型分类,CanopySegNet用于冠层覆盖量化,PlantCountNet用于植物和杂草计数,以及InsectNet用于昆虫识别。这些DCNN模型经过监督训练并在大量田间作物图像上进行了测试。

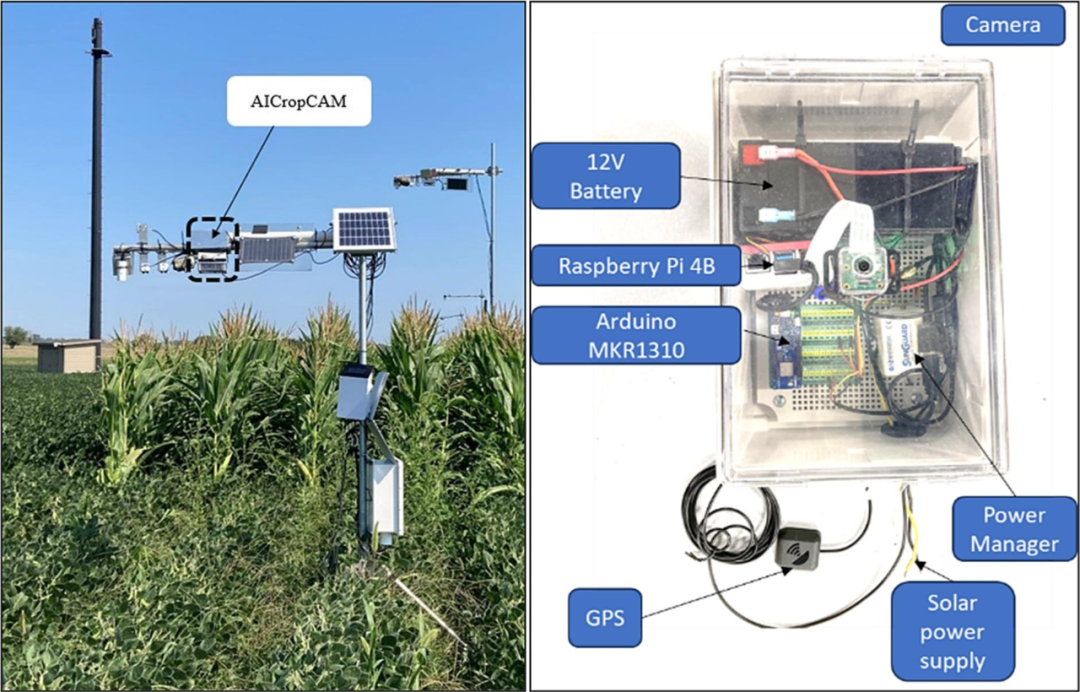

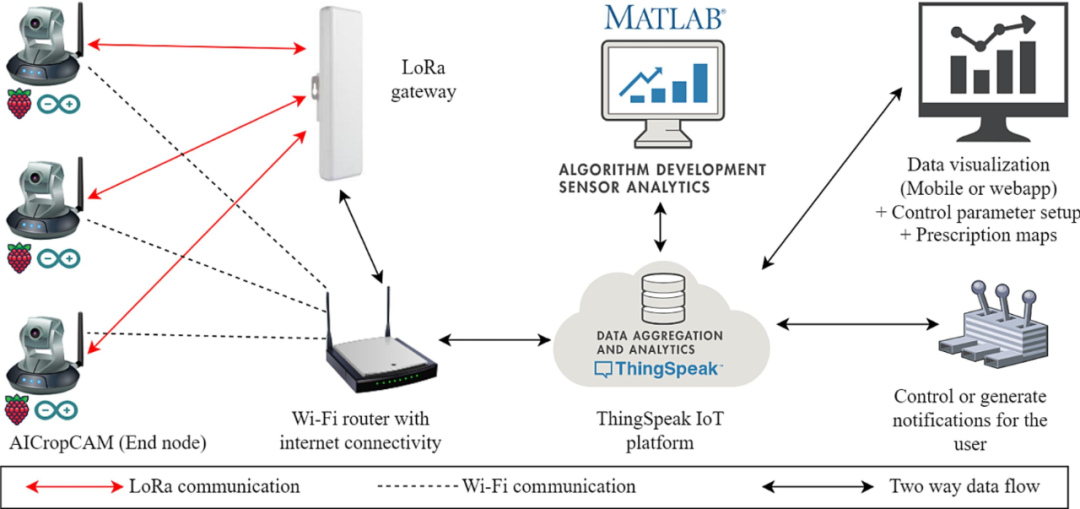

此系统建立在一个分布式无线传感器网络上,其传感器节点包括用于图像采集的RGB摄像头,用于边缘图像处理的树莓派4B单板计算机,以及用于LoRa通信和电源管理的Arduino MKR1310。测试结果显示,运行DCNN模型的时间和功率从InsectNet的0.20秒(3.68瓦)到CanopySegNet的20.20秒(5.83瓦)不等。分类模型CropClassiNet和分割模型CanopySegNet分别报告了94.50%和92.83%的准确率。

两个对象检测模型PlantCountNet和InsectNet报告的平均精度分别为0.69和0.02。模型预测结果随后被传输到ThingSpeak IoT平台进行数据可视化和分析。此研究表明AICropCAM成功实现了边缘深度图像处理,大幅减少了传输的数据量,并且能够满足精准农业中实时决策的需求。AICropCAM可以部署在移动平台上,如圆形喷灌机或无人机平台以增加其空间覆盖范围和分辨率,为作物监测和田间操作提供决策支持。

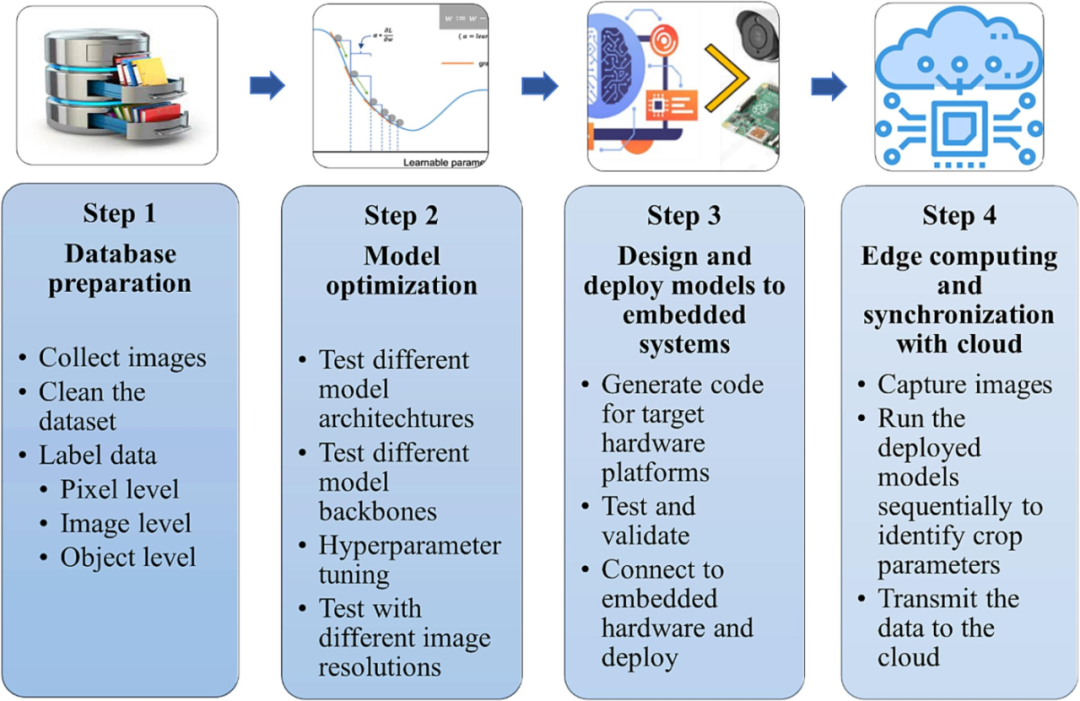

Fig. 1.Steps of edge image processing program deployment on the embedded system (edge devices).

Fig. 2.Left: An Illustration of how AICropCAM was set up in the field for image collection. In addition to the camera, other components such as the solar panel and data logger were also shown. Right: A close-up view of AICropCAM and its hardware components.

Fig. 4. Hardware overview of AICropCAM and data flow.

Fig. 5.Overall sequential image processing and data generation flow chart.

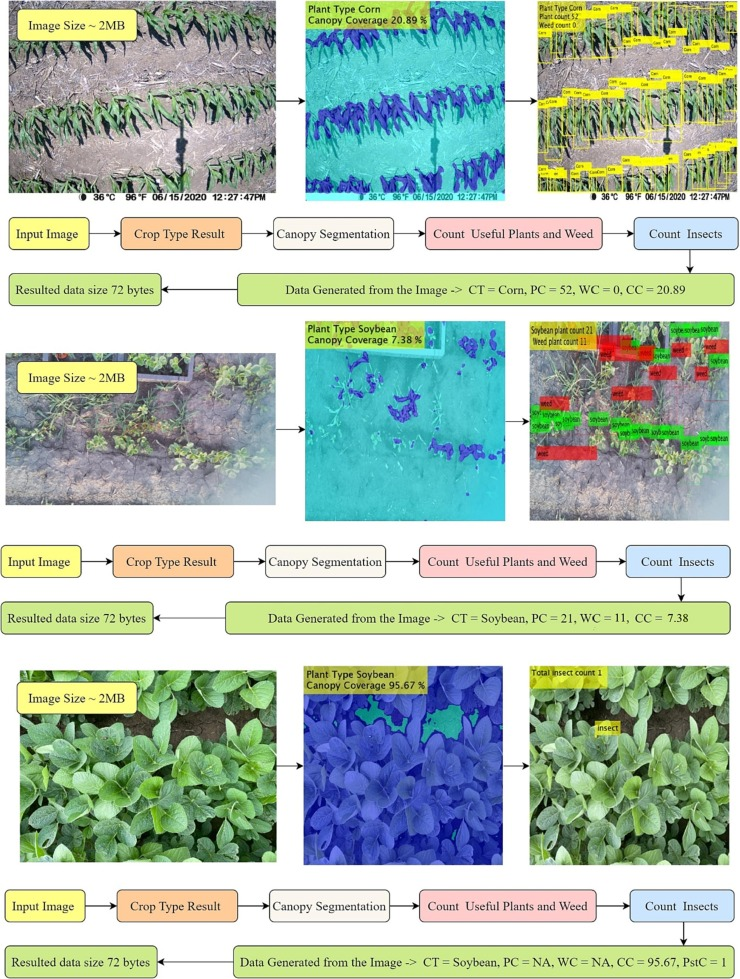

Fig. 6. Examples of message generation and data size reduction for LoRa transmission.

来 源

Nipuna Chamara, Geng Bai, Yufeng Ge, 2023. AICropCAM: Deploying classification, segmentation, detection, and counting deep-learning models for crop monitoring on the edge. Computers and Electronics in Agriculture 215, 108420.

作者介绍

Nipuna Chamara,美国内布拉斯加大学林肯分校, 生物系统工程系

白更,美国内布拉斯加大学林肯分校, 生物系统工程系

葛玉峰,美国内布拉斯加大学林肯分校, 生物系统工程系

更多推荐

已为社区贡献77条内容

已为社区贡献77条内容

所有评论(0)