国产芯片优化2:如何在带宽受限的硬件上,跑出通信无阻塞的极致速度?

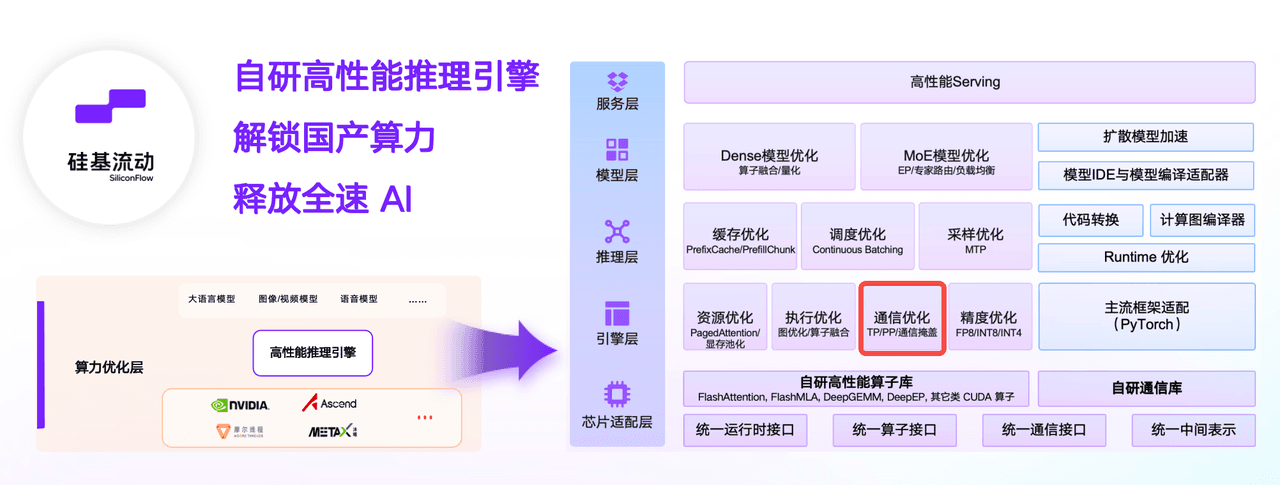

这是硅基流动【国产芯片适配与优化实践】系列分享文章的第二期,今天我们继续来看算力优化的“引擎层”,聊一聊“通信优化”这个话题。

这是硅基流动【国产芯片适配与优化实践】的系列分享文章,今天我们继续来看算力优化的“引擎层”,聊一聊“通信优化”这个话题。

系列文章导航

实践篇|国产芯片优化1:如何构建三位一体软件栈,突破既定硬件的性能瓶颈?

实践篇|国产芯片优化2:如何在带宽受限的硬件上,跑出通信无阻塞的极致速度?

实践篇|国产芯片优化3:如何利用MTP策略提升Decode 吞吐,将过剩算力转化为推理速度?

今天的内容,我们以在国产算力 Atlas 800I A2 上部署像 DeepSeek 这样复杂的 MoE(Mixture of Experts)模型为例。

诸如 Atlas 800I A2 这样的国产集群,单点算力强劲,却普遍存在一个致命短板——节点间的通信带宽远低于节点内。当运行 DeepSeek 这类需要大量节点间通信的 MoE 模型时,传统思路是大量使用 All2All 通信,这就好比让一支航母编队去挤一条乡村土路,必然导致严重的网络堵塞,强大的算力只能在那里白白浪费时间等待数据。

既然路无法拓宽,能否换个更聪明的“跑法”?

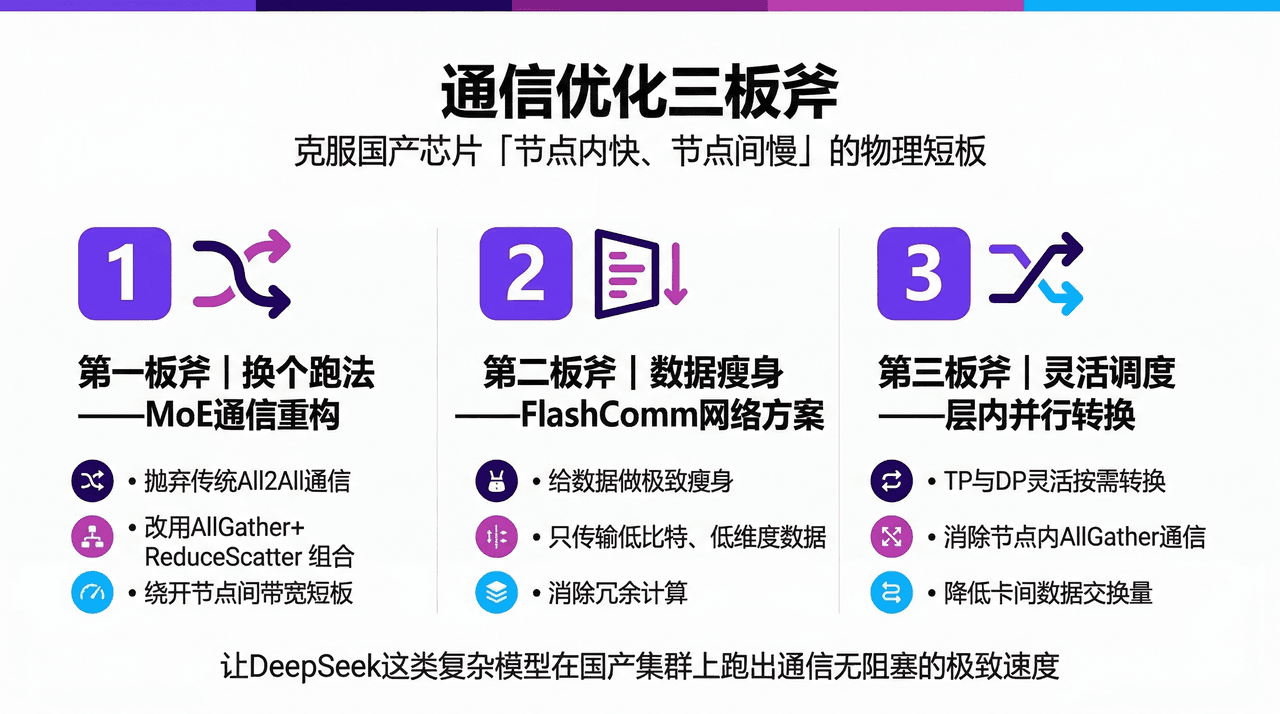

答案是肯定的。可以通过三层软件算法的精巧定制,即“通信优化三板斧”,可以克服国产芯片“节点内快、节点间慢”的物理缺陷,让复杂模型在带宽受限的硬件上也能跑出通信无阻塞的极致速度。

第一板斧:换个跑法 —— MoE 通信重构

之前提到,传统的 MoE 模型部署方式严重依赖 All2All 通信,这正是造成拥堵的“主干道”。因此,可以做一个大胆的决定:完全抛弃经典的 All2All 部署方式。

针对 Atlas 集群的拓扑结构特点,将 MoE 层的数据通信逻辑拆解为“AllGather + ReduceScatter”的组合。这一改变,如同巧妙地避开了拥堵的主干道,选择了一条畅通无阻的“高架桥”,直接绕开了节点间带宽的短板,高效解决拥堵问题。

第二板斧:数据瘦身 —— FlashComm 网络方案

解决了 MoE 层的通信模式,需要接着处理 DeepSeek 模型特有的 MLA(Multi-Latent Attention)结构在 Prefill(预填充)阶段产生的大量通信需求。具体来说,传统的并行策略会产生大量冗余计算和高维数据的传输需求,导致通信时延过高。

为此,可以使用 FlashComm 网络方案,其核心思想就是给数据做一次极致的“瘦身”。通过对通信算子的重新编排,强制网络只传输“低比特”和“低维度”的数据,从而大幅降低数据传输量,使得原本拥挤的带宽瞬间变得绰绰有余。同时,也消除了网络中的冗余计算,一举两得。

第三板斧:灵活调度 —— 层内并行转换

最后,再将目光投向节点内部,优化卡与卡之间的通信效率。

在 Prefill 阶段,不再死板地进行同步,而是引入“层内并行转换技术”,重新设计了 MLA 层内的多卡并行策略,实现 TP(张量并行)与 DP(数据并行)的灵活按需转换。这一招直接消除了节点内部大量的 AllGather 通信需求,充分利用量化特性,将卡间的数据交换量降至最低。

总结:用软件智慧,铺平硬件窄路

“换个跑法”、“数据瘦身”、“灵活调度”——这套通信优化三板斧,是专门为克服国产芯片“节点内快、节点间慢”的物理短板而定制设计的软件解决方案。

这一系列实践证明了,把复杂模型高效部署在国产集群上,即使面对“路窄”的先天不足,通过顶层的算法设计和底层的工程优化,依然可以跑出通信无阻塞的极致速度。让像 DeepSeek 这类前沿、复杂的 AI 大模型,在国产算力集群上也能丝滑运行,为企业释放每一分宝贵的 AI 算力。

【拓展阅读】

硅基流动私有化 MaaS 大模型服务平台,一站式为企业客户提供从异构算力纳管、模型训练、推理部署到场景落地的闭环解决方案。帮助客户以更低成本、更快速度、更高性能、更强稳定性,安全可靠地规模化落地大模型应用,满足从研发到生产的全链路需求。👉立即咨询。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)