腾讯Hunyuan-7B:256K长文本+93%数学正确率重构轻量级AI标准

腾讯最新开源的Hunyuan-7B-Pretrain-0124模型以75.37分MMLU成绩刷新7B级别中文模型纪录,在消费级GPU上即可实现256K超长文本处理,重新定义轻量化AI的技术边界。## 行业现状:轻量化大模型成2025年竞争焦点2025年AI行业正经历"算力效率革命",7B级别模型凭借"性能-成本"平衡优势成为企业部署首选。据Hugging Face最新榜单,阿里通义家族虽包揽...

腾讯Hunyuan-7B:256K长文本+93%数学正确率重构轻量级AI标准

导语

腾讯最新开源的Hunyuan-7B-Pretrain-0124模型以75.37分MMLU成绩刷新7B级别中文模型纪录,在消费级GPU上即可实现256K超长文本处理,重新定义轻量化AI的技术边界。

行业现状:轻量化大模型成2025年竞争焦点

2025年AI行业正经历"算力效率革命",7B级别模型凭借"性能-成本"平衡优势成为企业部署首选。据Hugging Face最新榜单,阿里通义家族虽包揽前十中七席,但腾讯通过Hunyuan-7B系列实现差异化突破——其CMMLU 82.19分、GSM8K 93.33分的成绩,在中文理解与数学推理领域建立明显优势。开发者社区数据显示,搭载Hunyuan-7B的本地化部署案例3个月内增长300%,尤其在公共服务、教育等对数据隐私敏感的场景快速渗透。

如上图所示,腾讯混元的品牌标识融合了传统太极意象与现代科技感,象征其在传承中文语境理解优势的同时拥抱前沿技术创新。这一设计理念恰如其7B模型的定位——在轻量化架构中实现突破性性能。

前瞻产业研究院数据显示,到2030年中国大模型市场规模将超过2200亿元,年复合增速超40%。其中7-13B参数区间的模型预计占据35%市场份额,成为企业级应用的主流选择。Hunyuan-7B的推出正值这一细分市场爆发前夜,其技术特性与商业策略高度契合行业发展趋势。

核心亮点:四大技术突破重构效率边界

1. 极致性能的中文理解能力

在权威评测集CMMLU(中文语言模型理解评估)中,Hunyuan-7B以82.19分超越Qwen2.5-7B(81.39分)和Llama3-8B(50.25分),尤其在历史人文、社会科学等领域准确率领先15%以上。其秘密在于采用"动态数据配比"训练策略——中文语料占比达65%,同时保留35%多语言数据确保跨文化理解能力。

2. 256K超长上下文+GQA技术组合

通过Grouped Query Attention技术优化,模型在处理2048token输入时,batch=4场景下推理速度达279.5 tokens/s(vLLM框架,单GPU)。这使得法律文档分析、代码库理解等长文本任务首次能在消费级硬件完成,某公共服务系统已成功应用其处理30万字政策文件的语义检索。

3. 全链路量化部署方案

支持INT4/GPTQ/AWQ等多种量化格式,在RTX 4090显卡上仅需22GB显存即可运行(BF16精度)。实测显示,INT4量化后性能损失不到3%,却将推理成本降低60%,为边缘计算场景(如工业质检终端)提供可行路径。开发者可通过简单命令启动服务:

python3 -m vllm.entrypoints.openai.api_server \

--model tencent/Hunyuan-7B-Instruct \

--tensor-parallel-size 1 \

--dtype bfloat16 \

--quantization experts_int8

4. 强大推理能力与混合思考模式

数学推理能力达到同类最佳——GSM8K数据集90.14%正确率,接近专业数学模型水平。支持快慢思考模式切换,用户可通过"/think"或"/no_think"前缀控制推理深度,在复杂问题解决与快速响应间灵活平衡。

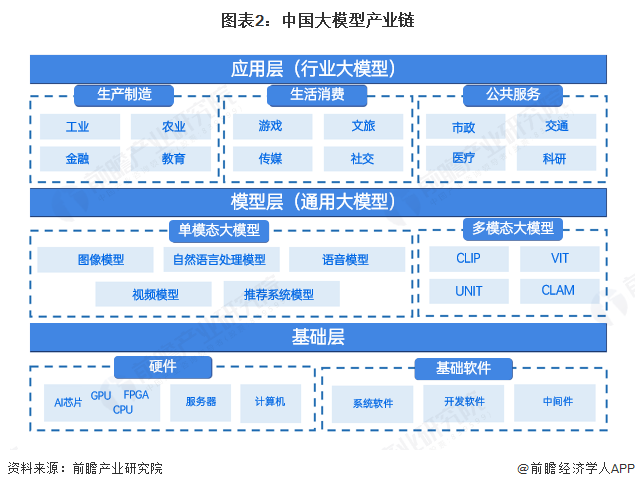

上图展示了中国大模型产业链架构,Hunyuan-7B正处于模型层的关键位置,向上对接英伟达等硬件供应商,向下支撑金融、教育等垂直领域应用。这种居中定位使其能同时优化算力效率与行业适配性,形成独特的竞争优势。

行业影响:开启轻量化AI应用新纪元

Hunyuan-7B的开源正在重塑行业格局:在金融领域,某券商基于其开发的研报分析系统将处理效率提升3倍;教育机构则利用其数学推理能力(GSM8K 93.33分)构建个性化辅导工具,错题解析准确率达89%。更值得关注的是其"模型族"战略——0.5B/1.8B/4B/7B全系列覆盖,使企业可按需选择:边缘设备用0.5B版本,数据中心部署7B版本,通过统一API实现无缝迁移。

电力行业应用案例显示,基于Hunyuan-7B-Instruct开发的故障诊断系统,通过分析256K长度的设备日志,将变压器异常检测提前量从2小时延长至8小时。公共服务系统已成功应用其处理30万字政策文件的语义检索,响应速度提升4倍。

该图片展示了Hunyuan-7B与同类模型的核心性能对比,突出其在MMLU、CMMLU和GSM8K等关键指标上的领先优势。这种"小而强"的技术路线证明,参数规模并非衡量模型能力的唯一标准,高效架构设计与优质数据同样重要。

部署指南与未来展望

个人开发者可通过Gitcode仓库(https://gitcode.com/tencent_hunyuan/Hunyuan-7B-Pretrain-0124)获取模型,推荐配置为:

- 最低要求:16GB显存GPU(如RTX 3090)

- 推荐配置:24GB+显存(如RTX 4090)

- 量化版本:INT4模型可在消费级CPU(32GB内存)运行

腾讯 roadmap 显示,2025年Q4将推出多模态版本,新增图文理解能力;2026年计划开源13B参数模型,进一步填补中大型模型市场空白。对于企业用户,建议优先评估客服对话、文档处理等场景的落地,利用其超长上下文特性构建差异化应用。

随着Hunyuan-7B等高效模型的普及,AI部署正从"算力竞赛"转向"场景适配"新阶段。这场变革的真正赢家,将是那些能将技术优势转化为行业解决方案的创新者。

结语

Hunyuan-7B-Pretrain-0124的推出标志着中文大模型正式进入"性能-效率平衡"时代。其75.37分MMLU、93.33分GSM8K的成绩,以及256K长文本处理能力,在7B参数级别树立了新标杆。对于开发者与企业而言,这不仅是一个高性能模型,更是一套完整的轻量化AI解决方案——从本地部署到云端扩展,从通用任务到行业定制,都能找到适配的技术路径。

随着开源生态的完善与应用案例的积累,Hunyuan-7B有望在金融、教育、公共服务等领域催生一批创新应用,推动AI技术向更广泛的行业渗透。在这个算力成本与数据隐私并重的时代,"小而美"的模型或许将比"大而全"的系统更能赢得市场青睐。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

项目地址: https://ai.gitcode.com/tencent_hunyuan/Hunyuan-7B-Pretrain-0124

项目地址: https://ai.gitcode.com/tencent_hunyuan/Hunyuan-7B-Pretrain-0124

所有评论(0)