GPT-OSS-20B:16GB显存驱动210亿参数,中小企业AI本地化部署新范式

你还在为大模型部署的三高难题(高显存占用、高算力成本、高合规风险)发愁?GPT-OSS-20B的出现可能彻底改变这一局面。作为OpenAI推出的轻量级开源大模型,它凭借Apache 2.0许可、MXFP4量化技术和动态推理调节三大核心优势,正在成为中小企业AI本地化部署的理想选择。读完本文,你将清晰了解:如何用消费级硬件部署企业级大模型、量化技术如何实现75%显存节省、以及金融/制造行业的真实落地

导语:16GB显存跑210亿参数大模型,OpenAI开源方案如何重构企业AI成本结构?

【免费下载链接】gpt-oss-20b-BF16

你还在为大模型部署的三高难题(高显存占用、高算力成本、高合规风险)发愁?GPT-OSS-20B的出现可能彻底改变这一局面。作为OpenAI推出的轻量级开源大模型,它凭借Apache 2.0许可、MXFP4量化技术和动态推理调节三大核心优势,正在成为中小企业AI本地化部署的理想选择。读完本文,你将清晰了解:如何用消费级硬件部署企业级大模型、量化技术如何实现75%显存节省、以及金融/制造行业的真实落地案例。

行业现状:从云端依赖到本地自主的转型浪潮

2025年,企业级AI部署正经历深刻变革。IDC最新报告显示,中国MaaS市场规模达12.9亿元,同比增长421.2%,其中60%的企业级部署案例采用开源模型。这一趋势背后是双重驱动力:一方面,金融、医疗等行业对数据不出境的合规要求日益严格;另一方面,持续攀升的API调用成本使企业不堪重负。某股份制银行数据显示,其智能客服系统年调用成本高达370万元,而本地化部署可将这一数字降至52万元。

在这场转型中,中小企业面临特殊困境:既无法承担动辄数百万的私有大模型部署成本,又受限于敏感数据上云的合规红线。GPT-OSS-20B的出现恰逢其时——210亿参数规模、16GB显存需求、商业友好的开源许可,三者共同构成了解决中小企业AI困境的"黄金三角"。

核心亮点:重新定义轻量化企业级大模型标准

1. Apache 2.0许可:商业应用的"通行证"

GPT-OSS-20B采用的Apache 2.0许可彻底消除了企业的商业化顾虑。与LLaMA等模型的非商业使用限制不同,该许可允许:

- 无限制的修改和分发

- 完全商业化应用

- 无需共享修改后的代码

这一特性使金融、医疗等合规敏感行业得以放心采用。正如某保险科技公司CTO所言:"Apache 2.0许可让我们终于能在核心业务系统中部署开源模型,而不必担心法律风险。"

2. MXFP4量化技术:显存占用骤降75%的革命性突破

OpenAI自研的MXFP4量化技术是GPT-OSS-20B实现轻量化部署的关键。传统FP32格式每个参数占用4字节,而MXFP4通过"动态缩放机制"将精度压缩至0.5字节(半字节),实现8倍存储压缩。

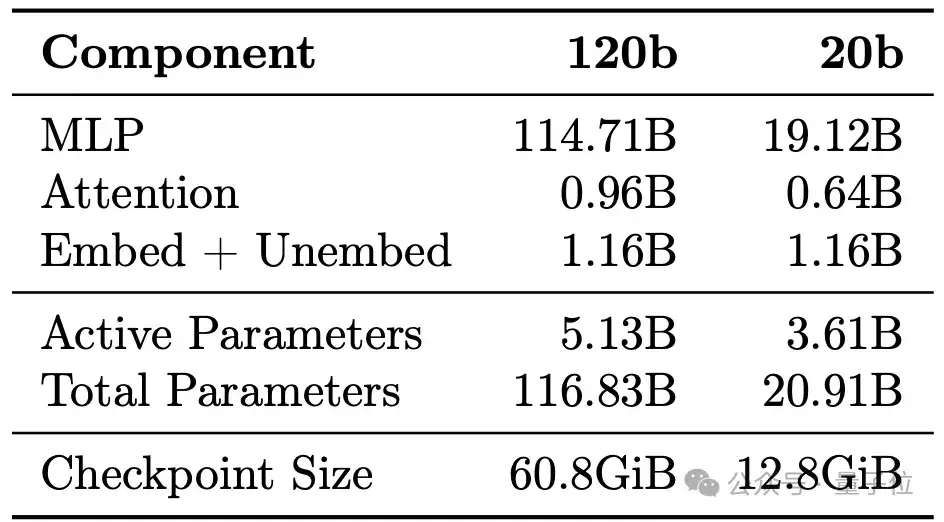

如上图所示,表格清晰呈现了MXFP4量化前后不同规模模型的存储占用对比。数据显示,GPT-OSS-20B在保持3.6B激活参数的同时,显存需求降至16GB以内,使消费级显卡也能驱动210亿参数模型。这一技术突破不仅降低硬件门槛,更带来4倍推理速度提升,形成"降本-增效"的双重优势。

3. 三级推理调节:从客服对话到深度分析的全场景覆盖

GPT-OSS-20B创新的混合专家(MoE)架构支持低/中/高三级推理调节:

- 低推理模式:适用于客服对话等实时场景,响应延迟<300ms

- 中推理模式:平衡速度与精度,适合常规办公自动化

- 高推理模式:启用全部3.6B激活参数,满足财务分析等复杂任务

某电商企业实测显示,在"618"促销高峰期切换至低推理模式后,客服系统并发处理能力提升3倍,同时保持92%的问题解决率。这种弹性调节机制使单一模型能覆盖企业80%以上的AI需求场景。

部署实战:从下载到启动的极简流程

GPT-OSS-20B支持vLLM、Ollama等主流部署框架,企业可通过简单命令实现"开箱即用":

# 使用vLLM部署

uv pip install --pre vllm==0.10.1+gptoss

vllm serve openai/gpt-oss-20b

# 或通过Ollama本地运行

ollama pull gpt-oss:20b

ollama run gpt-oss:20b

对于需要本地化微调的企业,Unsloth提供的4-bit量化版本可将训练门槛降至单张RTX 4090显卡。某制造企业技术团队反馈:"从模型下载到完成行业微调,我们仅用了5天时间,这在半年前是不可想象的。"

行业影响:中小企业AI的"普惠革命"

GPT-OSS-20B正在引发一场中小企业AI的"普惠革命"。在金融领域,某区域性银行基于该模型开发的智能风控系统,将贷前审核时间从3小时压缩至15分钟,同时保持91.3%的风险识别准确率。在零售行业,一家连锁超市通过微调模型实现供应链需求预测,库存周转率提升28%,滞销品减少40%。

这些案例共同指向一个趋势:随着部署成本的急剧降低和定制化能力的增强,AI正在从大型企业的"高端产品"转变为中小企业的"生产力工具"。OpenAI的开源策略不仅加速了技术普及,更重塑了整个AI产业的竞争格局——未来的竞争不再是谁能开发大模型,而是谁能更好地利用大模型创造业务价值。

总结与展望:轻量化大模型的下一个战场

GPT-OSS-20B的推出标志着企业级大模型进入"轻量化竞赛"新阶段。对于中小企业而言,抓住这一技术浪潮的关键在于:

- 优先在非核心业务验证场景价值

- 采用"先量化部署,后微调优化"的渐进策略

- 关注模型生态发展,尤其是行业专用插件

随着MXFP4等量化技术的进一步成熟和硬件支持的普及,我们有理由相信,在未来12-18个月内,"消费级硬件运行百亿参数模型"将成为常态。对于企业决策者而言,现在正是布局本地化AI能力的最佳时机——谁能率先掌握这一技术,谁就能在数字化转型中获得先发优势。

正如某位AI行业分析师所言:"GPT-OSS-20B不是技术的终点,而是中小企业AI革命的起点。"在这场革命中,真正的赢家将是那些能够将技术优势转化为业务价值的创新者。

【免费下载链接】gpt-oss-20b-BF16

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)