MiniCPM-Llama3-V-2.5-int4大模型部署指南

详细介绍在AutoDL算力平台上部署MiniCPM-Llama3-V-2.5-int4量化大模型的完整流程,涵盖环境配置、依赖安装、模型下载、内网穿透及常见报错解决方案,适配4090显卡与8GB显存环境,提供可运行的推理代码示例。

MiniCPM-Llama3-V-2.5-int4 大模型部署实战指南

在当前多模态大模型快速发展的背景下,如何将前沿视觉语言模型(VLM)高效部署到本地或云端环境,成为开发者和研究人员关注的核心问题。MiniCPM-Llama3-V-2.5-int4 作为 OpenBMB 团队推出的轻量级多模态模型,凭借其对 Llama3 架构的深度优化与 INT4 量化技术,在保持强大图像理解能力的同时,显著降低了显存占用——这使得它能够在 RTX 3090/4090 等消费级 GPU 上流畅运行,极大提升了落地可行性。

本文基于 Miniconda-Python3.9 镜像 环境,结合 AutoDL 算力平台实操经验,完整还原从环境搭建、依赖安装、模型加载到 Web 服务发布的全流程,并针对常见“坑点”提供可复用的解决方案。无论你是想快速验证模型效果,还是构建私有化视觉问答系统,这份实战手册都能帮你少走弯路。

环境准备:为什么选择 Miniconda?

深度学习项目最怕“在我机器上能跑”。为了规避包版本冲突导致的兼容性问题,我们推荐使用 Miniconda 来管理 Python 环境。相比于 Anaconda,Miniconda 更轻量,只包含 conda 包管理器和 Python 解释器本身,适合科研与生产场景中的精确依赖控制。

本指南所用基础镜像是 Miniconda-Python3.9,这是一个经过广泛验证的稳定组合,尤其适配 PyTorch 2.x 生态。通过 conda 创建独立虚拟环境后,所有安装都将隔离进行,避免污染全局配置。

硬件要求:INT4 量化带来的革命性变化

| 组件 | 最低要求 | 推荐配置 |

|---|---|---|

| GPU | NVIDIA RTX 3090 (24GB) | RTX 4090 (24GB) / A10G / A100 |

| 显存 | ≥16GB(非量化版) | ≥8GB(INT4量化版可运行) |

| CPU | 8核以上 | 16核以上 |

| 内存 | 32GB | 64GB |

| 存储空间 | ≥100GB SSD | ≥200GB NVMe |

| CUDA 支持 | CUDA 11.8 或更高 | CUDA 12.1+ |

💡 关键洞察:原始 FP16 版本的

MiniCPM-Llama3-V-2.5模型参数量约为 80 亿,推理时需要至少 48GB 显存(如 A100)。而经过 INT4 量化 后,显存占用减少近 60%,实测可在单卡 RTX 4090 上以 15~20 token/s 的速度完成图像描述生成任务。这对于预算有限但追求高性能的团队来说,是一个极具吸引力的选择。

平台推荐:哪里可以低成本试错?

- AutoDL算力平台:https://www.autodl.com/market/list

提供按小时计费的 GPU 实例,支持 RTX 3090/4090、A10G、A100 等多种显卡,非常适合短期实验与调试。 - ModelScope 魔搭社区:https://modelscope.cn/models

可直接下载模型权重与官方示例代码,国内访问速度快。 - Hugging Face 官方仓库:https://huggingface.co/openbmb/MiniCPM-Llama3-V-2_5-int4

支持git-lfs下载,适合熟悉命令行操作的用户。

快速启动:连接远程实例

假设你已在 AutoDL 上创建了一个搭载 RTX 4090 的容器实例,接下来可通过两种方式接入:

方式一:SSH 登录(推荐)

ssh -p <port> root@<your-instance-ip>

输入密码后即可进入终端操作界面。这种方式适合执行批量脚本、后台运行服务等任务。

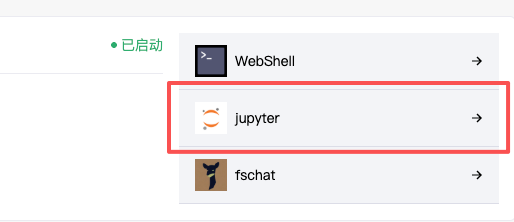

方式二:JupyterLab Web IDE

大多数算力平台会内置 JupyterLab 访问入口,点击即可打开图形化开发环境,便于交互式调试和可视化测试。

初始化 Conda 环境

首次登录时,可能会遇到如下报错:

CommandNotFoundError: Your shell has not been properly configured to use 'conda activate'.

这是因为 conda 尚未初始化当前 shell。解决方法很简单:

conda init bash

source ~/.bashrc

然后验证是否生效:

conda --version

# 输出类似:conda 23.11.0

确认无误后,创建专属虚拟环境:

conda create -n minicpmv25 python=3.9 -y

conda activate minicpmv25

激活成功后,命令行提示符前会出现 (minicpmv25) 标识,表示当前处于隔离环境中。

模型部署四步走

第一步:克隆官方代码库

git clone https://github.com/OpenBMB/MiniCPM-V.git

cd MiniCPM-V

该仓库包含了模型加载、推理接口、Web Demo 等核心模块,是后续所有操作的基础。

第二步:安装依赖项(关键!注意版本匹配)

建议优先使用国内镜像源加速安装:

pip install -r requirements.txt -i https://pypi.mirrors.ustc.edu.cn/simple

由于该项目对部分库版本敏感,需手动指定以下关键组件:

# PyTorch(根据CUDA版本选择)

pip install torch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 --index-url https://download.pytorch.org/whl/cu118

# Transformers & 分词器

pip install transformers==4.40.0 -i https://pypi.mirrors.ustc.edu.cn/simple

pip install sentencepiece==0.1.99 -i https://pypi.mirrors.ustc.edu.cn/simple

# Web UI 工具链

pip install gradio==3.40.0 -i https://pypi.mirrors.ustc.edu.cn/simple

pip install accelerate -i https://pypi.mirrors.ustc.edu.cn/simple

⚠️ 警告:请务必确保 PyTorch 与 CUDA 版本匹配。本文基于

CUDA 11.8,若你使用的是CUDA 12.x,请替换为对应的 PyTorch 安装命令(例如cu121)。

第三步:下载模型文件

方法一:使用 Git LFS(推荐)

git lfs install

git clone https://huggingface.co/openbmb/MiniCPM-Llama3-V-2_5-int4

方法二:通过 Hugging Face CLI

huggingface-cli download openbmb/MiniCPM-Llama3-V-2_5-int4 --local-dir ./MiniCPM-Llama3-V-2_5-int4

方法三:使用 ModelScope 下载(国内友好)

from modelscope.hub.snapshot_download import snapshot_download

model_dir = snapshot_download('OpenBMB/MiniCPM-Llama3-V-2_5-int4')

第四步:解压模型(如为压缩包)

某些渠道提供的模型可能是 .rar 格式,需先安装解压工具:

sudo apt-get update && sudo apt-get install unrar -y

unrar x MiniCPM-Llama3-V-2_5-int4.rar

解压后应包含以下文件:

config.json

generation_config.json

model.safetensors

special_tokens_map.json

tokenizer.model

tokenizer_config.json

这些是标准 Hugging Face 模型结构,可用于 AutoModel.from_pretrained() 直接加载。

推理测试:让模型“看见”图片

编写一个简单的测试脚本 test.py:

# test.py

import torch

from PIL import Image

from transformers import AutoModel, AutoTokenizer

# 设置模型路径

model_path = "./MiniCPM-Llama3-V-2_5-int4"

tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True)

model = AutoModel.from_pretrained(

model_path,

trust_remote_code=True,

torch_dtype=torch.float16

).to("cuda")

model.eval()

# 加载测试图像

image = Image.open("./assets/demo.jpg").convert("RGB")

question = "Please describe this image in detail."

msgs = [{"role": "user", "content": question}]

# 开始推理

response = model.chat(

image=image,

msgs=msgs,

tokenizer=tokenizer,

sampling=True,

temperature=0.7

)

print("Model Response:")

print(response)

运行脚本:

python test.py

预期输出示例:

Model Response:

This is a photograph of a white commercial airplane flying in the sky against a blue background with scattered clouds...

如果能看到类似结果,说明模型已成功加载并完成一次视觉推理!

进阶技巧:启用流式输出

对于 Web 应用或聊天机器人场景,逐字输出体验更自然。只需设置 stream=True:

res = model.chat(

image=image,

msgs=msgs,

tokenizer=tokenizer,

sampling=True,

temperature=0.7,

stream=True

)

for new_text in res:

print(new_text, end="", flush=True)

这样可以在响应生成过程中实时显示内容,提升交互感。

启动 Web 可视化界面

项目中自带了 web_demo_2.5.py 文件,用于启动图形化交互界面:

python web_demo_2.5.py

默认监听端口为 7860,本地可通过浏览器访问:

http://localhost:7860

页面提供上传图像、输入问题、调节采样参数等功能,适合演示或快速原型开发。

公网访问:内网穿透实战(cpolar)

如果你在云服务器上部署服务,默认只能在本地访问。要实现跨设备远程调用,需借助内网穿透工具暴露服务。

安装 cpolar

sudo apt-get update

sudo apt-get install curl -y

curl -L https://www.cpolar.com/static/downloads/install-release-cpolar.sh | sudo bash

验证安装:

cpolar version

配置认证 Token

前往 cpolar 官网后台,复制你的 authtoken 并配置:

cpolar authtoken your_auth_token_here

启动 HTTP 隧道

将本地 7860 端口映射至公网:

cpolar http 7860

成功后输出类似:

Forwarding: http://xxxxx.cpolar.io -> http://localhost:7860

复制链接在任意设备浏览器中打开,即可远程访问 Web UI。

持久化运行(开机自启)

为避免每次重启都要手动启动隧道,可将 cpolar 设为系统服务:

sudo systemctl enable cpolar

sudo systemctl start cpolar

sudo systemctl status cpolar

状态显示 active (running) 即表示服务正常运行。

常见问题排查清单

❌ 报错:无法连接 Hugging Face

OSError: We couldn't connect to 'https://huggingface.co'

原因:网络不通或尝试在线加载未下载的模型。

解决方案:

- 确保模型已完整下载至本地;

- 使用绝对路径加载;

- 添加 local_files_only=True 强制离线模式:

model = AutoModel.from_pretrained(

"./MiniCPM-Llama3-V-2_5-int4",

trust_remote_code=True,

torch_dtype=torch.float16,

local_files_only=True

)

❌ 报错:typer 版本冲突

spacy 3.7.2 requires typer<0.10.0,>=0.3.0, but you have typer 0.12.3 which is incompatible.

解决方法:降级 typer 至兼容版本:

pip install typer==0.9.0 -i https://pypi.mirrors.ustc.edu.cn/simple

同时建议锁定其他相关依赖:

pip install fastapi==0.70.0

pip install fastapi-cli==0.0.1

❌ 磁盘空间不足

查看磁盘使用情况:

df -h /root/autodl-tmp

清理缓存释放空间:

rm -rf ~/.cache/pip

rm -rf ~/.cache/huggingface

或挂载大容量目录:

ln -s /large_disk/workspace ~/workspace

✅ 成功运行的依赖版本参考

以下是经实测稳定的依赖组合(来自 conda list 截取):

Package Version

------------------------- -----------

Pillow 10.1.0

torch 2.1.2

torchvision 0.16.2

transformers 4.40.0

sentencepiece 0.1.99

accelerate 0.30.1

gradio 3.40.0

typer 0.9.0

fastapi 0.70.0

huggingface-hub 0.23.0

numpy 1.24.4

python 3.9.18

🔍 强烈建议锁定上述版本以保证环境一致性。

部署大模型从来不是一键完成的任务,每一个环节都可能隐藏着意想不到的问题。但从零开始跑通 MiniCPM-Llama3-V-2.5-int4 的那一刻起,你会发现——这种高度集成且经过良好量化的模型架构,正在让先进的多模态能力真正走向普及。无论是智能客服、教育辅助,还是自动化图文生成,这类轻量级 VLM 都展现出巨大的应用潜力。

更重要的是,整个过程教会我们如何科学地管理环境、处理依赖冲突、调试网络问题。这些技能远比单个模型的使用更具长期价值。下次当你面对一个新的开源大模型时,这套方法论依然适用。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)