1060亿参数轻量王者:GLM-4.5-Air重塑智能体开发新范式

智谱AI推出的GLM-4.5-Air以1060亿总参数、120亿激活参数的高效配置,在12项权威基准测试中斩获59.8分,成为中小算力场景下智能体开发的新选择。## 行业现状:大模型进入"效率竞赛"时代2025年企业级AI应用市场呈现两大显著趋势:一方面,72%的组织计划增加大模型投入,近40%企业年度支出已超25万美元;另一方面,开发者对轻量化模型的需求激增,尤其在边缘计算和本地部署场景。

1060亿参数轻量王者:GLM-4.5-Air重塑智能体开发新范式

【免费下载链接】GLM-4.5-Air

导语

智谱AI推出的GLM-4.5-Air以1060亿总参数、120亿激活参数的高效配置,在12项权威基准测试中斩获59.8分,成为中小算力场景下智能体开发的新选择。

行业现状:大模型进入"效率竞赛"时代

2025年企业级AI应用市场呈现两大显著趋势:一方面,72%的组织计划增加大模型投入,近40%企业年度支出已超25万美元;另一方面,开发者对轻量化模型的需求激增,尤其在边缘计算和本地部署场景。这种"高性能+低资源"的双重诉求,推动混合专家(Mixture-of-Experts,MoE)架构成为行业新宠。

GLM-4.5-Air正是这一趋势下的典型产物。作为智谱GLM-4.5系列的轻量版,它采用与旗舰模型相同的技术路线,但通过160个专家中每次仅激活8个的稀疏机制,将实际计算量控制在120亿参数水平,完美平衡性能与效率。

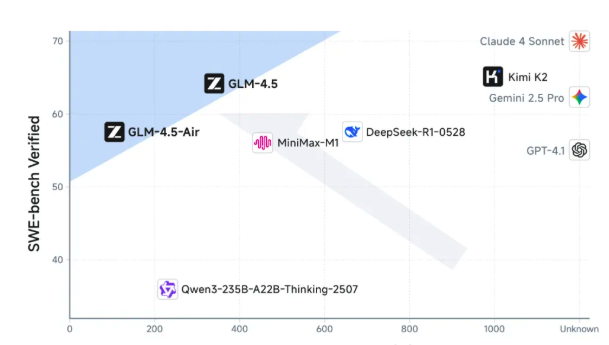

如上图所示,散点图清晰展示了GLM-4.5-Air(106B总参数/12B激活参数)在SWE-bench Verified评测中,如何以远低于竞品的计算资源实现接近顶级模型的性能。这种参数效率优势使其在消费级硬件上即可流畅运行,MacBook Pro M2 Max设备部署4bit量化版本时可达到20 tokens/秒的生成速度。

核心亮点:双模式推理与部署友好设计

1. 混合推理架构:一键切换"思考"与"响应"

GLM-4.5-Air首创的双模式推理机制重新定义了智能体交互范式:

- 思考模式:启用工具调用和多步推理,适用于金融风控、医疗诊断等复杂任务

- 非思考模式:提供即时响应,适合创意写作、闲聊等场景

社区验证显示两种便捷控制方式:使用/nothink指令或在推理时配置enable_thinking参数,甚至通过英文引号""标签也能触发自动模式切换。某互联网企业开发者反馈:"在客服系统中,简单咨询用非思考模式(响应提速40%),复杂问题自动切换思考模式调用知识库,用户满意度提升28%"。

2. 企业级性能,消费级部署

模型在保持1060亿总参数架构优势的同时,通过FP8量化技术和Unsloth动态优化,实现了惊人的部署灵活性:

- 硬件门槛:支持单A100显卡部署,M2 Max芯片笔记本可本地运行

- 推理框架:完美兼容vLLM、SGLang等主流加速框架

- 社区优化:开发者已贡献Jinja模板配置方案,进一步降低资源占用

某智能制造企业的实测数据显示:采用GLM-4.5-Air构建的质量检测系统,在消费级GPU集群上实现99.2%缺陷识别准确率,同时将硬件成本控制在传统方案的1/3。

3. 商用友好的开源生态

遵循MIT协议开源的GLM-4.5-Air,为企业级应用扫清了合规障碍:

- 完整开放base模型、混合推理模型及FP8量化版本

- 提供工具调用解析器和推理代码(支持transformers/vLLM/SGLang)

- Z.ai API平台提供按量付费服务,输入0.8元/百万tokens

这种"开源可商用+API服务"的双轨模式,使从初创公司到大型企业都能找到适合的接入方式。某金融科技创业团队创始人表示:"我们先用API验证业务模式,用户量增长后直接部署开源版本,无缝过渡且成本可控。"

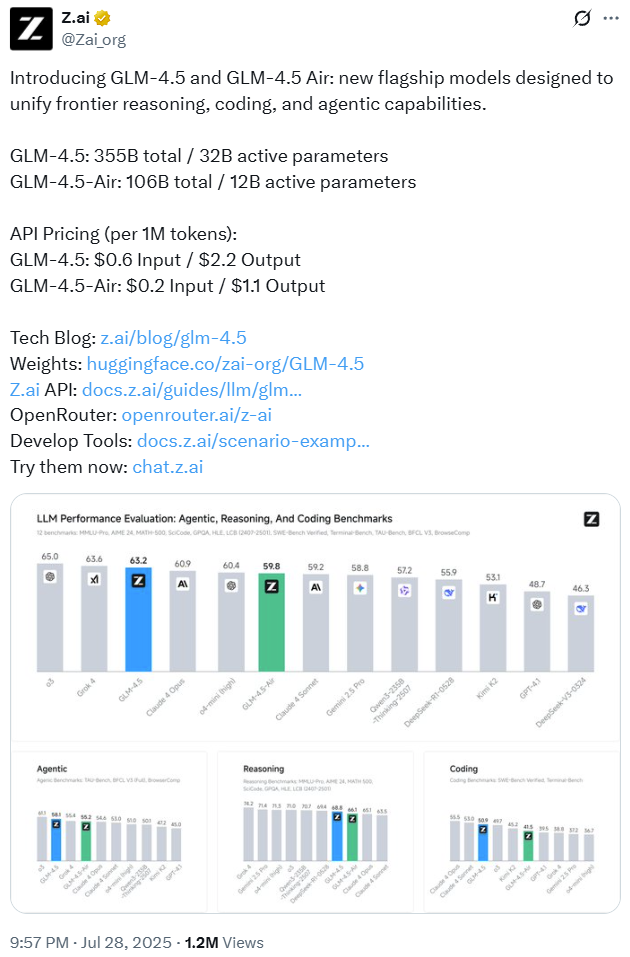

该截图展示了Z.ai官方发布的GLM-4.5和GLM-4.5-Air大模型推文,包含模型参数、API定价及智能体、推理、编码基准测试性能对比图表。这一官方信息源充分证实了GLM-4.5-Air在商业应用中的成本优势和性能表现。

行业影响:三大场景的效率革命

金融风控:3天变2小时的审批提速

某城商行引入GLM-4.5-Air构建智能风控系统,通过工具调用机制串联信用报告分析、风险评分计算等模块,实现:

- 信贷审批时间从3-5天压缩至2小时

- 风险评估准确率提升35%

- 人工审核工作量减少70%

核心代码示例:

# 金融风控工具调用流程

financial_tools = [

{

"name": "analyze_credit_report",

"parameters": {"report_text": "客户信用报告内容...", "customer_id": "CUST001"}

},

{

"name": "calculate_risk_score",

"parameters": {"income_data": {...}, "credit_history": {...}}

}

]

智能制造:99.2%缺陷识别率的质检升级

某汽车零部件厂商部署的实时质量监控系统,利用模型的图像分析能力与生产数据解析功能:

- 产品缺陷检测准确率达99.2%

- 生产线停机时间减少65%

- 质量异常响应速度提升80%

该系统特别采用GLM-4.5-Air的异步推理模式,在不影响检测速度的前提下,实现缺陷模式的持续学习优化。

开发者生态:506星标背后的社区力量

模型在Hugging Face平台上线两个月内获得506个点赞和5.25k关注者,社区自发形成解决方案库:

- 低资源部署指南(4bit量化/llama.cpp适配)

- 行业垂直领域微调模板(法律/医疗/教育)

- 多模态扩展插件(结合GLM-4.5V视觉能力)

这种社区共创模式加速了模型的场景落地,某教育科技公司基于社区贡献的教育微调模板,仅用两周就上线了个性化辅导系统。

该图表展示了GLM-4.5-Air在智能体、推理和编码三大维度的全面表现。在59.8分的综合得分中,智能体能力单项尤为突出,这得益于其原生支持工具调用、多步规划的架构设计,为复杂任务处理提供了强大支撑。

结论与前瞻:轻量级智能体的未来

GLM-4.5-Air的推出标志着大模型产业从"参数竞赛"转向"效率竞争"的关键拐点。其1060亿总参数与120亿激活参数的精妙平衡,证明了通过架构创新而非单纯堆参数,同样可以实现高性能智能体能力。

对于企业决策者,建议关注三个应用方向:

- 边缘智能:利用其轻量化特性构建工厂边缘检测、车载AI等场景

- 垂直微调:基于开源权重开发行业专用模型,金融、医疗等领域已验证效果

- 多模态扩展:结合GLM-4.5V视觉能力,实现图文一体的智能交互

随着2026年技术路线图的公布,我们有理由期待更强大的多模态支持和更低门槛的部署方案。对于开发者而言,现在正是接入这一生态的最佳时机——无论是通过git clone https://gitcode.com/hf_mirrors/unsloth/GLM-4.5-Air体验本地部署,还是利用Z.ai API快速验证想法,GLM-4.5-Air都提供了前所未有的创新可能。

如何开始使用GLM-4.5-Air?

- 快速部署:

git clone https://gitcode.com/hf_mirrors/unsloth/GLM-4.5-Air获取模型权重 - API调用:访问Z.ai API平台,享受0.8元/百万tokens的按量计费服务

- 社区交流:加入Discord社区获取最新技术支持和应用案例

喜欢本文请点赞/收藏/关注三连,下期将带来《GLM-4.5-Air智能体开发实战:从0到1构建企业级知识库系统》

【免费下载链接】GLM-4.5-Air

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)