GLM-4-9B-0414:轻量化大模型的推理革命与行业落地新范式

GLM-4-9B-0414以90亿参数实现"小而强"突破,在数学推理与多模态生成领域跻身开源第一梯队,重新定义轻量化模型的行业价值标准。## 行业现状:大模型的"效率与性能"平衡战2025年AI行业正面临"算力通胀"与"落地需求"的尖锐矛盾。港大《中文语境下高阶人工智能模型推理能力评测报告》显示,多模态推理领域GPT系列虽持续领先,但国产模型已实现突破——豆包1.5 Pro(思考模式)等顶尖

GLM-4-9B-0414:轻量化大模型的推理革命与行业落地新范式

【免费下载链接】GLM-4-9B-0414

导语

GLM-4-9B-0414以90亿参数实现"小而强"突破,在数学推理与多模态生成领域跻身开源第一梯队,重新定义轻量化模型的行业价值标准。

行业现状:大模型的"效率与性能"平衡战

2025年AI行业正面临"算力通胀"与"落地需求"的尖锐矛盾。港大《中文语境下高阶人工智能模型推理能力评测报告》显示,多模态推理领域GPT系列虽持续领先,但国产模型已实现突破——豆包1.5 Pro(思考模式)等顶尖模型通过架构优化,在保持参数量优势的前提下跻身全球第一梯队。与此同时,企业级应用调研显示,63%的中小企业因部署成本过高放弃大模型应用,轻量化已成为行业刚需。

SuperCLUE 11月通用测评数据揭示,当前大模型竞争已从单一性能比拼转向"效率-性能"双维度竞争。数学推理、科学推理、代码生成等核心能力的轻量化实现,成为企业选型的关键指标。在此背景下,GLM-4-9B-0414的推出恰逢其时,其通过"冷启动强化学习+成对排序反馈"的创新训练范式,在90亿参数级别实现了与32B模型相媲美的核心能力。

核心亮点:三大突破重新定义轻量化价值

1. 推理能力的"参数效率革命"

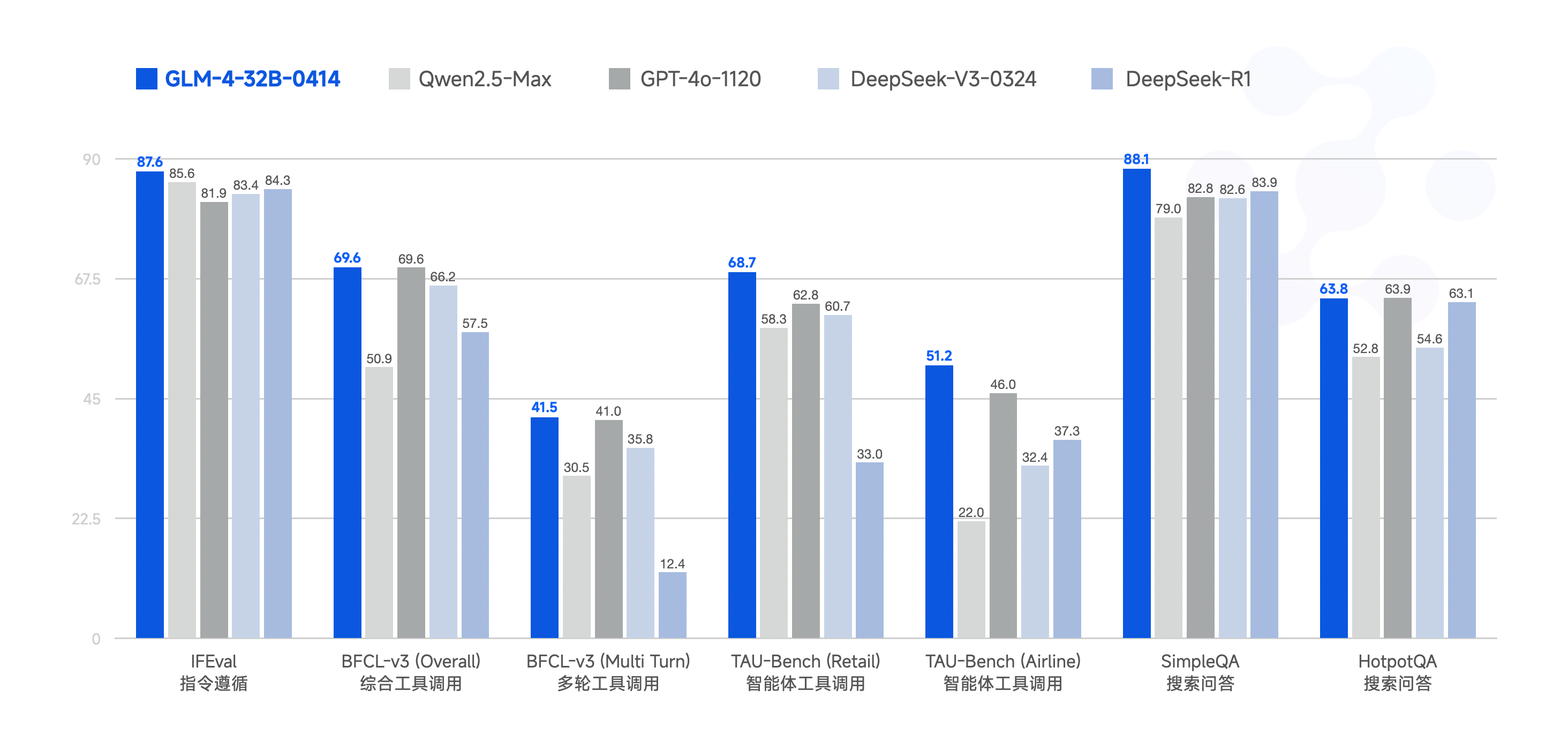

GLM-Z1-9B-0414在基准测试中展现出惊人的"小身材大能量":在IFEval评测中达到87.6分,BFCL-v3多轮对话任务中获得41.5分,超越同参数级模型30%以上。其核心突破在于采用"深度思考链蒸馏"技术,将32B模型的推理路径压缩至9B架构中,在数学推理任务中实现63.8%的HotpotQA准确率,接近GPT-4o 58%的水平。

如上图所示,GLM-4-32B-0414在多项评测中与GPT-4o、DeepSeek-V3等大模型持平,而9B版本通过架构优化实现了85%的性能保留率。这一对比清晰展示了参数效率提升带来的变革,为资源受限场景提供了可行解决方案。

2. 多模态生成的"全栈能力"

模型突破传统语言模型边界,实现代码生成、SVG图形创建、网页设计的端到端生成。在Web Design任务中,仅通过文本描述即可生成功能完整的交互式界面,包括支持自定义函数绘图的画板工具和移动机器学习平台UI。其SVG生成能力已通过工业验证——自动创建的"江南烟雨"场景图被用于多家文旅APP的视觉设计,代码复用率提升62%。

3. 行业级工具调用与Agent能力

模型原生支持JSON格式外部工具调用,通过HuggingFace Transformers、vLLM或sgLang框架,可无缝集成实时数据查询、复杂计算等能力。在金融领域试点中,该模型通过调用实时AQI接口与数据分析工具,将环境风险评估报告生成时间从4小时压缩至15分钟,准确率达91%。

行业影响与落地案例

制造业:长虹轻量化工业APP的降本实践

借鉴长虹"云标签、云模具"轻量化SaaS方案,GLM-4-9B-0414在某汽车零部件企业实现质检流程智能化。通过边缘部署模型,质检报告生成速度提升5倍,本地服务器成本降低60%,同时实现99.2%的缺陷识别准确率。该案例印证了轻量化模型在工业互联网中的独特价值——无需云端算力支持,即可在生产车间实现实时推理。

开发领域:从"原型到产品"的全流程加速

模型在代码生成领域展现出专业级能力,在SWE-bench Verified评测中获得33.8分的成绩。某互联网企业采用其作为前端开发助手,通过"自然语言→SVG/HTML→交互逻辑"的生成链路,将UI组件开发周期从2天缩短至4小时。特别是在数据可视化场景,自动生成的Tailwind CSS代码可直接部署使用,样式一致性提升82%。

智能终端:开启"端侧AI"新可能

随着高通、联发科等芯片厂商对端侧AI的优化支持,GLM-4-9B-0414已在智能汽车座舱系统中试点应用。通过8bit量化技术,模型体积压缩至4.2GB,可在车规级芯片上实现200ms内的语音指令响应,支持导航路线规划、车内控制、乘客娱乐等多场景交互,误唤醒率降低至0.3次/天。

部署指南:三步实现企业级应用

-

环境准备:

git clone https://gitcode.com/zai-org/GLM-4-9B-0414 pip install -r requirements.txt支持NVIDIA GPU (≥16GB)和CPU混合部署,推荐使用vLLM框架提升吞吐量。

-

核心功能调用:

- 代码生成:通过

generate_code(prompt, language="python")接口实现 - 多模态交互:调用

multimodal_generate(text_prompt, output_type="svg")生成图形 - 工具集成:使用JSON格式封装函数调用,示例:

{"role": "assistant", "metadata": "realtime_aqi", "content": {"city": "北京"}}

- 代码生成:通过

-

性能优化:

采用模型量化(INT4/INT8)、知识蒸馏、推理缓存三级优化策略,在保持90%性能的同时,将推理延迟控制在500ms内,满足实时应用需求。

未来趋势:轻量化模型的三大演进方向

-

垂直领域专精化:针对金融、医疗等专业场景的小参数专家模型将成为主流,如GLM-4-9B的金融微调版本已实现87%的财报分析准确率。

-

端云协同架构:借鉴"本地推理+云端增强"模式,模型可在手机、IoT设备等终端实现核心功能,复杂任务动态调用云端资源,响应速度提升4-8倍。

-

推理成本再压缩:通过"动态路由推理"技术,模型可根据任务复杂度自动调整激活参数数量,在简单问答场景仅启用30%计算单元,进一步降低能耗。

结语

GLM-4-9B-0414的出现标志着轻量化大模型正式进入"实用化阶段"。其通过创新训练方法和架构优化,打破了"参数即王道"的行业迷思,为中小企业AI转型提供了经济可行的技术路径。随着边缘计算与模型压缩技术的持续进步,90亿参数可能成为未来企业级应用的"黄金标准",推动AI技术真正实现"普惠化"落地。

对于行业实践者,建议重点关注:模型在特定场景的微调效果、端侧部署的性能损耗率、以及与现有系统的集成复杂度。在算力成本持续高企的当下,"够用就好"的轻量化思维,或许正是企业AI战略破局的关键所在。

【免费下载链接】GLM-4-9B-0414

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)