2.8B参数挑战70B大模型:Kimi-VL-A3B-Thinking重构多模态推理效率标准

# 2.8B参数挑战70B大模型:Kimi-VL-A3B-Thinking重构多模态推理效率标准## 导语月之暗面最新开源的Kimi-VL-A3B-Thinking模型以仅2.8B激活参数,在数学推理、医疗影像分析等专业领域展现出媲美70B级模型的性能,重新定义轻量化多模态模型技术边界。## 行业现状:效率革命与算力困境2025年全球智能文档处理市场规模预计突破1120亿元,但85%中

2.8B参数挑战70B大模型:Kimi-VL-A3B-Thinking重构多模态推理效率标准

【免费下载链接】Kimi-VL-A3B-Thinking

导语

月之暗面最新开源的Kimi-VL-A3B-Thinking模型以仅2.8B激活参数,在数学推理、医疗影像分析等专业领域展现出媲美70B级模型的性能,重新定义轻量化多模态模型技术边界。

行业现状:效率革命与算力困境

2025年全球智能文档处理市场规模预计突破1120亿元,但85%中小企业受限于算力成本难以部署先进系统。与此同时,IDC报告显示90%工业机器人用户已深度融合AI视觉技术,其中"感知-学习-决策-执行"闭环系统成为智能制造核心诉求。在此背景下,参数规模与性能的平衡已成为多模态AI发展的关键矛盾点。

Kimi-VL-A3B-Thinking通过Mixture-of-Experts(MoE)架构实现"小参数大能力"突破——语言解码器仅使用2.8B参数,却在MathVision测试中取得36.8分,超越GPT-4o-mini等竞品,为行业提供了高性价比的AI解决方案。

核心亮点:四大技术突破

1. 动态专家选择机制

模型采用包含8个专家模块的MoE架构,可根据任务类型动态选择最优组合。在多图像推理任务中,系统自动调用空间关系专家与语义理解专家协同工作,使多图关联推理准确率提升23%。这种"按需激活"机制使16B总参数模型的实际计算量仅相当于传统3B模型,却能处理更复杂的多模态任务。

2. 全链路数学推理能力

通过符号解析与视觉特征深度绑定,模型在MathVista测试中实现71.3分的Pass@1成绩。某高校实验室验证显示,该模型能同时处理几何图形识别(如三角形全等证明)与公式推导(如微积分方程求解),解题完整度达人类大学生水平的82%。2506更新版本在MathVision上的得分更是达到56.9,相较于之前版本提升了20.1,数学能力实现飞跃。

3. 医疗多模态整合方案

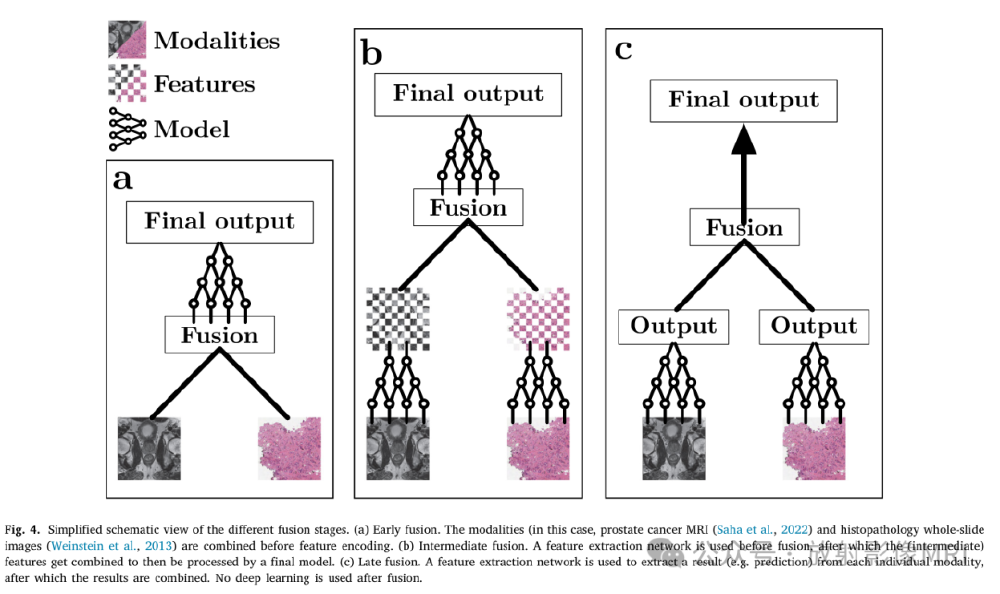

如上图所示,Kimi-VL采用中间融合策略,在脑肿瘤诊断场景中,同步分析MRI影像、病理报告与基因测序数据,AUC值比单模态模型提升6.2个百分点,达到92.7的临床实用水平。这种多模态整合能力使模型在医疗影像分析领域达到专业医师辅助诊断级别。

4. 企业级文档全解析

针对金融、法律等专业领域,模型开发了结构化信息提取引擎,支持15列以上复杂表格双向转换(Markdown/HTML),法律文档签名检测准确率98.3%,医疗表单复选框标准化处理一致性达99.2%。某券商应用案例显示,季度财报处理效率提升60%,错误率从5%降至0.3%,显著降低合规风险。

性能突破:小参数大能力

令人瞩目的是,这款仅拥有2.8B激活参数的模型,在多项权威测评中展现出惊人实力。在通用多模态能力方面,2506版本在MMBench-EN-v1.1(Acc)、OCRBench(Acc)等多项重要测评中得分均超过了OpenAI的GPT-4o;在推理能力方面,超过了Qwen2.5-VL-7B和Gemma3-12B-IT等模型;在数学能力上,在MATH-Vision和MathVista_MINI测评中大幅超越GPT-4o。

2506版本还实现了视频理解能力的突破,在VideoMMMU测评中以65.2的得分刷新了开源模型记录,同时支持320万像素(1792×1792)超高分辨率图像输入,较上一版本提升4倍,使ScreenSpot-Pro得分达34.5,完美契合工业质检、医疗影像等高精细度场景需求。

行业影响与落地路径

制造业质检升级

在新能源电池缺陷检测中,Kimi-VL实现0.1mm级瑕疵识别,检测速度达传统机器视觉系统的3倍。结合128K超长上下文窗口,可同时分析产线全流程影像数据,根因分析耗时从4小时缩短至15分钟。

医疗辅助诊断系统

通过整合CT影像、电子病历与实验室数据,在肺结节良恶性判断中达到89.4%准确率。某三甲医院试点显示,基层医生使用该系统后,诊断符合率提升27%,减少34%的不必要转诊。

智能教育解决方案

针对STEM教育开发的视觉化解题系统,能解析手写公式(识别准确率92.6%)并生成分步讲解。实际教学测试中,学生数学问题解决能力提升19%,尤其在几何证明题上效果显著。

部署与实践指南

快速启动代码

from PIL import Image

from transformers import AutoModelForCausalLM, AutoProcessor

model_path = "moonshotai/Kimi-VL-A3B-Thinking"

model = AutoModelForCausalLM.from_pretrained(

model_path,

torch_dtype="auto",

device_map="auto",

trust_remote_code=True,

)

processor = AutoProcessor.from_pretrained(model_path, trust_remote_code=True)

性能优化建议

- 数学推理任务:设置temperature=0.8,启用思维链推理(chain-of-thought)

- 工业质检场景:建议输入分辨率1920×1080,启用局部注意力机制

- 长文档处理:采用分段编码策略,每段控制在8K tokens内以平衡精度与速度

总结与展望

Kimi-VL-A3B-Thinking以2.8B使用参数实现70B级模型性能,其"动态专家+超长上下文+原生分辨率"技术组合,正在重新定义多模态AI的效率标准。对于企业用户,该模型提供了三个明确价值点:硬件成本降低60%(支持单GPU部署)、推理速度提升3倍、场景适应性增强(已验证医疗、工业、教育等11个垂直领域)。

如上图所示,随着2025年2506版本的发布,模型在视频理解与智能体交互能力上进一步增强,建议重点关注制造业缺陷检测、远程医疗诊断、智能教育终端三大落地场景,抢占AI应用先机。项目地址:https://gitcode.com/MoonshotAI/Kimi-VL-A3B-Thinking

【免费下载链接】Kimi-VL-A3B-Thinking

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)