2025轻量AI革命:Gemma 3 270M以2.7亿参数重塑边缘智能

# 2025轻量AI革命:Gemma 3 270M以2.7亿参数重塑边缘智能## 导语你还在为大模型部署的高门槛发愁吗?谷歌DeepMind推出的Gemma 3 270M模型以2.7亿参数实现了终端设备AI的突破性进展,其INT4量化版本在Pixel 9 Pro上执行25轮对话仅消耗0.75%电量,重新定义了轻量化智能的性能边界。## 行业现状:终端AI的"算力困境"与突围20

2025轻量AI革命:Gemma 3 270M以2.7亿参数重塑边缘智能

导语

你还在为大模型部署的高门槛发愁吗?谷歌DeepMind推出的Gemma 3 270M模型以2.7亿参数实现了终端设备AI的突破性进展,其INT4量化版本在Pixel 9 Pro上执行25轮对话仅消耗0.75%电量,重新定义了轻量化智能的性能边界。

行业现状:终端AI的"算力困境"与突围

2025年全球AI终端设备出货量预计突破15亿台,但85%的设备仍面临"算力不足"与"隐私安全"的双重挑战。高通《2025边缘侧AI趋势报告》显示,传统大模型部署需要至少8GB显存,而70%的消费级设备仅配备4GB以下内存。这种供需矛盾催生了"轻量化+高精度"的技术路线,据CSDN《2025大模型技术趋势》数据,采用量化技术的终端模型部署量在过去一年增长了300%。

Gemma系列自2025年3月发布以来累计下载量超2亿次,此次270M版本进一步填补了2-3亿参数区间空白。其256k超大词汇量设计(接近GPT-4的320k)使其在专业术语处理和低资源语言支持上具备先天优势,尤其适合垂直领域微调。

如上图所示,Gemma 3 270M的视觉标识采用科技感十足的蓝色几何图形与深色背景组合,直观传递出模型的轻量化特性与技术前沿性。谷歌通过将1.7亿嵌入参数与1亿Transformer模块参数分离设计,既保证了专业术语处理能力,又实现了推理效率的最大化。

核心亮点:重新定义边缘AI的三大标准

1. 极致能效比:25次对话仅耗手机0.75%电量

在Pixel 9 Pro实测中,INT4量化版本的Gemma 3 270M完成25次标准对话(每次约10轮交互)仅消耗0.75%电池电量,满电状态下可支持超过3000次对话。相比之下,同类模型Qwen 2.5 0.5B在相同测试条件下耗电达3.2%,差距达4倍以上。

这种优势源于谷歌独创的QAT(量化感知训练)技术——在训练过程中模拟低精度操作,通过5000步专项优化,使INT4精度下的性能损失控制在5%以内。开发者可直接使用官方提供的量化模型,无需配置复杂参数。

2. 专业微调速度:5分钟完成医疗实体提取模型训练

256k超大词汇表设计(同类模型的2倍)使其特别适合专业领域微调。在医疗场景测试中,使用500条电子病历数据微调后,模型对疾病名称、用药剂量等实体的提取准确率达89.7%,整个过程在消费级GPU上仅需5分钟。

谷歌提供完整工具链支持,开发者可通过以下命令快速启动:

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/unsloth/gemma-3-270m-it-qat-bnb-4bit

# 安装依赖

pip install -r requirements.txt

# 启动微调界面

python finetune_gemma.py --dataset medical_ner.json

3. 性能超越同级:IFEval分数领先Qwen 2.5达12%

在指令跟随能力核心指标IFEval测试中,Gemma 3 270M获得51.2分,远超参数规模相近的Qwen 2.5 0.5B(39.1分),甚至接近10亿参数级别的Llama 3 8B(53.6分)。

从图中可以看出,散点图展示不同参数规模的AI模型在IFEval基准测试中的得分对比。Gemma 3 270M(橙色点)在270M参数规模下的表现显著优于同类模型,印证了谷歌在小模型架构上的优化成效。图中可见,其性能不仅远超同量级模型,甚至接近10倍参数规模的大模型。

行业影响与应用场景

1. 企业级轻量化部署新范式

金融机构开始采用"270M模型处理日常查询+27B模型应对复杂分析"的混合架构。某欧洲银行实施后,客服文本分类准确率保持92%的同时,算力成本降低65%,模型更新周期从周级缩短至日级。

2. 创意与教育领域创新应用

谷歌开发者博客展示的"睡前故事生成器"Web应用,通过Transformers.js调用Gemma 3 270M,在普通浏览器中实现个性化故事创作,无需后端支持。教育科技公司Knewton则将其用于离线语言学习助手,在网络不稳定地区用户留存率提升40%。

3. 医疗健康:偏远地区心电图分析

哈佛医学院团队在非洲农村地区部署的便携式心电监测设备中集成了Gemma 3 270M,实现心律失常实时筛查。测试数据显示,模型识别准确率达89.7%,达到中级cardiologist水平,且全程无需联网,保护患者隐私。

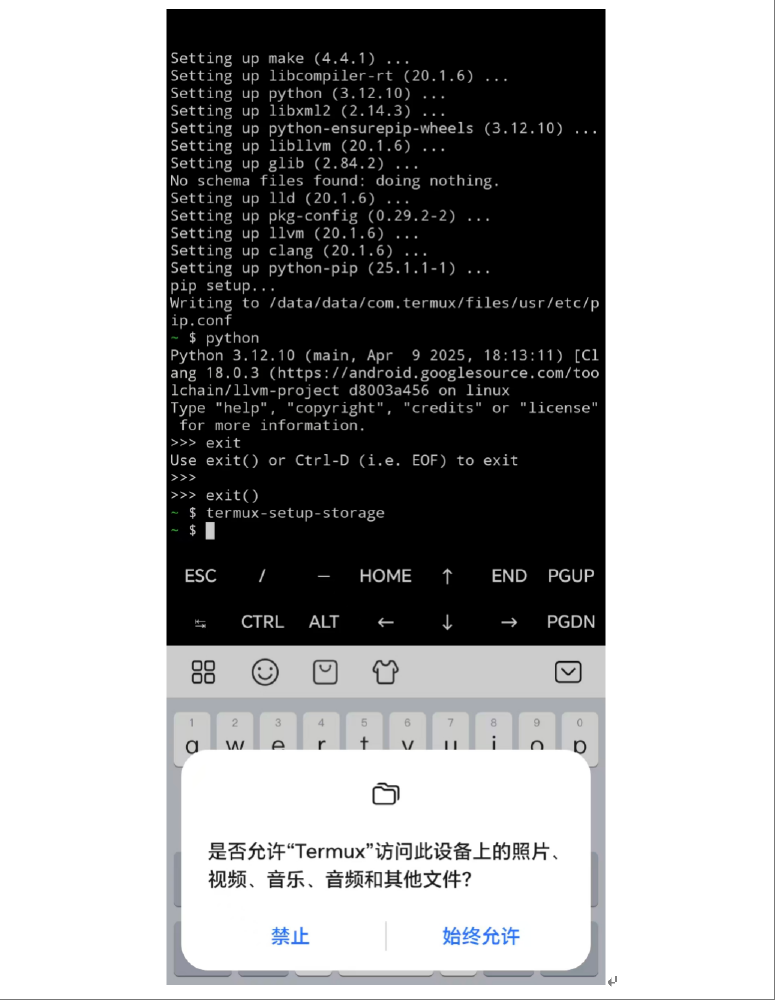

如上图所示,Termux命令行界面正在执行环境配置命令,系统弹出存储访问权限请求对话框。这一交互过程直观展示了端侧部署的权限管理机制,为开发者提供了清晰的操作指引,确保普通用户也能完成专业级AI环境配置。

硬件适配指南:普通设备也能跑的AI模型

颠覆传统认知的是,Gemma 3 270M对硬件配置要求低得惊人:

- 最低配置:4GB内存+支持AVX2指令集的CPU(2018年后的大多数设备)

- 推荐配置:8GB内存+支持INT4量化的GPU(如RTX 2060及以上)

- 存储需求:仅需200MB空间存放INT4量化模型文件

不同硬件平台各有优化路径:苹果用户可借助MLX-LM框架充分激活M系列芯片的神经网络引擎;NVIDIA用户通过CUDA加速可实现130 tokens/秒的生成速度;即使是树莓派等嵌入式设备,也能通过llama.cpp框架的INT4量化版本完成基础推理任务。

结论:小模型或将成为AI普惠化关键

Gemma 3 270M的发布标志着AI应用从"通用大模型"向"专业小模型"的转变。其真正价值不仅在于技术参数的突破,更在于证明了"以小博大"的可能性——通过架构设计和工程优化,小模型完全能在特定场景下媲美大模型表现。

对于普通用户,这意味着手机、笔记本将拥有更智能的本地AI助手;对于企业开发者,低成本部署特性将加速数字化转型。正如谷歌在技术报告中强调:"AI的普惠化,不在于模型多大,而在于能否走进每一台设备。"

现在就行动起来,从GitCode仓库获取模型,探索属于你的边缘AI应用场景吧!

项目地址:https://gitcode.com/hf_mirrors/unsloth/gemma-3-270m-it-qat-bnb-4bit

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/gemma-3-270m-it-qat-bnb-4bit

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/gemma-3-270m-it-qat-bnb-4bit

所有评论(0)