【深度雄文】别再只把大模型当聊天工具!它驱动未来的“新电力”,将引爆新一轮工业革命!

大模型是AI技术发展史上的一个质变节点。它通过 “数据 + 算力 + 参数” 的规模效应,首次实现了人工智能从感知智能(“看”和“听”)向初级认知智能(推理、规划、创作)的跨越,是连接数据、技术与应用的核心桥梁。

大模型是AI技术发展史上的一个质变节点。它通过 “数据 + 算力 + 参数” 的规模效应,首次实现了人工智能从感知智能(“看”和“听”)向初级认知智能(推理、规划、创作)的跨越,是连接数据、技术与应用的核心桥梁。

大模型作为通用智能底座,正逐渐成为新一代的人工智能基础设施,将如同水电一样,无处不在,持续为全社会供应“智力”,通过赋能万物成为智能体,驱动各行各业发生范式变革,最终推动人类社会从“个体智能”时代跃迁至“群体智能”时代。

01 / 大模型的诞生与发展

大模型正式诞生于2018年,标志性事件是GPT-1和BERT的相继发布,它们共同确立了大模型的技术范式和标准。2020年的GPT-3和2022年的ChatGPT则分别代表了大模型的规模突破和应用爆发,是这一技术发展道路上的重要里程碑。

2017年6月,Google发表《Attention is All You Need》论文,提出Transformer架构,通过引入自注意力机制,突破了传统架构的并行计算瓶颈与长距离依赖关系捕捉难题, 它不仅在当时显著提升了机器翻译的性能,更重要的是,其卓越的可扩展性和通用性为之后的大模型革命奠定了坚实的技术基础,被视为大模型的真正起点。

几乎所有现代的大模型,如GPT 系列、LLaMA 系列、文心一言、Qwen(千问)、DeepSeek、Sora、Midjourney等,都建立在Transformer架构之上。

2018年是大模型元年,以下两个里程碑事件标志着大模型时代的正式开启:

2018年6月,OpenAI发布GPT-1,这是首个将Transformer与无监督预训练结合的大语言模型(Large Language Model,简称LLM),参数规模达1.17亿,远超传统自然语言处理模型(如循环神经网络RNN),首次证明了“预训练 + 微调”范式的有效性,开创了生成式AI的先河。

2018年10月,Google发布BERT,这是首个基于Transformer的双向预训练模型,大幅提升了模型的语义理解精度,在多项自然语言处理任务上刷新世界纪录,参数规模达3.4亿,奠定了理解式AI的基础。

GPT-1与BERT二者的核心价值在于:首次完整确立了大模型的技术闭环—— “Transformer架构 + 预训练 + 微调”。后续所有大模型(包括千亿级、万亿级参数模型)的发展,本质都是在这一范式上的迭代升级(参数扩容、多模态融合、基于人类反馈的强化学习(RLHF)优化等)。

2020年5月,OpenAI发布GPT-3,参数规模达1750亿,首次展现出“小样本学习”和“零样本学习”能力(无需更新模型参数,仅通过少量示例或自然语言指令即可完成新任务的能力),打破了传统 AI“单任务专用、需重构微调”的局限, 被广泛认为是现代大模型的标杆,标志着AI从“专用智能”向“通用智能”发展过程中的重大跃迁。

2022年11月,OpenAI基于GPT-3.5推出 ChatGPT,以惊艳的自然对话能力引爆全球,2个月内突破1亿用户,引发全球大模型竞赛,这一事件被普遍视为“大模型出圈元年”和产业应用的分水岭。

2023年3月,OpenAI发布 GPT-4,能够同时理解和处理文本、图像等多种信息,推动大模型能力向通用人工智能迈进。此后,文生视频、文生音频等模型(如Sora)不断突破AI创作边界。

2025年1月,中国人工智能企业深度求索(DeepSeek)发布DeepSeek-R1,以“物美、价廉、开源”硬刚OpenAI,打破了大模型依赖大规模算力和巨额资本投入的模式,大大推进了AI的应用普及,AI普惠加速到来。

此后,大模型应用从通用领域向细分领域加速渗透,在互联网、工业、金融、政务、教育、医疗等垂直领域得到广泛应用。

简单说,2018年大模型“出生”,2020年“长大成人”,2022年“走向世界”,2023年成为“闯荡江湖的多面手”,2024 年至今是“深耕专业的实干家”。

02 / 什么是大模型?

大模型(Large Model,也称基础模型,Foundation Model)本质上是一个使用海量数据训练而成的深度神经网络模型(关于“深度神经网络模型”参见[深度学习:AI江湖的“逍遥派”(二)),因其庞大的训练数据和参数规模,实现了智能的涌现,展现出类似人类的智能,具备跨场景理解、生成、逻辑推理等高阶能力。

与传统AI相比,大模型的“大”体现在五个方面:

1、数据规模与维度“大”—— 认知视野的全面覆盖

大模型的 “大” 离不开海量数据的喂养,数据的 “大” 体现在两个层面:

规模大:训练数据量普遍达到万亿级别的Token(是大模型用来理解和生成人类语言的最小语义基本单位)量。覆盖互联网文本、书籍、科研论文、行业数据等,相当于让模型读完人类已有的大部分公开知识。

维度广:数据跨语言、跨领域、跨模态,既包含自然语言、数学逻辑,也涵盖医疗、法律、代码、工程等专业领域,还融合文本、图像、视频等多类信息,使其摆脱传统AI模型“单一数据来源”的局限,成为 “通才”。

2、算力需求“大”—— 计算动力的指数级跃升

这是大模型 “大” 的关键保障,也是参数规模与数据价值落地的核心前提。

算力就像大模型的“超级心脏”,没有它,万亿级数据只是仓库里的藏书,千亿级参数只是沉睡的数字。

传统机器学习模型的计算量相对较小,在普通CPU上即可完成训练,训练时间从几分钟到几小时不等。

大模型的计算量则达到天文数字级别。以GPT-4为例,其训练过程需要约2.15×10²⁵ FLOPs(浮点运算次数),这个数字是传统机器学习模型计算量的数十亿倍,使用了约25,000张NVIDIA A100 GPU,训练了90-100天。2024年,OpenAI在算力资源上支出了70亿美元。

这种算力需求差异也解释了为什么只有少数具备强大技术实力和资金实力的公司能够承担起大模型的训练任务。

3、参数规模“大”——神经元容量的量级突破

这是大模型 “大” 的最直观体现,也是所有能力的前提。参数规模如同模型的 “神经元容量”,百亿级以上的规模使其能存储海量知识、处理复杂逻辑,是通用能力的前提。

传统AI模型的参数量通常处于数千到数千万级别。而大模型的“大脑神经元”(参数)数量普遍超千亿,顶尖模型达万亿级别。例如GPT-4的参数量约为1.8万亿,是传统机器学习模型参数的数十万倍甚至数百万倍。

4、能力边界“大”—— 涌现能力的广度与深度

这是大模型 “大” 的根本价值,即能力从“专用”到“通用” 的跃迁。

广度上:打破传统 AI “一个模型解决一个任务” 的边界,可同时适配对话、翻译、代码生成、医疗诊断、创意写作、逻辑推理等数百种场景,无需重构模型架构。具备强大的泛化能力,同一模型只需少量数据微调或无需调整,就能适应多种不同场景的任务,做到“举一反三”。

深度上:具备“涌现能力”,当参数与数据达到一定的临界规模后,模型会自发地形成未被显式训练的、更复杂的新能力(如多跳推理、因果分析、跨模态交互、创意生成),能处理传统 AI 无法应对的“无固定答案”的复杂问题(如 “设计一套大模型落地的产业方案”“分析某事件的深层因果”)。彻底打破传统 AI “训练什么只会什么” 的能力局限。

5、赋能范围“大”——全场景的智能引擎

大模型的 “大” 最终体现在其赋能的辐射力:

跨产业覆盖:作为底层“智能操作系统”,赋能制造业、医疗、金融、教育、交通等全产业链,而非局限于某一细分领域。

跨技术协同:支撑智能体、群体智能、具身智能等前沿技术的落地。单个大模型可作为多个智能体的 “认知/决策核心”,多个大模型可协同形成“群体智能网络”,其赋能的是整个智能生态,而非单一应用。

跨场景渗透:从To B、To G 的组织级解决方案(如智能客服、数字人服务),到 To C 的消费级应用(如聊天机器人、内容创作工具),再到科研级创新(如药物研发、天体物理分析),渗透到社会生产生活的方方面面。

大模型的核心特征是:

规模庞大(参数量大、训练数据量大、算力需求大)、能力强大、智能涌现 和 通用属性。

具备“涌现能力”的机器学习模型就被认为是独立意义上的大模型,这也是其和传统AI模型最大的区别。

03 / 大模型家族

最初,大模型主要指大语言模型,随着技术的发展,现已形成了一个庞大且多样的“智能家族”。

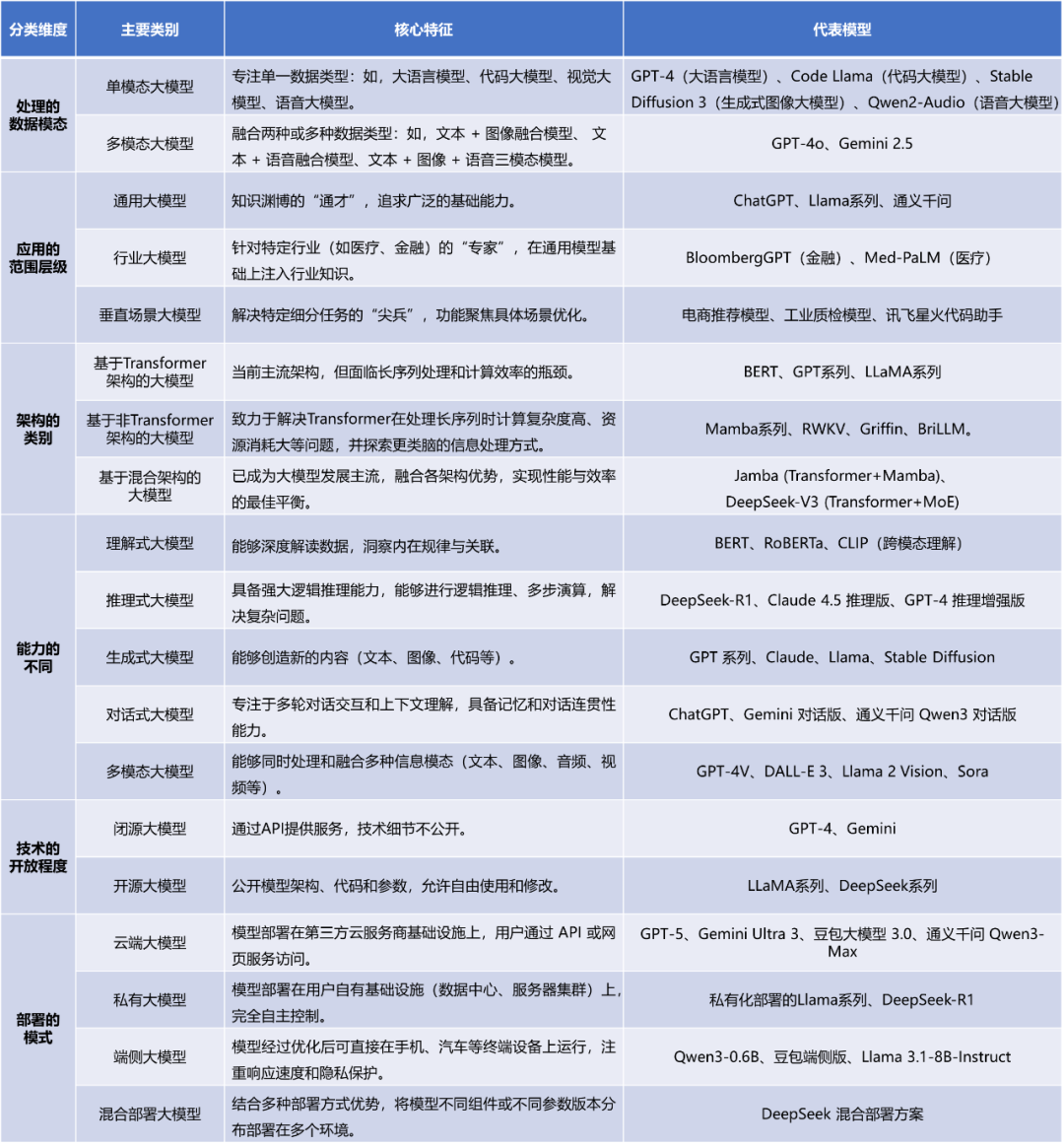

Δ 现有大模型分类

大模型家族的演进呈现出几条清晰的主线:

在技术层面,焦点已从单纯扩大参数规模转向提升多模态融合能力、复杂推理水平及实际任务解决效能,模型架构呈现多元化创新格局。

在应用层面,正从通用大模型“万金油”式的尝试,逐步深化为与行业知识深度融合的垂直领域大模型(如医疗诊断、智能制造、政务服务),并通过AI智能体(AI Agent)技术,将大模型的“思考能力”升级为“行动能力”,实现了从“被动对话”到“主动实干”的跃升。

在生态层面,开源与闭源模型共生共促,推动技术普惠,同时算力架构向“云-边-端”协同及低成本、高效率方向演进,共同支撑大模型在千行百业中规模化落地,赋能产业升级。

未来的大模型,会在持续进化中“打怪升级”:

既要 “减肥瘦身” 实现轻量化,像口袋里的“智能伙伴”触手可及、随取随用;又要“深耕细作”走向专业化,在各个赛道成为懂行的 “领域专家”;更要 “点亮智慧” 迈向高阶智能,不仅能听懂需求,更能主动拆解问题、联动物理世界。

最终,它会褪去 “重资产技术” 的高冷标签,变得更高效、更亲民、更实用,成为数智经济运转中不可或缺的基础设施,渗透到我们生产和生活的每一个角落。

那么,如何系统的去学习大模型LLM?

作为一名深耕行业的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)