10倍算力能在几周内用完!OpenAI首席研究员爆料:内部有300个项目;Meta挖过一半下属,为了抢人,扎克伯格亲自送汤!

主持人:你还有哪些小而脆弱的想法,可能会成为未来突破的核心?Mark:我有几个小想法,但不能透露太多。我主要关注预训练,少量涉及强化学习,还有一些关于如何整合的方法。主持人:目前大家对你们理解上有什么误区吗?Mark:最重要的是,OpenAI是一个研究为中心的公司,核心目标是打造AGI,没有干扰。产品开发只是从这个目标自然流出的结果。我们希望加速AI研究、自动化科学发现,并实现经济有用的工作。过去

首席研究员Mark Chen透露,Garlic 击败了 OpenAI 此前最优秀且规模更大的 GPT-4.5 预训练模型,未来可能以 GPT-5.2 或 GPT-5.5 形式发布。

最近Open AI的大事不断。

先是山姆·奥特曼正式宣布公司进入 “红色警报”(Code Red)状态,面对Google等竞争对手的步步紧逼,OpenAI决定下周直接发布全新的推理模型,代号“Garlic”(大蒜)。

首席研究员Mark Chen透露,Garlic 击败了 OpenAI 此前最优秀且规模更大的 GPT-4.5 预训练模型,未来可能以 GPT-5.2 或 GPT-5.5 形式发布。

与此同时,在最新采访中,Mark Chen还爆料了Meta和OpenAI之间疯狂的AI人才大战!

“Meta 找了我一半的直属下属,但他们都拒绝了。”

“Meta 每年有 100 亿美元的资本投入人才。”

“扎克伯格手工烹饪并亲自送汤给他试图从 OpenAI 招聘的人。”

Mark坦诚地表示:我也给我们试图从 Meta 招的人送过汤。我们甚至开玩笑说要搞一场“汤的军备竞赛”。

X上有很多网友对此喜闻乐见:应该让创始人们都习惯这种现象!

当然,Mark Chen也谈论了OpenAI在预训练上的发现以及他们如何应对Gemini 3的冲击,这可能与下周即将发布的Garlic有关:

- OpenAI核心研究团队规模大概500人,公司内大概有300个项目。大家为了拿到 GPU 会想出各种“幕后交易”的方式。

- Gemini 3发布后每个人都会用自己的方式去试探新模型,Mark有个“42问题”的puzzle,到现在没有任何一个模型真正解开过。

- OpenAI内部已经有性能达到 Gemini 3 水平的模型,而且很快会发布,之后还有更强的后续版本。Mark表示OpenAI本质上仍然是一家纯AI研究公司。过去半年,Mark和Jacub投入了很多时间在模型的预训练上,有信心和Gemini 3正面对决。认为预训练还有很大潜力,完全不同意“Scaling已经死了”的说法。

- Mark、Scott(Scott Gray,一位GPU极客) 以及其他几个人经常一起打扑克,他认为扑克本质上是概率与期望值的博弈,这点和语言模型也类似。Mark透露了在OpenAI“内斗风波”中,自己和Nick(Nick Turley,ChatGPT产品负责人)、Barrett(Barret Zoph,OpenAI前研究副总裁)是如何奔走联系100多名员工签署了请愿信。AI 实习生即将改变科研。预计一年内,AI将负责实现和调试,让研究人员专注于宏大理念。这不是未来,是明年。

- 对”你们真的需要那么多算力吗“这个问题感到很震惊,Mark:如果今天给我3倍的算力,可以立即高效利用;如果是10倍,几周内也能全部用满。

小编整理了整期对话的实录,信息量巨大,大家enjoy!

疯狂的AI抢人大战

主持人: 关于招聘大战,这段时间引起了很多关注,看起来 Meta 的动作相当激进。现在这场“以牙还牙”的较量进展到什么阶段了?

Mark: 是这样,顶尖人才的池子就那么大,所有人都知道那群人是谁。而且很多公司都意识到,打造一个顶尖 AI 实验室的关键因素之一(不是唯一,但很重要)就是招到最优秀的人才。所以,Meta 采取激进策略一点也不意外。但我想从 OpenAI 的视角讲一下这件事。媒体一直在说“人才单向流向 Meta”,但在我观察里,情况完全不是这样。比如我自己的直属团队,在他们成功从 OpenAI 挖到第一个人之前,Meta 已经去撬了我一半的直属下属——但全都拒绝了。

当然,如果你每年有 100 亿美元可以砸在招人上,那肯定能挖到一些。但我觉得我们保护顶尖人才的能力其实非常不错。而且,看着这件事不断升级,其实也挺有意思的。

比如,有一个故事很有意思:扎克伯格真的亲自给我们的人送过手工熬的汤,就为了招人——是他亲自做的汤。当时我非常震惊,但随着时间推移,我也更新了认知:这种方式在某些情况下是有效的。

后来呢……我也给我们试图从 Meta 招的人送过汤。(笑)我们甚至开玩笑说要搞一场“汤的军备竞赛”。我甚至想,下次团队外出团建要不要带他们去上一堂厨艺课。

主持人:那你亲自做汤吗?

Mark: 不,最好是找米其林的汤。(笑)Dejo(旧金山一家餐厅)做得很好,比我做的好得多。

但确实,在这过程中我学到了一件事:要怎么更激进地去争夺顶尖人才。而最让我受鼓舞的是,即使是那些最终去了 Meta 的人,我从没听任何一个说“AGI 会先在 Meta 出来”。大家都非常相信 OpenAI 的研究路线。我们内部也非常明确:不会跟 Meta 做“美元对美元”的对抗。Meta 开出的薪水倍数那么高,但我们的核心骨干仍然愿意留下,这让我非常有信心,大家是真心相信我们的长期价值和研发方向。

主持人: 为什么最后变成汤?

Mark: 不知道,汤、花、各种礼物,都有人送过。人生就是一场冒险嘛,我也乐于跟着 meme 走。

主持人: 在这样的招聘博弈里,你会用到扑克策略吗?

Mark: 核心还是我刚说的:媒体喜欢把这说成“谁输谁赢”,但真正要做的不是留下每一个人,而是识别我们必须留住的关键人物,并确保这些人留下。在这点上,我们做得非常好。

OpenAI 如何分配算力

主持人: 你的角色我理解是:Sam 管研究方向的最高决策;你和 Jakub 一起制定 OpenAI 的研究路线;然后你还要决定算力怎么分配。所以你既定方向,又负责执行。这听起来像一个非常难的工作,因为所有人都在拼命想从你那拿到 GPU。

Mark: 这是真的,大家为了拿到 GPU 会想出各种“后门交易”的方式。但确实,算力分配是我的主要工作之一。同样重要的是,每 1~2 个月,Jakub 和我会做一次内部“研究盘点”。

我们会把全公司约 300 个研究项目列在一个巨大的表格里,一个个深入理解,然后排序。对于一家 500 人的研究团队,公司必须明确核心优先级,既要口头讲清楚,也要通过算力分配表现出来。

主持人: 那 300 个项目里,有巨大模型的训练,也有各种小实验,你们怎么可能全部跟得上,然后决定哪个值得算力?

Mark: 核心是要保持对主要路线图的聚焦。这点是 OpenAI 与其他大实验室非常不同的地方:OpenAI 一直把“探索性研究”放在最中心的位置,不做跟风研究、不做补课研究。

我们不会因为别人做了 X,我们就去复现那个结果。那不是我们擅长的。我们总是在试图找到下一个范式(next paradigm),并愿意投入资源把它找出来。

很多人可能会惊讶,我们在探索上的算力消耗比训练最终成品模型还多。

主持人: 但每个项目负责人都会说自己的项目最重要啊,你怎么不被说服?

Mark: 这是这份工作最难的部分,要告诉一些项目:“现在不能给你资源。”但这也是领导者必须做的:明确哪些是核心优先级,哪些是辅助项目。

如何应对Gemini 3的冲击

主持人:你们总说不对竞争对手反应,比如最近 Gemini 3 发布后大家都在比 benchmark。但你们怎么做到不被影响?

Mark:今天的 AI 研究比以往竞争都激烈,但如果你陷入那种“为了领先 2 周就发一个小更新”的节奏,那是不可持续的。

真正重要的是:找到下一个范式。

几年前我们押注“RO(推理能力)”,当时所有人都说没必要,因为预训练和后训练都挺好。但现在大家会告诉你,“思考能力”已经是语言模型的基础能力。这种长期大赌注,才是能改变方向的东西。我们在找的是能让模型在未来几代中扩展到指数级算力的算法。

主持人: 你们从一家纯研究机构变成一家有产品、有商业压力的公司,怎样保持初心?

Mark: 我们虽然有产品线,但本质仍然是一家纯粹的 AI 研究公司。我们从非营利时代延续下来的灵魂,“全力推进 AGI 研究”一直没变。

如果你赢下研究,价值创造其实是非常容易的。真正的陷阱是只盯着短期商业价值。

主持人: Elon 以前说,哪里有什么“研究”,都是工程。

Mark: 某种程度上他是对的。如果你把“研究科学家”放在工程师之上,你就输了。

构建大模型需要大量工程:加速 kernel、解决数值问题、优化训练效率……如果没有强大的工程底层,你连现在规模的模型都训练不了。

而且“研究员”的类型非常多,有些人是“疯狂点子机器”,有些是极度稳健执行者,所以不能把研究者刻板化。

主持人:Gemini 3 刚推出,我确实挺好奇:当竞争对手发布新模型时,你本人或你们团队内部会发生什么?大家会不会立刻去测试它?有没有什么你经常用来“试探”新模型的题目或提示词?

Mark:会的会的。以 Gemini 3 为例,它确实是个不错的模型。我们内部会做的一件事,是尽量在评估上达成共识。

虽然 benchmark 能说明的东西有限,但就 benchmark 来看,我们其实挺自信:我们内部已经有性能达到 Gemini 3 水平的模型,而且很快会发布,之后还有更强的后续版本。

不过再说一次,benchmark 的信息有限,每个人都会用自己的方式试探这些新模型。

我个人有一道很喜欢给模型出的数学题,到现在没有任何一个模型真正解开过,就连那些强调“思考能力”的模型也没完全解出来。所以我还在等。

主持人:这题是什么?是秘密数学题吗?

Mark:不是秘密啦,只是如果我现在公布,它可能会被拿去训练(笑)。

它叫?“42 问题(the 42 problem)”:你要构建一个模 42 的随机数生成器,但你手头只有一些“模小于 42 的质数”的随机数生成器作为原语。你的目标是让调用这些子生成器的期望次数尽可能少。

这是个很可爱的 puzzle。语言模型能做到很接近最优,但目前还没有一个完全解出来。

主持人:我们正往我想问的方向走。但先插一句,我知道你竞争心很强,你之前也跟我说过你“非常讨厌输”。

Mark:是的,我真的很讨厌输。

主持人:所以我想象,如果你知道 Gemini 3 要在周四发布,你会不会半夜就把那道数学题丢给它测试?还是没那么夸张?

Mark:不会啦。这些事情是长周期的旅程。我这个人确实会对某些事很执着,但任何长期事业都需要“打长线”。

过去半年我们都在专注强化“预训练”,把这项能力做得更强。也和 Jakub 一起,在 OpenAI 内部打造出一支真正的预训练“王牌团队”。

正是这些努力,让我们今天有信心在“预训练实力”上跟 Gemini 3 正面对抗。

大模型的竞赛水平超越人类

主持人:说到 puzzle,我知道 Jakub 是在编程竞赛里出名的。我第一次见他是在 Facebook 的 Hacker Cup。他当时就像比赛里的“明星选手”。

而你好像小时候一直参加数学竞赛,对吧?后来也做过信息学竞赛?

Mark:对,我从小学到高中都在参加数学竞赛。但我其实很晚才开始接触编程,是大学舍友说服我去上第一门编程课。当时我还带着数学人的傲气,觉得数学才是最纯粹最难的学科。

后来编程竞赛变成了我和大学朋友保持联系的一种方式。我们每周末都会上线比赛。慢慢我发现自己确实有天赋,也开始给美国国家队命题、做教练。那是很有趣、很有社区感的经历,也让我认识了像 Scott 这样的人。

主持人:很多人知道数学竞赛,但信息学竞赛(IOI)感觉规模更小、更像解谜,对吧?

Mark:对,信息学竞赛就像高压的“编程解谜赛”。你每天只有三道题,五小时解决,既要快又要正确,压力非常大。但大家也因此结识一生的朋友。

我现在是美国队的教练之一。团队的实力每年都不一样,但前几年我们确实有一届非常“尖”的队伍,拿了冠军。

主持人:那你现在这么忙,教练要投入很多时间吗?

Mark:其实孩子们都很自驱,教练更多是在做“状态管理”和“决策管理”。比赛里会有好时段和坏时段,你不能让情绪被影响。这一点跟管理研究人员非常像,研究有顺利的时候,也有连着好几个月什么进展都没有的时候,不能被这些情绪牵着走。说白了就是士气管理。

有件事最近让我意识到:当我们让语言模型去解这些竞赛题时,它们的思考方式跟人非常不同。我们常以为模型是做“模式匹配”,但有些题人类觉得特别 ad hoc、特别难,模型却能轻松做出来。这种“直觉差异”让我意识到:未来在最前沿的科研里,人类 + AI 的组合会比任何单方都强,因为双方对“难”和“易”的判断完全不同。

主持人:这是不是有点像 AlphaGo 当年下出“人类从未想过的招”,那种“Move 37”时刻?

Mark:对,非常类似。我觉得 GPT-5 Pro 标志着一个重要拐点。发布后三天,我让一位物理学家朋友试试,让他别做小任务,而是直接把自己最新的论文丢进去。模型思考了 30 分钟,然后就把核心问题解出来了。他的反应就像李世石面对 Move 37 那一瞬间一样。我相信这种“突破时刻”接下来会在数学、物理、生物、材料科学等领域不断出现。模型现在真的到了那个水平。

主持人:但也会有一丝淡淡的失落吧?毕竟这些竞赛是许多独特人类天才曾经的巅峰。

Mark:有一点吧。我自己曾经就在这些竞赛里表现不错,虽然不是世界顶尖。但我还记得当我们用模型做竞赛评测时,它的水平一步步往上爬,从“普通水平”到有一天,它超过了我。那一刻很震撼:我们真的把这种能力自动化了。接着一两个月后,它也超过了 Jakub。以今年的 coder 大赛为例,模型已经做到世界第二名。去年它还在百名开外。

主持人:那未来十年,这些竞赛你觉得还会存在吗?

Mark:会的。竞赛本身就是一种乐趣。那些只是为了简历而参加的人可能会退出,但真正热爱它的人不会消失。

不过说实话,未来面试、作业、考试,这些评价体系都会被彻底改变。现在它们已经被语言模型“彻底打破”了。我们必须发明新的方式来判断一个人实际掌握了什么、能做什么。

我有个想法,也许在我们的面试中,候选人可以直接跟 ChatGPT 对话,你知道吗?是那种特别版本的 ChatGPT,模型会尝试评估你是否真正懂这些知识,或者你是否有能力在 OpenAI 工作。你得跟它进行一场对话,让它真正相信你属于 OpenAI。当然,你不能去“破解”它,但我们可以在之后查看对话记录。也许未来像这样的测试,更能准确反映你的能力。

Mark和Scott等人常打扑克

主持人:你小时候数学很好,是吗?你是在东海岸出生的?

Mark:对,在东海岸出生,然后也在西海岸生活过。

主持人:嗯,然后你又去台湾读了小学到高中,大概四年左右?

Mark:是的。我的父母当时在贝尔实验室工作。

主持人:所以你是工程师世家出身。嗯,你的成长经历很有意思,因为你接触了很多创新中心的环境,尤其是父母在贝尔实验室。你小时候的生活基本就是科学氛围吧?

Mark:是的,我的晚餐桌谈话经常是谜题之类的。我也体验了东海岸贝尔实验室那种传统环境。西海岸的时候,我父亲创业,我也早早接触到新公司的氛围。当然,再到台湾是个很大的文化冲击。学校有校服,周围还有铁丝网,非常严格。我觉得这些经历都很宝贵。

主持人:所以台湾的学校更严格?

Mark:我会说更不灵活自由,但它也教会了你一些东西。

主持人:你从一开始就知道要回美国上大学吗?

Mark:是的。

主持人:然后你去了 MIT。那一年的人才也很有意思吧?

Mark:嗯,2012 年那一届特别棒。比如Jacob Steinhardt,现在在做Transluce公司,我们当时还一起上计算机课、一起做项目。还有Paul Christiano,他也在OpenAI工作过。刚才说到竞技编程那一挂,还有像Scott Wu,现在在Cognition,他现在在X上简直成了“数学梗王”。

主持人:现在你们竞技的成果更像扑克牌了?之前我们在一个活动上深夜我路过一张桌子,看到你、Scott以及其他几个人,围在桌边打扑克,我不知道对你们来说算不算紧张,但对我来说气氛挺严肃的。所以你们现在是把数学和竞争都用在扑克上了吗?

Mark:扑克确实是个有趣的游戏。我过去对它非常痴迷。大概的感悟是,扑克更多是数学而不是心理战。你对扑克了解得越多,越会往这个方向修正自己的认知:它本质上是概率与期望值的博弈。你越懂数学,越能正确地诈唬,这让人非常轻松。我觉得语言模型也类似——表面上是非常人性化的语言生成,但背后其实有数学原理。

主持人:那你们怎么获得优势呢?你和 Scott 数学能力都非常强,我不太理解你们谁能比谁计算得更快。

Mark:其实更多是社交和交流的场合,而不是纯粹竞技。认真对待扑克反而会失去乐趣。我对扑克的痴迷在十多年前就结束了,现在就是娱乐而已。

主持人:你这是因为我看到Scott连赢了两天,才这么说的吧?

Mark:你可能说到点子上了。

主持人:他确实打得挺认真。

Mark:不过在回程飞机上我赢了。不是一对一,大概还有三四个人一桌。

从MIT到华尔街,再到AI

主持人:大学毕业后,你走的路径是直接去华尔街高频交易,对吗?

Mark:是的,那条路在 MIT 数学背景的学生中很常见。它是一个非常功利主义的环境,智慧和努力直接有具体回报。但文化上很封闭,大家不太信任彼此,发现新东西后往往先藏着,知识就是价值。长期下来,我觉得世界其实并没太大变化。四五年后,我觉得该做点别的。AlphaGo 的比赛对我启发很大,我想理解背后的原理。

主持人:那你之前接触过 AI 研究吗?

Mark:老实说没有。那次比赛很激励我,于是我开始深入 AI,目标之一是复现 DQN,用它玩 Atari 游戏达到超人水平。那就是我进入 AI 的起点。

主持人:你是边工作边研究吗?

Mark:是的,下班回去继续研究。

主持人:我还记得2018年左右我采访George Hotz的时候,他说过一句让我印象深刻的话。他说AI领域非常年轻,年轻到一个人只要读10-30篇论文(记不清到底多少篇了),就能学到整个领域的核心。

确实很有趣,AI是一个历史很久但“现在这个时刻非常浅”的领域。

Mark:我给那些对AI感到畏惧的人一个建议:它很浅。花三到六个月,选一个项目(比如复现DQN),你就能非常快地走到前沿。最近几年这个领域是变“深”了一点,但和理论数学、物理比差得远。

主持人:我问过Jakub,在数学里,很多人都是20多岁做出最伟大的工作,之后再难有突破。AI也是这样吗?我们是否依赖年轻人去读论文、突然灵光乍现?还是说这是一个人可以干一辈子的领域?

Mark:我觉得AI是一个可以一直做下去的领域。虽然OpenAI本身文化相对年轻,但我不认为你必须年轻才能做出好研究。

年轻人可能没有既定框架,更有创新灵活性,但经验和视角也是宝贵的。

OpenAI的“宫斗风波”

主持人:你在 OpenAI 2018 年刚入职时,公司大概只有 20 人?

Mark:是的,非常小。我以“Resident”的身份加入,那时还不是专家或博士,相当于一个六个月的压缩 PhD 项目,之后才逐渐深入研究。

主持人:那你最初的工作是独立研究?

Mark:是的,我前面大概有三年都是做IC(个人研究员)。我当时做的是生成式建模,因为那是Ilya当时最关注的方向。管理团队是后来才开始的。

主持人:DALL·E是公众第一次真正认识OpenAI生成模型的项目吗?

Mark:对。而DALL·E也标志着我从IC转向管理者。在那之前,我最自豪的项目之一是ImageGPT,证明即使不是语言,你把图像丢进 Transformer,模型一样能学到非常强的表示。

它能理解图像内容,并展示出“语言建模方法可以用在非文本领域”的可行性。

另一个我很骄傲的IC项目是Codex,我搭建了很多评估代码模型的框架,并深度研究如何让语言模型变成强大的代码模型。

主持人:你为什么选择 OpenAI?当时公司小,Google 在 AI 上已经投资很多。

Mark:有两点,一是宏大愿景,二是人才足够强大。我也认识 Greg,从大学时期就有交集。我觉得 OpenAI 罕见地兼具愿景和人才。

主持人:在 OpenAI 历史上,也经历过一些戏剧性事件,比如内部分歧。你是怎么处理的?

Mark:我很幸运,得到了管理者的支持。我记得在某些危机时期,我和 Nick(Nick Turley,ChatGPT产品负责人)、Barrett(Barret Zoph,OpenAI前研究副总裁)都觉得:“狼就在门口了。”大家都不断收到来自各大实验室的电话:“要不要来我们这儿工作?”

我当时给自己定下一个目标,我不会失去任何一个人。而且我们真的没有失去任何人。那几天我们几乎每天都把自己的家打开,让大家有一个可以来倾诉焦虑、互相陪伴的地方,我们也帮助大家持续与核心领导层保持联系,让他们感觉自己能参与、有发声权。

随着时间推移,大家形成了一种非常强烈的共同体精神:“我们一起面对这一切”“我们要向外界表明我们是一条心的”。当时我在几处房子之间来回走,后来我们有了一个想法,我们需要向世界展示,我们团结一致,并且愿意为Sam工作。于是请愿信就这样成形了。

这个主意大概在凌晨2点定下来,到了早上,研究组超过90%的人已经签名。大家互相给朋友打电话“你赞成还是不赞成?你要不要签?”最终,大概近100人签了那个请愿信。

主持人:那时,你处境应该挺尴尬的吧?尤其 Ilya 是你的导师,Sam 又在另一边。

Mark:是的,那时候信息很有限,你完全可以合理地问:“Sam到底做错了什么?”但我觉得核心人物不会轻易离开。我相信 Greg 和 Jakub 的正直,这才让局势稳定。

Jakub私底下非常搞笑

主持人:Jakub 给你留下什么印象?

Mark:他其实超级搞笑,真的非常搞笑。是一种非常讽刺式的幽默,经常把我笑疯。我和他在会议上能迅速达成共识,合作推进大项目,非常幸运能和他一起工作。

主持人:你们仍然保持团队凝聚力吗?

Mark:是的,我仍然觉得 OpenAI 是一个家庭。其他公司想抢人选时,我们都要保护团队成员。我一直努力确保团队幸福,理解自己在整体规划中的角色。

主持人:回顾历史,你会看到,2012 年 Ilya 取得了一个很大的突破,接着在 2017 年,Vaswani等人提出Transformer,Alec Radford推动了另一批重要成果,这些都是像“英雄人物”一样的突破,AI领域还非常年轻,看起来可能就是那8-10个人不断推动领域前进。

所以当John Schulman离开,Alec离开……我当时心里想:哇,如果你们失去这部分全明星阵容,那怎么继续?这不像一个能轻易替换人才的领域。

但令人惊讶的是,就在那之后,你们在reasoning方向和其他前沿方向上继续取得突破。

Mark:我并不完全同意“必须依赖明星人才”才可以做出好研究的观点。我认为,OpenAI 的文化非常特别,它不仅在顶层有方向上的押注,同时也在底层以非常自然的方式让一些最佳的想法自发涌现,甚至有时来自最意想不到的地方。我真正欣赏的,是看到这些赌注逐渐成形、被扩展并取得成果,而推理就是一个核心的例子。

主持人:那么关于“明星依赖”这个问题,你怎么看?毕竟你还看到 Google 花费巨大金额去挖回人才。

Mark:我认为是混合的策略。我们必须投资于人才管道,因为我对我们培养明星人才的能力非常有信心。但当然,世界上也有非常优秀的人才,大家都知道他们的价值。我从 Meta 学到的一件事是,OpenAI 也可以非常积极地争取明星人才,而我也借鉴了其中的一些策略。总的来说,我们应该不断努力组建最优秀的团队,为实现使命服务。这是一个竞争非常激烈的行业,但这正是我喜欢的部分。我个人非常有竞争心,讨厌输,无论是在研究还是招募上,我都会全力以赴。

这让我想起早期半导体的发展,那时候一大批半导体创业公司同时涌现,每家公司都在推动物理极限的边界。工程师们会在酒吧里交流发现的技术,同时每家公司也在努力尽快取得突破。你提出了一个有趣的观点:知识的基础扩散会发生,而公司可以选择两种方式应对:一是建立深度信息孤岛保护知识,我认为 OpenAI 并不是这样运作的;另一种是尽可能快速前进,我们喜欢开放的文化,研究人员自由分享想法,这才是取得最快进步的方式。

主持人:那 Sam 和 Jakub 现在是如何协作的?

Mark:我们是一个非常紧密的小团体。我每天都和 Sam、Jakub 沟通。Sam 非常热爱研究,喜欢和研究人员交流,从他们那里理解研究思路和方向。我也会依靠他发现潜在问题,并把信息反馈给我。Jakob 和我会花很多时间设计工作的方式,让团队成功,比如将合适的人配对、激励他们在重要方向上工作。这些都是非常关键的工作。

主持人:Sam 在做什么?是读论文还是和你们交流?

Mark:他会读论文,也会和研究人员交流,了解他们的思路和研究类型。当然,他还负责公司很大一部分其他事务。

预训练还有很大空间,不同意“Scaling已经终结”

主持人:接下来我问一些技术问题,可能涉及机密,但我会尽量不越界。关于预训练,我感觉你们已经找到了一些突破,让人很兴奋,这可能会是一次重大进展。能和我们讲讲你们发现了什么吗?

Mark:从高层来看,过去两年我们投入了大量资源在推理方面,去理解这个原始机制并让它运作起来,结果真的很有效。我认为一个副作用是,你在其他功能上,比如预训练和后训练,可能会稍微弱一点。

在过去六个月里,我和 Jakub 做了很多工作来重新增强这些能力。我觉得预训练更像是一块“肌肉”,需要不断锻炼,确保信息保持新鲜,并且团队在优化和数值计算的前沿工作。同时,你还需要确保整个团队的关注度在这个方向上,这也是我最近特别关注的事情。

我们认为预训练还有很大空间。很多人说“Scaling已经死了”,但我们完全不这么认为。从某种意义上讲,之前大家都关注强化学习,但我们觉得预训练还有很大潜力。通过这些努力,我们训练出了更强大的模型,这也让我们对今年年底的 Gemini 3 等版本充满信心。

主持人:我脑海里的想象是:你们一直在高速奔跑,整个领域都在快速发展。现在我们积累了海量的互联网数据,把它们扔到超级计算机上,然后 ChatGPT 就出现了。整个过程就像一场惊人的竞赛。

所以在最初阶段,你们有大量数据输入系统,初步处理这些数据,然后现在只是学习更高效的处理方式,有时候很难判断之前的错误在哪里。

Mark:对,你提到的正是我一直在思考的。预训练时,你让模型学习人类写作的数据,教它去模仿人类写作模式。在某种程度上,这也形成了瓶颈,限制了模型的能力,因为你无法超越人类已有的写作水平。

因此我们会引入强化学习,让模型去解决人类能想到的最困难任务,让它超越人类模仿的局限,达到更高水平。但这也带来了测量问题:我们如何判断模型是否已经超越人类?比如在科学领域,如何知道哪位“超人类”数学家更厉害?我们确实需要更好的评估方法来衡量科学进展。

目前我们还比较幸运,像 IMO、IOI 这样的竞赛可以衡量顶尖水平,但当模型能力超过人类,就没有标准测试了。

主持人:这让我想到 IOI 的事情。我记得那些在竞赛中很出色的孩子,后来被 Google 或 Facebook 招聘,但他们并不一定成为顶尖工程师或最有名的高管。这可能是个人选择,但很难说明,人类竞赛的顶尖人才一定会成为最伟大的工程师。那么,如果 AI 表现特别好,我们学到了什么?

Mark:这也是我喜欢 AI 工作的一点。相比传统工程文化,AI 更像是一个真正的精英主义体系。我学到一个经验:很难把一个没有研究人员尊重的人放到团队领导的位置。在研究领域尤其如此,你必须做出强有力的技术决策,选择正确路径和项目,否则你会失去研究人员的信任。AI 工作和打造强大 AI 的乐趣就在于此:我所有的创业项目都非常技术导向,和团队讨论技术问题很有意思。

主持人:回到预训练,我觉得 Transformer 引发了巨大的飞跃,而推理能力对我来说甚至更令人惊叹。过去几个月和你们交流时,我总感觉你们在三到五年间投入了大量工程工作,但成果还没有完全显现。你们现在是否已经能判断,这是一个与过去大飞跃相当的进步?

Mark:是的,我认为如此。推出 GPT-5 时,我们讨论了合成数据等多个方向,还有很多其他潜力巨大的研究线程,我们正在大规模推进。核心是保持多元化的赌注组合,重点支持那些显示出更多经验性潜力的方向。

10倍算力能在几周内用完

主持人:两周前,Andre Karpathy 在播客上表示,AGI 可能还有 10 年才会到来。我听到 Dario 的看法是一两年内可能出现重大科学突破。你怎么看?

Mark:社交媒体上这些循环的说法往往被放大,每个人对 AGI 的定义不同。就我而言,我关注的是我们是否在产生新的科学知识、推进科学前沿。我觉得从今年夏天起,这方面出现了巨大的阶段性飞跃。

我脑海中浮现的例子是生物科技领域的创业公司,它们在抗体设计和分子开发上展现了 AI 的潜力。我受到启发,想创建“OpenAI for Science”,目标是让那些意识到 AI 潜力并愿意全力投入的科学家能够被加速,而不是仅仅让 OpenAI 获奖。我们希望提供工具和框架,让所有科学家都能感受到加速效果,共同推动科学进步。

最近有些具体成果,比如 GPT-5 在开放凸优化问题上的论文,非常相关于核心机器学习问题。有些人可能会认为这只是“文献搜索”,但实际上复杂得多。总的来说,每隔两天,我看到进展都令人兴奋,有种感觉:我们正在培养 AI 科学家。这在计算机科学和数学领域尤其可信,也不奇怪这种趋势在生物学领域出现。

主持人:所以你们所说的,与每三周变化一次的舆论不同,你们看到的是实实在在的科学进展。尽管每个人对 AGI 的定义不同,但你们感觉未来一两年会有戏剧性的进展。

Mark:是的,这有点像个梗,当你问某人AGI何时到来,他们会说“两年后”,但我觉得我们已经不在那个世界了。数学和科学上的成果让我有了这种信念。

在OpenAI的研究中,我们设定了两个非常具体的目标:一年内,我们希望改变科研的方式,让AI实习生在研发过程中发挥作用;两年半内,我们希望AI能进行端到端的研究。

目前来看,今天你提出一个想法,你去实现、调试它,但一年内,我们有信心到达一个阶段,我们控制研究的整体方向,而模型负责具体的实现和调试工作。

主持人:除了预训练之外,我和你们交谈时,有时候感觉到类似的情况:你们在基础设施上的建设非常大,每次模型扩大10倍就会变得更强。你们在从GPT-4到GPT-5的时候,虽然计算量增加了,但没有看到预期的结果,是不是因为事情当时发展太快,我们还没真正看到10倍算力的飞跃?

Mark:是的,我的想法是,当有人问我们是否真的需要这么多计算资源时,这个问题本身令人震惊。因为我的日常工作就是处理大量计算请求。如果今天给我3倍的算力,我可以立即高效利用;如果是10倍,也能在几周内充分利用。所以对算力的需求是真实存在的,我不认为会放缓。

主持人:那你们对预训练取得的进展感到乐观,是不是意味着你们相信进一步扩展算力会带来更高的提升?

Mark:是的,我们绝对希望继续扩展模型规模,我们有算法上的突破可以支持这种扩展。Gemini 3也非常令人印象深刻,但仍有数据效率方面的问题没有解决,而我们在算法上有很强的能力。

主持人:我看到有泄露的备忘录里,Sam对Gemini 3表现得很严肃,是吗?

Mark:是的,部分原因是Sam的工作就是注入紧迫感和速度,我的工作也类似。Gemini 3是Google应该追求的正确方向,但我们也需要在组织内注入尽可能多的紧迫感。我们有能力快速响应后续工作。

联手Jony Ive,搞硬件设备开发

主持人:你在硬件方面也参与吗?比如和Jony Ive合作?

Mark:是的,我昨天还和Jony Ive以及一些研究人员共进晚餐,包括预训练和后训练负责人。未来的ChatGPT与现在不同,它会有记忆功能,每次与你交互时会学习、反思你的问题,下次交互会更聪明。设计一款以这种理念为核心的设备非常重要。

主持人:你们如何判断在硬件上有品位?

Mark:其实我们不需要自己有品位,这是Jony的工作。他负责判断设计的优劣。我们在模型行为上有自己团队,他们判断的是模型行为的“品味”,和硬件设计类似,都需要探索和创意。举个例子,我们可能会问模型“最喜欢的数字是多少”,通过这种方式判断它的行为风格。

最后的一些问题

主持人:你还有哪些小而脆弱的想法,可能会成为未来突破的核心?

Mark:我有几个小想法,但不能透露太多。我主要关注预训练,少量涉及强化学习,还有一些关于如何整合的方法。

主持人:目前大家对你们理解上有什么误区吗?

Mark:最重要的是,OpenAI是一个研究为中心的公司,核心目标是打造AGI,没有干扰。产品开发只是从这个目标自然流出的结果。我们希望加速AI研究、自动化科学发现,并实现经济有用的工作。过去一年最重要的更新是科学研究自动化方面,确实在发生。

主持人:你现在多大了?能有社交生活吗?

Mark:我34岁,快35了。社交生活基本没有。最近两周每天都是工作到凌晨一两点,但我喜欢这样。工作很多,要招聘很多人,要做很多指导工作,这个黄金时期不能浪费。

主持人:你曾在办公室过夜,是吗?

Mark:是的,有一段时间,Barret 离开公司去创办自己的公司,我需要守护研究,就在办公室过夜。感觉像在保护自己的孩子。

主持人:你们经历了“宫斗”、大规模挖角、Meta启动巨大的研究团队……现在的战火算过去了吗?

Mark:我每次和团队开会都会说:“等我处理完这件事,我会抬起头看看有没有新的火要救。”

但现在我已经完全接受,构建AGI的赌注够大,所以永远会有新的火。关键是,在混乱中,你要能判断什么才是真正重要的事。

主持人:距离 DeepSeek 事件已经过去好几个月了吧?当时大家好像一度有些失控,你现在回过头来看,中国开源模型,尤其是开源 AI 模型,你有什么想法吗?

Mark:我觉得那是我第一次真正意识到,保持我们研究模式的纯粹性有多重要。事件发生时,的确很火,大家都在问:“OpenAI 是不是走偏了?这些模型会追上我们吗?”我们当时的回应,其实就是踏踏实实地走自己的研究路线。我觉得那完全是正确的选择。我还没看到 DeepSeek 的后续模型,但我认为他们是很强的实验室。DeepSeek 在某种程度上很好地复现了我们 O 系列模型的一些理念,但我们要专注于创新。

主持人:你觉得 500 人的规模,是随着公司增长而增加,还是已经是追求重大创意的最优规模了?

Mark:我觉得可以用更少的人数来完成这些工作。随着 AI 研究人员或 AI 实习生的加入,如何设计团队是一个实际问题。我非常重视高密度的人才。比如今年第二季度,我决定不开放任何研究岗位的招聘,如果有人想加入,就得找出谁不合适。这样的做法很重要,不希望团队稀释,也希望保持高水平的人才门槛。

主持人:我记得有一次会议,你和 Jakub 的意见有点类似,但你特别强调关于项目归属的问题。当时你觉得大家对归属的执着有点过头了,对吧?

Mark:是的,我觉得过分关注个人信用是不好的。但从公司的角度,我们仍然需要在内部和外部认可每个人的贡献。很多公司已经不再做论文署名、荣誉榜,但我和 Jakub 决定在 OpenAI 保留这种方式。有人可能会说,这会让我们的顶尖人才暴露在外,容易被挖走。但我觉得这不重要,我们应该认可真正做出贡献的人,继续培养 AI 顶尖人才。

主持人:也就是说,个人研究者对归属感不必过度执着?

Mark:是的,会议中确实有这种情绪,我和 Jakub 对此持稍微不同的看法。总之,我认为 OpenAI 是允许个人获得最多外部认可的地方。

主持人:你 2018 年加入 OpenAI,当时它还是一家非营利研究公司。你来自高频交易行业,看到 AI 的潜力。你能分享一下,你当时为什么选择参与 AI 研究吗?

Mark:我主要是关注安全性和对齐问题。我管理 OpenAI 的对齐团队,我认为未来一两年最大的挑战之一就是模型对齐。我们在过去一年在这方面做得不错,尤其是关于“策划”(scheming)的研究。随着强化学习投入的增加,模型可能表现出自我意识、自我保护,甚至可能策划某些事情。问题在于,它可能最终给出你期望的答案,但过程可能是扭曲的。因此理解模型的思维过程至关重要。

主持人:那我们理解模型的能力,能跟上 AI 系统复杂性的增长吗?还是我们最终会到达一个永远学不懂的阶段?

Mark:我们从 GPT-1 就决定不去监督模型的思考过程。如果你给模型激励去表现出人类喜欢的思维,它不一定会诚实表达自己的意图。我们通过这种方式来观察模型的思维过程,用于理解对齐问题。

最近几个月,有论文与 DeepMind 和 Anthropic 合作,探讨了这种方法的演变。我担心未来模型可能会说出非常令人信服的东西,但我们无法确定它是否与我们的价值观对齐。所以有很多有趣的方向,比如能否建立模型相互监督或共演化的环境,让唯一稳定的平衡状态是模型诚实,这方面还有大量工作要做。

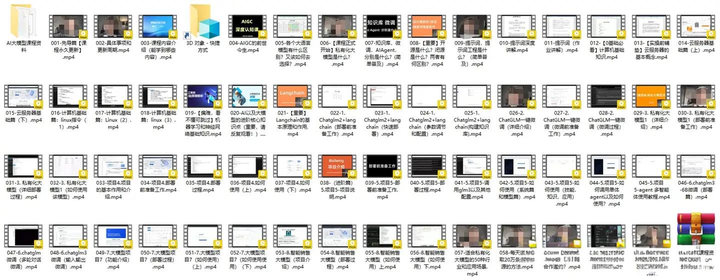

如果你想更深入地学习大模型,以下是一些非常有价值的学习资源,这些资源将帮助你从不同角度学习大模型,提升你的实践能力。

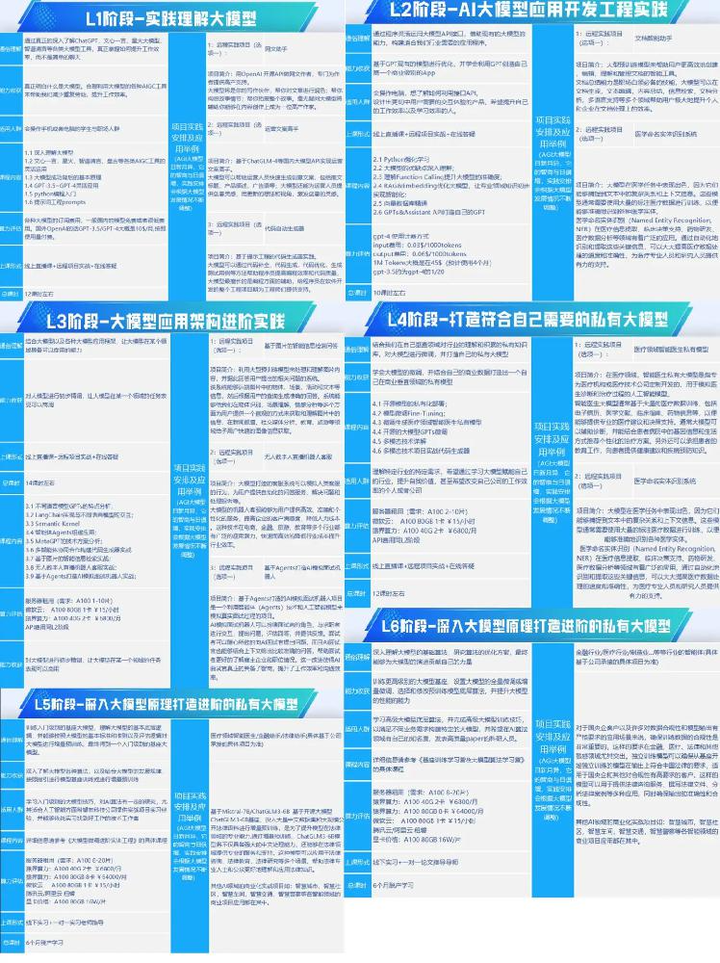

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获取

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获取

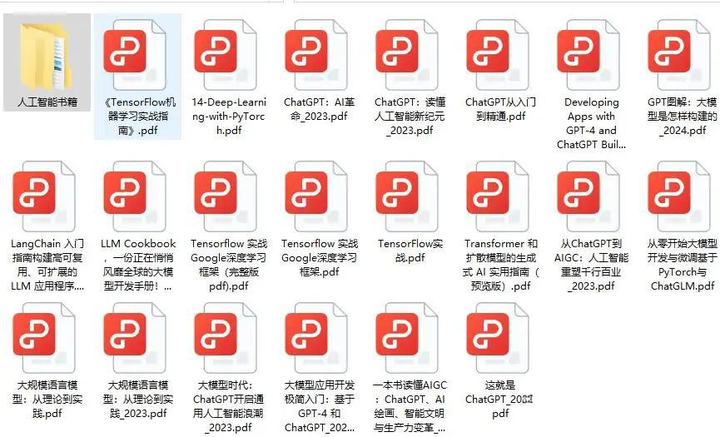

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获取

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)