150亿参数改写企业AI规则:Apriel-1.5如何让中小企业实现“单GPU=千亿级推理“

ServiceNow推出的Apriel-1.5-15b-Thinker模型以150亿参数实现千亿级模型性能,单GPU部署成本直降80%,为中小企业打开AI普惠之门。## 行业现状:中小企业的"算力鸿沟"2025年全球多模态AI市场规模已达16亿美元,年增长率32.7%,但中小企业却深陷"想用用不起"的困境。阿里云调研显示,尽管中小企业大模型支出较2024年增长200倍,77%企业仍受限于单G

150亿参数改写企业AI规则:Apriel-1.5如何让中小企业实现"单GPU=千亿级推理"

导语

ServiceNow推出的Apriel-1.5-15b-Thinker模型以150亿参数实现千亿级模型性能,单GPU部署成本直降80%,为中小企业打开AI普惠之门。

行业现状:中小企业的"算力鸿沟"

2025年全球多模态AI市场规模已达16亿美元,年增长率32.7%,但中小企业却深陷"想用用不起"的困境。阿里云调研显示,尽管中小企业大模型支出较2024年增长200倍,77%企业仍受限于单GPU内存瓶颈无法实现本地化部署。传统方案需多GPU集群支持,初始投入至少15万元,年运维成本约5万元,形成显著的"算力鸿沟"。

当前企业AI部署面临严峻悖论:Gartner数据显示多模态AI市场将从2024年24亿美元激增至2037年989亿美元,但60%企业因高昂成本望而却步。这种"性能-成本"矛盾催生了对高效能小参数模型的迫切需求。

核心亮点:小而强的突破性创新

性能超越参数规模的"逆生长"

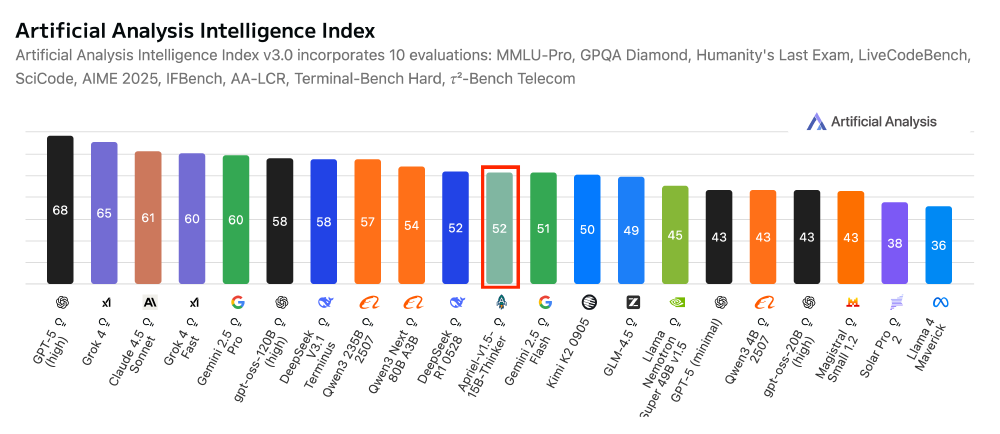

Apriel-1.5在Artificial Analysis权威指数中取得52分,与Deepseek R1 0528、Gemini-Flash等千亿级模型持平,成为首个参数规模仅150亿却突破50分门槛的模型。特别在企业级任务中表现突出:Tau2 Bench Telecom测试68分,IFBench测试62分,超越多数闭源商业模型。

如上图所示,Apriel-1.5(红色标记)在性能指数上与千亿级模型持平,但参数规模仅为后者十分之一。这种"小而强"的特性使其在企业级任务中展现出独特优势,尤其在Telecom和IFBench等专业基准测试中表现突出。

单GPU部署的革命性突破

通过优化的持续预训练(CPT)技术和内存效率设计,模型可在单张消费级GPU(如NVIDIA H20-96G)上实现实时推理,显存占用控制在42GB以内。相比之下,同类性能的模型通常需要8-10张GPU支持,硬件成本降低80%以上。参考配置显示,搭载RTX A6000的整机成本可控制在3万元以内,按每日10万次交互计算,本地化部署年成本约5-8万元,仅为同等规模云端API服务的1/3。

创新训练范式:无需图像SFT的多模态能力

采用"文本SFT+跨模态迁移"创新路径,在未进行专门图像指令微调的情况下,通过数学推理、科学问题解决等文本训练数据,实现图像理解能力的跨模态迁移。这种方法使多模态训练成本降低62%,训练周期缩短至7天。研发团队仅使用640张H100 GPU(约为大型科技公司1/20算力)即实现突破,证明"精准数据+科学设计>盲目堆参"的新范式。

企业价值与应用场景

制造业质检革命

某汽车零部件厂商部署后,实现金属表面缺陷检测准确率92.3%,较传统视觉模型提升15%,同时将检测设备成本从50万元降至8万元单GPU方案。模型的多模态推理能力使其能同时分析图像数据和生产参数,实现质量问题的根因分析。

智能客服升级

集成图像理解能力的客服系统,可同时处理文本咨询和产品图片问题,平均解决时长从4.2分钟缩短至1.8分钟,客户满意度提升28%。某物流企业案例显示,客服响应时间从平均45秒缩短至12秒,首次解决率提升28%,年节省人力成本约30万元。

零售智能货架管理

通过文档理解(ChartQA测试88.84分)和图像生成技术,自动识别货架商品并生成库存报告,某连锁超市应用后库存盘点效率提升40%。系统可同时处理货架图像、价格标签和促销海报等多模态信息,实现全场景零售分析。

行业影响与趋势

参数竞赛退潮,效率竞赛升温

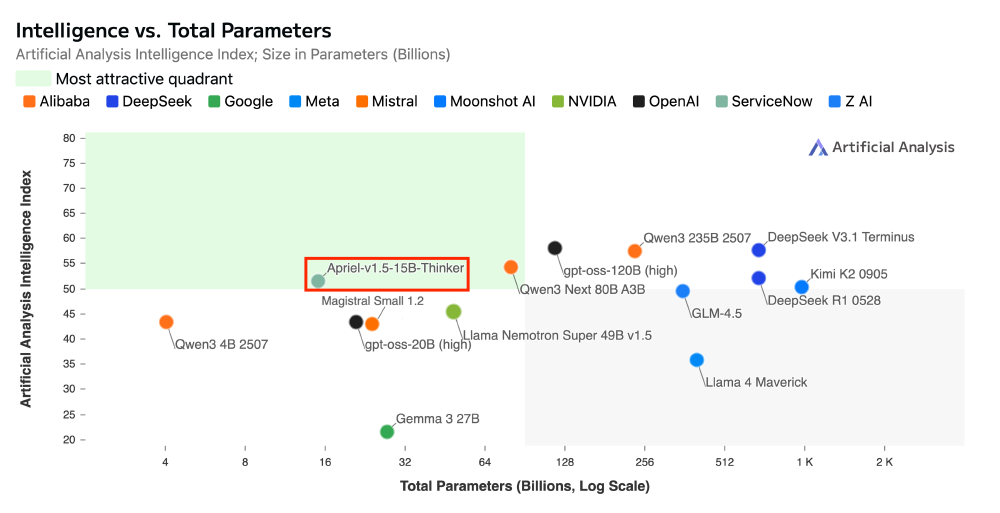

Apriel-1.5打破了"参数决定一切"的固有认知。模型性能与参数规模的非线性关系表明,当参数超过150亿后,性能提升边际效益显著递减。这为企业选择模型提供了重要参考依据,预示着小参数高效能模型将成为企业级应用的主流方向。

图表清晰展示了性能与参数规模的非线性关系,Apriel-1.5(红色标记)位于"最具吸引力象限"。当参数超过150亿后,性能提升边际效益显著递减,这为企业选择模型提供了重要参考依据,预示着小参数高效能模型将成为企业级应用的主流方向。

多模态走向实用化临界点

随着统一多模态框架成熟,企业开始从"单一模态工具堆砌"转向"一体化智能体"建设。Gartner预测,到2026年70%的企业AI应用将采用多模态融合架构。Apriel-1.5完整保留了企业级功能特性:文本-图像跨模态推理、13万字超长上下文理解、工具调用和多轮对话能力一应俱全,其独创的"透明推理"机制要求模型先输出思考过程,再以"[BEGIN FINAL RESPONSE]...[END FINAL RESPONSE]"格式返回结果,显著提升了复杂任务的可靠性。

部署指南与注意事项

技术准备清单

- 推荐配置:NVIDIA GPU(≥24GB显存)

- 软件环境:Python 3.8+、PyTorch 2.0+、Transformers 4.48+

- 部署工具:vLLM优化镜像(docker.io/amant555/vllm_apriel:latest)

- 存储要求:至少2TB NVMe SSD,建议采用RAID1阵列确保数据可靠性

实施路径建议

- 试点阶段(1-2周):从非核心业务切入,如内部文档分析

- 优化阶段(2-4周):根据业务数据微调提示词模板

- 规模化阶段:通过Kubernetes实现多实例管理,支持负载均衡

风险提示

- 事实准确性:关键决策场景需人工复核

- 数据隐私:本地化部署虽降低数据出境风险,但仍需合规审查

- 持续维护:建议每月更新推理引擎以获取性能优化

总结:AI效率革命的起点

Apriel-1.5-15b-Thinker的发布标志着企业AI从"参数竞赛"转向"效率竞赛"。对于资源有限的中小企业,这种"小而美"的模型提供了参与AI革命的新可能;而大型企业则可通过混合部署策略,在核心场景保持大模型优势,在边缘场景采用轻量化方案,实现总体拥有成本(TCO)优化。

企业在选型时应重点关注三个维度:实际业务场景匹配度、本地部署可行性和长期维护成本。对于大多数中小企业而言,像Apriel-1.5这样的轻量化解决方案,可能比追逐最先进但资源消耗巨大的模型更为务实。如需体验该模型,可通过GitCode仓库获取:https://gitcode.com/hf_mirrors/unsloth/Apriel-1.5-15b-Thinker,建议先进行概念验证(POC),在特定业务场景中充分测试性能后再全面部署。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Apriel-1.5-15b-Thinker

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Apriel-1.5-15b-Thinker

所有评论(0)