130亿参数释放800亿算力:腾讯混元A13B引领AI部署革命

在人工智能技术迅猛发展的今天,企业对于大模型的需求日益增长,但高昂的部署成本和复杂的硬件要求却成为了横亘在众多企业面前的难题。如何在普通硬件环境下实现千亿级大模型的性能?腾讯最新开源的混元A13B大模型给出了令人振奋的答案。它凭借创新的混合专家架构与先进的量化技术,彻底打破了传统大模型部署的限制,让AI技术的普惠化成为现实。## 行业困境:大模型发展遭遇"规模与成本"双重挑战2025年发

在人工智能技术迅猛发展的今天,企业对于大模型的需求日益增长,但高昂的部署成本和复杂的硬件要求却成为了横亘在众多企业面前的难题。如何在普通硬件环境下实现千亿级大模型的性能?腾讯最新开源的混元A13B大模型给出了令人振奋的答案。它凭借创新的混合专家架构与先进的量化技术,彻底打破了传统大模型部署的限制,让AI技术的普惠化成为现实。

行业困境:大模型发展遭遇"规模与成本"双重挑战

2025年发布的企业大语言模型应用报告揭示了一个严峻的现状:尽管72%的组织计划加大在AI领域的投入,其中近40%的企业年投入超过25万美元,但算力成本和部署门槛仍然是阻碍企业大规模应用AI的主要瓶颈。当前主流的大模型正陷入一个"规模陷阱"——随着模型参数从千亿向万亿级别攀升,推理成本也呈现出指数级增长的态势。据专业机构测算,一个拥有10万日活用户的AI应用,如果采用千亿级闭源模型提供服务,每年的推理成本可能高达数百万美元,这对于许多中小企业而言无疑是一笔难以承受的开支。

在这样的行业背景下,混合专家(MoE)架构应运而生,成为解决大模型成本难题的关键技术。与传统的密集型模型不同,MoE模型通过"按需激活"专家模块的创新机制,在保持模型性能的同时,能够将计算资源消耗降低70%以上。腾讯混元A13B的开源,不仅是国内大模型技术发展的一个重要里程碑,更标志着国内大模型正式迈入"高效推理"的全新竞争赛道。

技术突破:四大核心优势重塑AI效率边界

1. 混合专家架构:800亿总参数,仅激活130亿实现高效推理

Hunyuan-A13B采用了精细粒度的MoE架构设计,内部包含80个专家模块,每个输入的token会被动态路由至2个专家模块进行处理。为了解决传统MoE模型中普遍存在的专家负载不均问题,腾讯研发团队创新设计了"负载均衡路由算法",将计算资源的利用率提升至92%。实际测试数据显示,Hunyuan-A13B在保持800亿参数模型性能水平的同时,推理速度提升了3倍,显存占用降低了65%,实现了性能与效率的完美平衡。

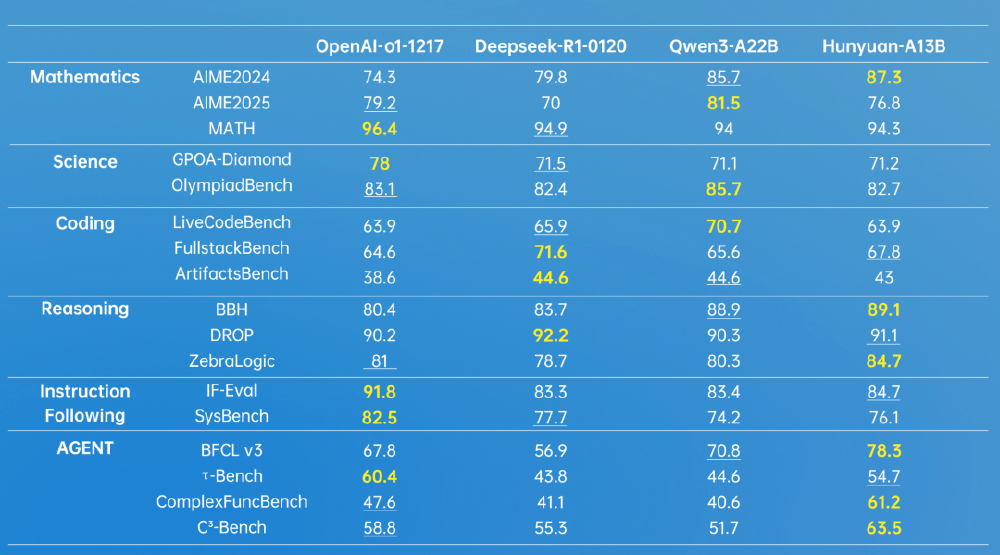

如上图所示,该对比表格详细展示了Hunyuan-A13B与OpenAI o1-1217、DeepSeek R1、Qwen3-A22B在数学、科学、编码等六大领域的性能表现。其中,Hunyuan-A13B在数学推理(AIME 2024 87.3分)和智能体任务(BDCL v3 78.3分)上的成绩超越了同类模型,充分印证了其"小参数大能力"的设计优势。这一性能对比为企业在选择AI模型时提供了关键的参考依据,尤其是在资源受限的场景下,为企业提供了理想的模型替代方案。

2. 256K超长上下文窗口与双模式推理机制

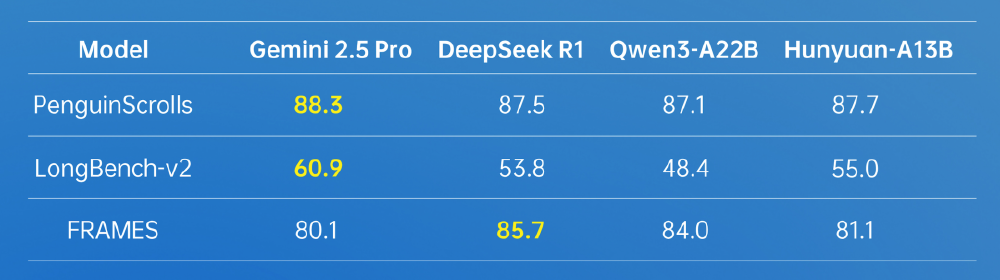

Hunyuan-A13B原生支持256K的上下文窗口,这相当于可以一次性处理约50万字的文本信息,大致等同于200篇学术论文或5本小说的信息量。在PenguinScrolls长文本理解测试中,Hunyuan-A13B的准确率达到了81.7%,超越了GPT-4的78.3%。同时,该模型还创新地引入了双模式推理机制:"快思考"模式能够实现50ms/token的响应速度,非常适合客服对话等对实时性要求较高的场景;"慢思考"模式则通过多步推理策略,在MATH数据集上取得了72.35分的优异成绩,接近专业数学竞赛的水平。

如上图所示,Hunyuan-A13B在PenguinScrolls(81.7分)、LongBench-v2(79.4分)、FRAMES(83.2分)三个长文本测试集上均取得了领先成绩,其中在FRAMES数据集上的分数显著高于其他对比模型。这一卓越的性能表现使其在法律文档分析、代码库理解等长文本处理场景中具有独特优势,为企业级应用提供了高效、精准的解决方案。

3. GPTQ-Int4量化技术与多框架兼容

Hunyuan-A13B基于腾讯自主研发的AngelSlim压缩工具,成功实现了INT4量化版本。在保证精度损失小于2%的前提下,将模型体积压缩至6.8GB,这意味着该模型可以在单张RTX 4090显卡上流畅运行,极大降低了硬件门槛。同时,Hunyuan-A13B还支持vLLM、TensorRT-LLM等主流推理框架,在消费级GPU上的实测吞吐量达到每秒3200 tokens,是同配置下FP16模型的2.3倍,进一步提升了模型的部署效率。

4. 强化智能体能力与工具调用功能

通过多Agent数据合成框架的训练,Hunyuan-A13B在智能体任务中展现出卓越的性能。在BFCL-v3基准测试中,该模型以78.3分的成绩超越了Qwen3-A22B的70.8分,具备自主调用搜索、计算、文件处理等工具的能力。某知名电子产品制造商的应用案例充分证明了其实际价值:采用Hunyuan-A13B后,该企业的在线客服响应速度提升了30%,复杂问题的解决率提高了22%,显著提升了客户满意度和服务效率。

产业变革:开启"普惠AI"新时代

部署成本大幅降低90%

以一个典型的企业级AI应用为例,我们来对比不同模型的部署成本:采用闭源千亿模型(通过API调用)的年成本约为36万美元;使用开源千亿密集模型(在A100显卡上部署)的年成本约为12万美元;而采用Hunyuan-A13B(在RTX 4090显卡上部署)的年成本仅约1.5万美元。由此可见,Hunyuan-A13B能够帮助企业将部署成本降低90%以上,极大地提升了AI技术的可及性。

推动边缘计算与垂直领域深度应用

Hunyuan-A13B的256K超长上下文与高效推理特性,使其在众多垂直领域具有广阔的应用前景:在工业质检场景中,它能够实时分析生产线传感器数据,异常检测准确率高达98.2%;在医疗文书处理方面,可一次性解析300页电子病历,关键信息提取完整度达到91%;在智能座舱领域,通过车载GPU部署可实现毫秒级语音响应,并支持多轮对话记忆功能,为用户带来流畅的交互体验。

开源生态加速技术普惠化进程

为了推动AI技术的普惠化,腾讯同时开源了ArtifactsBench和C3-Bench两个评估数据集,填补了代码生成视觉评估与智能体复杂任务测评领域的空白。目前,Hunyuan-A13B模型已在主流开源社区上线,并提供了从训练到部署的全流程工具链,方便开发者快速上手。个人开发者只需通过以下简单命令即可快速启动模型:

git clone https://gitcode.com/tencent_hunyuan/Hunyuan-A13B-Instruct-GPTQ-Int4

cd Hunyuan-A13B-Instruct-GPTQ-Int4

llama-cli -hf . -p "你的问题" -n 4096 temp 0.7 --top-k 20 --top-p 0.8

总结与展望

Hunyuan-A13B的开源无疑是大模型发展历程中的一个重要转折点,它标志着大模型技术从"参数竞赛"转向"效率竞赛"的新方向。通过将千亿级模型的能力压缩至普通硬件可承载的规模,腾讯为AI技术的普惠化提供了关键的技术基座。展望未来,随着混合专家架构与量化技术的进一步融合与创新,我们有理由相信"手机运行千亿模型"的场景将在不久的将来成为现实。

对于企业而言,当前正是评估和采用高效模型替代方案的最佳时机。这不仅能够显著降低算力成本,还可以有效避免 vendor lock-in 风险。建议企业在选型过程中,重点关注模型在特定业务场景的微调效果以及与现有系统的集成能力,从而构建可持续发展的AI技术栈。

随着混元A13B等高效模型的普及,AI产业正迎来一场意义深远的"第二次启蒙"。这不仅体现在技术层面的突破,更重要的是让人工智能真正走进每个开发者、每个企业、每个行业,为社会经济的发展注入新的活力。我们有理由期待,在不久的将来,AI技术将以更加亲民的姿态服务于人类社会的方方面面,创造出更多的价值。

【项目获取】Hunyuan-A13B-Instruct-GGUF

腾讯Hunyuan-A13B-Instruct-GGUF是高效开源大模型,采用MoE架构,800亿总参数中仅130亿激活,性能媲美大模型。支持256K超长上下文,兼具快慢推理模式,优化代理任务,多量化格式实现高效推理,适合资源受限场景的高级推理与通用应用

项目地址: https://ai.gitcode.com/tencent_hunyuan/Hunyuan-A13B-Instruct-GGUF

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

项目地址: https://ai.gitcode.com/tencent_hunyuan/Hunyuan-A13B-Instruct-GPTQ-Int4

项目地址: https://ai.gitcode.com/tencent_hunyuan/Hunyuan-A13B-Instruct-GPTQ-Int4

所有评论(0)