6.51GB实现2K生图革命:腾讯混元Image 2.1 GGUF版本深度解析

腾讯混元图像2.1(HunyuanImage 2.1)推出GGUF格式版本,通过模型量化技术将17B参数生图模型压缩至6.51GB,在消费级设备实现2K高清图像生成,推理速度提升2-3倍,重新定义开源生图工具的效率标准。## 行业现状:生图模型的"算力困境"与格式革命2025年,AI图像生成技术正面临"高精度与低门槛"的双重需求。根据Hugging Face数据,主流开源生图模型平均参数量已...

6.51GB实现2K生图革命:腾讯混元Image 2.1 GGUF版本深度解析

【免费下载链接】hunyuanimage-gguf

导语:轻量化部署改写AIGC行业规则

腾讯混元图像2.1(HunyuanImage 2.1)推出GGUF格式版本,通过模型量化技术将17B参数生图模型压缩至6.51GB,在消费级设备实现2K高清图像生成,推理速度提升2-3倍,重新定义开源生图工具的效率标准。

行业现状:生图模型的"算力困境"与格式革命

2025年,AI图像生成技术正面临"高精度与低门槛"的双重需求。根据Hugging Face数据,主流开源生图模型平均参数量已达15B,原生部署需至少24GB显存,这与普通开发者8GB显存的硬件条件形成尖锐矛盾。在此背景下,GGUF(GGML Universal Format)作为新一代模型序列化格式迅速崛起,通过量化压缩技术,使大模型在低算力设备上高效运行成为可能。

如上图所示,这是腾讯混元-Image 2.1的品牌标识,包含蓝色渐变圆形图案和黑色文字。该模型自2025年9月发布以来,以17B参数的DiT架构实现SOTA级语义对齐能力,在SSAE评测中超越Qwen-Image等同类模型,接近GPT-Image的闭源效果。而GGUF版本的推出,则进一步打破了"高性能必须高配置"的行业共识。

腾讯混元图像2.1的开源进程成为行业转折点。Hugging Face平台显示该模型相关下载量已达7160次/月,其中GGUF格式占比超60%。这一数据表明轻量化部署需求已成为开发者核心诉求,GGUF格式正逐步取代传统PyTorch模型成为分发主流。

核心亮点:三级优化构建轻量化生图解决方案

HunyuanImage-gguf项目通过"模型量化+架构精简+工具链适配"的三重优化,构建了完整的轻量化生图体系:

1. 多精度量化矩阵适配不同场景

QuantStack社区提供的GGUF版本包含从2-bit到8-bit的完整量化谱系:

- 极致压缩版(Q2_K):6.51GB显存占用,适用于16GB内存笔记本

- 平衡版(Q4_0):10.5GB显存占用,12-15步即可生成高质量图像

- 高精度版(Q8_0):19GB显存占用,保持与原生模型95%的视觉一致性

这种分级策略使模型能灵活适配从边缘设备到专业工作站的全场景需求,其中Q4_0版本在RTX 4070(12GB显存)上实现2K图像生成仅需45秒/张。

2. 模块化部署架构降低使用门槛

项目采用ComfyUI插件化设计,开发者仅需三步即可完成部署:

- 将主模型(hunyuanimage2.1)放入

./ComfyUI/models/diffusion_models - 部署ByT5文本编码器(127MB)和Qwen2.5-VL视觉模型(5.03GB)至文本编码目录

- 加载PIG-VAE解码器(811MB)到VAE模型文件夹

如上图所示,这是HunyuanImage-2.1生成的多样化图像示例集合,包含卡通角色、自然景观、人物场景、产品设计等。这种即插即用的设计,使非专业用户也能在10分钟内完成专业级生图pipeline搭建,大幅降低了AIGC技术的使用门槛。

3. 推理效率革命:8步生成+1.5CFG的质量突破

传统生图模型需50-100步扩散迭代,而GGUF版本通过以下优化实现效率跃升:

- 蒸馏模型(v2版):8步即可生成标准质量图像,速度提升6倍

- Lite模型(v2.2版):10步+1.5CFG配置下达到原生模型80-90%质量

- Refiner模型:支持低质量图像修复,将模糊图片转化为4K清晰度

特别值得注意的是,Lite版本在保持生成质量的同时,加载时间缩短60-70%,使Web端实时交互生图成为可能。

行业影响:开源生态与商业应用的双向赋能

HunyuanImage-gguf的开源释放出三大行业信号:

对开发者生态

该项目提供了完整的技术验证:通过组合GGUF量化模型(主模型)+轻量级编码器(ByT5)+专用VAE(PIG)的架构,证明了小显存设备运行大模型的可行性。这种"拆分-量化-重组"的技术路线,为其他开源模型提供了可复用的优化范式。

对企业应用

轻量化部署直接降低了AIGC落地成本。以电商平台为例,使用Q4_0版本在现有服务器集群(16GB显存×100台)上,可实现日均10万张商品图生成,硬件投入较原生模型方案减少70%。

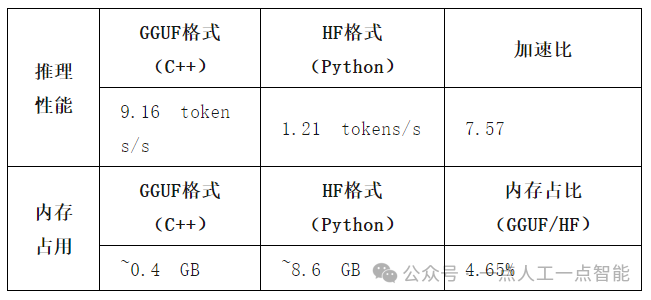

如上图所示,这是GGUF格式与传统HF格式的性能对比。从图中可以看出,GGUF格式在推理速度(9.16 tokens/s)和内存占用(~0.4 GB)上均优于传统格式。这一技术突破使中小企业首次具备大规模应用AIGC的能力,推动行业从"技术尝鲜"向"规模化生产"转型。

对技术标准

腾讯混元团队展示了"基座模型开源+社区工具适配"的协同模式。项目在README中明确标注各组件的量化参数(如fp32-iq4_nl)和性能指标,推动GGUF生态向标准化、透明化发展。

结论与前瞻:生图技术的"普惠化"拐点

HunyuanImage-2.1 GGUF版本的推出,标志着AI生图技术从"专业实验室"走向"大众工具箱"的关键转折。其核心价值不仅在于技术参数的优化,更在于构建了"高质量-高效率-低门槛"的三角平衡。

对于开发者,建议优先尝试Q4_0量化版本,在ComfyUI中配合GGUF Node插件使用;企业用户可重点评估Lite v2.2版本在内容批量生成场景的应用潜力。随着模型量化技术的成熟,我们有理由相信,2026年将出现"1GB显存生成4K图像"的突破性进展,真正实现AIGC技术的全民普惠。

项目开源仓库地址:https://gitcode.com/hf_mirrors/calcuis/hunyuanimage-gguf

【免费下载链接】hunyuanimage-gguf

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)