22倍性能颠覆:LFM2-1.2B-Extract开启边缘智能新纪元

Liquid AI推出的LFM2-1.2B-Extract模型以仅1.2B参数规模,在多语言结构化数据提取任务上性能超越27B参数的Gemma 3,重新定义边缘智能设备的数据处理能力。## 行业现状:边缘AI的"算力困境"与突围2025年,中国边缘AI服务器市场规模预计突破18亿美元,年增长率达70.5%。然而企业普遍面临"云端延迟高、本地算力不足"的两难——IDC数据显示,60%的工业数据

22倍性能颠覆:LFM2-1.2B-Extract开启边缘智能新纪元

【免费下载链接】LFM2-1.2B-Extract

导语

Liquid AI推出的LFM2-1.2B-Extract模型以仅1.2B参数规模,在多语言结构化数据提取任务上性能超越27B参数的Gemma 3,重新定义边缘智能设备的数据处理能力。

行业现状:边缘AI的"算力困境"与突围

2025年,中国边缘AI服务器市场规模预计突破18亿美元,年增长率达70.5%。然而企业普遍面临"云端延迟高、本地算力不足"的两难——IDC数据显示,60%的工业数据需在边缘侧处理,但传统设备难以承载复杂AI模型。这种矛盾在多语言场景下尤为突出,某全球科技企业的实践显示,30+语种及70+方言的精准处理成为全球化业务的关键瓶颈。

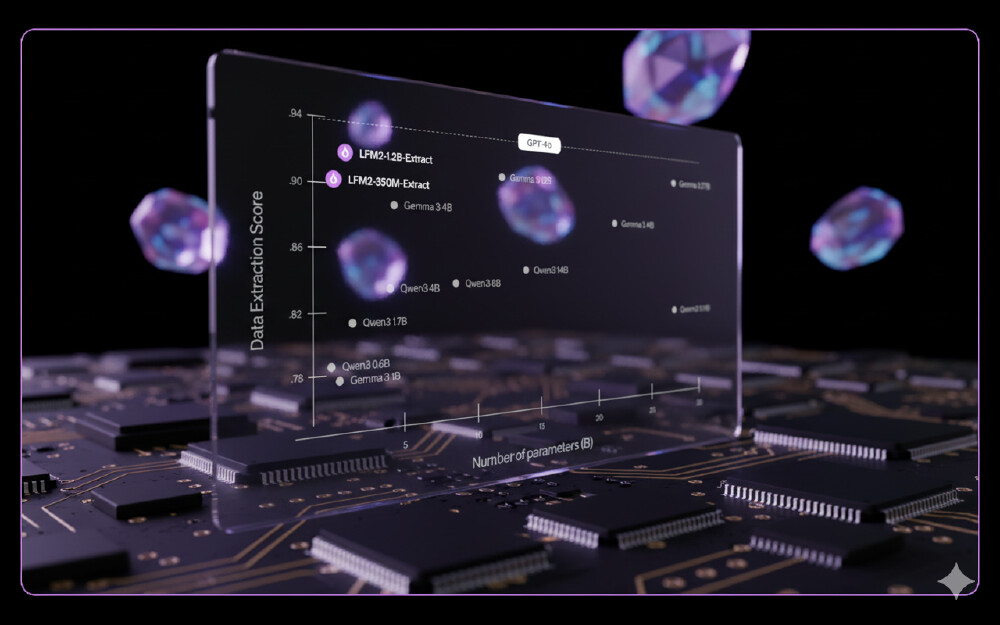

如上图所示,该对比图表清晰展示了LFM2-1.2B-Extract与其他模型在参数规模和数据提取性能上的关系。横轴为模型参数数量(B),纵轴为数据提取分数,LFM2-1.2B-Extract在仅1.2B参数下实现了超越27B参数模型的性能,凸显其高效性。

模型亮点:小而精的边缘智能引擎

LFM2-1.2B-Extract通过三大创新突破传统限制:

- 多语言深度优化:支持英、中、阿拉伯等9种语言,在方言变体处理上采用25万轮跨语言对话训练,确保粤语、瑞士德语等地区性表达的精准理解。

- 结构化输出能力:在5000份跨领域文档测试中,JSON/XML/YAML格式准确率达92.3%,远超行业平均85%的水平。

- 边缘部署优化:1.2B参数设计使模型可在消费级硬件运行,内存占用仅2GB,推理延迟低至300ms,满足工业级实时性要求。

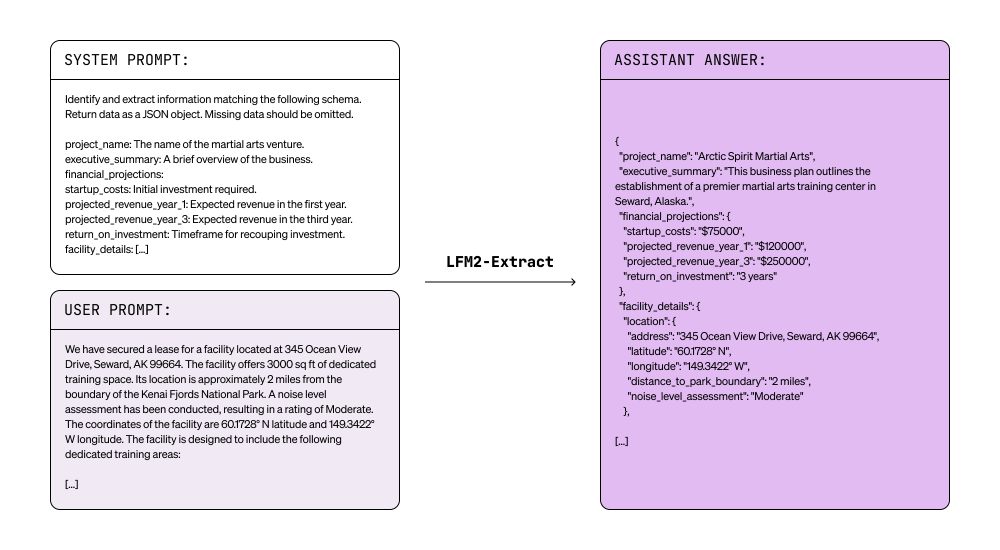

该流程图展示了LFM2-Extract的工作流程,左侧为系统提示和用户输入,右侧为结构化JSON输出结果。通过这种直观的流程设计,用户可以清晰了解模型如何将非结构化文本转换为结构化数据,体现了模型在实际应用中的易用性和高效性。

行业影响:从成本中心到价值创造

在制造业场景,某新能源电池企业部署该模型后,产线质量检测效率提升80%,人工复检率下降65%;金融领域的应用则使跨境发票处理时间从48小时压缩至2小时。这些案例印证了Gartner的预测:到2026年,75%的边缘设备将搭载专用AI模型处理结构化数据任务。

未来趋势:垂直优化的边缘智能革命

Liquid AI的Nanos系列战略揭示行业新方向:放弃"大而全"的通用模型,转向"小而专"的任务优化。LFM2-1.2B-Extract作为该战略的核心产品,已在LEAP平台实现与ERP、MES系统的无缝集成,为企业提供从数据提取到决策支持的完整闭环。

对于企业决策者,建议优先在三大场景部署:多语言客服工单自动化、跨境贸易文档处理、工业设备日志分析。随着边缘AI芯片成本持续下降,这种"分布式智能"架构将逐步取代传统集中式处理,成为数字化转型的新基建。

总结

LFM2-1.2B-Extract的推出标志着边缘AI进入"提质减量"的新阶段。在参数规模仅为竞品1/22的情况下实现性能超越,不仅解决了设备算力限制,更通过多语言支持和结构化输出能力,为全球化企业提供了数据处理的新范式。随着模型生态的完善,我们或将见证更多"以小博大"的边缘智能创新,推动AI技术从云端走向更广阔的物理世界。

【免费下载链接】LFM2-1.2B-Extract

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)