英伟达送你免费算力,GLM和Minimax随便用

不用花两万块买显卡,也不用折腾Docker部署。英伟达NIM平台开放免费API,支持国产顶级模型GLM-4.7和Minimax-M2.1,3分钟拿到密钥就能用。本文手把手教你申请,附完整配置参数。

显卡买不起,但AI照样用得起

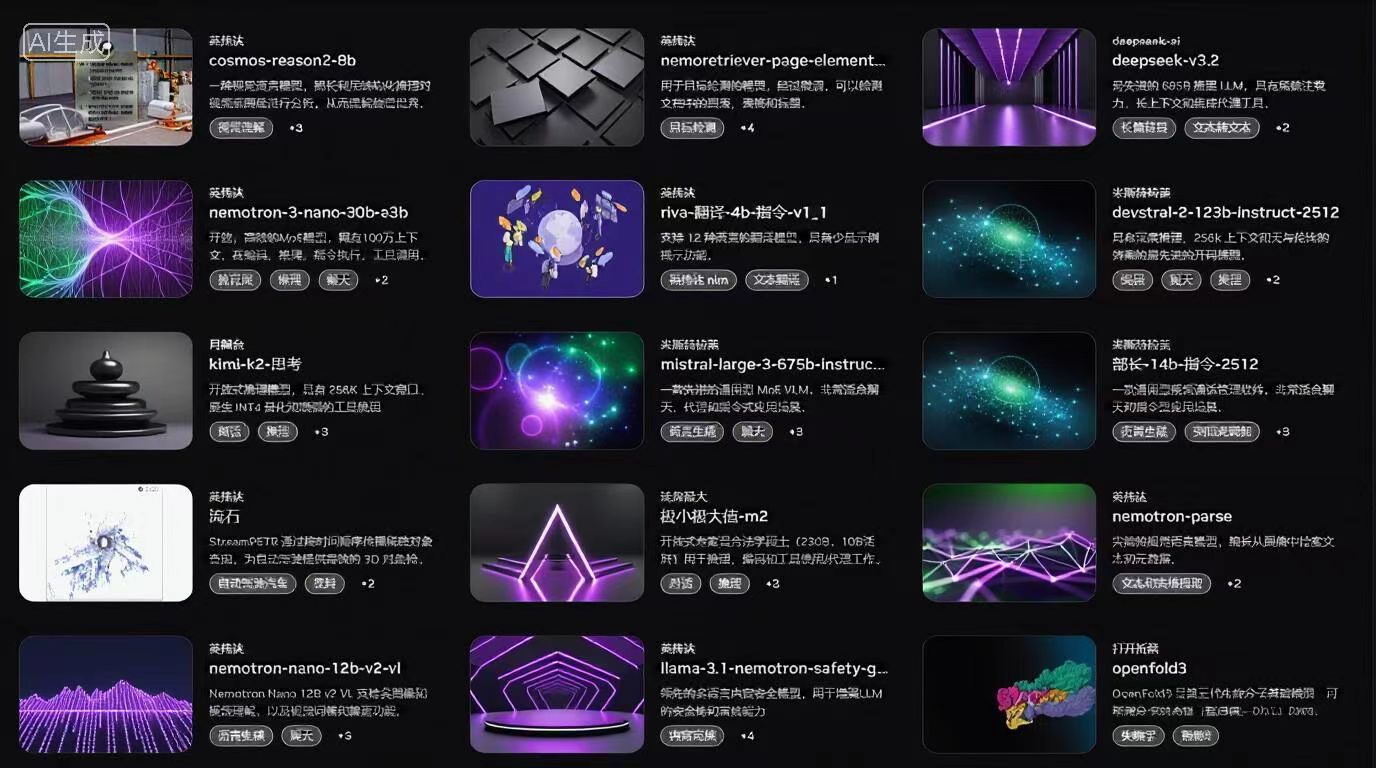

前两天翻英伟达的网站,无意中发现了个好东西——他们的NIM平台,现在可以免费调用GLM-4.7和Minimax这两个国产模型。

什么概念呢?就是说,你不用花两万多买张RTX 5090,也不用在自己电脑上装Docker、配环境、下模型文件。只要拿到一个API密钥,直接用英伟达的服务器算力,按照OpenAI那套标准接口就能调。

对咱们这些想在编辑器里集成AI功能,或者做点小项目测试的人来说,这事儿实在太合适了。今天就把整个流程给大家说清楚。

三分钟拿到通行证

整个申请过程,我掐着表试了一遍,确实用不了多久。

第一步:注册账号

打开英伟达NIM的页面:build.nvidia.com/explore/discover

没账号的话,用邮箱注册一个。这个邮箱以后管理密钥要用,别随便填。

第二步:验证手机号

这一步很多人担心。其实不用怕,咱们国内的+86手机号完全支持。

注册完之后,系统会让你验证手机号,防止接口被乱用。在验证页面选"China",输入号码,收个验证码就行。我试过,短信来得挺快。

第三步:生成密钥

验证通过后,在模型列表里随便点开一个(密钥是通用的,点哪个都行)。

找到右上角的"Get API Key"按钮,点进去生成。

生成完一定要马上复制保存!这个密钥是以"nvapi-"开头的一长串字符,页面刷新可能就找不到了。

###怎么用?直接抄作业

拿到密钥之后,最常见的用法就是配到代码编辑器里。下面这套参数适用于所有支持OpenAI协议的工具,比如VSCode的AI插件、Cursor、沉浸式翻译这些。

配置参数:

API Provider: OpenAI Compatible

Base URL: https://integrate.api.nvidia.com/v1

API Key: 填你申请的 nvapi-xxxx...

Model ID: - 用智谱的话填:zhipu-ai/glm-4-9b

- 用Minimax的话填:minimaxai/minimax-m2.1填完保存,就能直接调用了。

为什么值得试试?

额度够用

目前的限制是每分钟40次请求。听起来不多?其实对个人用户来说,这个量基本等于敞开用。

除非你是要批量处理几千条数据,否则日常写代码、润色文章、翻译内容,根本碰不到这个上限。

模型靠谱

GLM和Minimax都是国产模型里的头部选手。尤其是处理中文、理解长文本这些场景,效果往往比原版的Llama系列还要好。

现在能通过英伟达的服务器免费跑,速度和稳定性都有保障,不用担心自己的小破电脑带不动。

最后说一句

这种大厂的免费服务,建议赶紧申请一个密钥备着。

💡 工具推荐:我日常在用 ChatTools (https://chattools.top) 处理AI需求,支持Claude、GPT等主流模型,完全免费且无需魔法上网。

📰 想了解AI行业最新动态?推荐 AI Inking (https://aiinking.com),实时追踪AI资讯,我常去看看有什么新鲜事。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)