深度学习篇---ECA模块

ECA模块是一种高效的轻量级通道注意力机制,通过局部跨通道交互优化特征权重分配。相比SENet,ECA摒弃降维操作,采用1D卷积直接捕捉邻近通道的依赖关系,并自适应调整卷积核大小以适应不同网络层级。其优势包括:极低参数量(如ResNet50仅增加80参数)、显著性能提升(优于SENet/CBAM)以及动态适应能力。ECA通过全局平均池化→1D卷积→Sigmoid激活的简洁流程实现特征重标定,成为即

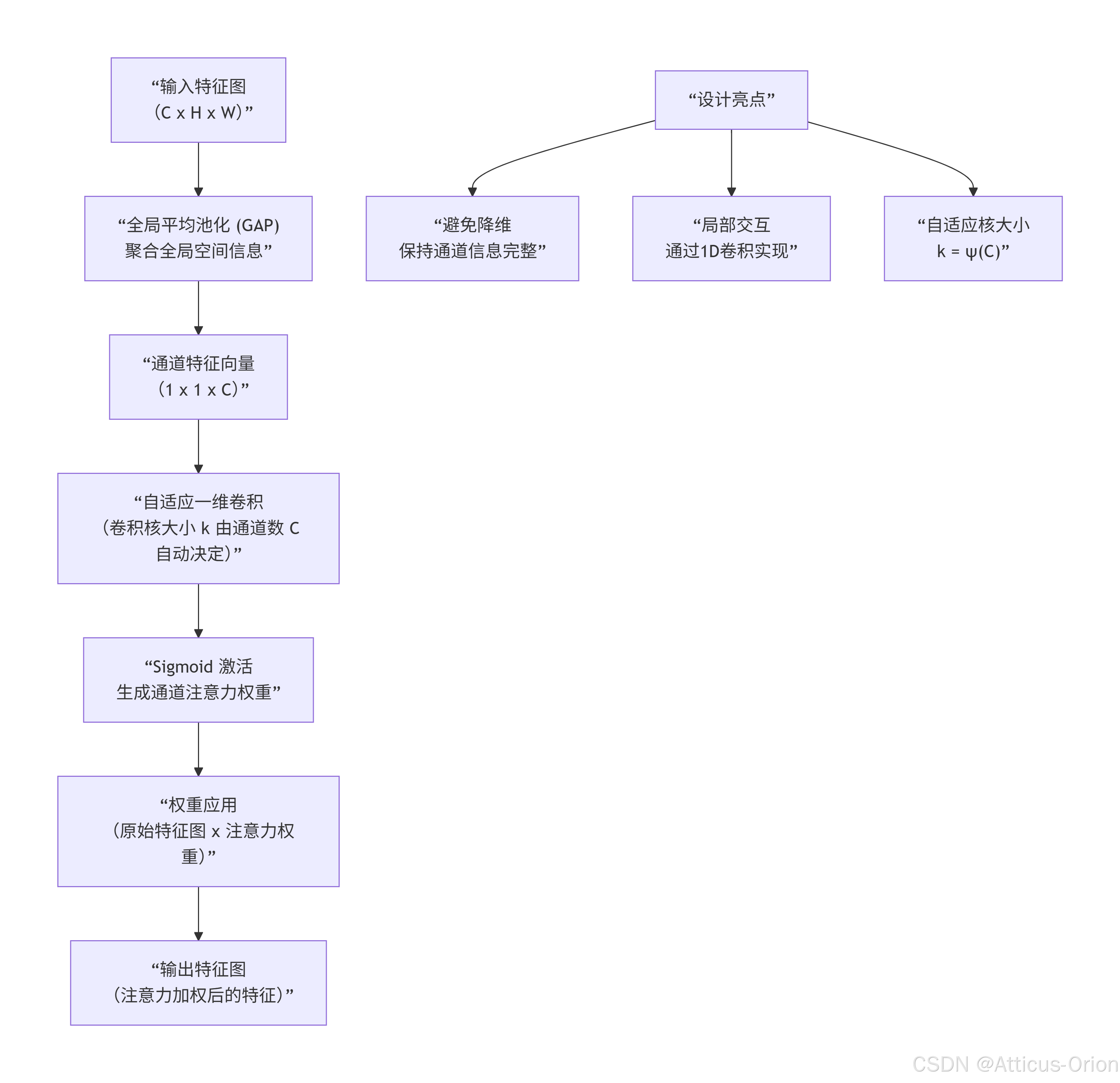

ECA模块(Efficient Channel Attention)是一种在计算机视觉领域广泛应用的轻量级注意力机制。它主要解决了一个核心矛盾:如何在不增加模型复杂度的前提下,有效提升通道注意力的性能。下面我将从设计动机、核心原理、工作机制和优势特点几个方面,为你全面介绍ECA机制,并在最后附上一张总结性的Mermaid流程图。

1. 设计动机:对SENet的反思

在ECA被提出之前,SENet(Squeeze-and-Excitation Network)是最具代表性的通道注意力方法。SENet通过全局平均池化和两个全连接层(第一个全连接层进行降维,第二个全连接层恢复维度)来学习通道权重。

然而,ECA的作者通过实验分析指出,SENet中的降维操作会对通道注意力的预测产生负面影响,因为它丢失了通道与其依赖关系之间的直接对应信息。并非所有通道都需要复杂的非线性关系来捕捉注意力,某些简单的局部交互可能就足够了。基于这一观察,ECA模块被设计出来,旨在用更简单、更高效的方式实现有效的通道注意力。

2. 核心原理:局部跨通道交互与1D卷积

ECA模块的核心思想是避免降维,并捕捉局部跨通道交互。它通过以下步骤实现:

-

全局信息嵌入(Squeeze):首先,使用全局平均池化将输入特征图(尺寸为

H x W x C)的空间维度进行压缩,生成一个1 x 1 x C的通道描述符。这一步与SENet相同,目的是聚合全局空间信息。 -

局部跨通道交互(Excitation):这是ECA最创新的部分。为了利用聚合后的通道信息,ECA并没有使用全连接层,而是采用了一个卷积核大小为k的一维卷积。这个一维卷积作用于全局平均池化后的通道向量上,只考虑每个通道与其k个相邻通道之间的交互信息。这种机制假设通道注意力通常只在局部范围内相关,即“近邻通道”之间的依赖关系更为重要。

-

自适应选择卷积核大小:对于不同的CNN架构,最佳的局部交互范围(即1D卷积的核大小k)是不同的。ECA提出了一种自适应确定k的方法:让k与通道维数C成正比。通常,通道数越多,需要交互的邻域范围也应相应扩大。其映射关系可以表示为:

k = ψ(C) = | (log₂(C) + b) / γ |_odd,其中|·|_odd表示取最近的奇数。这种自适应机制使得ECA模块可以无缝嵌入到不同层级的网络中,而无需手动调参。 -

权重应用(Reweight):通过一维卷积生成的权重经过Sigmoid函数激活后,得到最终的通道注意力权重。然后将这些权重逐通道乘以原始的输入特征图,完成对特征图的重标定。

3. 工作机制与代码结构

从代码实现的角度看,ECA模块的结构非常简洁。一个典型的ECA模块包含以下几个部分:

-

输入层:接收一个形状为

(Batch, Channels, Height, Width)的特征图。 -

全局平均池化层:将空间维度

(H, W)压缩为(1, 1),输出形状为(Batch, Channels, 1, 1)。 -

重塑层 (Squeeze):将池化后的结果进行维度压缩,去掉最后两个维度,变为

(Batch, Channels),或者重塑为适合1D卷积的格式(Batch, 1, Channels)。 -

一维卷积层:对上述通道向量执行一维卷积。卷积核大小

k根据通道数自适应确定,padding 设置为(k - 1) // 2以保证输入输出长度一致。 -

激活函数层:使用Sigmoid函数将卷积输出映射到

[0, 1]之间,作为通道权重。 -

权重应用层:将得到的权重

(Batch, Channels, 1, 1)与原始输入特征图进行逐元素相乘,得到加权后的输出。

这种设计使得ECA模块成为一种即插即用的组件,可以非常方便地集成到现有的任何卷积神经网络中,如ResNet、MobileNet等。

4. 主要优势

-

极高的效率:ECA模块仅引入了极少的额外参数和计算量。例如,在ResNet50中,ECA模块仅增加约80个参数,而性能提升却非常明显。

-

显著的性能提升:由于其避免了降维带来的信息损失,并通过局部交互精准捕捉通道依赖,ECA在ImageNet分类、COCO目标检测等任务上均超越了SENet和CBAM等经典方法。

-

自适应能力:通过自动确定1D卷积的核大小,ECA能够根据网络的深度和通道数动态调整感受野,具有良好的泛化能力。

5. 总结框图

为了更直观地理解ECA模块在整个网络中的工作流程,下图展示了其核心计算逻辑:

流程图解读:

上图清晰地展示了ECA的数据流。输入特征图经过GAP压缩后,并没有像SENet那样进入复杂的全连接层进行降维和升维,而是直接通过一个轻量级的1D卷积进行局部交互。这种设计是ECA能够在保持高效的同时实现高性能的关键。

总结来说,ECA注意力机制通过其创新的设计,为深度学习领域提供了一个“大道至简”的优秀范例,证明了在通道注意力建模中,有时“少即是多”。它目前已经成为改进各种卷积神经网络的首选轻量级注意力模块之一。

更多推荐

已为社区贡献82条内容

已为社区贡献82条内容

所有评论(0)